|

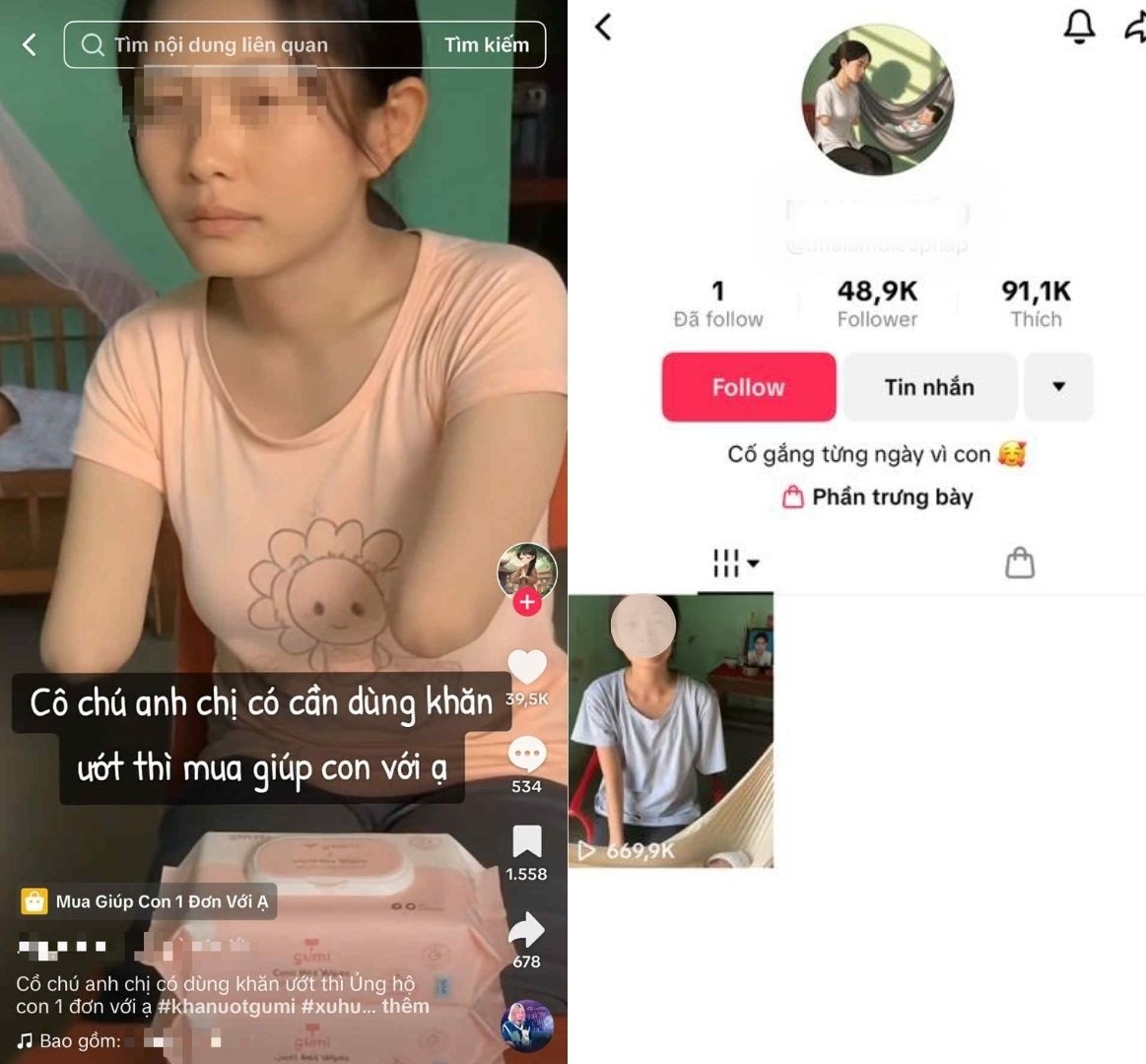

AI를 이용해 판매자를 사칭하는 계정. 사진: TikTok . |

최근 일련의 첨단 AI 도구가 등장하면서 몇 가지 명령만으로 사진과 비디오를 제작하는 것이 훨씬 간편해졌습니다. 하지만 인터넷 사용자들이 진짜와 가짜를 구별하는 능력은 이러한 발전을 따라가지 못했으며, 일부 주체들이 이를 악용하여 수익을 창출하고 있습니다.

최근 소셜 미디어에서 한 틱톡 계정이 빠르게 확산되고 있습니다. 두 팔이 절단된 여성이 어린 자녀들을 부양하기 위해 물건을 팔아야 하는 모습을 담은 영상들이 게시되었습니다. 영상 속 여성은 수수한 옷을 입고, 키친타월이나 세제 같은 물품들을 소개하는 애틋한 말투를 사용합니다.

기록에 따르면, 이 여성은 남편이 사고로 일찍 세상을 떠나 홀로 어린아이를 키우는 상황을 공유했지만, 영상에서는 일관된 이야기가 나오지 않았습니다. 해당 계정은 수백만 건 이상의 조회수와 소통을 기록하며 채널 개설 3일 만에 팔로워 10만 명을 돌파했습니다. 많은 사람들이 위로의 말을 전하고, 지원을 요청하며, 심지어 도움을 줄 물품을 주문하기도 했습니다.

사용자들은 유사한 콘텐츠를 보유한 계정을 계속해서 발견합니다. 이러한 채널의 공통점은 새로 생성된 개인 페이지이고, 실제 상호작용 기록이 없으며, 지나치게 감정적인 콘텐츠를 공유하는 경우가 많다는 것입니다.

|

이러한 채널은 대개 새롭고 명확한 프로필이 없습니다. |

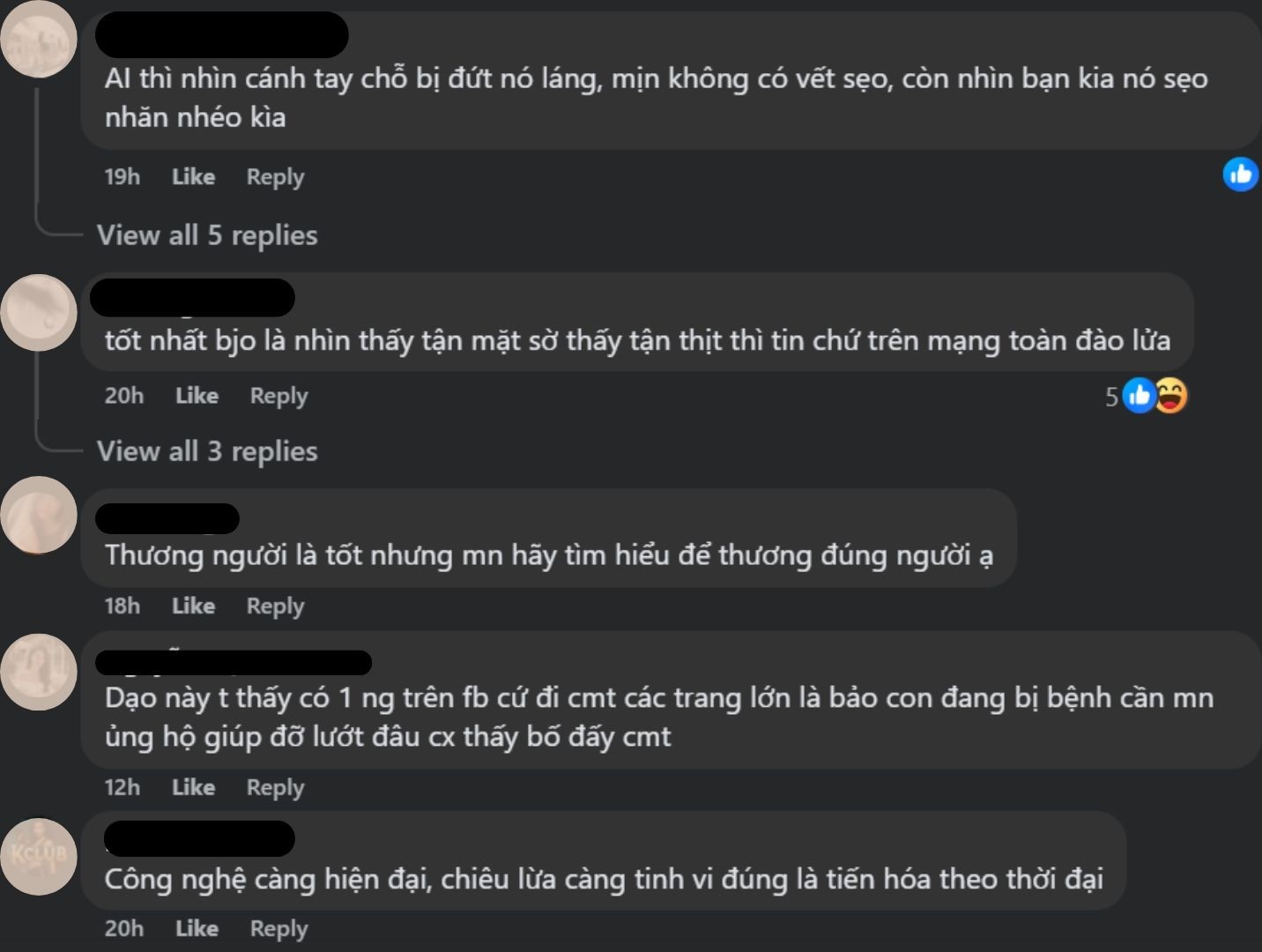

하지만 얼마 후, 네티즌들은 각 영상에서 이상하고 앞뒤가 맞지 않는 부분을 발견했습니다. 예를 들어, 여성의 잘린 팔이 매우 매끈해 보였고, 집 벽의 페인트가 달랐으며, 아기가 이상하게 가만히 누워 있었습니다. 그 이유는 모든 영상이 AI가 다른 사람들을 속이기 위해 만들어낸 것이었기 때문입니다.

경고 또는 폭로 댓글이 계정 소유자에 의해 숨겨지거나 삭제되었다는 점에 유의해야 합니다. 많은 사람들이 속았다는 사실에 불쾌감을 느꼈을 뿐만 아니라, 사람들의 동정심을 이용해 이익을 취하려는 행동에 분개했습니다.

또한, 이러한 가짜 영상은 같은 플랫폼에서 생계를 이어가는 운영자와 다른 장애인들에게도 영향을 미칩니다. 푸토 에 사는 응아틱꾹(Nga Tich Cuc) 채널 운영자인 쩐 티 응아(36세) 씨는 자신이 실제로 팔을 절단했다고 계속해서 말해야 했습니다.

2024년 말, 이 여성은 급성 바이러스성 심근염에 걸려 사지를 모두 절단해야 했고, 가족의 사랑으로 새 삶을 시작했습니다. 최근 생방송에서 그녀는 의심받고 혹독한 말을 들은 것에 대한 슬픔을 표했습니다.

이렇게 새로 만든 채널들은 빠르게 많은 팔로워를 확보하면서 차별화를 더욱 어렵게 만들었습니다. 비슷한 콘텐츠를 보유한 NLS라는 또 다른 계정은 단 한 번의 영상만으로 팔로워가 거의 5만 명에 달했습니다.

|

사용자들은 속았을 때 분노와 신뢰 상실을 표현했습니다. |

따라서 온라인 커뮤니티가 자신들이 보는 것에 대한 신뢰를 점차 잃어가고, 결국 진정으로 도움이 필요한 사람들을 돌보지 않는 것을 비난할 수는 없습니다. 한 댓글에서는 AI 기술을 이용하여 커뮤니티의 감정을 악용하는 사람들은 비난받아 마땅하다고 주장했습니다.

사이버 사기 수법은 점점 더 정교해지고 있으며, 접촉이 뜸한 사람이나 노령층을 노리고 있습니다. 대부분의 계정 소유자는 입원이나 장애 등 트라우마를 겪는 사람들의 이미지를 사용하여 쇼핑 카트를 첨부하거나 계좌 번호를 남겨 지원 요청을 하고 있습니다.

CNBC는 이전에 AI를 이용해 다운증후군 환자를 사칭하는 인스타그램, 유튜브, 틱톡 계정 30개 이상을 적발했습니다. 이들은 팔로워를 늘리고 지역 사회 모금을 촉구하기 위해 가슴 아픈 사연을 이용했지만, 실제로는 해당 계정을 자신들의 이익을 위해 도용했습니다.

이 사건은 AI가 현실감 있는 콘텐츠를 재현하는 능력을 악의적인 행위자들이 악용할 가능성을 경고합니다. 기술이 급속도로 발전함에 따라, 사용자들은 기술을 대중화하는 동시에 사랑하는 사람들이 온라인 사기의 피해자가 되지 않도록 도와야 합니다.

출처: https://znews.vn/video-nghi-ai-gia-nguoi-khuet-tat-ban-hang-gay-buc-xuc-post1598306.html

댓글 (0)