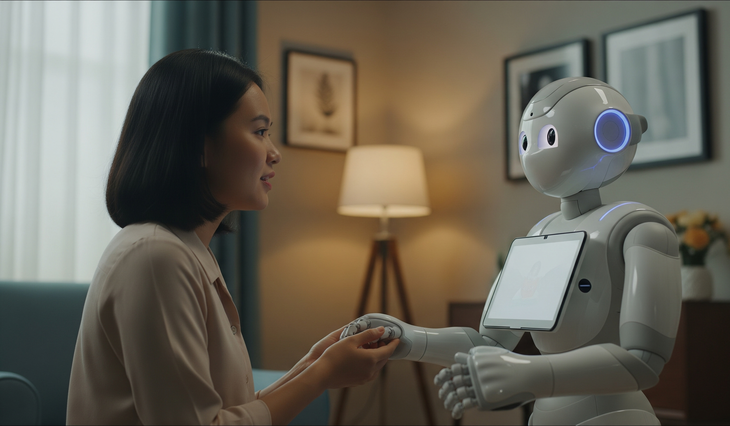

ຮູບພາບດັ່ງກ່າວສະແດງໃຫ້ເຫັນເຖິງບຸກຄົນທີ່ວາງໃຈໃນຫຸ່ນຍົນບຳບັດທາງຈິດ.

Psychotherapy ເຄີຍເປັນການເດີນທາງທີ່ຮຽກຮ້ອງໃຫ້ມີການຟັງທີ່ເອົາໃຈໃສ່ແລະເຫັນອົກເຫັນໃຈ. ແຕ່ດ້ວຍການພັດທະນາຂອງປັນຍາປະດິດແລະເຕັກໂນໂລຢີການປຸງແຕ່ງພາສາທໍາມະຊາດ, ຫຸ່ນຍົນການປິ່ນປົວແບບໃຫມ່ກໍາລັງເກີດຂື້ນ.

ບໍ່ຈໍາເປັນຕ້ອງໄປຫ້ອງການ, ບໍ່ມີທ່ານຫມໍທີ່ແທ້ຈິງ, ພຽງແຕ່ໂທລະສັບຫຼືແທັບເລັດພຽງພໍທີ່ຈະເລີ່ມຕົ້ນ "ການສົນທະນາ" ກັບຫຸ່ນຍົນ. ແຕ່ນີ້ຍັງເຮັດໃຫ້ເກີດຄໍາຖາມສໍາລັບຫຼາຍໆຄົນ: ຄໍາຕອບຈາກເຄື່ອງຈັກມີປະສິດທິພາບແທ້ໆໃນການຜ່ອນຄາຍອາລົມ?

ຫຸ່ນຍົນບຳບັດທາງຈິດກຳລັງກາຍເປັນອັດສະລິຍະຫຼາຍຂຶ້ນ.

ການເພີ່ມຂຶ້ນຂອງຕົວແບບພາສາຂະຫນາດໃຫຍ່ (LLMs) ເຊັ່ນ GPT, Claude, ແລະ Gemini ໄດ້ເປີດໃຊ້ຫຸ່ນຍົນການປິ່ນປົວເພື່ອຕິດຕໍ່ສື່ສານຕາມທໍາມະຊາດ, ສະຫນອງການຕອບສະຫນອງທີ່ສອດຄ່ອງແລະ empathetic. ການເລີ່ມຕົ້ນເຊັ່ນ Wysa, Woebot, ແລະ Replika ໄດ້ພັດທະນາແອັບພລິເຄຊັນສົນທະນາທີ່ໃຊ້ AI ທີ່ສາມາດຮັບຮູ້ຄວາມຮູ້ສຶກຜ່ານຂໍ້ຄວາມແລະປັບການຕອບສະຫນອງເພື່ອໃຫ້ກົງກັບອາລົມຂອງຜູ້ໃຊ້.

ຢູ່ເບື້ອງຫຼັງການສົນທະນາທີ່ເບິ່ງຄືວ່າງ່າຍດາຍເຫຼົ່ານີ້ແມ່ນ ລະບົບການປະມວນຜົນພາສາທີ່ສັບສົນ , ປະສົມປະສານການຮຽນຮູ້ເຄື່ອງຈັກແລະການວິເຄາະອາລົມ. ແບບຈໍາລອງ AI ໄດ້ຖືກຝຶກອົບຮົມໂດຍໃຊ້ການສົນທະນາທີ່ບໍ່ເປີດເຜີຍຊື່ລ້ານໆຄົນ, ພ້ອມກັບກອບທິດສະດີຂອງຈິດໃຈທາງດ້ານພຶດຕິກໍາ.

ເມື່ອຜູ້ໃຊ້ສົ່ງຂໍ້ຄວາມເຊັ່ນ "ຂ້ອຍຮູ້ສຶກເມື່ອຍແລະຫມົດຫວັງ", ລະບົບບໍ່ພຽງແຕ່ຕອບສະຫນອງດ້ວຍຄໍາເວົ້າທີ່ປອບໂຍນແຕ່ຍັງສາມາດຮັບຮູ້ອາການຂອງຄວາມທຸກໃຈແລະແນະນໍາການປະຕິບັດການປັບຕົວຂອງມັນສະຫມອງ.

ນອກເຫນືອຈາກການປຸງແຕ່ງຂໍ້ຄວາມ, ບາງລະບົບຍັງປະສົມປະສານ AI ເພື່ອວິເຄາະການປາກເວົ້າ, ການຮັບຮູ້ລະດັບຄວາມກົດດັນໂດຍຜ່ານຄວາມໄວໃນການເວົ້າ, intonation, ຫຼືຄວາມຖີ່ຂອງຄວາມງຽບ. ນີ້ອະນຸຍາດໃຫ້ຫຸ່ນຍົນ "ກວດພົບ" ການປ່ຽນແປງເລັກນ້ອຍໃນຄວາມຮູ້ສຶກເຖິງແມ່ນວ່າໃນເວລາທີ່ຜູ້ໃຊ້ບໍ່ໄດ້ເວົ້າ.

ການຕອບສະ ໜອງ ຍັງກາຍເປັນ ທຳ ມະຊາດຫຼາຍຂຶ້ນ, ບໍ່ມີສູດຄືກັບ chatbots ເກົ່າ, ຍ້ອນຕົວແບບທີ່ຮຽນຮູ້ຢ່າງຕໍ່ເນື່ອງຈາກການໂຕ້ຕອບທີ່ຜ່ານມາ.

ເທກໂນໂລຍີຄອມພິວເຕີ້ຟັງຄລາວຊ່ວຍ synchronize ຂໍ້ມູນທັງຫມົດ, ຮັບປະກັນປະສົບການການສົນທະນາທີ່ບໍ່ລຽບງ່າຍບໍ່ວ່າທ່ານຈະໃຊ້ໂທລະສັບຫຼືຄອມພິວເຕີ. AI ບໍ່ພຽງແຕ່ອີງໃສ່ສິ່ງທີ່ຜູ້ໃຊ້ເວົ້າ; ມັນຮຽນຮູ້ຈາກປະຫວັດການສົນທະນາ, ເວລາປະຕິສໍາພັນ, ຄວາມຖີ່ຂອງຄໍາທີ່ໃຊ້ໃນຄວາມຮູ້ສຶກ, ແລະອື່ນໆອີກເພື່ອ ປັບຮູບແບບການຕອບສະຫນອງຂອງມັນໃຫ້ກັບແຕ່ລະຄົນ . ນັ້ນແມ່ນເຫດຜົນທີ່ຄົນຈໍານວນຫຼາຍຮູ້ສຶກວ່າຫຸ່ນຍົນການປິ່ນປົວແມ່ນ "ຮູ້ຈັກ" ພວກມັນຢ່າງແທ້ຈິງໃນໄລຍະເວລາ.

ເມື່ອເຄື່ອງສາມາດຟັງໄດ້, ມັນບໍ່ໄດ້ຫມາຍຄວາມວ່າມັນເຂົ້າໃຈ.

ອີງຕາມການຄົ້ນຄວ້າຂອງ Tuoi Tre Online , ບໍ່ວ່າ AI ສາມາດວິເຄາະພາສາໄດ້ດີປານໃດ, ຍັງມີ ຊ່ອງຫວ່າງລະຫວ່າງຄວາມເຂົ້າໃຈ semantics ແລະຄວາມຮູ້ສຶກ . ຫຸ່ນຍົນອາດຈະຕອບສະຫນອງດ້ວຍຄໍາເວົ້າມາດຕະຖານຂອງການຊຸກຍູ້, ແຕ່ມັນຂາດຄວາມອົບອຸ່ນທີ່ມາຈາກຄວາມເມດຕາຂອງມະນຸດ.

ໃນກໍລະນີຂອງວິກິດການສຸຂະພາບຈິດຮ້າຍແຮງ, ຫຸ່ນຍົນຍັງບໍ່ທັນສາມາດທົດແທນການຕອບສະຫນອງທັນເວລາ, ໂດຍສະເພາະໃນເວລາທີ່ການປະຕິບັດສະເພາະ, ການແຊກແຊງ, ຫຼືການຊ່ວຍເຫຼືອສຸກເສີນແມ່ນຈໍາເປັນ.

ນອກຈາກນັ້ນ, ລະບົບ AI ຍັງຂຶ້ນກັບຂໍ້ມູນທີ່ສະຫນອງໃຫ້. ຖ້າຊຸດຂໍ້ມູນການຝຶກອົບຮົມຂາດຄວາມຫຼາກຫຼາຍໃນວັດທະນະທໍາ, ພາສາທ້ອງຖິ່ນ, ຫຼືການສະແດງອອກ, ຄໍາຕອບຂອງຫຸ່ນຍົນອາດຈະມີຄວາມຮູ້ສຶກ "ເຢັນ" ຫຼືບໍ່ຖືກຕ້ອງໃນສະພາບການສະເພາະ.

ບາງແອັບຍັງມີຂໍ້ຈຳກັດເມື່ອຜູ້ໃຊ້ສະແດງອາລົມທາງອ້ອມ ຫຼືໃຊ້ຄຳປຽບທຽບ – ເຊິ່ງເປັນເລື່ອງທຳມະດາຫຼາຍໃນການສົນທະນາທາງຈິດຕະວິທະຍາ.

ຍິ່ງໄປກວ່ານັ້ນ, ຄວາມກັງວົນກ່ຽວກັບຄວາມເປັນສ່ວນຕົວບໍ່ສາມາດຖືກລະເລີຍໃນຍຸກດິຈິຕອນຂອງມື້ນີ້. ເນື່ອງຈາກ ຂໍ້ມູນທາງຈິດຕະວິທະຍາເປັນຂໍ້ມູນທີ່ລະອຽດອ່ອນ , ຖ້າບໍ່ຖືກເຂົ້າລະຫັດ ແລະ ຄວບຄຸມຢ່າງຖືກຕ້ອງ, ມັນສາມາດມີຄວາມສ່ຽງຮ້າຍແຮງຕໍ່ການຮົ່ວໄຫຼ. ໃນຂະນະທີ່ເຕັກໂນໂລຢີກາຍເປັນສ່ວນບຸກຄົນຫຼາຍຂຶ້ນ, ການແບ່ງປັນອາລົມກັບລະບົບເຄື່ອງຈັກຮຽກຮ້ອງໃຫ້ມີຄວາມເຂົ້າໃຈກ່ຽວກັບຄວາມສ່ຽງທີ່ກ່ຽວຂ້ອງ.

ປະຕິເສດບໍ່ໄດ້, ເຕັກໂນໂລຢີໄດ້ເຮັດໃຫ້ການດູແລສຸຂະພາບຈິດສາມາດເຂົ້າເຖິງໄດ້ຫຼາຍກວ່າແຕ່ກ່ອນ. AI ແລະຫຸ່ນຍົນປິ່ນປົວສາມາດເຮັດຫນ້າທີ່ເປັນຄູ່ຮ່ວມງານເບື້ອງຕົ້ນ, ສະຫນອງການບັນເທົາທຸກຊົ່ວຄາວຈາກຄວາມຮູ້ສຶກທີ່ຫຍຸ້ງຍາກ. ຢ່າງໃດກໍ່ຕາມ, ການວາງຄວາມໄວ້ວາງໃຈຢ່າງສົມບູນໃນເຄື່ອງຈັກຍັງຮຽກຮ້ອງໃຫ້ມີຄວາມລະມັດລະວັງ.

ໂດຍການເຂົ້າໃຈຂໍ້ຈໍາກັດຂອງເຕັກໂນໂລຢີ, ຜູ້ໃຊ້ຈະຮູ້ວິທີການນໍາໃຊ້ຜົນປະໂຫຍດຂອງມັນໂດຍບໍ່ຕ້ອງເພິ່ງພາອາໄສ, ເພື່ອໃຫ້ພວກເຂົາຢູ່ໃນການຄວບຄຸມອາລົມຂອງພວກເຂົາ - ແທນທີ່ຈະຖືກຈັດການໂດຍສາຍລະຫັດທີ່ສະຫລາດ.

ທີ່ມາ: https://tuoitre.vn/robot-tri-lieu-tam-ly-co-thau-hieu-hay-chi-biet-lang-nghe-20250618102426124.htm

![[ວີດີໂອ] ຫັດຖະກຳປະດິດສ້າງ ດົ່ງໂຮ່ ໄດ້ຮັບການຈາລຶກຈາກອົງການ UNESCO ເຂົ້າໃນບັນຊີລາຍຊື່ເຄື່ອງຫັດຖະກຳ ທີ່ຕ້ອງການການປົກປັກຮັກສາດ່ວນ.](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/12/10/1765350246533_tranh-dong-ho-734-jpg.webp)

(0)