Serang dari setiap sudut.

Google telah melancarkan produk kecerdasan buatan (AI) baharu yang dipanggil "Gemini Nano Banana," yang bukanlah AI linguistik (LLM) berskala besar yang mampu menulis dan menaakul, sebaliknya AI yang mengkhusus dalam penyuntingan foto... Ramai pengguna teruja dengan alat ini, tetapi ia juga membawa beberapa kekurangan.

“Ia seperti ‘langkah ke belakang’ dalam teknologi AI dan batasan etika,” kata Nguyen Hong Phuc, Ketua Pegawai Saintifik Conductify AI, menyuarakan pendapat peribadinya. “Gemini Nano Banana mempunyai keupayaan penyuntingan imej yang berkesan. Tetapi tindakan Google yang tidak menapis Gemini Nano Banana, melonggarkan halangan dan mekanisme pengehadan, membolehkan AI ini mencipta imej yang sangat serupa dengan selebriti, imej yang sugestif, imej sensitif, dan sebagainya,” kata Phuc.

Menurut Encik Nguyen Hong Phuc, keupayaan ini menjadikan Gemini Nano Banana alat untuk mencipta imej palsu yang realistik, sehingga pakar AI pun tidak dapat membezakannya, yang membawa kepada risiko baharu penipuan dan keselamatan siber, seperti mencipta gambar palsu dengan ahli politik terkenal untuk menyebarkan maklumat palsu, malah individu yang menjadi sasaran manipulasi foto dan fitnah yang dihasilkan oleh AI di media sosial...

Tambahan pula, dengan berpuluh-puluh alat penyuntingan foto AI lain yang menggegarkan internet, penipuan deepfake tidak menunjukkan tanda-tanda akan berhenti. Statistik daripada organisasi keselamatan menunjukkan bahawa teknologi deepfake mewujudkan kempen pancingan data yang menyasarkan individu bernilai tinggi, terutamanya pemimpin perniagaan. Pada tahun 2024, terdapat 140,000-150,000 kes di seluruh dunia, dengan 75% menyasarkan CEO dan eksekutif kanan... Deepfake boleh meningkatkan kerugian ekonomi global sebanyak 32%, kira-kira $40 bilion setahun menjelang 2027.

Baru-baru ini, syarikat AI Anthropic mengesan dan menggagalkan kempen serangan siber yang dijalankan oleh penggodam asing, yang buat pertama kalinya merekodkan penggunaan AI untuk menyelaras aktiviti serangan automatik. Secara khususnya, penggodam menggunakan sistem AI untuk merancang, mengarah dan menggunakan operasi pencerobohan – satu perkembangan "membimbangkan" yang berisiko mengembangkan skala dan kelajuan kempen serangan siber…

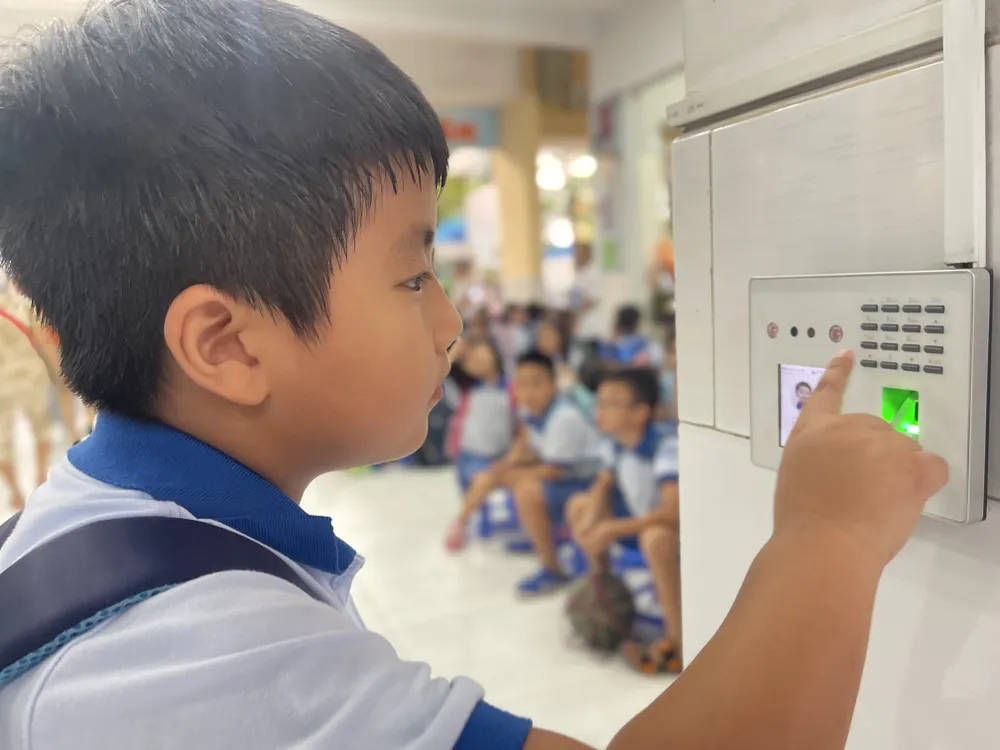

Encik Ngo Minh Hieu, Pengarah Pertubuhan Anti-Penipuan Persatuan Keselamatan Siber Kebangsaan, berkongsi bahawa alat bersepadu AI meningkatkan kelajuan penipuan sebanyak kira-kira 20 kali ganda berbanding menggunakan orang sebenar. Penipu menyediakan AI dengan senario penipuan untuk dianalisis, dan sistem akan segera bersembang secara automatik dengan mangsa. Daripada data awal, AI boleh memahami apa yang mangsa mahukan dan berkomunikasi dengan mereka dalam masa nyata. Taktik yang paling canggih ialah serangan "Man-in-the-Middle", di mana apabila pengguna melakukan pengesahan video (seperti merakam wajah mereka atau memberi arahan), penggodam campur tangan untuk mengganggu data yang dihantar. Penjenayah siber kemudian memasukkan video deepfake yang telah disediakan terlebih dahulu, menggantikan aliran data sebenar pengguna untuk memintas proses pengesahan. Dengan kaedah ini, sistem keselamatan bank dan institusi kewangan juga berisiko tertipu.

Pengurusan data yang lebih baik

Memandangkan AI semakin berleluasa, risiko keselamatan dan privasi juga meningkat dengan ketara. Data yang disimpan dan diproses pada pelayan jauh akan menjadi sasaran menarik bagi penggodam dan penjenayah siber. Menurut data daripada Persatuan Keselamatan Siber Kebangsaan, pada suku kedua tahun 2025 sahaja, bilangan serangan siber berkuasa AI meningkat sebanyak 62%, menyebabkan kerugian global sehingga $18 bilion...

Pakar percaya perlindungan data adalah penting. Walau bagaimanapun, pengumpulan dan penjualan data berterusan secara terbuka di banyak platform "pasaran gelap", dengan harga serendah $20 sebulan. Penjenayah siber boleh menggunakan alat yang meniru model bahasa tetapi disesuaikan untuk tujuan jenayah. Alat ini mampu menghasilkan perisian hasad dan juga memintas perisian antivirus.

Di Vietnam, Dekri No. 13/2023/ND-CP (berkuat kuasa mulai 17 April 2023) mengawal selia perlindungan data peribadi. Tambahan pula, Undang-undang Perlindungan Data Peribadi, yang dijangka berkuat kuasa pada 1 Januari 2026, akan membuka mekanisme perundangan yang lebih kukuh untuk menangani risiko kebocoran dan penyalahgunaan data peribadi. Walau bagaimanapun, menurut Persatuan Keselamatan Siber Kebangsaan, keberkesanan penguatkuasaan masih perlu diperkukuhkan merentasi tiga tonggak: meningkatkan kesedaran awam, meningkatkan tanggungjawab korporat dan meningkatkan kapasiti pemprosesan agensi kawal selia. Selain langkah teknikal, setiap individu perlu membangunkan keupayaan untuk mengenal pasti tanda-tanda yang luar biasa dan mencurigakan serta melindungi diri mereka secara proaktif daripada interaksi digital yang berbahaya…

Kaspersky telah memberi amaran tentang eksploitasi Dark AI (istilah yang merujuk kepada penggunaan model bahasa besar (LLM) yang beroperasi di luar kawalan keselamatan standard, yang selalunya membolehkan tindakan seperti pancingan data, manipulasi, serangan siber atau penyalahgunaan data). Organisasi dan individu perlu bersedia untuk menghadapi serangan siber yang semakin canggih dan sukar dikesan disebabkan oleh kebangkitan Dark AI di rantau Asia Pasifik.

Sergey Lozhkin, Ketua Pasukan Penyelidikan dan Analisis Global (GReAT) untuk wilayah Timur Tengah, Turki, Afrika dan Asia Pasifik di Kaspersky, berkongsi bahawa salah satu manifestasi penyalahgunaan AI semasa ialah kemunculan model Black Hat GPT. Ini adalah model AI yang dibangunkan atau diubah suai khusus untuk tujuan yang tidak beretika dan menyalahi undang-undang, seperti mencipta perisian hasad, mencipta e-mel pancingan data yang fasih dan persuasif untuk serangan berskala besar, mencipta suara dan video deepfake, malah menyokong serangan simulasi.

Pakar Kaspersky mengesyorkan agar individu dan perniagaan menggunakan penyelesaian keselamatan generasi akan datang untuk mengesan perisian hasad yang dihasilkan oleh AI, di samping mengutamakan perlindungan data. Perniagaan harus melaksanakan alat pemantauan masa nyata untuk mengesan eksploitasi kerentanan yang didorong oleh AI; memperkukuh kawalan akses dan latihan pekerja untuk mengehadkan AI dalam zon gelap dan risiko kebocoran data; dan mewujudkan pusat operasi keselamatan siber untuk memantau ancaman dan bertindak balas dengan cepat terhadap insiden.

Sumber: https://www.sggp.org.vn/bao-mat-du-lieu-thoi-ai-post824210.html

![[Video] Matahari Terbenam di Lap An Lagoon – Tempat matahari terbenam di atas jaring ikan](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/05/31/1780192137701_beach-landscape-sea-water-nature-grass-745871-pxhere-com.jpeg)

![[Imej] Simfoni yang cemerlang dan kuasa letupan di langit Da Nang.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/05/31/1780193150738_anh-bia-copy-jpg.webp)

![[Video] Matahari Terbenam di Lap An Lagoon – Tempat matahari terbenam di atas jaring ikan](https://vphoto.vietnam.vn/thumb/800x450/vietnam/resource/IMAGE/2026/05/31/1780192137701_beach-landscape-sea-water-nature-grass-745871-pxhere-com.jpeg)

![[Video] Matahari Terbenam di Lap An Lagoon – Tempat matahari terbenam di atas jaring ikan](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2026/05/31/1780192137701_beach-landscape-sea-water-nature-grass-745871-pxhere-com.jpeg)

Komen (0)