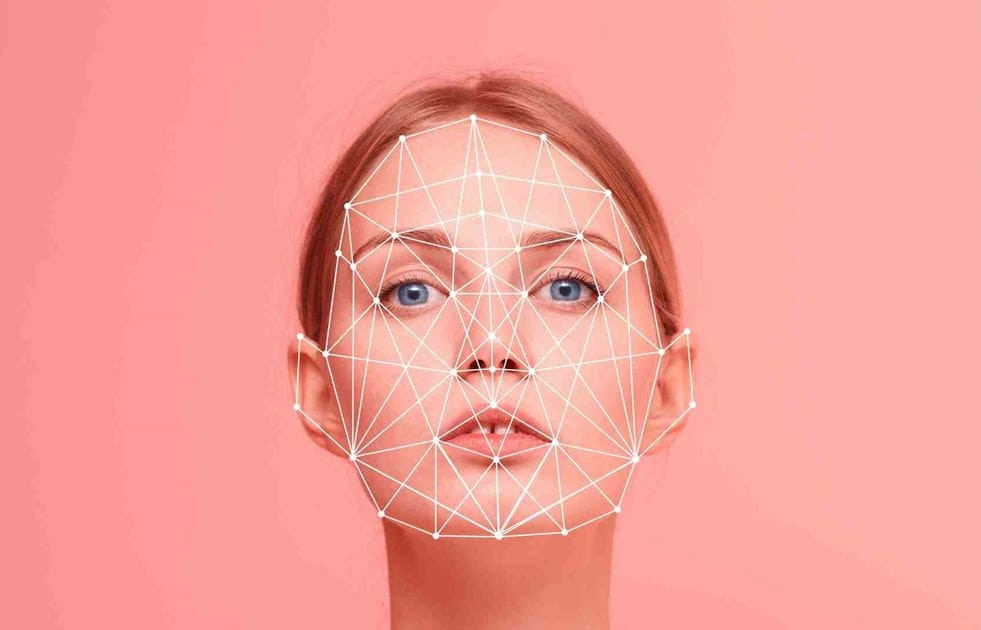

Deepfake is een term die is ontstaan door de woorden 'Deep Learning' en 'Fake' te combineren. Simpel gezegd is het een technologie die nep-audio, -visuele of zelfs -videoproducten simuleert en creëert.

Sinds de explosieve groei van kunstmatige intelligentie (AI) is het probleem van deepfakes steeds vaker voorgekomen, wat leidt tot een golf van desinformatie in de media. Het proactief verifiëren van de herkomst van afbeeldingen en video's is daarom een dringende kwestie voor toonaangevende camerafabrikanten wereldwijd .

Naar verwachting zullen Sony, Canon en Nikon digitale camera's op de markt brengen die digitale handtekeningen direct op hun spiegelloze (of DSLR) camera's ondersteunen. De implementatie van digitale handtekeningen op camera's is een cruciale stap die bewijs van herkomst en beeldintegriteit biedt.

Deze digitale handtekeningen bevatten informatie over de datum, tijd, locatie en fotograaf, en zijn fraudebestendig. Dit is vooral belangrijk voor fotojournalisten en andere professionals wiens werk authenticatie vereist.

Drie giganten in de camera-industrie zijn het eens geworden over een wereldwijde standaard voor digitale handtekeningen die compatibel zijn met de online verificatietool Verify. Deze tool, geïntroduceerd door een coalitie van wereldwijde nieuwsorganisaties, technologiebedrijven en camerafabrikanten, maakt het mogelijk om gratis de authenticiteit van elke afbeelding te verifiëren. Als een afbeelding is gemaakt of bewerkt met behulp van AI, zal Verify deze markeren als 'Geen inhoudsgegevens'.

Het belang van anti-deepfake-technologieën vloeit voort uit de snelle toename van deepfake-producten met bekende figuren zoals voormalig Amerikaans president Donald Trump en de Japanse premier Fumio Kishida.

Daarnaast hebben onderzoekers van de Tsinghua Universiteit in China een nieuw, gegeneraliseerd AI-model ontwikkeld dat in staat is om ongeveer 700.000 afbeeldingen per dag te genereren.

Naast camerafabrikanten mengen ook andere technologiebedrijven zich in de strijd tegen deepfakes. Google heeft een tool uitgebracht om AI-gegenereerde afbeeldingen digitaal van een watermerk te voorzien, terwijl Intel technologie heeft ontwikkeld om veranderingen in huidtinten in foto's te analyseren en zo de authenticiteit ervan te bepalen. Hitachi doet ook onderzoek naar technologie om online identiteitsfraude te voorkomen.

De nieuwe technologie zal naar verwachting begin 2024 op de markt komen. Sony is van plan de technologie te promoten bij de media en heeft in oktober 2023 veldproeven uitgevoerd. Canon werkt samen met Thomson Reuters en het Starling Data Preservation Lab (een onderzoeksinstituut opgericht door Stanford University en de University of Southern California) om de technologie verder te verfijnen.

Camerafabrikanten hopen dat de nieuwe technologie het publieke vertrouwen in beelden zal herstellen en daarmee onze perceptie van de wereld zal veranderen.

(volgens OL)

Betaal $5.000 aan Facebook om deepfake-video's van beleggingsfraude te verspreiden.

Nieuwe malware neemt smartphones over en deepfake-video's worden steeds geavanceerder.

Deepfake-video's worden steeds geavanceerder en realistischer.

Wat kunt u doen om te voorkomen dat u slachtoffer wordt van deepfake-videogesprekken die worden gebruikt om mensen te misleiden en geld af te troggelen?

Deepfake wordt misbruikt om de gezichten van slachtoffers over pornografische video's heen te plaatsen.

Bron

Reactie (0)