Angrip fra alle vinkler.

Google har lansert et nytt produkt for kunstig intelligens (KI) kalt «Gemini Nano Banana», som ikke er en storskala språklig KI (LLM) som er i stand til å skrive og resonnere, men snarere en KI som spesialiserer seg på fotoredigering... Mange brukere er begeistret for dette verktøyet, men det har også en rekke ulemper.

«Det er som et «skritt tilbake» innen AI-teknologi og etiske begrensninger», sa Nguyen Hong Phuc, vitenskapelig sjef i Conductify AI, og uttrykte sin personlige mening. «Gemini Nano Banana har effektive bilderedigeringsmuligheter. Men Googles avsensurering av Gemini Nano Banana, som løsner barrierene og begrensende mekanismer, lar denne AI-en lage bilder som er utrolig like kjendiser, suggestive bilder, sensitive bilder osv.», sa Phuc.

Ifølge Nguyen Hong Phuc gjør denne funksjonen Gemini Nano Banana til et verktøy for å lage realistiske falske bilder, i en slik grad at selv AI-eksperter ikke kan skille dem fra hverandre, noe som fører til nye risikoer for svindel og cybersikkerhet, som å lage falske bilder med kjente politikere for å spre falsk informasjon, og til og med at enkeltpersoner blir utsatt for AI-generert fotomanipulasjon og ærekrenkelse på sosiale medier ...

Videre, med dusinvis av andre AI-bilderedigeringsverktøy som tar internett med storm, viser deepfake-svindel ingen tegn til å stoppe. Statistikk fra sikkerhetsorganisasjoner viser at deepfake-teknologi skaper phishing-kampanjer rettet mot verdifulle individer, spesielt bedriftsledere. I 2024 var det 140 000–150 000 tilfeller globalt, hvorav 75 % var rettet mot administrerende direktører og toppledere ... Deepfakes kan øke globale økonomiske tap med 32 %, omtrent 40 milliarder dollar per år innen 2027.

Nylig oppdaget og avverget AI-selskapet Anthropic en cyberangrepskampanje utført av utenlandske hackere, som for første gang registrerte bruk av AI for å koordinere automatiserte angrepsaktiviteter. Hackerne brukte spesifikt AI-systemer til å planlegge, dirigere og distribuere inntrengingsoperasjoner – en «bekymringsfull» utvikling som risikerer å øke omfanget og hastigheten på cyberangrepskampanjer ...

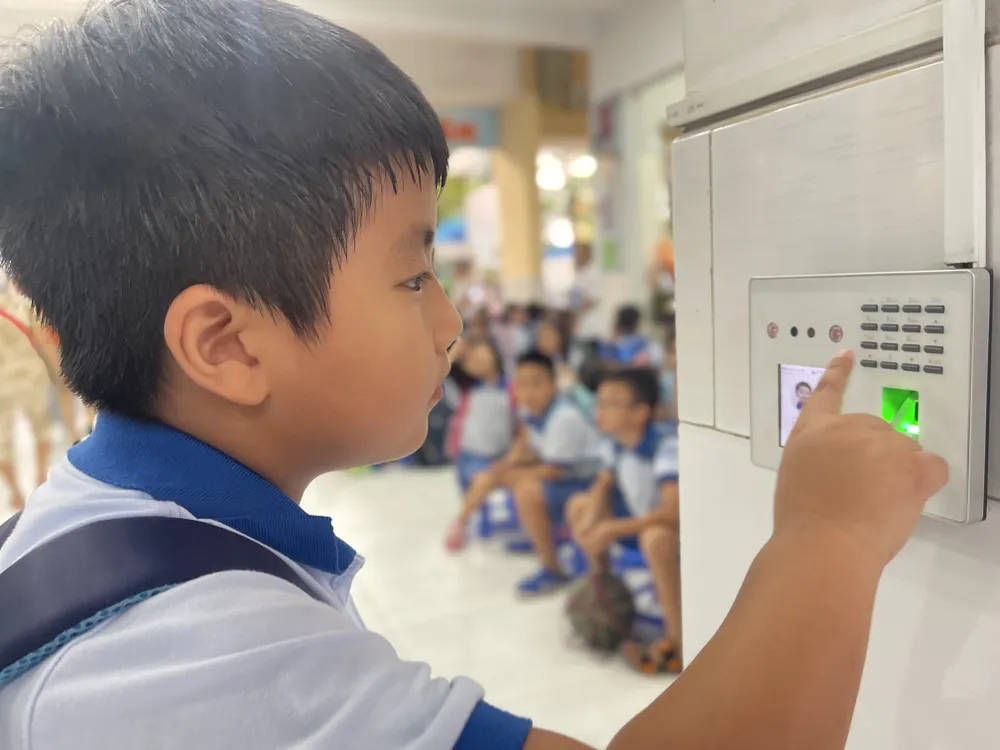

Ngo Minh Hieu, direktør for antisvindelorganisasjonen til National Cybersecurity Association, fortalte at AI-integrerte verktøy øker hastigheten på svindel med omtrent 20 ganger sammenlignet med å bruke ekte mennesker. Svindlere gir AI-en et svindelscenario for analyse, og systemet chatter umiddelbart automatisk med ofrene. Fra de første dataene kan AI-en forstå hva offeret ønsker og kommunisere med dem i sanntid. Den mest sofistikerte taktikken er "Man-in-the-Middle"-angrepet, der hackeren griper inn for å forstyrre de overførte dataene når en bruker utfører videoautentisering (for eksempel å ta opp ansiktet sitt eller gi kommandoer). Nettkriminelle setter deretter inn forhåndsdefinerte deepfake-videoer, og erstatter brukerens virkelige datastrøm for å omgå autentiseringsprosessen. Med denne metoden risikerer også sikkerhetssystemene til banker og finansinstitusjoner å bli lurt.

Bedre datahåndtering

Etter hvert som AI blir stadig mer utbredt, øker også sikkerhets- og personvernrisikoene betydelig. Data lagret og behandlet på eksterne servere vil bli et attraktivt mål for hackere og nettkriminelle. Ifølge data fra National Cyber Security Association økte antallet AI-drevne nettangrep med 62 % bare i andre kvartal 2025, noe som forårsaket globale tap på opptil 18 milliarder dollar...

Eksperter mener databeskyttelse er avgjørende. Innsamling og salg av data fortsetter imidlertid åpent på mange «svartebørs»-plattformer, for så lite som 20 dollar per måned. Nettkriminelle kan bruke verktøy som etterligner språkmodeller, men som er tilpasset kriminelle formål. Disse verktøyene er i stand til å generere skadelig programvare og til og med omgå antivirusprogramvare.

I Vietnam regulerer dekret nr. 13/2023/ND-CP (i kraft fra 17. april 2023) beskyttelsen av personopplysninger. Videre vil loven om beskyttelse av personopplysninger, som forventes å tre i kraft 1. januar 2026, åpne opp for en sterkere juridisk mekanisme for å håndtere risikoen for lekkasjer og misbruk av personopplysninger. Ifølge National Cybersecurity Association må imidlertid effektiviteten av håndhevingen fortsatt styrkes på tvers av tre søyler: øke offentlig bevissthet, øke bedriftsansvaret og forbedre behandlingskapasiteten til reguleringsorganer. Utover tekniske tiltak må hver enkelt utvikle evnen til å identifisere uvanlige og mistenkelige tegn og proaktivt beskytte seg mot farlige digitale interaksjoner ...

Kaspersky har advart om utnyttelsen av mørk kunstig intelligens (et begrep som refererer til utrulling av store språkmodeller (LLM-er) som opererer utenfor standard sikkerhetskontroller, og som ofte muliggjør handlinger som phishing, manipulasjon, cyberangrep eller datamisbruk). Organisasjoner og enkeltpersoner må forberede seg på å møte stadig mer sofistikerte og vanskeligere å oppdage cyberangrep på grunn av fremveksten av mørk kunstig intelligens i Asia-Stillehavsregionen.

Sergey Lozhkin, leder for det globale forsknings- og analyseteamet (GReAT) for Midtøsten, Tyrkia, Afrika og Asia-Stillehavsregionene hos Kaspersky, delte at én manifestasjon av dagens misbruk av kunstig intelligens er fremveksten av Black Hat GPT-modeller. Dette er kunstig intelligens-modeller som er spesielt utviklet eller modifisert for å tjene uetiske og ulovlige formål, for eksempel å lage skadelig programvare, lage flytende og overbevisende phishing-e-poster for storskala angrep, lage dypfalske stemmer og videoer, og til og med støtte simulerte angrep.

Kaspersky-eksperter anbefaler at enkeltpersoner og bedrifter bruker neste generasjons sikkerhetsløsninger for å oppdage AI-generert skadelig programvare, samtidig som de prioriterer databeskyttelse. Bedrifter bør implementere sanntidsovervåkingsverktøy for å spore AI-drevet sårbarhetsutnyttelse; styrke tilgangskontroll og opplæring av ansatte for å begrense AI i den mørke sonen og risikoen for datalekkasjer; og etablere et driftssenter for cybersikkerhet for å overvåke trusler og reagere raskt på hendelser.

Kilde: https://www.sggp.org.vn/bao-mat-du-lieu-thoi-ai-post824210.html

![[Foto] Generalsekretær og president To Lam mottar Amazons senior visepresident David Zapolsky](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/05/22/1779466547770_a1-bnd-3513-6601-jpg.webp)

Kommentar (0)