Potencjalne ryzyko związane z rozpowszechnianiem dezinformacji

Nauka i technologia nie tylko wpływają na sposób przekazywania wiadomości przez prasę i media, ale także na sposób i skuteczność dostępu do informacji, a także mają ogromny wpływ na jakość informacji.

W rzeczywistości dziennikarstwo szybko adaptowało się do innowacji technologicznych, zwłaszcza w ostatnich latach. Sztuczna inteligencja (AI) stopniowo zyskała popularność w mediach masowych i redakcjach agencji prasowych. Zastosowanie AI przyniosło korzyści zarówno dziennikarzom, jak i organizacjom medialnym. Uwalnia dziennikarzy od żmudnych, codziennych zadań, oszczędzając im czas i pozwalając skupić się na bardziej kreatywnej i wymagającej wysokich kwalifikacji pracy.

Choć sztuczna inteligencja ma wiele zalet, budzi też pewne obawy. Jednym z największych zagrożeń jest możliwość rozpowszechniania dezinformacji za pośrednictwem treści generowanych przez sztuczną inteligencję.

Dziesięć największych agencji informacyjnych na świecie apeluje o wspólne i przejrzyste negocjacje między mediami a twórcami sztucznej inteligencji, mające na celu kontrolę nad tym, które materiały chronione prawem autorskim mogą być wykorzystywane w narzędziach szkoleniowych sztucznej inteligencji, a także wyeliminowanie stronniczości w algorytmach sztucznej inteligencji.

W zeszłym tygodniu 10 wiodących światowych agencji prasowych podpisało list wzywający do przejrzystości i jasnych przepisów dotyczących praw autorskich dotyczących sztucznej inteligencji. Agencje prasowe argumentowały, że sztuczna inteligencja może „zagrozić stabilności ekosystemu medialnego” poprzez znaczące osłabienie zaufania czytelników do jakości i rzetelności wiadomości.

Według wielu badań, sztuczna inteligencja może być wykorzystywana do filtrowania i wybierania historii, które z największym prawdopodobieństwem przyciągną czytelników i wzbudzą ich zainteresowanie, tworząc w ten sposób nierównowagę w wiadomościach, która nie istniałaby, gdyby historie były prezentowane w obiektywny sposób przez ludzi. Opinia publiczna jest narażona tylko na jednostronną wersję wydarzeń, dlatego może być zorientowana na jednostronne informacje generowane przez sztuczną inteligencję. Co więcej, sztuczna inteligencja może być wykorzystywana do rozpowszechniania dezinformacji i fałszywych wiadomości poprzez prezentowanie sfabrykowanych historii obok prawdziwych.

Sztuczna inteligencja może być również podatna na fałszywe wiadomości. Algorytmy sztucznej inteligencji są zaprojektowane do szybkiego i dokładnego przetwarzania danych, co oznacza, że trudno jest odróżnić prawdziwe wiadomości od fałszywych. Co więcej, sztuczna inteligencja nie jest w stanie zrozumieć emocjonalnych i moralnych implikacji przetwarzanych wiadomości. Wraz z rozwojem sztucznej inteligencji, jej podatność na fałszywe wiadomości będzie rosła, co jeszcze bardziej utrudni odróżnianie prawdy od fałszu.

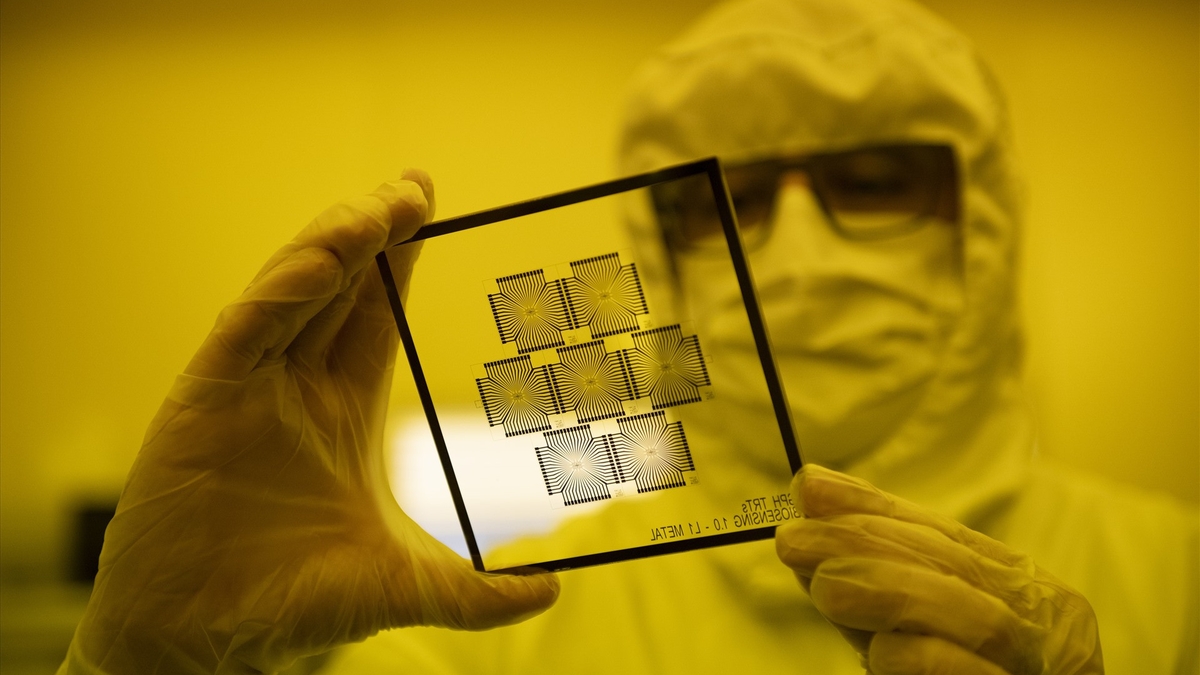

Według dr. Nguyena Ngoc Oanha, kierownika Wydziału Stosunków Międzynarodowych Akademii Dziennikarstwa i Komunikacji, wraz z rosnącą potęgą sztucznej inteligencji (AI) musimy zachować szczególną ostrożność i działać proaktywnie w obliczu ryzyka, że cyberprzestępcy i wrogie siły wykorzystają AI do rozpowszechniania szkodliwych i fałszywych informacji. Z perspektywy bezpieczeństwa mediów, wskazuje to na potencjalne ryzyko dezinformacji, zniekształceń i fake newsów. Zastosowanie sztucznej inteligencji w obszarze informacji może pomóc w tworzeniu fałszywych głosów, obrazów, fałszywych historii i stwierdzeń, które wydają się prawdziwe, aby oszukać opinię publiczną, zwłaszcza w mediach społecznościowych.

„Osoby o złych intencjach wykorzystują rolę i prestiż prasy do fałszowania informacji, wprowadzając opinię publiczną w błąd, że są to informacje przekazywane i odzwierciedlane przez prasę. Rozwój fake newsów będzie stawał się coraz bardziej wyrafinowany i złożony, dlatego oprócz zwiększenia czujności, metody identyfikacji, reagowania na nie i radzenia sobie z nimi muszą koncentrować się na inwestowaniu w inteligentne technologie i systematycznym ich przetwarzaniu. Konieczne jest usprawnienie zarządzania mediami społecznościowymi i agencjami prasowymi, aby dostosować się do zmian” – skomentował adiunkt dr Nguyen Ngoc Oanh.

Branża informacyjna musi znaleźć sposoby na ochronę swoich kreatywnych treści.

Od premiery ChatGPT w listopadzie 2022 roku niemal codziennie wdrażane są nowe aplikacje oparte na generatywnej sztucznej inteligencji. W rezultacie internet wypełnił się treściami generowanymi przez sztuczną inteligencję. Choć niektóre z nich są oszałamiające, to jednak wiele z nich to nijakie, powtarzalne treści. Ułatwia to rozpowszechnianie dezinformacji i nakłada na branżę medialną większe obciążenie w budowaniu i odbudowywaniu zaufania czytelników.

Dziennikarz Nguyen Hoang Nhat, zastępca redaktora naczelnego gazety Vietnamplus, przywołał lekcje z przeszłości, kiedy wielu ekspertów twierdziło, że jednym z pierwszych poważnych błędów prasy była zbyt powolna reakcja na znaczenie i inwazję mediów społecznościowych. „Przeszliśmy przez długi okres umieszczania wszystkich tworzonych przez nas treści w mediach społecznościowych, zmieniając nasze podstawowe założenia, aby im służyć, co czasami nie jest naszą mocną stroną ani tym, czego potrzebują czytelnicy. Krótko mówiąc, nadaliśmy mediom społecznościowym zbyt dużą władzę i doprowadziliśmy do tego, że media społecznościowe odwróciły się od nas i nas pochłonęły” – powiedział dziennikarz Nguyen Hoang Nhat.

W czasach, gdy wietnamska reprezentacja kobiet brała udział w Mistrzostwach Świata, media społecznościowe były pełne źródeł rozpowszechniających zniekształcone i zmyślone informacje. (Zdjęcie: VTC)

Analizując obecne zagrożenie ze strony sztucznej inteligencji, dziennikarz Nguyen Hoang Nhat stwierdził, że generalnie sztuczna inteligencja pomaga redakcjom wykonywać swoją pracę szybciej i oszczędzać koszty, ale jednocześnie sprawi, że redaktorzy i reporterzy będą bardziej pobłażliwi, a także przyczyni się do szybszego rozprzestrzeniania fałszywych informacji. „Na przykład, podczas niedawnych Mistrzostw Świata w Piłce Nożnej Kobiet, fałszywe treści na temat reprezentacji Wietnamu kobiet stały się niezwykle „wirusowe” dzięki memom stworzonym za pomocą narzędzi opartych na sztucznej inteligencji, co doprowadziło do skrajnego rozregulowania ogólnej psychiki pewnej części odbiorców” – podał przykład dziennikarz Nguyen Hoang Nhat.

Za granicą News Guard opublikował szokującą statystykę: 347 serwisów informacyjnych, które wyglądają jak autentyczne serwisy informacyjne, ale są pełne treści generowanych przez sztuczną inteligencję i promują dezinformację. Niedawne badanie przeprowadzone przez Massachusetts Institute of Technology (MIT) wykazało, że ludzie chętniej wierzą w dezinformację generowaną przez sztuczną inteligencję niż w fake newsy generowane przez ludzi.

Zdaniem dziennikarza Nguyen Hoang Nhat, rzeczywistość ta stawia branżę informacyjną w sytuacji, w której musi ona znaleźć sposoby na ochronę swoich kreatywnych treści i własności intelektualnej, ale nie może odwrócić się od udogodnień, jakie oferuje sztuczna inteligencja.

Oceniając wyzwania związane z rzetelnością informacji, profesor nadzwyczajny dr Nguyen Ngoc Oanh stwierdził, że chociaż Chat GPT ma wiele wyjątkowych cech, ostatecznie jest to jedynie narzędzie, którego dziennikarze muszą nauczyć się używać, aby służyć swojej pracy, tworzyć dzieła i produkty prasowe zgodnie z zasadami zawodu. Kwestia weryfikacji źródeł informacji reporterów i dziennikarzy jest niezwykle ważna, jeśli nie chcą oni „pomagać” w rozpowszechnianiu nieprawdziwych informacji.

W wyniku licznych seminariów i dyskusji na temat sztucznej inteligencji stwierdzono, że ryzyko wykorzystywania fałszywych danych i wiadomości w pracach dziennikarskich jest bardzo wysokie, jeśli zarządzanie treścią w redakcji nie nadąża za rozwojem technologii cyfrowych . W kontekście, że prawodawstwo dla dziennikarstwa cyfrowego w Wietnamie nie nadąża jeszcze za rzeczywistością, problemy prawne, zagrożenia dla bezpieczeństwa mediów, przypadki naruszeń praw autorskich oraz kontrowersje dotyczące etyki dziennikarskiej i społecznej odpowiedzialności prasy w kontekście zautomatyzowanego dziennikarstwa… stanowią dziś poważne wyzwania.

Phan Hoa Giang

Źródło

![[Zdjęcie] Da Nang: Setki osób łączy siły, aby oczyścić ważny szlak turystyczny po przejściu huraganu nr 13](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/07/1762491638903_image-3-1353-jpg.webp)

![[Wideo] Pomniki w Hue ponownie otwarte dla zwiedzających](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/11/05/1762301089171_dung01-05-43-09still013-jpg.webp)

Komentarz (0)