Wietnam ma swój pierwszy zbiór zasad etycznych dotyczących sztucznej inteligencji

Oczekuje się, że sztuczna inteligencja (AI) przyniesie ogromne korzyści ludziom, społeczeństwu i gospodarce Wietnamu. Wraz z zastosowaniem AI, Wietnam początkowo prowadził badania i podejmował działania mające na celu minimalizację ryzyka w procesie rozwoju i użytkowania AI, równoważąc czynniki ekonomiczne, etyczne i prawne.

Z tego też powodu Ministerstwo Nauki i Technologii (MOST) wydało zestaw dokumentów określających szereg zasad dotyczących odpowiedzialnego prowadzenia badań i rozwoju systemów sztucznej inteligencji.

W dokumencie wytycznych określono szereg ogólnych zasad i dobrowolnych zaleceń, które należy stosować w badaniach, projektowaniu, rozwoju i dostarczaniu systemów sztucznej inteligencji.

Zachęcamy agencje naukowe i technologiczne, organizacje, przedsiębiorstwa i osoby fizyczne zajmujące się badaniami, projektowaniem, rozwojem i dostarczaniem systemów sztucznej inteligencji do stosowania niniejszego dokumentu z wytycznymi.

W związku z tym badania i rozwój systemów AI w Wietnamie muszą opierać się na fundamentalnym założeniu, jakim jest dążenie do społeczeństwa skoncentrowanego na człowieku, w którym każdy będzie mógł korzystać z dobrodziejstw sztucznej inteligencji, przy jednoczesnym zapewnieniu rozsądnej równowagi między korzyściami a ryzykiem.

Działania badawczo-rozwojowe w zakresie systemów AI w Wietnamie mają na celu zapewnienie neutralności technologicznej. Ministerstwo Nauki i Technologii we wszystkich przypadkach zachęca do wymiany doświadczeń i dyskusji z udziałem odpowiednich stron. Zasady i wytyczne będą nadal badane i aktualizowane, aby dostosować je do sytuacji praktycznych.

Ministerstwo Nauki i Technologii poinformowało, że celem powstania tego zestawu dokumentów jest promowanie zainteresowania badaniami, rozwojem i wykorzystaniem sztucznej inteligencji w Wietnamie w sposób bezpieczny i odpowiedzialny, minimalizując negatywny wpływ na ludzi i społeczność. Zwiększy to zaufanie użytkowników i społeczeństwa do sztucznej inteligencji oraz ułatwi badania i rozwój sztucznej inteligencji w Wietnamie.

Zasady odpowiedzialnego rozwoju sztucznej inteligencji

W dokumencie zachęca się programistów do wykazywania ducha współpracy, promując innowacyjność poprzez połączenie i interakcję systemów sztucznej inteligencji. Programiści muszą zapewnić przejrzystość, kontrolując dane wejściowe i wyjściowe systemów AI oraz umożliwiając im objaśnianie istotnych analiz.

Deweloperzy muszą zwracać uwagę na możliwość kontrolowania systemów sztucznej inteligencji i z wyprzedzeniem oceniać związane z nimi ryzyko. Jedną z metod oceny ryzyka jest przeprowadzanie testów w wydzielonej przestrzeni, takiej jak laboratorium lub środowisko, w którym zagwarantowane jest bezpieczeństwo, przed ich praktycznym zastosowaniem.

Ponadto, aby zagwarantować sterowalność systemami AI, twórcy oprogramowania powinni zwrócić uwagę na monitorowanie systemu (posiadanie narzędzi do oceny/monitorowania lub dostosowywanie/aktualizowanie na podstawie opinii użytkowników) oraz środki reagowania (wyłączanie systemu, wyłączanie sieci itp.) wykonywane przez ludzi lub zaufane systemy AI.

Twórcy oprogramowania muszą zapewnić, że system sztucznej inteligencji (AI) nie wyrządzi szkody życiu, zdrowiu ani mieniu użytkowników ani osób trzecich, w tym za pośrednictwem pośredników; muszą zwrócić uwagę na bezpieczeństwo systemu AI, jego niezawodność i odporność na ataki fizyczne lub wypadki; muszą zapewnić, że system AI nie narusza prywatności użytkowników ani osób trzecich. Prawa do prywatności wymienione w zasadzie obejmują prawo do prywatności przestrzeni (spokój w życiu osobistym), prawo do prywatności informacji (danych osobowych) oraz poufność komunikacji.

Tworząc systemy sztucznej inteligencji, programiści muszą zachować szczególną ostrożność, aby zapewnić poszanowanie praw człowieka i godności. W miarę możliwości, w zależności od specyfiki zastosowanej technologii, programiści muszą podjąć środki, aby zapewnić, że nie powodują dyskryminacji ani niesprawiedliwości z powodu stronniczości (uprzedzeń) w danych treningowych. Co więcej, programiści muszą wywiązywać się ze swojej odpowiedzialności wobec interesariuszy i wspierać użytkowników.

Source: https://vietnamnet.vn/viet-nam-ra-nguyen-tac-ai-khong-duoc-gay-ton-hai-tinh-mang-tai-san-nguoi-dung-2292026.html

![[Zdjęcie] Targi Jesienne 2025 i imponujące rekordy](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/03/1762180761230_ndo_br_tk-hcmt-15-jpg.webp)

![[Zdjęcie] Lam Dong: Zbliżenie nielegalnego jeziora z uszkodzoną ścianą](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/03/1762166057849_a5018a8dcbd5478b1ec4-jpg.webp)

![[Zdjęcie] Sekretarz generalny To Lam przyjmuje ambasadora Singapuru Jayę Ratnam](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/03/1762171461424_a1-bnd-5309-9100-jpg.webp)

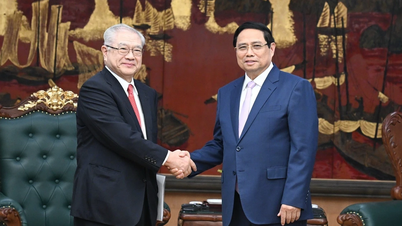

![[Zdjęcie] Premier Pham Minh Chinh przyjmuje przewodniczącego Stowarzyszenia Przyjaźni Japońsko-Wietnamskiej w regionie Kansai](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/03/1762176259003_ndo_br_dsc-9224-jpg.webp)

Komentarz (0)