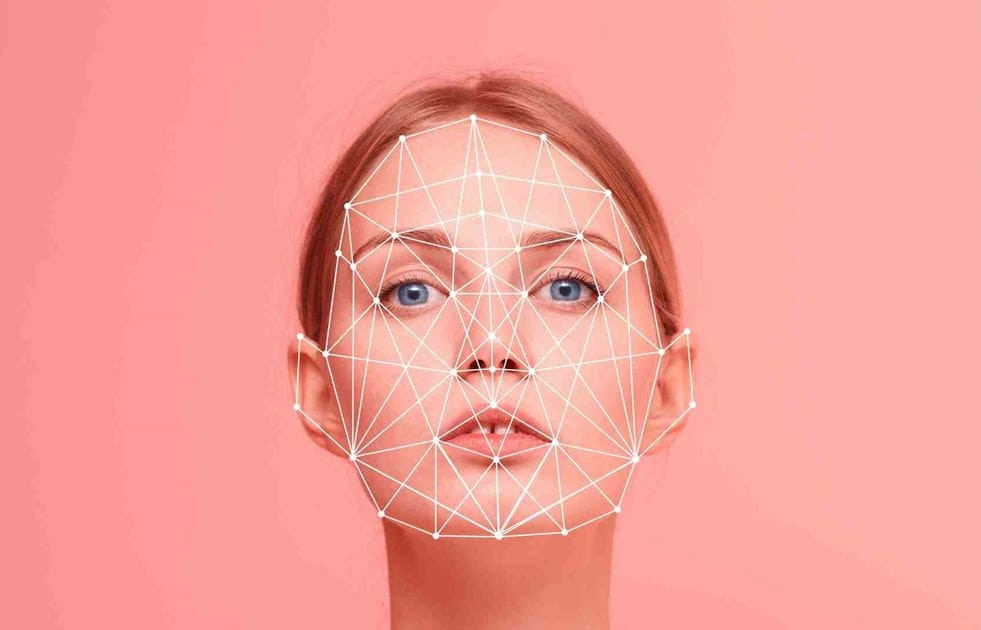

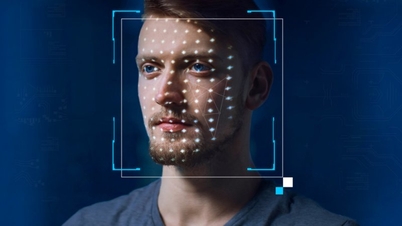

Deepfake é um termo criado pela combinação de 'Deep Learning' (Aprendizado Profundo) e 'Fake' (Falso). Simplificando, é a tecnologia usada para simular e criar produtos falsos de áudio, imagem ou até mesmo vídeo .

Desde o desenvolvimento explosivo da inteligência artificial (IA) , o problema dos deepfakes tornou-se cada vez mais comum, criando ondas de desinformação que se espalham pela imprensa. Portanto, autenticar proativamente a origem de imagens e vídeos é uma questão urgente para as principais empresas de câmeras do mundo .

Espera-se que Sony, Canon e Nikon lancem câmeras digitais que suportem assinaturas digitais diretamente em seus modelos Mirrorless (ou câmeras DSLR). O esforço para implementar assinaturas digitais em câmeras é uma medida extremamente importante, pois cria evidências da origem e integridade das imagens.

Essas assinaturas digitais incluirão informações sobre a data, hora, local, fotógrafo e serão invioláveis. Isso é especialmente importante para fotojornalistas e outros profissionais cujo trabalho exige autenticação.

Três gigantes da indústria de câmeras concordaram com um padrão global para assinaturas digitais compatível com a ferramenta de verificação online Verify. Lançada por uma coalizão de organizações de notícias globais, empresas de tecnologia e fabricantes de câmeras, a ferramenta permitirá a verificação gratuita da autenticidade de qualquer imagem. Se as imagens forem criadas ou modificadas usando IA, o Verify as sinalizará como "Sem Verificação de Conteúdo".

A importância das tecnologias anti-deepfake decorre do rápido aumento de deepfakes de figuras famosas como o ex-presidente dos EUA, Donald Trump, e o primeiro-ministro japonês, Fumio Kishida.

Além disso, pesquisadores da Universidade de Tsinghua, na China, desenvolveram um novo modelo de IA generativa capaz de gerar cerca de 700.000 imagens por dia.

Além dos fabricantes de câmeras, outras empresas de tecnologia estão se unindo à luta contra os deepfakes. O Google lançou uma ferramenta para adicionar marcas d'água digitais a imagens geradas por IA, enquanto a Intel desenvolveu uma tecnologia que analisa mudanças na tonalidade da pele em fotos para ajudar a determinar sua autenticidade. A Hitachi também está trabalhando em uma tecnologia para prevenir fraudes de identidade online.

A nova tecnologia deverá estar disponível no início de 2024. A Sony planeja promovê-la junto à mídia e já realizou testes de campo em outubro de 2023. A Canon está em parceria com a Thomson Reuters e o Starling Data Preservation Lab (um instituto de pesquisa fundado pela Universidade Stanford e pela Universidade do Sul da Califórnia) para aprimorar ainda mais a tecnologia.

Os fabricantes de câmeras esperam que a nova tecnologia ajude a restaurar a confiança do público nas imagens, que, por sua vez, moldam nossa percepção do mundo.

(de acordo com OL)

Paguei US$ 5.000 para o Facebook divulgar um vídeo deepfake de um golpe de investimento.

Novo malware assume o controle de smartphones, vídeos deepfake estão ficando cada vez mais sofisticados.

Os vídeos deepfake estão ficando cada vez mais sofisticados e realistas.

O que fazer para evitar cair na armadilha das videochamadas deepfake que aplicam golpes em transferências de dinheiro?

A tecnologia deepfake está sendo explorada para inserir os rostos das vítimas em vídeos pornográficos.

Fonte

![[Foto] Lam Dong: Imagens dos danos após suspeita de rompimento de lago em Tuy Phong](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/02/1762078736805_8e7f5424f473782d2162-5118-jpg.webp)

![[Foto] O presidente Luong Cuong recebe o secretário de Guerra dos EUA, Pete Hegseth.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/02/1762089839868_ndo_br_1-jpg.webp)

Comentário (0)