Deepfake-urile reprezintă acum o preocupare majoră, deoarece numărul escrocheriilor care utilizează această tehnologie continuă să crească.

După ce au cercetat forumurile Darknet, unde operează frecvent infractorii cibernetici, experții în securitate au descoperit că atât de mulți infractori folosesc software Deepfake pentru fraudă, încât cererea depășește cu mult oferta de software Deepfake disponibil în prezent pe piață.

Pe măsură ce cererea depășește oferta, experții Kaspersky prevăd o creștere a escrocheriilor Deepfake, cu metode din ce în ce mai diverse și sofisticate: de la furnizarea de videoclipuri de imitație de înaltă calitate până la utilizarea de imagini cu celebrități în transmisiuni live false pe rețelele de socializare, promițând dublarea cantității de informații trimise de victime.

Conform sistemului de referință informațională Regula, 37% dintre companiile din întreaga lume s-au confruntat cu escrocherii Deepfake bazate pe voce, iar 29% au devenit victime ale escrocheriilor Deepfake bazate pe videoclipuri.

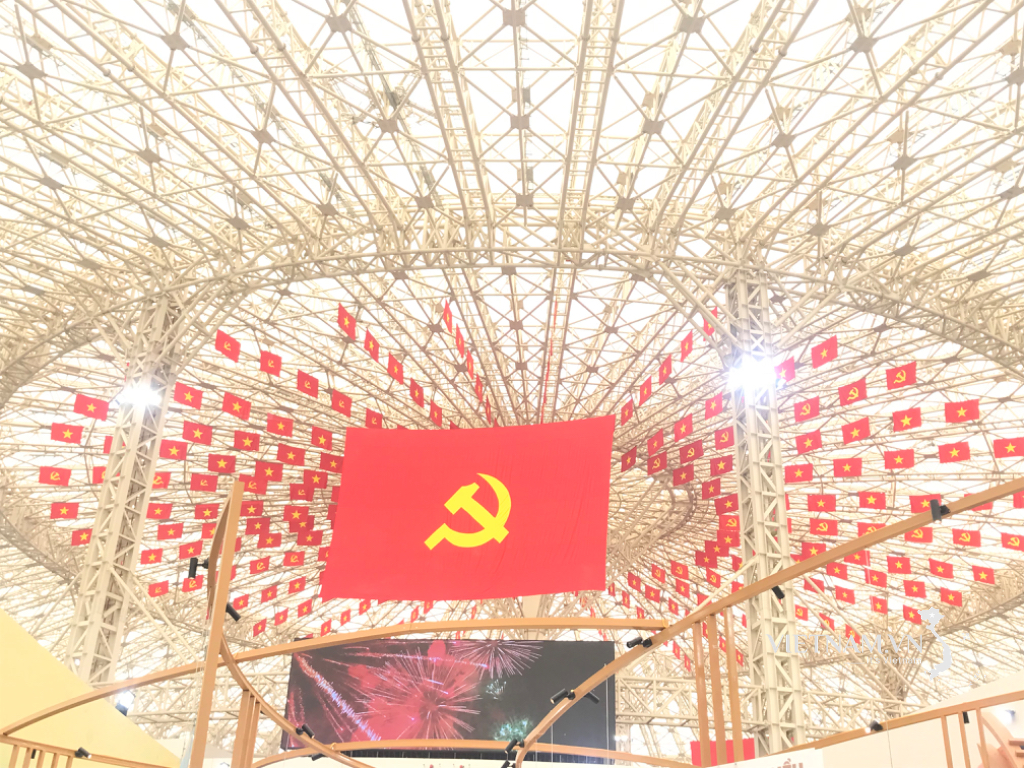

Această tehnologie a devenit o amenințare la adresa securității cibernetice din Vietnam, unde infractorii cibernetici folosesc adesea apeluri video false pentru a se da drept persoane cu scopul de a împrumuta bani de la rudele și prietenii acestora.

Un apel video Deepfake poate dura doar un minut, ceea ce face foarte dificil pentru victime să facă distincția între un apel real și unul fals.

Deepfake-urile devin treptat un „coșmar” în escrocheriile online sofisticate.

„ Deepfake-urile au devenit un coșmar pentru femei și societate. Infractorii cibernetici exploatează inteligența artificială (IA) pentru a suprapune fețele victimelor peste imagini și videoclipuri pornografice, precum și în campaniile de propagandă.”

„Aceste forme de manipulare au ca scop controlul opiniei publice prin răspândirea de dezinformări, chiar afectând reputația organizațiilor sau a persoanelor”, a declarat dna Vo Duong Tu Diem, director regional al Kaspersky Vietnam.

Deși inteligența artificială este utilizată în mod abuziv de infractori în scopuri nefaste, persoanele fizice și companiile pot folosi în continuare inteligența artificială pentru a identifica deepfake-urile, reducând probabilitatea unor escrocherii reușite.

Prin urmare, utilizatorii vor avea la dispoziție mai multe soluții utile pentru a se proteja de escrocherii, cum ar fi utilizarea unui software de detectare a conținutului generat de inteligență artificială (care folosește algoritmi avansați pentru a analiza și determina măsura în care au fost editate imaginile/videoclipurile/înregistrările audio).

Pentru videoclipurile deepfake, există acum instrumente care ajută la identificarea mișcărilor nepotrivite dintre gură și vorbire. Unele programe sunt chiar suficient de „puternice” pentru a detecta fluxul sanguin anormal sub piele prin analizarea rezoluției video, deoarece atunci când inima pompează sânge, venele din corpul unei persoane își schimbă culoarea.

În plus, filigranele servesc drept semne de identificare în imagini, videoclipuri etc., ajutând autorii să protejeze drepturile de autor ale produselor lor de inteligență artificială. Această caracteristică poate deveni o armă împotriva Deepfake-urilor, deoarece ajută la urmărirea originii platformei care a creat inteligența artificială. Utilizatorii pricepuți la tehnologie pot găsi modalități de a urmări sursa conținutului pentru a compara modul în care datele originale au fost modificate de inteligența artificială.

În prezent, unele tehnologii emergente utilizează algoritmi de criptare pentru a insera valori hash la intervale de timp stabilite în cadrul videoclipului. Dacă videoclipul a fost editat, valoarea hash se va schimba, permițând utilizatorilor să verifice dacă conținutul a fost modificat.

Anterior, existau câteva îndrumări privind găsirea anomaliilor în videoclipuri, cum ar fi distorsiunea culorilor, mișcările musculare nenaturale, mișcările ochilor etc. Cu toate acestea, pe măsură ce inteligența artificială devine din ce în ce mai inteligentă, aceste valori nu dau întotdeauna rezultate precise.

Procesul de verificare a credibilității videoclipurilor nu se mai bazează pe inspecția vizuală, ci necesită instrumente tehnologice concepute pentru a preveni și detecta conținutul fals.

Khanh Linh

Sursă

Comentariu (0)