Cu ritmul său rapid de dezvoltare, inteligența artificială (IA) revoluționează multe domenii - de la asistență medicală, educație și afaceri până la viața de zi cu zi. Cu toate acestea, dezavantajele acestei tehnologii prezintă provocări semnificative pentru gestionarea și controlul informațiilor în spațiul cibernetic.

Inundat de știri false generate de inteligența artificială.

Știrile false generate de inteligența artificială sunt răspândite pe platformele de socializare în principal pentru a obține vizualizări, aprecieri și interacțiuni în scopul vânzărilor online sau pentru a profita de pe urma platformei.

Cei care creează știri false profită adesea de evenimentele actuale în trend care atrag atenția publicului. De exemplu, după gravul accident rutier din 17 septembrie de la piața Tan Long, comuna Lao Bao, provincia Quang Tri , soldat cu 12 victime, pe rețelele de socializare au apărut imagini sfâșietoare, provocând lacrimi în ochi mulți telespectatori. Identificând aceste imagini ca fiind create de inteligența artificială, poliția din comuna Lao Bao a emis un avertisment cu privire la răspândirea acestor imagini false înșelătoare. Acest comportament nu numai că răspândește informații false, dar împiedică și investigațiile.

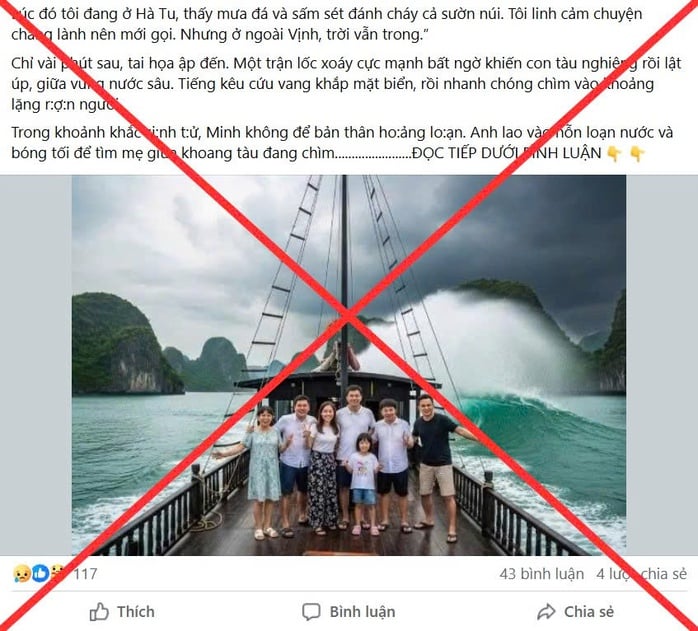

În mod similar, profitând de atenția publică din jurul răsturnării ambarcațiunii turistice Green Bay 58 din Golful Ha Long, provincia Quang Ninh, pe 19 iulie, care a ucis zeci de oameni, multe conturi de socializare au postat imagini emoționante și povești despre victime. Cu toate acestea, o parte semnificativă a acestui conținut a fost fals, creat folosind inteligența artificială pentru a manipula emoțiile și a atrage interacțiunea utilizatorilor de socializare. În special, utilizarea pe scară largă a imaginilor false cu o empatie exagerată ar putea traumatiza și mai mult familiile victimelor.

Cu tehnologia AI în continuă îmbunătățire, este nevoie doar de câteva minute și comenzi simple pentru a crea un videoclip cu conținut captivant care corespunde perfect intențiilor utilizatorului. Printre acestea, platformele AI de generație următoare, precum KlingAI, Veo 3 și Sora, sunt foarte populare printre utilizatorii din întreaga lume, inclusiv în Vietnam.

În plus, tehnologia deepfake – o combinație de deep learning și fake – este, de asemenea, o preocupare majoră la nivel global, deoarece poate fi utilizată pentru a crea imagini, sunete sau videoclipuri care par atât de reale încât sunt foarte greu de detectat ca fiind false. Drept urmare, numeroase escrocherii legate de această tehnologie au avut loc atât în Vietnam, cât și în întreaga lume.

Generalul-locotenent Nguyen Minh Chinh, vicepreședinte permanent al Asociației Naționale pentru Securitate Cibernetică, a remarcat o tendință tot mai mare de abuz al inteligenței artificiale în scopuri ilegale. Mai exact, inteligența artificială ca serviciu (instrumente și aplicații furnizate de inteligența artificială) este exploatată de infractorii cibernetici pentru a crea programe malware, voci, fețe și mesaje false... pentru fraudă, atacuri cibernetice, intruziuni în sistemele de date și chiar pentru a destabiliza securitatea și a afecta reputația organizațiilor, companiilor și liderilor.

Potrivit domnului Tran Ngoc Anh, director tehnic al companiei Hoa Binh Cyber Space Company Limited (CyPeace), unul dintre riscurile pentru utilizatorii de inteligență artificială este potențialul de a primi informații eronate generate de instrumentul în sine. În plus, există o serie de alte probleme, cum ar fi scurgerea de informații confidențiale și date personale.

Imaginile false sunt răspândite online pentru a „face spectatorii să plângă”, câștigând astfel aprecieri și sporind interacțiunea (Captură de ecran).

Creșterea responsabilității utilizatorului

Înainte de a fi implementate măsuri tehnologice și juridice pentru a controla strict dezvoltarea și utilizarea inteligenței artificiale, utilizatorii trebuie să utilizeze proactiv și responsabil această tehnologie.

Expertul în securitate cibernetică Vu Ngoc Son, șeful Comitetului pentru Tehnologie al Asociației Naționale de Securitate Cibernetică, a subliniat că oamenii sunt subiecții care exploatează și utilizează IA, astfel încât atât aspectele bune, cât și cele rele ale IA sunt strâns legate de oameni. Dacă utilizatorii sunt pricepuți și o aplică în scopuri bune, tehnologia își va valorifica punctele forte în avantajul lor. În schimb, dacă utilizatorii IA nu înțeleg sau o exploatează în scopuri ilegale, acest lucru poate avea consecințe grave. „Pentru a utiliza și exploata IA eficient, este necesar să ne concentrăm pe construirea unei echipe și a unor procese. IA își atinge valoarea doar atunci când este pusă în mâinile celor care știu cum să o stăpânească”, a declarat expertul în securitate cibernetică.

Având în vedere pericolele tehnologiei deepfake – un instrument important care facilitează frauda cibernetică actuală – Ministerul Finanțelor a subliniat în timpul elaborării Legii privind Investițiile și Afacerile că afacerile cu tehnologie deepfake trebuie reglementate ca un sector de afaceri condiționat pentru a preveni utilizarea abuzivă a tehnologiei care provoacă perturbări ale informațiilor și fraudă. Potrivit Ministerului Finanțelor, afacerile cu tehnologie deepfake sunt în prezent unul dintre noile domenii cu riscuri potențiale complexe pentru securitate și ordine, însă nu sunt reglementate ca un sector de afaceri condiționat.

Potrivit avocatului Tran Anh Tuan (Asociația Baroului Hanoi), utilizarea inteligenței artificiale pentru a crea conținut fără permisiune, în special pentru a crea informații false, fabricate sau frauduloase, poate încălca prevederile Codului Civil. Contravenienții se pot confrunta cu sancțiuni administrative sau despăgubiri pentru daune. În cazurile care provoacă consecințe grave, se poate angaja răspunderea penală. „Utilizatorii trebuie să fie precauți atunci când accesează și utilizează inteligența artificială, evitând absolut orice acțiuni care exploatează inteligența artificială pentru a obține vizualizări sau aprecieri; aceștia ar trebui să își asume responsabilitatea personală și să respecte legea atunci când utilizează inteligența artificială și participă la mediul online”, a sfătuit avocatul Tuan.

Generalul-locotenent Nguyen Minh Chinh a subliniat că elementul central al dezvoltării durabile a inteligenței artificiale îl reprezintă resursa umană. De la cercetători, ingineri, experți în securitate cibernetică până la manageri și utilizatori, toată lumea trebuie să fie pe deplin echipată cu cunoștințe, abilități, etică și conștientizare juridică. Potrivit acestuia, aceasta nu este doar echipa care construiește și operează sistemele de inteligență artificială, ci și forța cheie în prevenirea, detectarea și combaterea infracțiunilor de înaltă tehnologie în spațiul cibernetic.

Vietnamul va avea o lege privind inteligența artificială.

La o recentă conferință științifică națională despre inteligența artificială, ministrul științei și tehnologiei, Nguyen Manh Hung, a declarat că inteligența artificială deschide mari oportunități, dar ridică și multe probleme legate de etică, ocuparea forței de muncă și încrederea socială. Prin urmare, dezvoltarea inteligenței artificiale trebuie să fie rapidă, sigură și umană.

Potrivit ministrului Nguyen Manh Hung, IA nu înlocuiește oamenii, ci îi servește, acționând ca asistent al acestora. IA este un instrument puternic, dar oamenii sunt factorii de decizie; prin urmare, IA ar trebui să sprijine, nu să înlocuiască, gândirea, valorile și responsabilitățile umane. „Ministerul Științei și Tehnologiei va emite un cod național de etică pentru IA, armonizat cu standardele internaționale, dar conceput pentru a se potrivi realităților vietnameze și va dezvolta, de asemenea, o lege și o strategie privind IA”, a declarat ministrul Nguyen Manh Hung.

Sursă: https://nld.com.vn/ngan-cong-nghe-vuot-ranh-gioi-dao-duc-196250923205638915.htm

Comentariu (0)