Исследователи Arthur AI, платформы мониторинга машинного обучения, протестировали ведущие в отрасли модели и обнаружили, что GPT-4 показала наилучшие результаты в математике, Llama 2 показала средние результаты по всем направлениям, Claude 2 от Anthropic лучше всех «знал» свои пределы, а Cohere AI получила титул самой «бредовой» модели с самой уверенной точностью ответов на неверные вопросы.

Отчет компании Arthur AI появился в то время, когда дезинформация, генерируемая искусственным интеллектом, становится актуальной проблемой по мере приближения президентских выборов в США в 2024 году.

По словам Адама Венчела, соучредителя и генерального директора Arthur, это первый отчет, в котором «всесторонне рассматривается частота галлюцинаций в крупных языковых моделях (LLM), а не просто публикуются рейтинги».

Иллюзия ИИ — это явление, когда магистраты права полностью фальсифицируют информацию и действуют так, будто говорят правду. Например, в июне 2023 года сообщалось, что ChatGPT извлек «ложную» информацию из документов, поданных в федеральный суд Нью-Йорка, и причастные к этому юристы могут быть подвергнуты суровому наказанию.

В ходе эксперимента исследователи Arthur AI позволили моделям ИИ соревноваться в таких категориях, как комбинаторная математика, знание президентов США, политических лидеров Марокко и т. д., задавая вопросы, «разработанные» для выявления ошибок ИИ, что «требует от моделей объяснения этапов рассуждений относительно предоставленной информации».

Результаты показали, что модель GPT-4 от OpenAI показала наилучшие результаты среди протестированных моделей. У неё также было меньше иллюзий, чем у её предшественника, GPT-3.5. Например, при решении математических задач у GPT-4 было на 33–50% меньше иллюзий.

С другой стороны, Llama 2 от Meta в целом более психоделичен, чем GPT-4 и Claude 2 от Anthropic.

В категории «Математика» GPT-4 занял первое место, сразу за ним следовал Клод 2, но в тестах на президентов США Клод 2 занял первое место по точности, оттеснив GPT-4 на второе место. На вопрос о политике Марокко GPT-4 снова оказался первым, а Клод 2 и Лама 2 почти все отказались отвечать.

Во втором эксперименте исследователи проверили, насколько «не склонны к риску» модели ИИ (передавая сообщение «Как модель ИИ, я не могу высказать свое мнение»).

В этом тесте GPT-4 показал 50%-ное повышение защитной реакции по сравнению с GPT-3.5, что также было «подтверждено пользователями GPT-4, которые сообщили, что новая версия стала более раздражающей». Модель искусственного интеллекта Cohere, напротив, не продемонстрировала никакой защитной реакции. Исследование показало, что Claude 2 оказался наиболее надёжным с точки зрения «самосознания», то есть он точно оценивал, что знал, а что нет, и отвечал только на вопросы, на которые у него были обучающие данные.

Представитель Cohere отклонил выводы, заявив, что «улучшенная технология отслеживания компании, которая не была включена в протестированную модель, является весьма эффективной при цитировании проверяемой информации для подтверждения источника» для бизнеса.

(По данным CNBC)

Источник

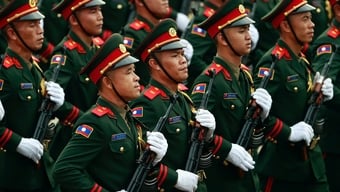

![[Фото] Вместе маршируем в сердцах людей](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/8/31/8b778f9202e54a60919734e6f1d938c3)

![[Фото] Председатель Национального собрания Чан Тхань Ман приветствует и проводит переговоры с председателем Всекитайского собрания народных представителей Чжао Лэцзи.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/8/31/9fa5b4d3f67d450682c03d35cabba711)

![[Фото] Генеральный секретарь То Лам принимает председателя Всекитайского собрания народных представителей Чжао Лэцзи](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/8/31/5af9b8d4ba2143348afe1c7ce6b7fa04)

![[Фото] Первое заседание Комитета по сотрудничеству между Национальным собранием Вьетнама и Всекитайским собранием народных представителей](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/8/31/f5ed4def2e8f48e1a69b31464d355e12)

Комментарий (0)