Как работают поддельные изображения ИИ?

В наши дни ИИ повсюду – даже на войне. В этом году приложения искусственного интеллекта настолько усовершенствовались, что практически любой может использовать генераторы ИИ для создания изображений, которые выглядят реалистично, по крайней мере, на первый взгляд.

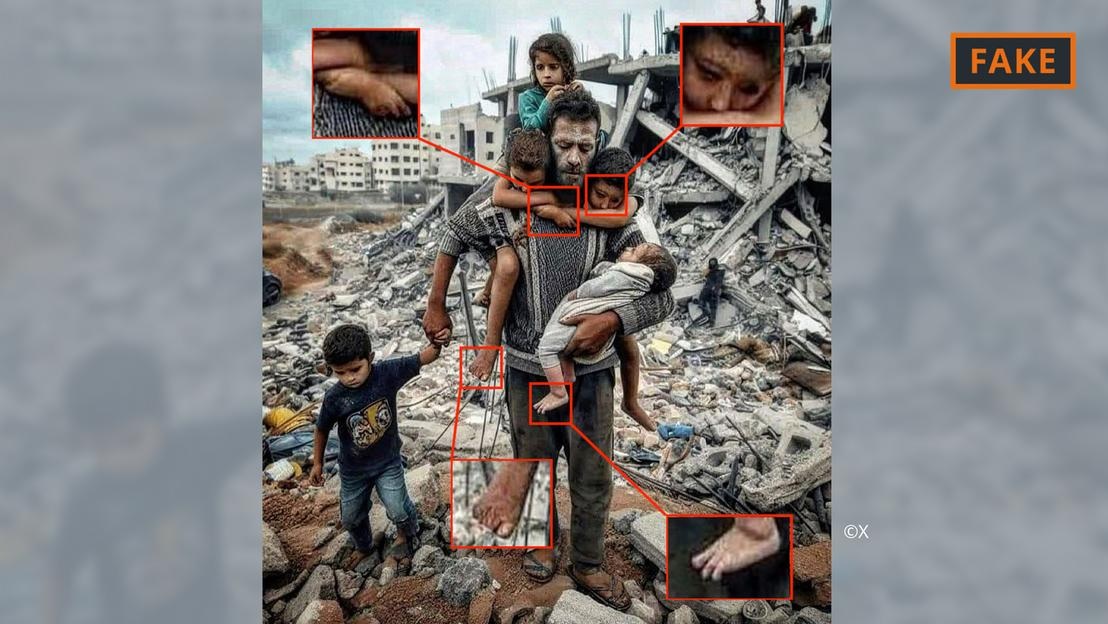

Созданная искусственным интеллектом фейковая фотография войны в Газе.

Для этого пользователям достаточно предоставить таким инструментам, как Midjourney или Dall-E, несколько подсказок, включая спецификации и информацию. Затем инструменты ИИ преобразуют текстовые или даже голосовые подсказки в изображения.

Этот процесс генерации изображений основан на машинном обучении. Например, если создатель просит показать 70-летнего мужчину, едущего на велосипеде, он будет искать в своей базе данных термины, соответствующие изображениям.

На основе имеющейся информации алгоритм искусственного интеллекта сгенерирует изображение пожилого велосипедиста. Благодаря постоянному поступлению данных и техническим обновлениям эти инструменты значительно усовершенствовались и постоянно обучаются.

Всё это применяется к изображениям, связанным с конфликтом на Ближнем Востоке. В условиях конфликта, где «эмоции настолько сильны», дезинформация, в том числе распространяемая с помощью изображений, созданных с помощью искусственного интеллекта, оказывает огромное влияние, считает эксперт по искусственному интеллекту Хани Фарид.

Фарид, профессор цифровой аналитики Калифорнийского университета в Беркли, считает, что ожесточенные бои являются идеальной питательной средой для создания и распространения фейкового контента, а также для разжигания эмоций.

Типы изображений войны Израиля и ХАМАС, созданных с помощью ИИ

Изображения и видео, созданные с помощью искусственного интеллекта, способствовали распространению дезинформации, связанной с войной на Украине, и то же самое продолжается в войне между Израилем и ХАМАС.

По мнению экспертов, изображения войны, созданные ИИ и распространяемые в социальных сетях, часто делятся на две категории. Одна из них фокусируется на страданиях людей и вызывает сочувствие. Другая — это фейковый ИИ, который преувеличивает события, тем самым разжигая конфликты и эскалацию насилия.

Созданная искусственным интеллектом фейковая фотография отца и ребенка среди развалин в секторе Газа.

Например, к первой категории относится фотография отца и его пятерых детей на фоне груды обломков. Она была многократно опубликована в X (ранее Twitter) и Instagram и просмотрена сотни тысяч раз.

Это изображение было помечено сообществом, по крайней мере на X, как подделка. Его можно распознать по различным ошибкам и несоответствиям, характерным для изображений, созданных с помощью искусственного интеллекта (см. изображение выше).

Похожие аномалии можно увидеть и на фейковом изображении ИИ, которое стало вирусным на сайте X ниже. На нем якобы изображена палестинская семья, обедающая вместе на руинах.

Созданная искусственным интеллектом фейковая фотография палестинской вечеринки.

Между тем, еще одно изображение, на котором солдаты размахивают израильскими флагами, проходя через поселение, заполненное разбомбленными домами, попадает во вторую категорию и призвано разжечь ненависть и насилие.

Откуда берутся такие ИИ-изображения?

Большинство изображений конфликтов, созданных с помощью ИИ, публикуются на платформах социальных сетей, но они также доступны на ряде других платформ и организаций, и даже на некоторых новостных сайтах.

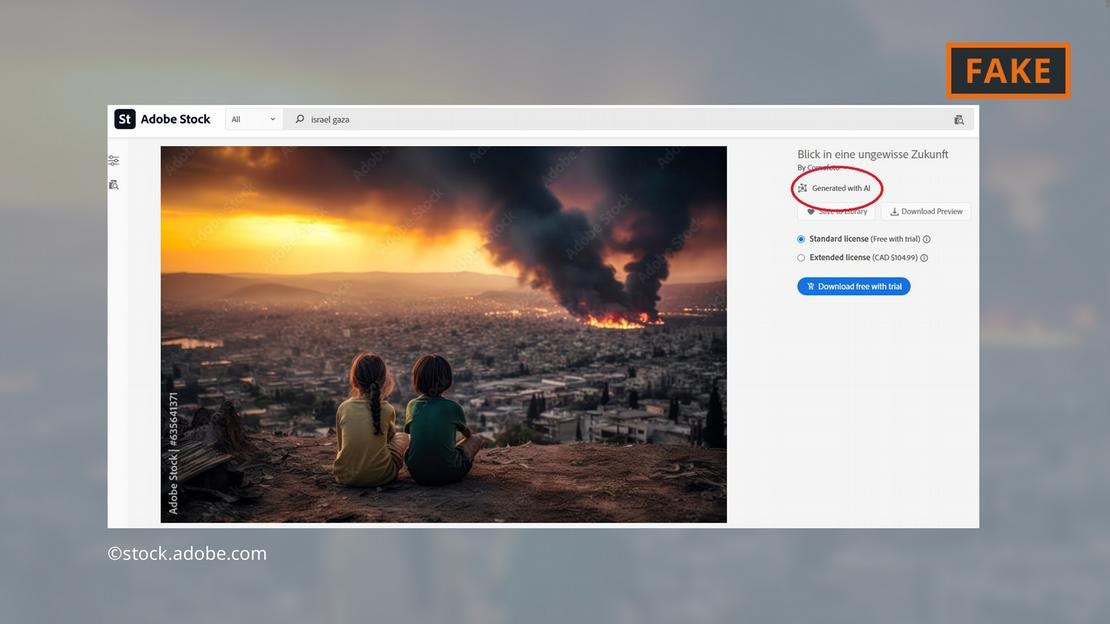

Компания Adobe, занимающаяся разработкой программного обеспечения, попала в заголовки новостей, добавив к своему ассортименту стоковых фотографий изображения, созданные с помощью искусственного интеллекта, к концу 2022 года. В базе данных они будут помечены соответствующим образом.

Теперь Adobe также предлагает к продаже созданные с помощью ИИ изображения войны на Ближнем Востоке — например, взрывы, протесты или клубы дыма за мечетью Аль-Акса.

Adobe предлагает созданные с помощью искусственного интеллекта изображения боевых действий в секторе Газа.

Критики сочли это тревожным, поскольку некоторые сайты продолжали использовать изображения, не помечая их как созданные ИИ. Например, изображение, о котором идёт речь, появилось на странице «Newsbreak» без какого-либо указания на то, что оно создано ИИ.

Даже Европейская парламентская исследовательская служба, научное подразделение Европейского парламента, проиллюстрировала онлайн-текст о конфликте на Ближнем Востоке изображением из базы данных Adobe, созданным с помощью ИИ, — не пометив его как созданное с помощью ИИ.

Европейская обсерватория цифровых медиа призывает журналистов и работников СМИ быть предельно осторожными при использовании изображений ИИ, рекомендуя не применять их, особенно при освещении реальных событий, таких как война в Газе.

Насколько опасны изображения ИИ?

Вирусный контент и изображения, созданные с помощью искусственного интеллекта, неизбежно вызывают у пользователей чувство тревоги по поводу всего, с чем они сталкиваются в интернете. «Если мы окажемся в мире, где изображения, аудио и видео могут быть подвергнуты манипуляциям , всё станет подозрительным», — объясняет исследователь из Калифорнийского университета в Беркли Фарид. «И вы потеряете доверие ко всему, включая правду».

Именно это и произошло в следующем случае: премьер-министр Израиля Биньямин Нетаньяху и несколько других политиков опубликовали в социальных сетях фотографию того, что предположительно является обгоревшим телом израильского ребенка.

Антиизраильский инфлюенсер Джексон Хинкль позже заявил, что изображение было создано с помощью искусственного интеллекта. Заявление Хинкля набрало более 20 миллионов просмотров в социальных сетях и вызвало бурные дискуссии на платформе.

В конечном итоге многочисленные организации и инструменты проверки заявили, что изображение подлинное, а утверждение Хинкла — ложное. Однако очевидно, что ни один инструмент не поможет пользователям легко вернуть утраченное доверие!

Хоанг Хай (по данным DW)

Источник

![[Фото] Закрытие XIII конференции Центрального Комитета партии XIII созыва](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/08/1759893763535_ndo_br_a3-bnd-2504-jpg.webp)

Комментарий (0)