Благодаря стремительному развитию искусственный интеллект (ИИ) совершает революцию во многих областях — от здравоохранения, образования и бизнеса до повседневной жизни. Однако недостатки этой технологии создают серьезные проблемы для управления и контроля информации в киберпространстве.

Завалено фейковыми новостями, сгенерированными искусственным интеллектом.

Фейковые новости, созданные с помощью ИИ, распространяются в социальных сетях в основном для того, чтобы получить просмотры, лайки и вовлеченность аудитории с целью онлайн-продаж или получения прибыли от платформы.

Те, кто создает фейковые новости, часто используют в своих целях актуальные события, привлекающие внимание общественности. Например, после серьезной дорожно-транспортной аварии 17 сентября на рынке Тан Лонг в коммуне Лао Бао провинции Куангчи , в результате которой погибли 12 человек, в социальных сетях появились душераздирающие фотографии, вызвавшие слезы у многих пользователей. Полиция коммуны Лао Бао, определив, что эти изображения созданы с помощью искусственного интеллекта, выпустила предупреждение о распространении подобных вводящих в заблуждение фейковых изображений. Такое поведение не только распространяет ложную информацию, но и препятствует расследованию.

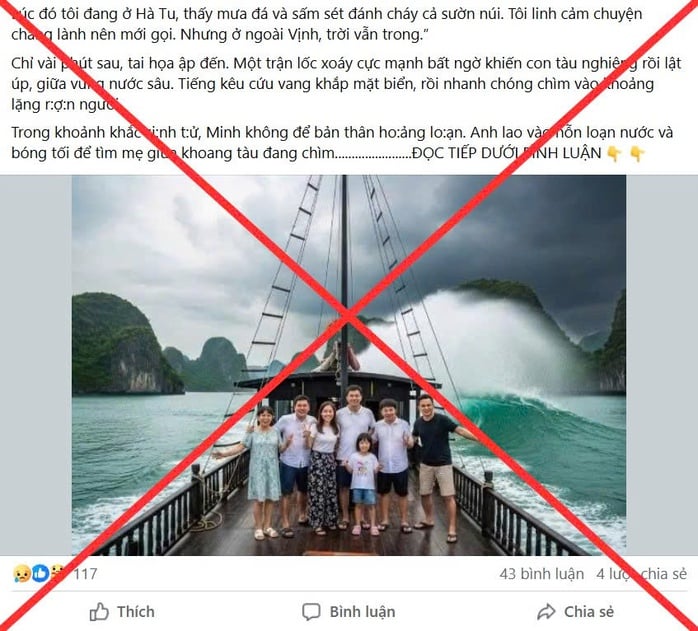

Аналогичным образом, воспользовавшись вниманием общественности к крушению туристического катера Green Bay 58 в заливе Халонг, провинция Куангнинь, 19 июля, в результате которого погибли десятки людей, многие аккаунты в социальных сетях опубликовали эмоциональные изображения и истории о жертвах. Однако значительная часть этого контента была фейковой, созданной с помощью ИИ для манипулирования эмоциями и привлечения внимания пользователей социальных сетей. Примечательно, что широкое распространение фейковых изображений с преувеличенной симпатией может еще больше травмировать семьи жертв.

Благодаря постоянному совершенствованию технологий искусственного интеллекта, создание видеоролика с привлекательным контентом, идеально соответствующего намерениям пользователя, занимает всего несколько минут и требует простых команд. Среди них особое внимание пользователей по всему миру, включая Вьетнам, привлекают платформы ИИ нового поколения, такие как KlingAI, Veo 3 и Sora.

Кроме того, технология дипфейков — сочетание глубокого обучения и подделки — также представляет собой серьезную проблему во всем мире, поскольку она может использоваться для создания изображений, звуков или видео, которые выглядят настолько реалистично, что их очень трудно распознать как подделку. В результате во Вьетнаме и по всему миру произошло множество мошеннических схем, связанных с этой технологией.

Генерал-лейтенант Нгуен Минь Чинь, постоянный вице-председатель Национальной ассоциации кибербезопасности, отметил растущую тенденцию злоупотребления ИИ в незаконных целях. В частности, ИИ как услуга (инструменты и приложения, предоставляемые ИИ) используется киберпреступниками для создания вредоносного ПО, подделки голосов, лиц и текста... с целью мошенничества, кибератак, несанкционированного доступа к данным и даже для дестабилизации безопасности и нанесения ущерба репутации организаций, предприятий и руководителей.

По словам г-на Тран Нгок Аня, технического директора компании Hoa Binh Cyber Space Company Limited (CyPeace), одним из рисков для пользователей ИИ является потенциальная возможность получения дезинформации, генерируемой самим инструментом. Кроме того, существует множество других проблем, таких как утечка конфиденциальной информации и персональных данных.

В интернете распространяются фейковые изображения, призванные «заставить зрителей плакать», тем самым получить лайки и увеличить количество взаимодействий (скриншот).

Повышение ответственности пользователей

Прежде чем будут приняты технологические и правовые меры для жесткого контроля за разработкой и использованием ИИ, пользователям необходимо проявлять инициативу и ответственно использовать эту технологию.

Эксперт по кибербезопасности Ву Нгок Сон, глава технологического комитета Национальной ассоциации кибербезопасности, отметил, что именно люди являются субъектами, которые используют ИИ, поэтому как положительные, так и отрицательные стороны ИИ тесно связаны с людьми. Если пользователи обладают необходимыми навыками и применяют технологию в благих целях, она будет использовать свои сильные стороны в их интересах. И наоборот, если пользователи ИИ не понимают его или используют в незаконных целях, это может привести к серьезным последствиям. «Для эффективного использования ИИ необходимо сосредоточиться на создании команды и отлаженных процессов. ИИ раскрывает свой потенциал только тогда, когда находится в руках тех, кто умеет им пользоваться», — сказал эксперт по кибербезопасности.

Учитывая опасность технологии дипфейков – ведущего инструмента, способствующего современному кибермошенничеству, – Министерство финансов в ходе разработки Закона об инвестициях и бизнесе подчеркнуло, что деятельность, связанная с технологией дипфейков, должна регулироваться как условный сектор экономики, чтобы предотвратить злоупотребление этой технологией, приводящее к искажению информации и мошенничеству. По мнению Министерства финансов, бизнес, связанный с технологией дипфейков, в настоящее время является одной из новых областей со сложными потенциальными рисками для безопасности и порядка, однако он не регулируется как условный сектор экономики.

По словам адвоката Тран Ань Туана (Ханойская коллегия адвокатов), использование ИИ для создания контента без разрешения, особенно для распространения ложной, сфабрикованной или мошеннической информации, может являться нарушением положений Гражданского кодекса. Нарушителям могут грозить административные санкции или компенсация ущерба. В случаях, повлекших серьезные последствия, может быть привлечена к уголовной ответственности. «Пользователям необходимо проявлять осторожность при доступе к ИИ и его использовании, полностью избегая любых действий, которые используют ИИ для получения просмотров или лайков; им следует проявлять личную ответственность и соблюдать закон при использовании ИИ и участии в онлайн-среде», — посоветовал адвокат Туан.

Генерал-лейтенант Нгуен Минь Чинь подчеркнул, что ключевым элементом устойчивого развития ИИ являются человеческие ресурсы. От исследователей, инженеров и экспертов по кибербезопасности до менеджеров и пользователей — каждый должен обладать необходимыми знаниями, навыками, этическими принципами и правовой грамотностью. По его словам, это не только команда, которая создает и эксплуатирует системы ИИ, но и ключевая сила в предотвращении, выявлении и борьбе с высокотехнологичными преступлениями в киберпространстве.

Во Вьетнаме будет принят закон об искусственном интеллекте.

На недавней национальной научной конференции по искусственному интеллекту министр науки и технологий Нгуен Мань Хунг заявил, что ИИ открывает огромные возможности, но также поднимает множество вопросов, касающихся этики, занятости и социального доверия. Поэтому развитие ИИ должно быть быстрым, безопасным и гуманным.

По словам министра Нгуен Мань Хунга, ИИ не заменяет людей, а служит им, выступая в роли помощника. ИИ — мощный инструмент, но решения принимают люди; поэтому ИИ должен поддерживать, а не заменять человеческое мышление, ценности и ответственность. «Министерство науки и технологий разработает национальный кодекс этики для ИИ, гармонизированный с международными стандартами, но разработанный с учетом вьетнамских реалий, а также закон об ИИ и стратегию в области ИИ», — заявил министр Нгуен Мань Хунг.

Источник: https://nld.com.vn/ngan-cong-nghe-vuot-ranh-gioi-dao-duc-196250923205638915.htm

![[Фото] Приём в честь генерального секретаря и президента Т. Лама и его жены во время их государственного визита на Филиппины.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/06/01/1780295488620_vna-potal-chieu-dai-chao-mung-tong-bi-thu-chu-tich-nuoc-to-lam-va-phu-nhan-tham-cap-nha-nuoc-toi-philippines-8798060-7855-jpg.webp)

Комментарий (0)