ปัจจุบันเทคโนโลยี Deepfake กำลังเป็นปัญหาใหญ่ เนื่องจากจำนวนการหลอกลวงที่ใช้เทคโนโลยีนี้เพิ่มขึ้นอย่างต่อเนื่อง

หลังจากทำการวิจัยฟอรัมในดาร์กเน็ต ซึ่งเป็นแหล่งที่อาชญากรไซเบอร์มักใช้ในการปฏิบัติงาน ผู้เชี่ยวชาญด้านความปลอดภัยพบว่ามีอาชญากรจำนวนมากใช้ซอฟต์แวร์ Deepfake ในการฉ้อโกง จนความต้องการมีมากกว่าปริมาณซอฟต์แวร์ Deepfake ที่มีอยู่ในตลาดอย่างมาก

เนื่องจากความต้องการมีมากกว่าอุปทาน ผู้เชี่ยวชาญของ Kaspersky คาดการณ์ว่าจะเกิดการเพิ่มขึ้นอย่างมากของการหลอกลวงด้วย Deepfake โดยมีวิธีการที่หลากหลายและซับซ้อนมากขึ้นเรื่อยๆ ตั้งแต่การสร้าง วิดีโอ เลียนแบบคุณภาพสูง ไปจนถึงการใช้ภาพของคนดังในไลฟ์สตรีมปลอมบนโซเชียลมีเดีย พร้อมสัญญาว่าจะเพิ่มเงินที่เหยื่อส่งให้เป็นสองเท่า

จากข้อมูลของระบบอ้างอิงข้อมูล Regula พบว่า 37% ของธุรกิจ ทั่วโลก เคยประสบกับกลโกง Deepfake ที่ใช้เสียง และ 29% ตกเป็นเหยื่อของกลโกง Deepfake ที่ใช้ภาพ

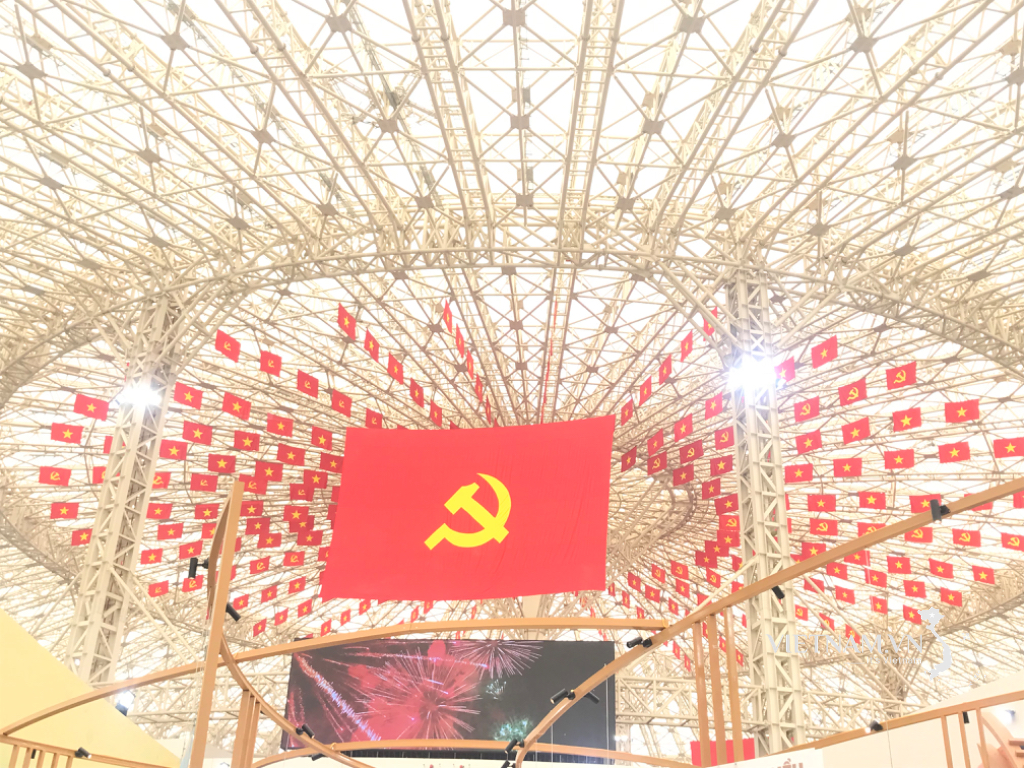

เทคโนโลยีนี้ได้กลายเป็นภัยคุกคามต่อความมั่นคงทางไซเบอร์ของเวียดนาม โดยที่อาชญากรไซเบอร์มักใช้การโทรผ่านวิดีโอปลอมเพื่อแอบอ้างเป็นบุคคลอื่นเพื่อยืมเงินจากญาติและเพื่อนฝูง

วิดีโอคอลปลอมที่สร้างด้วยเทคโนโลยี Deepfake อาจใช้เวลาเพียงแค่หนึ่งนาที ทำให้เหยื่อแยกแยะได้ยากมากระหว่างการโทรจริงกับการโทรปลอม

ภาพปลอมแปลงแบบ Deepfake กำลังกลายเป็น "ฝันร้าย" ในการหลอกลวงออนไลน์ที่ซับซ้อนมากขึ้นเรื่อย ๆ

" ภาพปลอมแปลง (Deepfake) กลายเป็นฝันร้ายสำหรับผู้หญิงและสังคม อาชญากรไซเบอร์ใช้ปัญญาประดิษฐ์ (AI) ในการซ้อนภาพใบหน้าของเหยื่อลงบนภาพและวิดีโอโป๊ รวมถึงใช้ในแคมเปญโฆษณาชวนเชื่อ"

"การบิดเบือนข้อมูลในรูปแบบเหล่านี้มีเป้าหมายเพื่อควบคุมความคิดเห็นสาธารณะโดยการเผยแพร่ข้อมูลที่ผิดพลาด หรือแม้กระทั่งทำลายชื่อเสียงขององค์กรหรือบุคคล " นางโว่ ดือง ตู เดียม ผู้อำนวยการประจำภูมิภาคของ Kaspersky เวียดนาม กล่าว

แม้ว่า AI จะถูกอาชญากรนำไปใช้ในทางที่ผิดเพื่อจุดประสงค์ที่ชั่วร้าย แต่บุคคลและธุรกิจต่างๆ ก็ยังสามารถใช้ปัญญาประดิษฐ์ในการระบุภาพปลอม (deepfake) ซึ่งจะช่วยลดโอกาสในการหลอกลวงที่ประสบความสำเร็จได้

ดังนั้น ผู้ใช้จะมีวิธีแก้ไขที่เป็นประโยชน์หลายวิธีเพื่อปกป้องตนเองจากการหลอกลวง เช่น การใช้ซอฟต์แวร์ตรวจจับเนื้อหาที่สร้างโดย AI (ซึ่งใช้อัลกอริธึมขั้นสูงในการวิเคราะห์และกำหนดขอบเขตของการดัดแปลงรูปภาพ/วิดีโอ/เสียง)

สำหรับวิดีโอดีพเฟค ปัจจุบันมีเครื่องมือที่ช่วยระบุการเคลื่อนไหวที่ไม่ตรงกันระหว่างปากและการพูดแล้ว โปรแกรมบางโปรแกรมยัง "ทรงพลัง" มากพอที่จะตรวจจับการไหลเวียนของเลือดที่ผิดปกติใต้ผิวหนังได้ด้วยการวิเคราะห์ความละเอียดของวิดีโอ เพราะเมื่อหัวใจสูบฉีดเลือด เส้นเลือดในร่างกายของคนเราจะเปลี่ยนสี

นอกจากนี้ ลายน้ำยังทำหน้าที่เป็นเครื่องหมายระบุตัวตนในภาพ วิดีโอ ฯลฯ ช่วยให้ผู้สร้างปกป้องลิขสิทธิ์ของผลิตภัณฑ์ AI ของตนได้ คุณสมบัตินี้สามารถกลายเป็นอาวุธต่อต้าน Deepfake ได้ เพราะช่วยในการติดตามแหล่งที่มาของแพลตฟอร์มที่สร้างปัญญาประดิษฐ์ ผู้ใช้ที่เชี่ยวชาญด้านเทคโนโลยีสามารถหาวิธีติดตามแหล่งที่มาของเนื้อหาเพื่อเปรียบเทียบว่าข้อมูลต้นฉบับถูกดัดแปลงโดย AI อย่างไร

ปัจจุบัน เทคโนโลยีใหม่บางอย่างใช้อัลกอริธึมการเข้ารหัสเพื่อแทรกค่าแฮชในช่วงเวลาที่กำหนดภายในวิดีโอ หากวิดีโอถูกแก้ไข ค่าแฮชจะเปลี่ยนไป ทำให้ผู้ใช้สามารถตรวจสอบได้ว่าเนื้อหาถูกดัดแปลงหรือไม่

ก่อนหน้านี้ มีแนวทางบางอย่างในการค้นหาความผิดปกติในวิดีโอ เช่น การบิดเบือนสี การเคลื่อนไหวของกล้ามเนื้อที่ไม่เป็นธรรมชาติ การเคลื่อนไหวของดวงตา เป็นต้น อย่างไรก็ตาม เมื่อ AI มีความฉลาดมากขึ้นเรื่อยๆ ค่าเหล่านี้จึงไม่ได้ให้ผลลัพธ์ที่แม่นยำเสมอไป

กระบวนการตรวจสอบความน่าเชื่อถือของวิดีโอไม่ได้อาศัยการตรวจสอบด้วยสายตาเพียงอย่างเดียวอีกต่อไป แต่ต้องใช้เครื่องมือทางเทคโนโลยีที่ออกแบบมาเพื่อป้องกันและตรวจจับเนื้อหาปลอม

คานห์ ลินห์

[โฆษณา_2]

แหล่งที่มา

การแสดงความคิดเห็น (0)