Sahte yapay zeka görüntüleri nasıl çalışıyor?

Yapay zeka artık her yerde, hatta savaşta bile. Yapay zeka uygulamaları bu yıl o kadar gelişti ki, neredeyse herkes yapay zeka üreteçlerini kullanarak en azından ilk bakışta gerçekçi görünen görüntüler oluşturabiliyor.

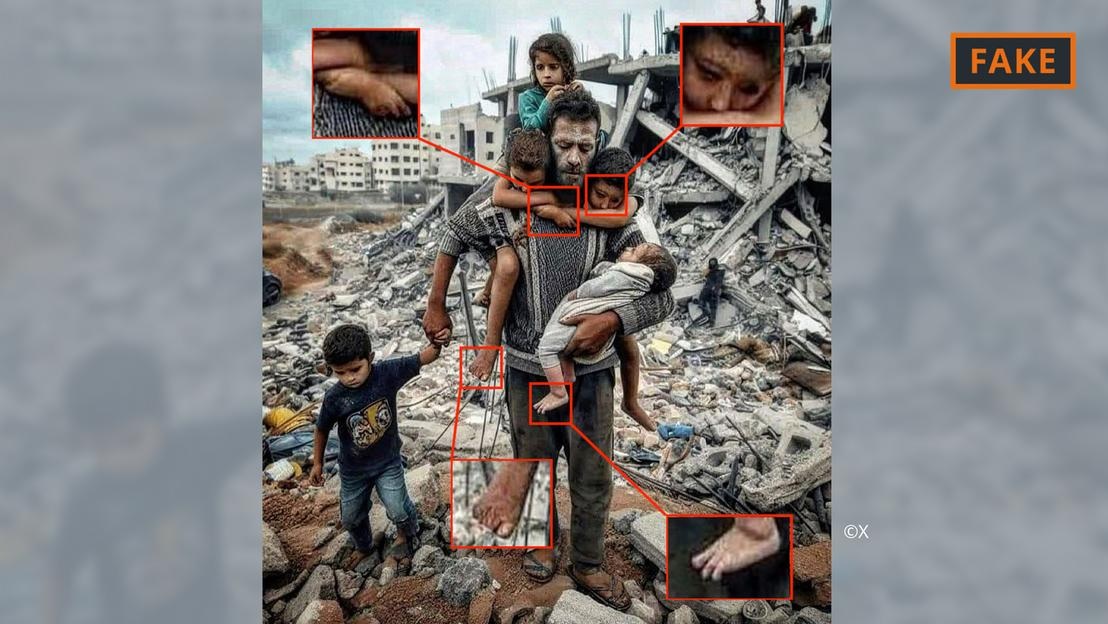

Gazze'deki savaşa ait yapay zeka destekli sahte fotoğraf.

Kullanıcılar bunu yapmak için Midjourney veya Dall-E gibi araçlara, teknik özellikler ve bilgiler içeren birkaç komut sağlar. Yapay zeka araçları daha sonra metinsel veya hatta sesli komutları görsellere dönüştürür.

Bu görüntü oluşturma süreci, makine öğrenimi olarak bilinen bir yönteme dayanmaktadır. Örneğin, bir içerik oluşturucu 70 yaşında bisiklet süren bir adamı göstermek isterse, veritabanında arama yaparak terimleri görsellerle eşleştirecektir.

Yapay zeka algoritması, mevcut bilgilere dayanarak yaşlı bisikletçinin bir görüntüsünü oluşturacaktır. Giderek artan girdi ve teknik güncellemelerle bu araçlar büyük ölçüde geliştirilmiş ve sürekli öğrenmektedir.

Tüm bunlar Orta Doğu çatışmasıyla ilgili görsellere uygulanıyor. Yapay zekâ uzmanı Hany Farid, "duyguların çok yoğun" olduğu bir çatışmada, yapay zekâ görüntüleri de dahil olmak üzere yanlış bilginin yayılmasının büyük bir etkiye sahip olduğunu söylüyor.

Kaliforniya Üniversitesi, Berkeley'de dijital analitik profesörü olan Farid, şiddetli savaşların sahte içeriklerin yaratılması ve yayılması için mükemmel bir üreme alanı olduğunu ve duyguları körüklediğini söyledi.

İsrail-Hamas savaşına ait yapay zeka görüntülerinin türleri

Yapay zekâ yardımıyla oluşturulan görüntü ve videolar Ukrayna'daki savaşa ilişkin dezenformasyonu körükledi ve bu durum İsrail-Hamas savaşında da yaşanmaya devam ediyor.

Uzmanlara göre, sosyal medyada dolaşan savaş temalı yapay zeka görselleri genellikle iki kategoriye ayrılıyor. Biri insanların çektiği acılara odaklanıyor ve sempati uyandırıyor. Diğeri ise olayları abartarak çatışmayı ve şiddeti körükleyen sahte yapay zekalar.

Gazze'deki enkazda baba ve çocuğunun yapay zeka tarafından oluşturulan sahte fotoğrafı.

Örneğin, ilk kategoride bir baba ve beş çocuğunun moloz yığınının önünde çekilmiş fotoğrafı yer alıyor. Fotoğraf, X (eski adıyla Twitter) ve Instagram'da defalarca paylaşıldı ve yüz binlerce kez görüntülendi.

Bu görsel, en azından X platformunda topluluk tarafından sahte olarak işaretlendi. Yapay zeka görsellerinde yaygın olan çeşitli hatalar ve tutarsızlıklar nedeniyle fark edilebilir (yukarıdaki görsele bakın).

Benzer anormallikler, aşağıda X'te viral olan ve Filistinli bir ailenin kalıntılar üzerinde birlikte yemek yediğini gösterdiği iddia edilen sahte yapay zeka görüntüsünde de görülebiliyor.

Filistin partisinin yapay zeka tarafından oluşturulmuş sahte fotoğrafı.

Bu arada, askerlerin bombalanmış evlerle dolu bir yerleşim yerinin içinden geçerken İsrail bayrakları salladığını gösteren bir başka görüntü, nefret ve şiddeti kışkırtmak için tasarlanmış ikinci kategoriye giriyor.

Peki bu yapay zeka görüntüleri nereden geliyor?

Çatışmalara ilişkin yapay zeka tarafından üretilen görüntülerin çoğu sosyal medya platformlarında paylaşılıyor ancak bunlara aynı zamanda birçok başka platform ve kuruluşta, hatta bazı haber sitelerinde de ulaşılabiliyor.

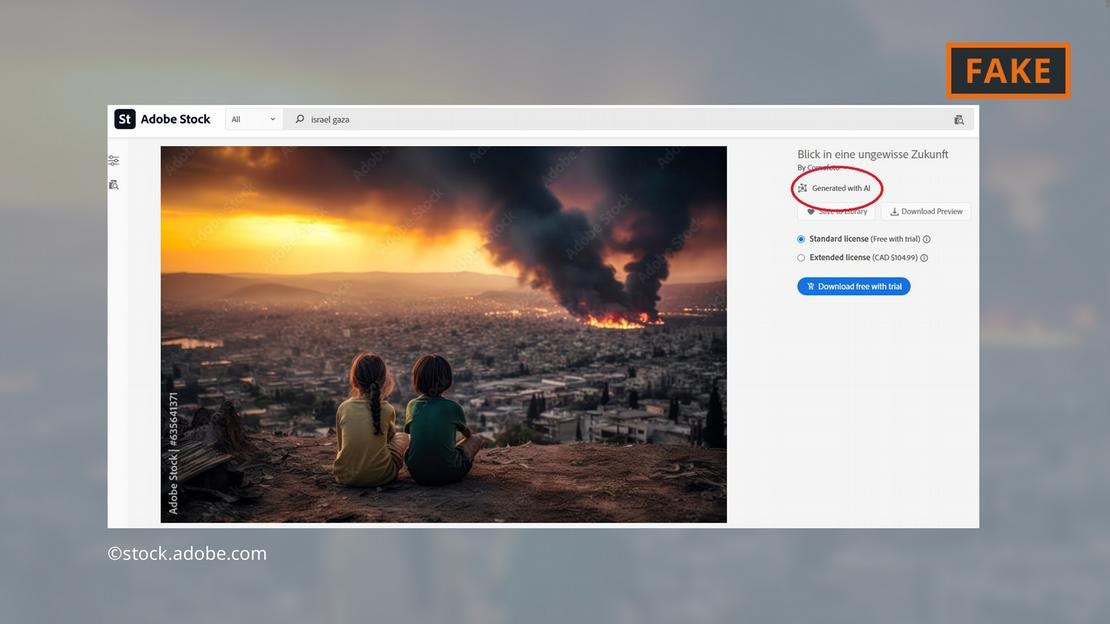

Yazılım şirketi Adobe, 2022 yılı sonuna kadar stok fotoğraf yelpazesine yapay zeka destekli görseller ekleyerek gündemde yer aldı. Bunlar veritabanında buna göre etiketlenecek.

Adobe ayrıca Ortadoğu savaşına ait patlamalar, protesto eden insanlar veya Mescid-i Aksa'nın arkasındaki duman sütunları gibi görselleri yapay zeka kullanarak satışa sunuyor.

Adobe, Gazze'deki çatışmalara ait yapay zeka destekli görüntüleri kullanıma sunuyor.

Eleştirmenler bu durumu rahatsız edici buldu, çünkü bazı siteler görselleri yapay zeka tarafından üretilmiş olarak etiketlemeden kullanmaya devam etti. Örneğin, söz konusu görsel, yapay zeka tarafından üretildiğine dair hiçbir belirti olmadan "Newsbreak" sayfasında yayınlandı.

Avrupa Parlamentosu'nun bilimsel kolu olan Avrupa Parlamentosu Araştırma Servisi bile, Ortadoğu çatışmasıyla ilgili bir çevrimiçi metni, Adobe veritabanından alınan bir yapay zeka görseliyle resimlendirdi; ancak görselin yapay zeka tarafından üretildiğine dair bir etiket koymadı.

Avrupa Dijital Medya Gözlemevi, gazetecileri ve medya profesyonellerini yapay zeka görüntülerini kullanırken son derece dikkatli olmaları konusunda uyarıyor ve özellikle Gazze'deki savaş gibi gerçek hayattaki olayları ele alırken bu tür görüntülerin kullanılmamasını tavsiye ediyor.

Yapay zeka görüntüleri ne kadar tehlikeli?

Viral yapay zeka içerikleri ve görselleri, kullanıcıların çevrimiçi ortamda karşılaştıkları her şey konusunda huzursuz hissetmelerine neden olacaktır. UC Berkeley araştırmacısı Farid, "Görüntülerin, seslerin ve videoların manipüle edilebildiği bir dünyaya girersek, her şey şüpheli hale gelir," diye açıklıyor. "Dolayısıyla gerçeğe de dahil olmak üzere her şeye olan güvenimizi kaybederiz."

İşte tam da bu olayda yaşananlar: İsrail Başbakanı Binyamin Netanyahu ve diğer bazı siyasetçiler tarafından sosyal medyada paylaşılan, İsrailli bir bebeğin yanmış cesedi olduğuna inanılan bir görüntü.

İsrail karşıtı bir fenomen olan Jackson Hinkle, daha sonra görselin yapay zeka kullanılarak oluşturulduğunu iddia etti. Hinkle'ın bu açıklaması sosyal medyada 20 milyondan fazla kez görüntülendi ve platformda hararetli tartışmalara yol açtı.

Sonuç olarak, çok sayıda kuruluş ve doğrulama aracı, görüntünün gerçek olduğunu ve Hinkle'ın iddiasının yanlış olduğunu açıkladı. Ancak, hiçbir aracın kullanıcıların kaybettikleri güveni kolayca geri kazanmalarına yardımcı olamayacağı açıktır!

Hoang Hai (DW'ye göre)

[reklam_2]

Kaynak

Yorum (0)