|

| Ілюстрація заклику розглядати штучний інтелект як біологічну зброю. (Джерело: gizmodo.com) |

У статті «Ставтеся до ШІ як до біологічної зброї, а не до ядерної» Емілії Яворської, науковиці -лікарки та директорки Інституту майбутнього життя (США), авторка стверджує, що, незважаючи на те, що світ останнім часом неодноразово порівнював ШІ з ядерними бомбами, існує більш підходящий підхід, який полягає в регулюванні цього типу технологій як біологічної зброї або біотехнології.

За словами автора, штучний інтелект, мабуть, є найпотужнішою технологією в історії людства, яку людство розробляє сьогодні. Шкідливий вплив штучного інтелекту, включаючи дискримінацію, загрози демократії та концентрацію впливу, добре задокументований.

Однак провідні компанії зі штучного інтелекту змагаються у створенні дедалі потужніших систем штучного інтелекту, що зростає ризики зі швидкістю, безпрецедентною в історії людства.

Оскільки лідери намагаються стримати та контролювати поширення штучного інтелекту та пов'язані з ним ризики, їм необхідно враховувати ті ж правила та стандарти, які людство використовувало для його створення в минулому.

Адаптація та інновації можуть співіснувати, особливо коли на кону людські життя.

Попередження від ядерних технологій

Хоча ядерна енергетика більш ніж у 600 разів безпечніша за нафту з точки зору смертності та надзвичайно ефективна, мало хто з країн торкається її через наслідки, які вони спостерігали внаслідок тривалого підходу до ядерної енергетики.

Світ дізнався про ядерні технології у вигляді атомної та водневої бомб. Завдяки цій зброї людство вперше в історії розробило технологію, здатну покласти край людській цивілізації, продукту гонки озброєнь, яка надавала пріоритет швидкості та інноваціям над безпекою та контролем.

Подальші провали в технічній безпеці та управлінні ризиками, які стали відомими причинами ядерних катастроф на Чорнобильській АЕС та Фукусімі, знищили будь-які шанси людей сприйняти позитивні аспекти ядерної енергетики.

Незважаючи на загальну сприятливу оцінку ризиків ядерної енергетики та десятиліття вчених, які працюють над тим, щоб переконати світ у її життєздатності, сама концепція «ядерної» енергетики залишається… заплямованою.

Коли технологія завдає шкоди на ранніх стадіях, суспільна обізнаність та надмірна реакція можуть назавжди обмежити її потенційні переваги. Через ранні помилки з ядерною енергетикою людство не змогло скористатися перевагами її чистого, безпечного джерела енергії, а вуглецева нейтральність та енергетична стабільність залишаються недосяжною мрією.

Правильний підхід до біотехнології

Однак у деяких галузях люди зробили правильний вибір. Біотехнологія — одна з таких галузей, яка має стимул для швидкого розвитку в контексті того, що багато пацієнтів щодня страждають і помирають від хвороб, які не мають ліків.

Етос цього дослідження полягає не в тому, щоб «швидко рухатися та ламати речі», а в тому, щоб впроваджувати інновації якомога швидше та безпечніше. Люди обмежують темпи інновацій у цій галузі системою правил, етики та норм, які захищають добробут суспільства та окремих осіб, а також оберігають галузь від паралічу через негативну реакцію, яка може призвести до катастрофи.

Коли біологічну зброю було заборонено на Конвенції про заборону біологічної зброї під час Холодної війни, протиборчі наддержави погодилися, що створення такої зброї нічиїми інтересами не відповідає. Лідери побачили, що ці важкоконтрольовані, але легкодоступні технології не слід розглядати як механізм перемоги в гонці озброєнь, а як загрозу самому людству.

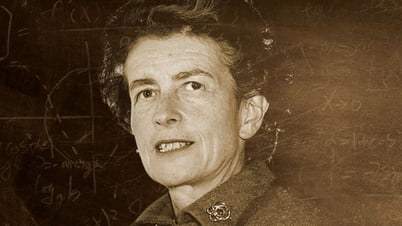

| Емілія Яворська — одна з науковиць, яка нещодавно підписала відкритого листа, в якому виступає за шестимісячний мораторій на розробку штучного інтелекту. Вона також підписала заяву, в якій попереджає, що штучний інтелект становить «ризик зникнення» для людства. |

Пауза в гонці біологічної зброї дозволяє людству розвивати її у відповідальному темпі, а вчені та регулятори застосовують суворі стандарти до будь-яких нових інновацій, які потенційно можуть завдати шкоди людині.

Ці зміни не обійшлися без витрат, але також започаткували біоекономіку з багатьма застосуваннями в різних сферах, від чистої енергії до сільського господарства.

Під час пандемії Covid-19 біологи застосували технологію мРНК для створення ефективних вакцин зі швидкістю, безпрецедентною в історії людства.

Нещодавнє опитування дослідників штучного інтелекту показало, що 36% респондентів вважають, що штучний інтелект може спричинити катастрофу ядерного рівня. Однак реакція уряду та його регулювання були повільними, що не відповідає темпам впровадження технологій, адже кількість користувачів застосунку ChatGPT зараз перевищує 100 мільйонів.

Стрімке зростання ризиків, пов'язаних зі штучним інтелектом, спонукало 1800 генеральних директорів та 1500 професорів у США нещодавно підписати листа із закликом до шестимісячної паузи в розробці ШІ та термінового процесу регулювання та зменшення ризиків. Ця пауза дасть світовій спільноті час обмежити шкоду, завдану ШІ, та запобігти ризику незворотної катастрофи для нашого суспільства.

Оцінюючи ризики та потенційну шкоду штучного інтелекту, ми також повинні враховувати, як не втратити з поля зору позитивний потенціал цієї технології. Якщо ми будемо відповідально розвивати штучний інтелект зараз, ми зможемо отримати неймовірні переваги від цієї технології. Наприклад, переваги застосування штучного інтелекту для розробки та відкриття ліків, покращення якості та вартості медичного обслуговування, а також розширення доступу до лікарів та медичного лікування.

DeepMind від Google показав, що штучний інтелект має потенціал для вирішення фундаментальних проблем у біології, яких людство довго уникало. Згідно з дослідженням, штучний інтелект може пришвидшити досягнення всіх Цілей сталого розвитку Організації Об'єднаних Націй, рухаючи людство до майбутнього з покращеним здоров'ям, рівністю, процвітанням та миром.

Настав час для світової спільноти об'єднатися, як це було 50 років тому на Конвенції про заборону біологічної зброї, щоб забезпечити безпечний та відповідальний розвиток штучного інтелекту. Якщо ми не вживемо заходів найближчим часом, ми ризикуємо зруйнувати світле майбутнє ШІ та наше власне суспільство.

Джерело

![[Фото] Осінній ярмарок 2025 та вражаючі рекорди](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/03/1762180761230_ndo_br_tk-hcmt-15-jpg.webp)

![[Фото] Прем'єр-міністр Фам Мінь Чінь приймає голову Асоціації дружби між Японією та В'єтнамом у регіоні Кансай](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/03/1762176259003_ndo_br_dsc-9224-jpg.webp)

![[Фото] Генеральний секретар То Лам приймає посла Сінгапуру Джаю Ратнама](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/03/1762171461424_a1-bnd-5309-9100-jpg.webp)

![[Фото] Лам Донг: Крупний план незаконного озера з пробитою стіною](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/03/1762166057849_a5018a8dcbd5478b1ec4-jpg.webp)

Коментар (0)