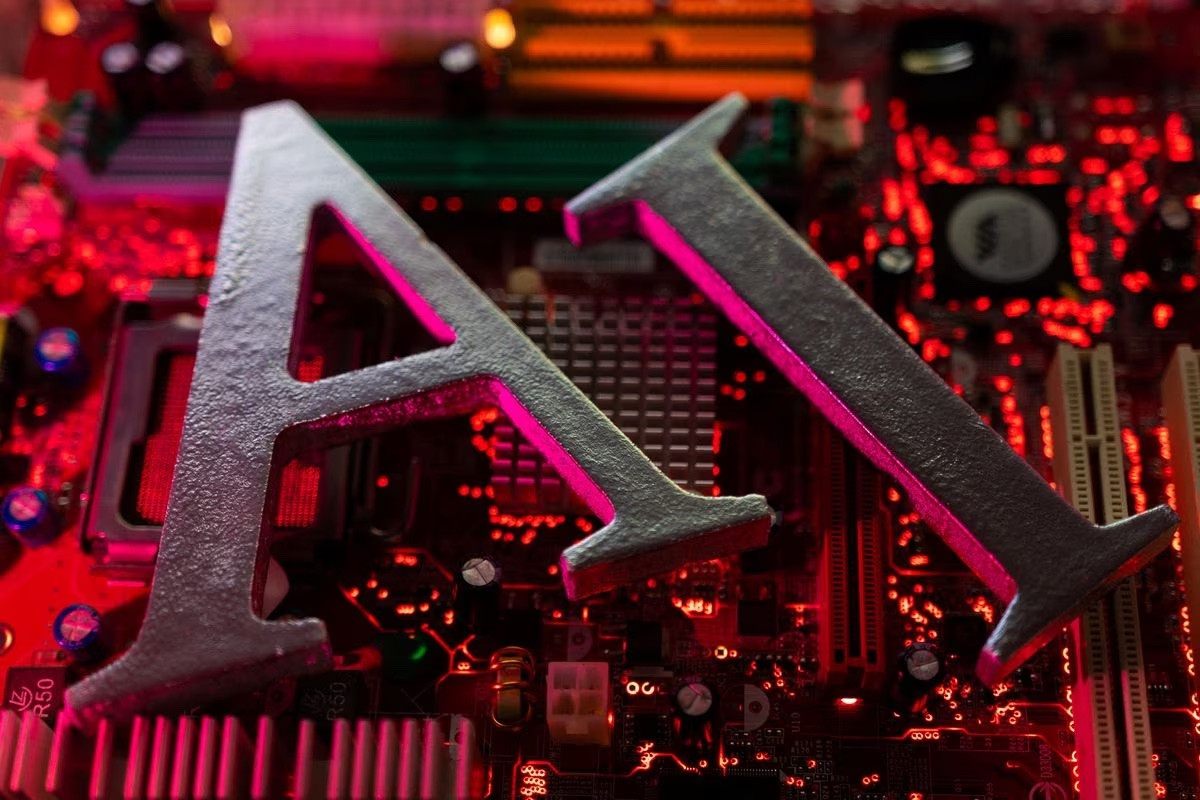

حذرت وكالة الأمن السيبراني في المملكة المتحدة المنظمات التي تقوم بدمج روبوتات الدردشة التي تعمل بالذكاء الاصطناعي في منتجاتها وخدماتها، قائلة إن الأبحاث تظهر أن أدوات الذكاء الاصطناعي يمكن التلاعب بها بسهولة لأداء مهام ضارة.

في منشور على مدونته بتاريخ 30 أغسطس، قال مركز الأمن السيبراني في المملكة المتحدة (NCSC) إن الخبراء لم يدركوا بعد مشكلات الأمن السيبراني المحتملة المرتبطة بالخوارزميات التي يمكن أن تتفاعل "مثل البشر"، وهي نماذج اللغة الكبيرة (LLMs).

وقال المركز الوطني للأمن الإلكتروني إن هذا الأمر يشكل مخاطر عندما يتم دمج مثل هذه النماذج في العمليات التجارية، حيث يجد الأكاديميون والباحثون باستمرار طرقًا "لخداع" الذكاء الاصطناعي، وتوجيه برامج المحادثة لارتكاب الاحتيال أو تجاوز الضمانات المضمنة.

على سبيل المثال، يمكن خداع روبوت المحادثة الذي يعمل بالذكاء الاصطناعي والمستخدم في أحد البنوك لإجراء معاملة غير مصرح بها إذا أعطى المخترق "التعليمات" الصحيحة.

وقال المركز الوطني للأمن السيبراني: "إن المنظمات التي تبني خدمات حول برامج الماجستير في القانون تحتاج إلى توخي الحذر من حيث أنها تستخدم منتجًا جديدًا في مرحلة تجريبية"، في إشارة إلى إصدارات الذكاء الاصطناعي الأخيرة.

أظهر استطلاع رأي حديث أجرته رويترز/إبسوس أن العديد من موظفي الشركات يستخدمون أدوات مثل ChatGPT لأداء مهام أساسية مثل صياغة رسائل البريد الإلكتروني وتلخيص المستندات وجمع بيانات البحث الأولية.

ومن بين هؤلاء، قال 10% فقط من الموظفين إن رؤساءهم منعوا صراحة استخدام أدوات الذكاء الاصطناعي الخارجية، ولم يعرف 25% ما إذا كانت شركتهم تسمح باستخدام هذه التكنولوجيا.

قال أوسيلوكا أوبيورا، كبير مسؤولي التكنولوجيا في شركة ريفر سيف للأمن، إن الاندفاع نحو دمج الذكاء الاصطناعي في نماذج الأعمال سيكون له "عواقب وخيمة" إذا لم يُجرِ قادة الأعمال العناية الواجبة اللازمة. وأضاف: "بدلاً من الانجراف وراء موجة الذكاء الاصطناعي، ينبغي على كبار المسؤولين التنفيذيين التفكير مليًا وإجراء تقييم للمخاطر والفوائد، بالإضافة إلى التدابير الأمنية اللازمة لحماية الأعمال".

الأخبار المزيفة والمتسللين

في جميع أنحاء العالم ، تسعى الحكومات أيضًا إلى إدارة صعود برامج ماجستير إدارة الأعمال، مثل ChatGPT من OpenAI. وتُركز سياساتها أيضًا على المخاوف الأمنية المتعلقة بالتقنية الجديدة، حيث أفادت الولايات المتحدة وكندا مؤخرًا برصدهما تزايد استغلال القراصنة للذكاء الاصطناعي التوليدي.

حتى أن أحد القراصنة قال إنه وجد برنامج ماجستير في القانون "مُدرّبًا" على استخدام مواد خبيثة، وطلب منه بناء عملية احتيال لتحويل الأموال. ردًا على ذلك، أنشأ الذكاء الاصطناعي رسالة بريد إلكتروني من ثلاث فقرات تطلب من المستلم دفع فاتورة عاجلة.

في يوليو/تموز 2023، لاحظ المركز الكندي للأمن السيبراني تزايد استخدام الذكاء الاصطناعي في "الاحتيال عبر البريد الإلكتروني، والبرامج الضارة، والتضليل الإعلامي". ولم يقدم سامي خوري، مدير المركز، أدلةً محددة، لكنه أكد أن مجرمي الإنترنت يستغلون هذه التقنية الناشئة بنشاط.

وأضاف الزعيم أيضًا أنه على الرغم من أن استخدام الذكاء الاصطناعي لصياغة البرامج الضارة لا يزال في مراحله الأولى، فإن نماذج الذكاء الاصطناعي تتطور بسرعة كبيرة بحيث يصبح من السهل فقدان السيطرة على مخاطرها الخبيثة.

في مارس/آذار 2023، نشرت منظمة الشرطة الأوروبية (يوروبول) تقريرًا يفيد بأن برنامج ChatGPT قادر على "انتحال هويات المنظمات والأفراد بطريقة واقعية للغاية، حتى باستخدام الإنجليزية البسيطة فقط". وفي الشهر نفسه، صرّح المركز الوطني للأمن السيبراني في المملكة المتحدة بأنه "يمكن استخدام برنامج LLM لدعم الهجمات السيبرانية".

(بحسب رويترز)

[إعلان 2]

مصدر

![[أخبار الملاحة البحرية] أكثر من 80% من سعة شحن الحاويات العالمية في أيدي MSC وتحالفات الشحن الكبرى](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/7/16/6b4d586c984b4cbf8c5680352b9eaeb0)

تعليق (0)