على وجه التحديد، نصحت شركة ألفابت، الشركة الأم لجوجل، موظفيها بعدم إدخال وثائقهم السرية في روبوتات الدردشة الذكية. ووفقًا لمصادر داخل ألفابت نفسها، اطلعت عليها رويترز، حذرت الشركة مهندسيها من استخدام الشيفرة البرمجية التي تُنتجها روبوتات الدردشة مباشرةً.

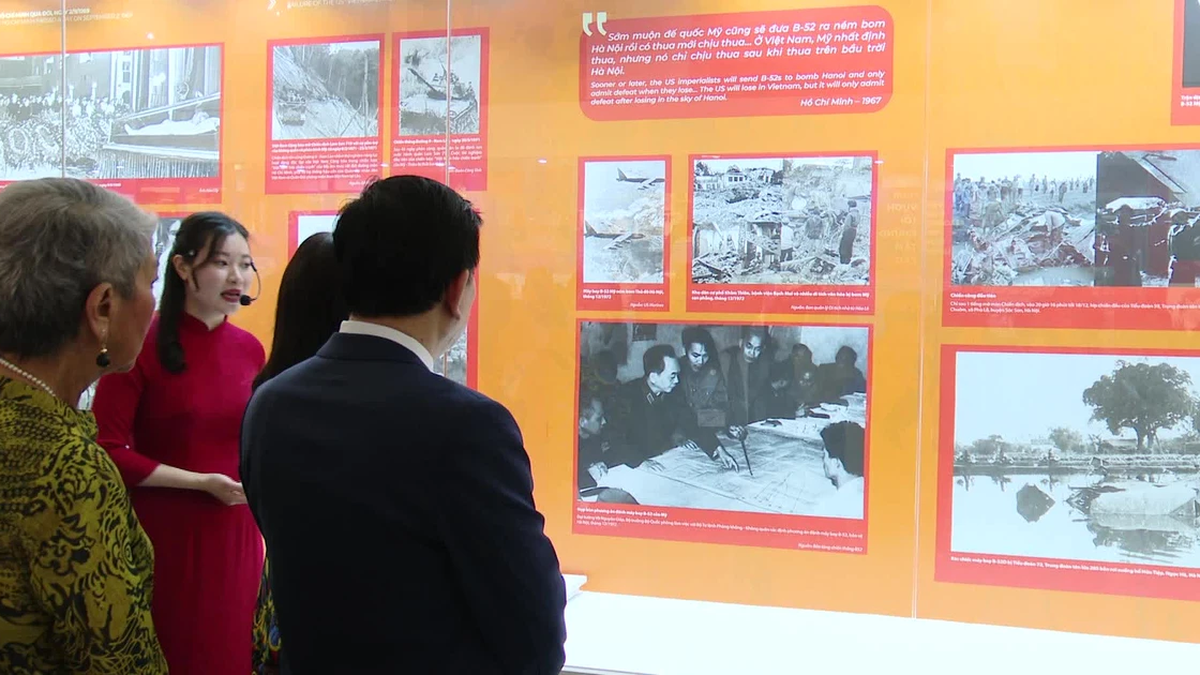

تشعر شركة جوجل العملاقة للتكنولوجيا بالقلق أيضًا بشأن تسريب المعلومات عبر روبوت الدردشة الذكي الخاص بها. الصورة: رويترز

روبوتات الدردشة، بما في ذلك بارد وChatGPT، هي برامج تستخدم ما يُسمى بالذكاء الاصطناعي العام لإجراء محادثات تُحاكي المحادثات البشرية مع المستخدمين. ويقول الخبراء إن روبوتات الدردشة قادرة على تكرار البيانات التي تستوعبها أثناء استجابتها، مما يُشكل خطر تسريب معلومات المستخدم.

تُظهر هذه المخاوف سعي جوجل لتجنب أي ضرر تجاري ناتج عن برنامجها الذي تُطلقه لمنافسة ChatGPT. كما يعكس حذر جوجل اتجاهًا عالميًا متزايدًا للخوف، بما في ذلك تحذير الشركات من الكشف عن معلومات حول برامج الدردشة الآلية.

لقد وضعت عدد متزايد من الشركات في جميع أنحاء العالم ضمانات على برامج المحادثة التي تعمل بالذكاء الاصطناعي، بما في ذلك سامسونج وأمازون ودويتشه بنك.

وبحسب استطلاع أجرته شركة Fishbowl الأمريكية على ما يقرب من 12 ألف شخص، فإن حوالي 43% من المتخصصين في مجال التكنولوجيا كانوا يستخدمون ChatGPT أو أدوات الذكاء الاصطناعي الأخرى اعتبارًا من يناير/كانون الثاني، غالبًا دون إخبار رؤسائهم.

بحلول فبراير، طلبت جوجل من موظفي روبوت الدردشة "بارد" عدم مشاركة أي معلومات داخلية، وفقًا لتقرير Insider. وتُطلق جوجل الآن روبوت "بارد" في أكثر من 180 دولة وبأربعين لغة.

تُطبّق تقنية الذكاء الاصطناعي من جوجل على أدواتٍ تُنشئ رسائل البريد الإلكتروني والمستندات، بل وتُنشئ البرامج تلقائيًا. مع ذلك، قد تحتوي هذه المهام على معلوماتٍ خاطئة، وقد تُشكّل خطر تسريب المعلومات.

بوي هوي (وفقا لرويترز، إنسايدر)

[إعلان 2]

مصدر

تعليق (0)