في عام 2023، بينما يشعر ملايين الأشخاص بالقلق بشأن إمكانية استيلاء نماذج الذكاء الاصطناعي مثل ChatGPT على وظائفهم، فإن بعض الشركات على استعداد لدفع مئات الآلاف من الدولارات لتجنيد الأشخاص الذين يمكنهم استغلال هذا الجيل الجديد من روبوتات الدردشة التي تعمل بالذكاء الاصطناعي.

وبحسب بلومبرج ، فإن ظهور ChatGPT في ذلك الوقت أدى إلى إنشاء مهنة جديدة تسمى Prompt Engineer، براتب يصل إلى 335000 دولار أمريكي /السنة.

"تحدث مع الذكاء الاصطناعي"

على عكس المبرمجين التقليديين، يقترح المهندسون البرمجة نثرًا، ثم يرسلون الأوامر المكتوبة في نص عادي إلى نظام الذكاء الاصطناعي، الذي يقوم بعد ذلك بتحويل الأوصاف إلى عمل فعلي.

غالبًا ما يفهم هؤلاء الأشخاص عيوب الذكاء الاصطناعي، الأمر الذي قد يؤدي بعد ذلك إلى تعزيز قوته والتوصل إلى استراتيجيات معقدة لتحويل المدخلات البسيطة إلى نتائج فريدة حقًا.

|

حقق لانس جانك أرباحًا تقارب 35,000 دولار أمريكي من دورة تدريبية عبر الإنترنت لتعليم الناس كيفية استخدام ChatGPT. الصورة: Gearrice. |

لاستخدام الذكاء الاصطناعي بفعالية، يجب إتقان مهارة تصميم الأوامر. فبدون هذه المهارة، ستُدمر مسيرتك المهنية عاجلاً أم آجلاً، كما قالت ليديا لوجان، نائبة رئيس التعليم العالمي وتنمية الموارد البشرية في مجموعة IBM للتكنولوجيا.

ومع ذلك، مع التطور السريع، أصبحت نماذج الذكاء الاصطناعي الآن أفضل بكثير في فهم نوايا المستخدم، ويمكنها حتى طرح أسئلة متابعة إذا كانت النية غير واضحة.

بالإضافة إلى ذلك، ووفقًا لصحيفة وول ستريت جورنال ، تقوم الشركات بتدريب مجموعة واسعة من الموظفين عبر مختلف الإدارات حول أفضل طريقة لاستخدام الأوامر ونماذج الذكاء الاصطناعي، لذلك هناك حاجة أقل لشخص واحد يحمل هذه الخبرة.

على وجه التحديد، في استطلاع حديث أجرته مايكروسوفت، سُئل 31 ألف موظف في 31 دولة عن الأدوار الجديدة التي تُفكّر شركتهم في إضافتها خلال الـ 12-18 شهرًا القادمة. ووفقًا لجاريد سباتارو، مدير تسويق الذكاء الاصطناعي في مايكروسوفت، احتلّ مهندس الأوامر المرتبة الثانية من أسفل القائمة.

وفي الوقت نفسه، تتصدر الأدوار مثل المدربين وعلماء البيانات وخبراء أمن الذكاء الاصطناعي القائمة.

يزعم سباتارو أن نماذج اللغة الكبيرة تطورت الآن بما يكفي لتمكين التفاعل والحوار والوعي بالسياق بشكل أفضل.

على سبيل المثال، ستطرح أداة البحث القائمة على الذكاء الاصطناعي من مايكروسوفت أسئلة متابعة، وتُعلم المستخدم عندما لا يفهم شيئًا ما، وتطلب منه إبداء رأيه في المعلومات المُقدمة. بعبارة أخرى، يقول سباتارو: "ليس بالضرورة أن تكون الجمل مثالية".

إن المطالبة بـ "الأعمى" ليست خطأ

هناك عدد قليل جدًا من الوظائف الشاغرة لمهندسي القيادة في الوقت الحالي، وفقًا لهانا كالهون، نائب الرئيس للذكاء الاصطناعي في منصة البحث عن الوظائف Indeed.

في يناير 2023، بعد أشهر قليلة من إطلاق ChatGPT، ارتفعت عمليات بحث المستخدمين على Indeed عن هذا الدور إلى 144 عملية بحث لكل مليون عملية بحث. ومع ذلك، استقر هذا العدد منذ ذلك الحين عند حوالي 20-30 عملية بحث لكل مليون عملية بحث.

|

مهندسو التوجيه هم مهندسون مكلفون بصياغة الأسئلة أو إصدار الأوامر لأدوات الذكاء الاصطناعي مثل ChatGPT. الصورة: Riku AI. |

وبالإضافة إلى انخفاض الطلب، بسبب الميزانيات الضيقة وعدم اليقين الاقتصادي المتزايد، أصبحت الشركات أيضًا أكثر حذرًا بشأن التوظيف بشكل عام في السنوات الأخيرة.

وتقول شركات مثل Nationwide Insurance وCarhartt Workwear وNew York Life Insurance إنها لم تقم بتوظيف مهندسين قيادة على الإطلاق، وبدلاً من ذلك ترى أن مهارات القيادة الأفضل هي المهارة التي يمكن تدريب جميع الموظفين الحاليين عليها.

يقول جيم فاولر، كبير مسؤولي التكنولوجيا في Nationwide: "سواء كنت تعمل في مجال التمويل أو الموارد البشرية أو الشؤون القانونية، فإننا نرى أن هذه القدرة جزء من مسمى وظيفي، وليست مسمى وظيفي منفصل".

قال البروفيسور أندرو نج، مؤسس Google Brain والمحاضر في جامعة ستانفورد، إنه في بعض الأحيان لا يحتاج المستخدمون إلى أن يكونوا مفصلين للغاية عند إدخال الطلبات (المطالبات) للذكاء الاصطناعي.

في منشور على X، يُطلق السيد نج على هذه الطريقة اسم " التحفيز الكسول " - أي تغذية الذكاء الاصطناعي بالمعلومات دون سياق واضح أو تعليمات محددة. وقال المؤسس المشارك لكورسيرا وديب ليرنينج: "يجب ألا نضيف تفاصيل إلى التحفيز إلا عند الضرورة القصوى".

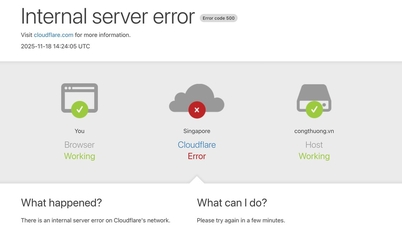

يقدم نج مثالاً نموذجيًا للمبرمجين الذين يقومون بتصحيح الأخطاء، والذين غالبًا ما يقومون بنسخ ولصق رسائل الخطأ بأكملها - أحيانًا عدة صفحات طويلة - في نماذج الذكاء الاصطناعي دون ذكر ما يريدون صراحةً.

"معظم نماذج اللغة الكبيرة (LLMs) ذكية بما يكفي لفهم ما تحتاج إلى تحليله واقتراح الحلول، حتى لو لم تقل ذلك صراحةً"، كما كتب.

|

يتجاوز برنامج ماجستير إدارة الأعمال الاستجابة للأوامر البسيطة، إذ بدأ بفهم نوايا المستخدم وأسبابه لإيجاد حلول مناسبة. الصورة: بلومبرج. |

وبحسب نج، فإن هذه خطوة إلى الأمام تُظهر أن LLM تتجه تدريجياً إلى ما هو أبعد من القدرة على الاستجابة للأوامر البسيطة، لتبدأ في فهم نوايا المستخدم وأسبابه للتوصل إلى حلول مناسبة - وهو الاتجاه الذي تسعى إليه الشركات التي تطور نماذج الذكاء الاصطناعي.

مع ذلك، لا يُجدي "التحفيز المتكاسل" نفعًا دائمًا. يُشير نج إلى أنه ينبغي استخدام هذه التقنية فقط عندما يتمكن المستخدمون من الاختبار بسرعة، مثلًا من خلال واجهة ويب أو تطبيق ذكاء اصطناعي، ويكون النموذج قادرًا على استنتاج النية من معلومات قليلة.

وأكد السيد نج قائلاً: "إذا كانت الذكاء الاصطناعي يحتاج إلى الكثير من السياق للاستجابة بالتفصيل، أو لا يستطيع التعرف على الأخطاء المحتملة، فلن يكون هناك أي فائدة من مجرد توجيه بسيط".

المصدر: https://znews.vn/khong-con-ai-can-ky-su-ra-lenh-cho-ai-nua-post1549306.html

![[صورة] الذكرى الستين لتأسيس جمعية فناني التصوير الفوتوغرافي في فيتنام](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F05%2F1764935864512_a1-bnd-0841-9740-jpg.webp&w=3840&q=75)

![[صورة] كات با - جنة الجزيرة الخضراء](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F04%2F1764821844074_ndo_br_1-dcbthienduongxanh638-jpg.webp&w=3840&q=75)

تعليق (0)