|

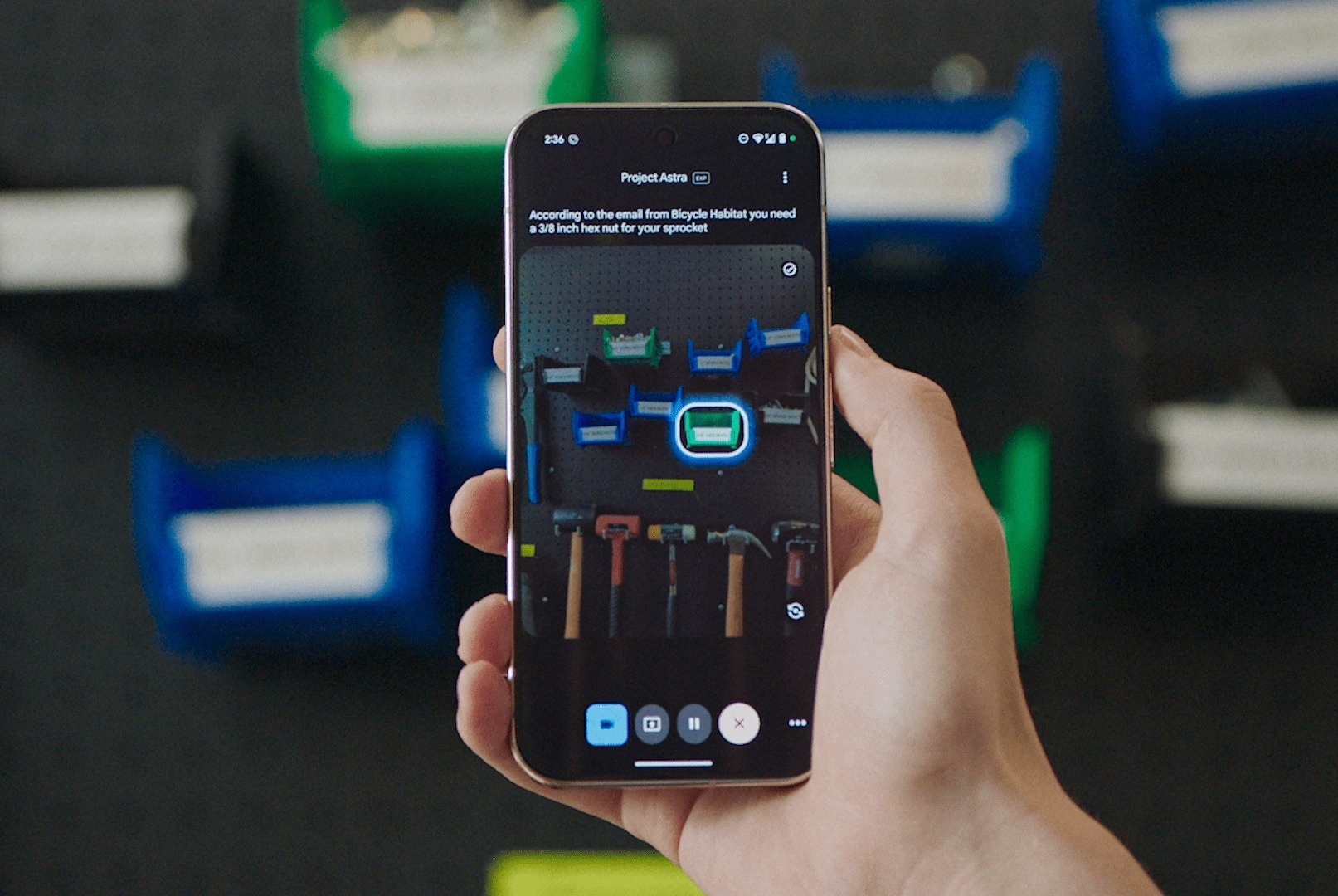

Interaktive Benutzeroberfläche von Project Astra. Foto: Google . |

Auf der I/O 2025 am frühen Morgen des 21. Mai (Vietnamesischer Zeit) kündigte Google zahlreiche neue Funktionen von Project Astra an. Das 2024 erstmals eingeführte Project Astra nutzt ein multimodales KI-Modell, um Bilder und visuelle Informationen in Echtzeit zu nutzen und zu analysieren. Dies ist Googles großes Ziel, KI im Alltag nützlicher zu machen.

Nach einer Testphase werden einige Funktionen von Project Astra wie Sprachfeedback, Speicher und grundlegende Berechnungen in Gemini- und Google-Apps erscheinen.

Während der Veranstaltung demonstrierte Google einige Möglichkeiten, wie Astra im Alltag helfen kann. Neben der Beantwortung von Fragen und der Kamera, die sich merkt, wo Sie Ihre Brille abgelegt haben, kann Astra nun auch proaktiv Aufgaben erledigen, ohne dass Sie darum bitten müssen.

„Astra kann basierend auf dem, was es sieht, entscheiden, wann es spricht. Es beobachtet ständig und reagiert entsprechend“, sagte Greg Wayne, Forscher bei DeepMind.

Laut The Verge könnte diese Funktion die Funktionsweise von KI verändern. Anstatt darauf zu warten, dass Nutzer ihre Kameras ausrichten und um Hilfe bitten, kann Astra kontinuierlich überwachen, zuhören und bei Bedarf automatisch helfen. Derzeit konzentriert sich Google auf die Entwicklung von Astra für Smartphones und Smart Glasses.

Wayne gibt einige Beispiele für die Funktionsweise von Astra. Während der Hausaufgaben kann das Tool die Benutzer überwachen und sofort warnen, wenn Fehler erkannt werden, anstatt zu warten, bis der Benutzer fertig ist und um eine Überprüfung bittet.

Demis Hassabis, CEO von DeepMind, sagte, Astra darin zu trainieren, Aufgaben selbstständig auszuführen, sei eine der schwierigsten technischen Fähigkeiten. Er nannte es „Situationslesen“, da die KI entscheiden müsse, wann sie helfen soll, wie sie helfen soll und wann sie ruhig bleiben soll. Dies sind Aktionen, die Menschen zwar recht gut beherrschen, aber schwer zu quantifizieren und zu untersuchen sind.

Astras nächstes Upgrade besteht darin, Nutzerinformationen im Internet und in Google-Produkten auszuwerten. Laut The Verge kann das Tool den Zeitplan kennen, um zu benachrichtigen, wann man das Haus verlassen soll, und den Inhalt von E-Mails lesen, um beim Check-in in Hotels Telefonnummern zu extrahieren.

|

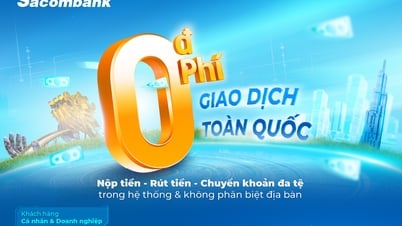

Die Hervorhebungsfunktion von Project Astra hilft beim Scannen von Objekten und beim Vergleichen von Informationen, die in anderen Anwendungen extrahiert wurden. Foto: Google . |

Das letzte Puzzleteil von Astra ist seine Fähigkeit, die Bedienung eines Android-Telefons zu erlernen. Bibo Xiu, ein Vertreter der Produktabteilung von DeepMind, demonstrierte dies auf der Veranstaltung. Er richtete die Kamera des Telefons auf einen Sony-Kopfhörer und bat Astra, das Modell zu identifizieren.

Nachdem Astra geantwortet hatte, dass es sich bei den Kopfhörern um Sony WH-1000XM4 oder WH-1000XM3 handeln könnte, bat Xiu das Tool weiter, die Bedienungsanleitung zu finden, und erklärte dann, wie man eine Verbindung zum Telefon herstellt. Nach Astras Anweisungen unterbrach Xiu den Chatbot und bat ihn, die Verbindung für ihn herzustellen. Astra öffnete sofort die Einstellungen und führte die Verbindung selbst durch.

Der Vorgang verlief nicht ganz reibungslos, da Xiu Astra erlauben musste, den Telefonbildschirm zu überwachen. Google strebt an, dass der Chatbot in Zukunft Bildschirme automatisch überwachen kann.

In einem anderen Google- Video bittet eine Person Astra, ein Huffy-Fahrradhandbuch zu suchen und anschließend eine Seite mit Anweisungen zur Reparatur eines Fahrradteils aufzurufen. Astra kann sogar ein YouTube-Video zum Entfernen einer abgenutzten Schraube finden und anschließend den nächstgelegenen Händler kontaktieren, um ein Ersatzteil zu finden. In der Demonstration läuft alles nahtlos ab.

Obwohl Astra noch nicht flächendeckend veröffentlicht wurde, sagte Google, dass die Bildanalysefunktion Gemini Live für alle iOS-Benutzer veröffentlicht wird (bisher wurde sie nur von Android unterstützt).

In Zukunft werde die KI von Google nicht nur auf Befehl handeln, sondern Astra werde helfen, „zu verstehen, was im Moment sichtbar ist und was nicht“, sagte Xiu.

Quelle: https://znews.vn/ai-cua-google-ngay-cang-thong-minh-post1554615.html

![[Maritime News] Mehr als 80 % der weltweiten Containerschifffahrtskapazität liegen in den Händen von MSC und großen Schifffahrtsallianzen](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/7/16/6b4d586c984b4cbf8c5680352b9eaeb0)

Kommentar (0)