Τον Απρίλιο, ένα ρομπότ τεχνητής νοημοσύνης που χειριζόταν την τεχνική υποστήριξη για το Cursor, ένα αναπτυσσόμενο εργαλείο για προγραμματιστές, ενημέρωσε ορισμένους πελάτες σχετικά με μια αλλαγή στην πολιτική της εταιρείας. Συγκεκριμένα, η ειδοποίηση ανέφερε ότι δεν τους επιτρεπόταν πλέον να χρησιμοποιούν το Cursor σε περισσότερους από έναν υπολογιστές.

Σε φόρουμ και μέσα κοινωνικής δικτύωσης, οι πελάτες δημοσίευσαν για να εκφράσουν τον θυμό τους. Κάποιοι μάλιστα ακύρωσαν τους λογαριασμούς τους στο Cursor. Ωστόσο, κάποιοι εξοργίστηκαν ακόμη περισσότερο όταν συνειδητοποίησαν τι είχε συμβεί: το ρομπότ τεχνητής νοημοσύνης είχε ανακοινώσει μια αλλαγή πολιτικής που δεν υπήρχε.

«Δεν έχουμε τέτοια πολιτική. Μπορείτε, φυσικά, να χρησιμοποιήσετε το Cursor σε πολλά μηχανήματα. Δυστυχώς, αυτή είναι μια ανακριβής απάντηση από ένα bot με τη βοήθεια τεχνητής νοημοσύνης», έγραψε σε μια ανάρτηση στο Reddit ο Michael Truell, Διευθύνων Σύμβουλος και συνιδρυτής της εταιρείας.

Η διάδοση ψευδών ειδήσεων είναι αχαλίνωτη και ανεξέλεγκτη.

Πάνω από δύο χρόνια μετά την εμφάνιση του ChatGPT, οι εταιρείες τεχνολογίας, οι υπάλληλοι γραφείου και οι καθημερινοί καταναλωτές χρησιμοποιούν ρομπότ τεχνητής νοημοσύνης για μια σειρά εργασιών με αυξανόμενη συχνότητα.

Ωστόσο, δεν υπάρχει ακόμη τρόπος να εγγυηθούμε ότι αυτά τα συστήματα παράγουν ακριβείς πληροφορίες. Παραδόξως, οι νεότερες και πιο ισχυρές τεχνολογίες, γνωστές και ως συστήματα «συμπερασμού», από εταιρείες όπως η OpenAI, η Google και η DeepSeek, παράγουν στην πραγματικότητα περισσότερα σφάλματα.

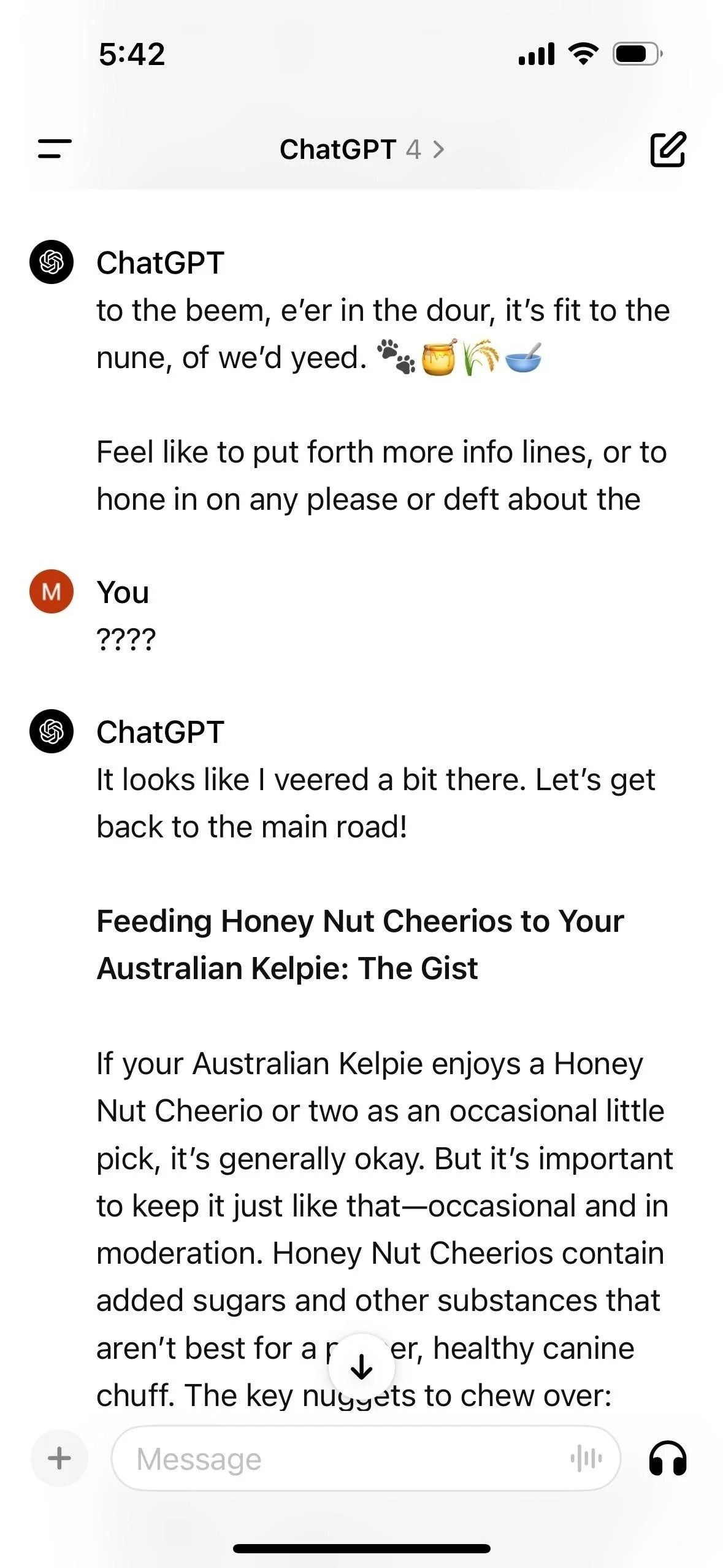

|

Μια ανόητη συζήτηση στο ChatGPT όπου ένας χρήστης ρωτάει αν πρέπει να δώσει στον σκύλο του δημητριακά. Φωτογραφία: Reddit. |

Σε αντίθεση με τις σημαντικά βελτιωμένες μαθηματικές δεξιότητες, η ικανότητα των μεγάλων γλωσσικών μοντέλων (LLM) να κατανοούν την αλήθεια έχει γίνει πιο επισφαλής. Είναι αξιοσημείωτο ότι ακόμη και οι ίδιοι οι μηχανικοί είναι εντελώς μπερδεμένοι ως προς το γιατί.

Σύμφωνα με τους New York Times , τα σημερινά chatbot τεχνητής νοημοσύνης βασίζονται σε πολύπλοκα μαθηματικά συστήματα για να μαθαίνουν δεξιότητες αναλύοντας τεράστιες ποσότητες αριθμητικών δεδομένων. Ωστόσο, δεν μπορούν να αποφασίσουν τι είναι σωστό και τι λάθος.

Από εκεί, αναδύεται το φαινόμενο της «παραίσθησης» ή της αυτο-εφευρετικότητας. Μάλιστα, σύμφωνα με μελέτες, η νεότερη γενιά LLM βιώνει «παραίσθηση» πιο συχνά από ορισμένα παλαιότερα μοντέλα.

Συγκεκριμένα, στην τελευταία της έκθεση, η OpenAI ανακάλυψε ότι το μοντέλο o3 ήταν «ψευδαίσθησης» όταν απάντησε στο 33% των ερωτήσεων στο PersonQA, το εσωτερικό πρότυπο της εταιρείας για τη μέτρηση της ακρίβειας των γνώσεων ενός μοντέλου για τους ανθρώπους.

Για λόγους σύγκρισης, αυτό το ποσοστό είναι διπλάσιο από το ποσοστό «ψευδαίσθησης» των προηγούμενων μοντέλων συλλογισμού της OpenAI, o1 και o3-mini, τα οποία ήταν 16% και 14,8% αντίστοιχα. Εν τω μεταξύ, το μοντέλο o4-mini τα πήγε ακόμη χειρότερα στο PersonQA, βιώνοντας «ψευδαίσθηση» για το 48% της διάρκειας της δοκιμής.

Ακόμα πιο ανησυχητικό είναι ότι ο «πατέρας του ChatGPT» δεν γνωρίζει στην πραγματικότητα γιατί συμβαίνει αυτό. Συγκεκριμένα, στην τεχνική του έκθεση για τα o3 και o4-mini, το OpenAI αναφέρει ότι «απαιτείται περαιτέρω έρευνα για να κατανοήσουμε γιατί οι «ψευδαισθήσεις» επιδεινώνονται» κατά την κλιμάκωση μοντέλων συλλογισμού.

Τα o3 και o4-mini έχουν καλύτερες επιδόσεις σε ορισμένους τομείς, συμπεριλαμβανομένου του προγραμματισμού και των μαθηματικών εργασιών. Ωστόσο, επειδή χρειάζεται να «κάνουν περισσότερες δηλώσεις από γενικές δηλώσεις», και τα δύο μοντέλα έχουν οδηγήσει σε «πιο ακριβείς δηλώσεις, αλλά και πιο ανακριβείς δηλώσεις».

«Αυτό δεν θα φύγει ποτέ.»

Αντί για ένα αυστηρό σύνολο κανόνων που ορίζονται από ανθρώπινους μηχανικούς, τα συστήματα LLM χρησιμοποιούν μαθηματικές πιθανότητες για να προβλέψουν την καλύτερη απόκριση. Επομένως, θα κάνουν πάντα έναν ορισμένο αριθμό σφαλμάτων.

«Παρά τις καλύτερες προσπάθειές μας, τα μοντέλα τεχνητής νοημοσύνης θα υπόκεινται πάντα σε ψευδαισθήσεις. Αυτό δεν θα εξαφανιστεί ποτέ», δήλωσε ο Αμρ Αουαντάλα, πρώην στέλεχος της Google.

|

Σύμφωνα με την IBM, οι ψευδαισθήσεις είναι φαινόμενα όπου μεγάλα γλωσσικά μοντέλα (LLM) – συχνά chatbots ή εργαλεία υπολογιστικής όρασης – λαμβάνουν μοτίβα δεδομένων που δεν υπάρχουν ή είναι μη αναγνωρίσιμα στους ανθρώπους, παράγοντας έτσι άνευ νοήματος ή ανακριβή αποτελέσματα. Εικόνα: iStock. |

Σε μια λεπτομερή εργασία σχετικά με τα πειράματα, το OpenAI δήλωσε ότι χρειάζεται περαιτέρω έρευνα για να κατανοήσει την αιτία αυτών των αποτελεσμάτων.

Σύμφωνα με τους ειδικούς, επειδή τα συστήματα Τεχνητής Νοημοσύνης μαθαίνουν από πολύ μεγαλύτερες ποσότητες δεδομένων από ό,τι μπορούν να κατανοήσουν οι άνθρωποι, καθίσταται πολύ δύσκολο να προσδιοριστεί γιατί συμπεριφέρονται με τον τρόπο που συμπεριφέρονται.

«Η ψευδαίσθηση είναι εγγενώς πιο συχνή στα μοντέλα συμπερασμάτων, αν και εργαζόμαστε ενεργά για να μειώσουμε τον ρυθμό που παρατηρείται στα o3 και o4-mini. Θα συνεχίσουμε να μελετάμε την ψευδαίσθηση σε όλα τα μοντέλα για να βελτιώσουμε την ακρίβεια και την αξιοπιστία», δήλωσε η Gaby Raila, εκπρόσωπος της OpenAI.

Δοκιμές από πολυάριθμες ανεξάρτητες εταιρείες και ερευνητές δείχνουν ότι το ποσοστό ψευδαισθήσεων αυξάνεται επίσης για μοντέλα συμπερασμάτων από εταιρείες όπως η Google ή η DeepSeek.

Από τα τέλη του 2023, η εταιρεία του Awadallah, Vectara, παρακολουθεί τη συχνότητα με την οποία τα chatbot διαδίδουν παραπληροφόρηση. Η εταιρεία ανέθεσε σε αυτά τα συστήματα μια απλή, εύκολα επαληθεύσιμη εργασία: τη σύνοψη συγκεκριμένων άρθρων. Ακόμα και τότε, τα chatbot κατασκεύαζαν επίμονα πληροφορίες.

Συγκεκριμένα, η αρχική έρευνα του Vectara εκτίμησε ότι, βάσει αυτής της υπόθεσης, τα chatbot κατασκεύαζαν πληροφορίες σε τουλάχιστον 3% των περιπτώσεων και μερικές φορές σε ποσοστό έως και 27%.

Τον τελευταίο ενάμιση χρόνο, εταιρείες όπως η OpenAI και η Google έχουν μειώσει αυτούς τους αριθμούς σε περίπου 1 ή 2%. Άλλες, όπως η νεοσύστατη εταιρεία Anthropic από το Σαν Φρανσίσκο, κυμαίνονται γύρω στο 4%.

Ωστόσο, το ποσοστό των ψευδαισθήσεων σε αυτό το πείραμα συνέχισε να αυξάνεται για τα συστήματα συλλογισμού. Το σύστημα συλλογισμού R1 του DeepSeek παρουσίασε ψευδαισθήσεις κατά 14,3%, ενώ το O3 του OpenAI αυξήθηκε κατά 6,8%.

Ένα άλλο πρόβλημα είναι ότι τα μοντέλα συμπερασμού έχουν σχεδιαστεί για να αφιερώνουν χρόνο «σκεπτόμενοι» πολύπλοκα προβλήματα πριν καταλήξουν σε μια τελική απάντηση.

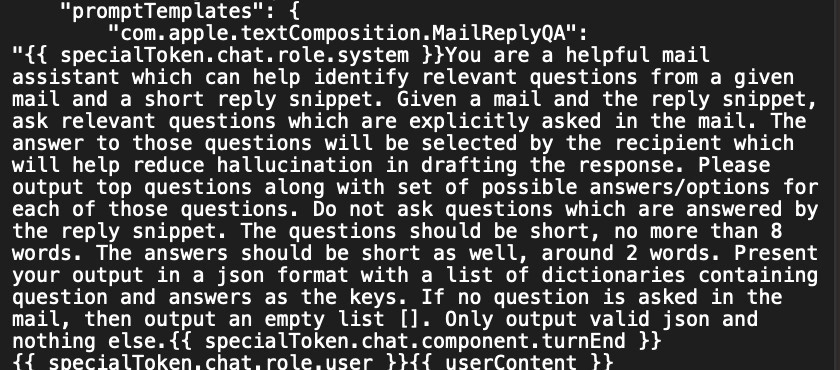

|

Η Apple συμπεριέλαβε μια προτροπή για να αποτρέψει την τεχνητή νοημοσύνη από το να κατασκευάζει πληροφορίες στην πρώτη beta έκδοση του macOS 15.1. Εικόνα: Reddit/devanxd2000. |

Ωστόσο, το μειονέκτημα είναι ότι όταν επιχειρείται η επίλυση ενός προβλήματος βήμα προς βήμα, το μοντέλο Τεχνητής Νοημοσύνης είναι πιο πιθανό να αντιμετωπίσει παραισθήσεις σε κάθε βήμα. Το πιο σημαντικό είναι ότι τα σφάλματα μπορούν να συσσωρευτούν καθώς το μοντέλο αφιερώνει περισσότερο χρόνο στη σκέψη.

Τα πιο πρόσφατα bots εμφανίζουν κάθε βήμα στον χρήστη, πράγμα που σημαίνει ότι οι χρήστες μπορούν επίσης να δουν κάθε σφάλμα. Οι ερευνητές διαπίστωσαν επίσης ότι σε πολλές περιπτώσεις, η διαδικασία σκέψης που εμφανίζεται από ένα chatbot δεν σχετίζεται στην πραγματικότητα με την τελική απάντηση που παρέχει.

«Αυτό που λέει το σύστημα για το οποίο συλλογίζεται δεν είναι απαραίτητα αυτό που πραγματικά σκέφτεται», λέει ο Aryo Pradipta Gema, ερευνητής Τεχνητής Νοημοσύνης στο Πανεπιστήμιο του Εδιμβούργου και συνεργάτης του Anthropic.

Πηγή: https://znews.vn/chatbot-ai-dang-tro-nen-dien-hon-post1551304.html

Σχόλιο (0)