Το Τμήμα Ασφάλειας Πληροφοριών εξέδωσε πρόσφατα προειδοποίηση σχετικά με τη συνεχιζόμενη επανεμφάνιση απάτης βίντεο και εικόνας υψηλής τεχνολογίας.

Συνεπώς, η κατάσταση των κυβερνοεγκληματιών που εκμεταλλεύονται δημόσιες εικόνες και βίντεο ανθρώπων για να επεξεργάζονται, να κόβουν και να απειλούν να εκβιάσουν με ψεύτικα βίντεο έχει προειδοποιηθεί ευρέως από τις αρχές σε μεγάλο αριθμό ανθρώπων.

Χρησιμοποιώντας την τεχνολογία Deepfake που επιτρέπει την αναπαραγωγή του ήχου και της εικόνας ενός ατόμου με υψηλή ακρίβεια, οι εγκληματίες μπορούν να μιμηθούν τους ηγέτες σε διαδικτυακές συναντήσεις ή να δημιουργήσουν βίντεο και κλήσεις για να διαπράξουν οικονομική απάτη.

Επιπλέον, αυτές οι απάτες συχνά εκμεταλλεύονται ψυχολογικούς παράγοντες όπως η επείγουσα ανάγκη, ο φόβος ή η εξουσία, αναγκάζοντας τα θύματα να ενεργούν βιαστικά χωρίς να ελέγχουν προσεκτικά την αυθεντικότητα.

Τα deepfakes δεν περιορίζονται σε απάτες οικονομικών επενδύσεων. Ένα άλλο παράδειγμα είναι οι απάτες ρομαντικών ειδήσεων, όπου τα Deepfakes χρησιμοποιούνται για τη δημιουργία φανταστικών χαρακτήρων που αλληλεπιδρούν με τα θύματα μέσω βιντεοκλήσεων. Αφού κερδίσει την εμπιστοσύνη του θύματος, ο απατεώνας θα ζητήσει μεταφορές χρημάτων για την επίλυση έκτακτων περιστατικών, εξόδων ταξιδιού ή δανείων.

Υπό το πρίσμα της παραπάνω κατάστασης, το Τμήμα Ασφάλειας Πληροφοριών συνιστά στους ανθρώπους να είναι επιφυλακτικοί με τις επενδυτικές συμβουλές από διασημότητες στα μέσα κοινωνικής δικτύωσης, να είναι επιφυλακτικοί με άγνωστα μηνύματα, email ή κλήσεις και να παρατηρούν προσεκτικά τις αφύσικες εκφράσεις του προσώπου στα βίντεο.

Οι χρήστες πρέπει επίσης να περιορίσουν την ανάρτηση περιεχομένου που σχετίζεται με προσωπικά στοιχεία στα κοινωνικά δίκτυα, για να αποφύγουν την κλοπή πληροφοριών όπως εικόνες, βίντεο ή φωνές από κακοποιούς. Ταυτόχρονα, να ορίσουν τους λογαριασμούς σε ιδιωτική λειτουργία για την προστασία των προσωπικών πληροφοριών.

Μιλώντας σε δημοσιογράφους της εφημερίδας Dai Doan Ket, ο ειδικός σε θέματα κυβερνοασφάλειας Ngo Minh Hieu, συνιδρυτής του Vietnam Cyber Fraud Prevention Project (Chongluadao.vn), δήλωσε ότι η χρήση της τεχνολογίας Deepfake στην Τεχνητή Νοημοσύνη για την πραγματοποίηση πλαστών βιντεοκλήσεων για σκοπούς απάτης εξακολουθεί να είναι περίπλοκη. Τα υποκείμενα εκμεταλλεύονται αυτήν την τεχνολογία για να αυξήσουν την αξιοπιστία του «θηράματός» τους.

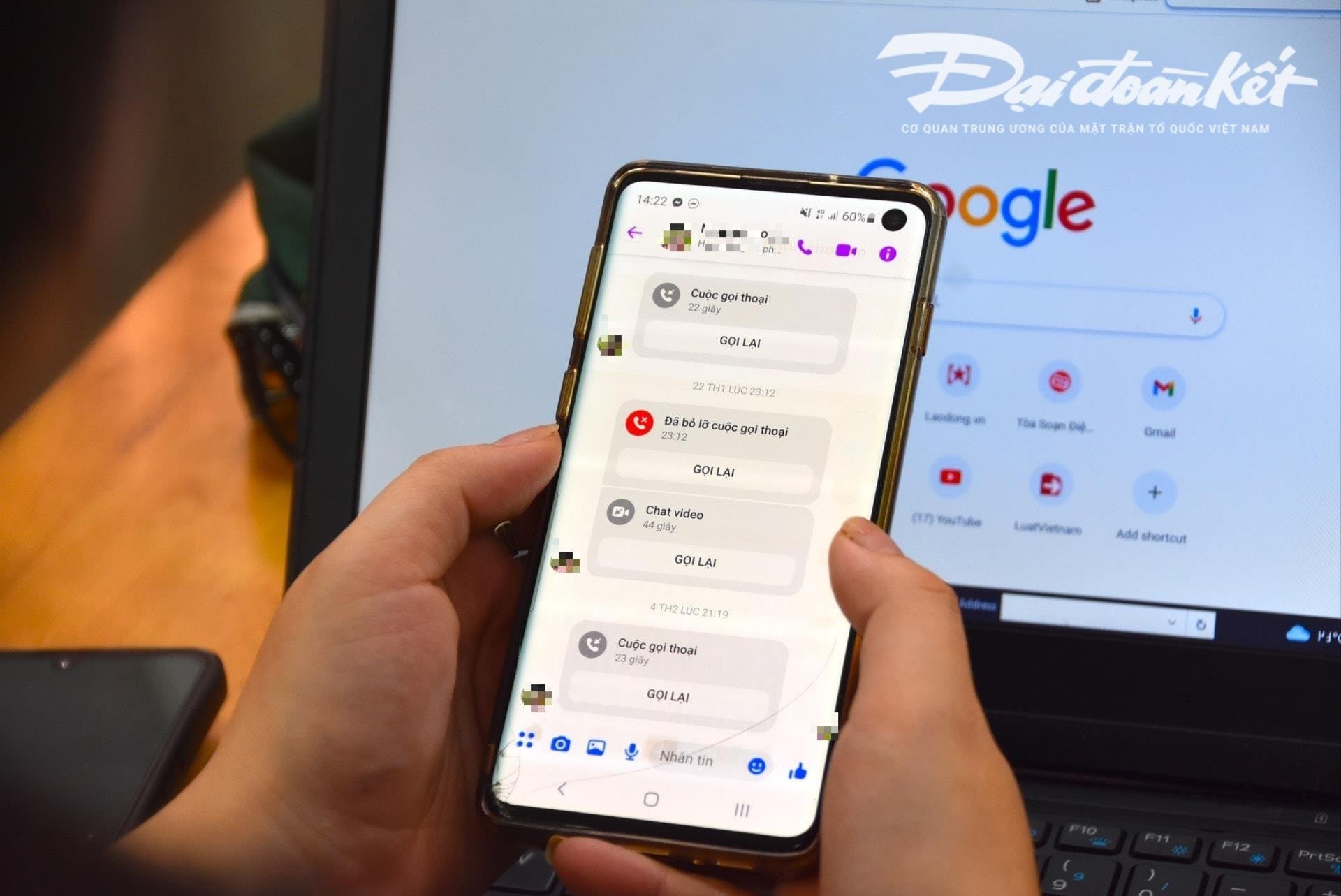

Συγκεκριμένα, τα υποκείμενα θα πραγματοποιούν προληπτικά βιντεοκλήσεις στα θύματα από προηγουμένως «κλεμμένες» εικόνες και βίντεο και θα χειραγωγούν την τεχνική, θα παραμορφώνουν τον ήχο ή θα δημιουργούν προβλήματα με ψεύτικες εικόνες για να κερδίσουν την εμπιστοσύνη του θύματος.

Συνήθως, αυτές οι κλήσεις είναι πολύ σύντομες, διαρκούν μόνο λίγα δευτερόλεπτα, και στη συνέχεια χρησιμοποιούν τη δικαιολογία του ασταθούς δικτύου, του να βρίσκονται στο δρόμο κ.λπ. για να ζητήσουν από το θύμα να ικανοποιήσει τα αιτήματα του απατεώνα.

Οι ειδικοί προειδοποιούν ότι η χρήση της Τεχνητής Νοημοσύνης για κυβερνοαπάτες πιθανότατα θα αυξηθεί σημαντικά στο εγγύς μέλλον. Επομένως, οι άνθρωποι πρέπει να αυξήσουν προληπτικά την επαγρύπνησή τους, ειδικά όταν λαμβάνουν παράξενα μηνύματα, βιντεοκλήσεις και συνδέσμους.

Σύμφωνα με την ανάλυση αυτού του ειδικού, ο τρέχων αλγόριθμος τεχνητής νοημοσύνης (AI) Deepfake κατά τη διάρκεια κλήσεων σε πραγματικό χρόνο δεν θα είναι σε θέση να το χειριστεί εάν ο καλών στρίψει αριστερά, δεξιά ή σηκωθεί...

Μια ιδιαίτερη αδυναμία στην οποία πρέπει να δώσουν προσοχή οι άνθρωποι όταν λαμβάνουν αυτές τις κλήσεις είναι τα δόντια. Συνεπώς, οι τρέχοντες αλγόριθμοι τεχνητής νοημοσύνης δεν μπορούν να αναπαράγουν τα δόντια του ατόμου που μιμείται.

Εάν χρησιμοποιείτε Deepfake, η εικόνα του ατόμου που ανοίγει το στόμα του μπορεί να μην έχει δόντια, ενώ κάποιοι άνθρωποι μπορεί να έχουν 3 ή ακόμα και 4 γνάθους. Επομένως, τα χαρακτηριστικά των δοντιών είναι το πιο αναγνωρίσιμο στοιχείο μιας ψεύτικης κλήσης χρησιμοποιώντας Deepfake.

Η «επιβράδυνση» και η μη άμεση τήρηση του αιτήματος είναι απαραίτητη προϋπόθεση για να αποφευχθεί η πτώση στην παγίδα της απάτης. Όταν λαμβάνουν οποιοδήποτε μήνυμα ή κλήση μέσω κοινωνικών δικτύων, οι άνθρωποι πρέπει να καλέσουν απευθείας τους συγγενείς τους για να επαληθεύσουν ακριβώς ποιος επικοινωνεί μαζί τους με ελάχιστο χρόνο άνω των 30 δευτερολέπτων ή να συναντηθούν αυτοπροσώπως.

Σε περίπτωση υποψίας πλαστοπροσωπίας συγγενών στα μέσα κοινωνικής δικτύωσης με σκοπό την εξαπάτηση ή την ιδιοποίηση περιουσίας, είναι απαραίτητο να αναφερθείτε αμέσως στην πλησιέστερη αστυνομική υπηρεσία για έγκαιρη υποστήριξη και διεκπεραίωση.

[διαφήμιση_2]

Πηγή: https://daidoanket.vn/chuyen-gia-chi-meo-nhan-biet-cuoc-goi-deepfake-lua-dao-10300910.html

![[INFOGRAPHIC] Πορτρέτο του νεοεκλεγέντα Προέδρου του Καμερούν σε ηλικία 92 ετών](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/11/08/1762560057791_info-tongthong-cameroon-anh-thumb-jpg.webp)

![[Βίντεο] Τα μνημεία του Χουέ ανοίγουν ξανά για να υποδεχτούν τους επισκέπτες](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/11/05/1762301089171_dung01-05-43-09still013-jpg.webp)

Σχόλιο (0)