Deepfakes de IA, secuencias de videojuegos camufladas como escenas de combate reales y desinformación generada por chatbots: todas estas formas de desinformación tecnológica están distorsionando gravemente el conflicto entre Israel e Irán. Están alimentando una guerra narrativa en las redes sociales que distorsiona la realidad.

La guerra de información, que se desarrolla en paralelo a los enfrentamientos sobre el terreno (desencadenados por los ataques israelíes a las instalaciones nucleares y al liderazgo militar de Irán) ha expuesto una profunda crisis digital en una era de herramientas de inteligencia artificial en rápida evolución que desdibujan la línea entre la verdad y la invención.

Los expertos afirman que el auge de la desinformación en los conflictos ha puesto de relieve la urgente necesidad de herramientas de detección y verificación más robustas. Resulta preocupante que las principales plataformas tecnológicas estén flexibilizando estas medidas de seguridad al reducir la moderación de contenido y la dependencia de los verificadores de datos.

En declaraciones a la prensa, Ken Jon Miyachi, fundador de BitMindAI, con sede en Austin, afirmó que el mundo está presenciando un aumento de la desinformación generada por IA, especialmente en relación con el conflicto entre Irán e Israel. Estas herramientas se utilizan para manipular la percepción pública, a menudo amplificando narrativas divisivas o falsas con una escala y sofisticación sin precedentes.

GetReal Security, empresa estadounidense especializada en detectar medios manipulados, también ha identificado una ola de vídeos falsos relacionados con el conflicto entre Israel e Irán.

La empresa vincula los videos altamente visuales, que muestran escenas horrorosas de aviones y edificios israelíes dañados por el conflicto, así como misiles iraníes montados en remolques, con el generador de inteligencia artificial Veo 3 de Google, conocido por su capacidad para crear imágenes hiperrealistas.

Hany Farid, cofundador de GetReal Security y profesor de la Universidad de California en Berkeley (EE. UU.), compartió un pequeño consejo para identificar imágenes falsas creadas por IA: los videos de Veo 3 suelen tener una duración de 8 segundos o una combinación de clips de duración similar.

“Este límite de ocho segundos obviamente no prueba que un video sea falso, pero debería ser una buena razón para detenerse y verificar la información antes de compartirlo”, enfatizó.

Según el Sr. Miyachi, experto de BitMindAI, la situación actual de difusión de contenidos falsos y falsificados en Internet refleja una crisis más profunda: la erosión de la confianza en la información digital.

Ante esta situación, enfatizó la necesidad de desarrollar herramientas más efectivas para detectar contenidos falsos, mejorar la alfabetización mediática en la sociedad y promover el rol responsable de las plataformas tecnológicas en el mantenimiento de la transparencia y la salud de las discusiones públicas.

Fuente: https://www.vietnamplus.vn/ai-lam-nhieu-loan-thong-tin-ve-cuoc-xung-dot-israel-iran-nhu-the-nao-post1045593.vnp

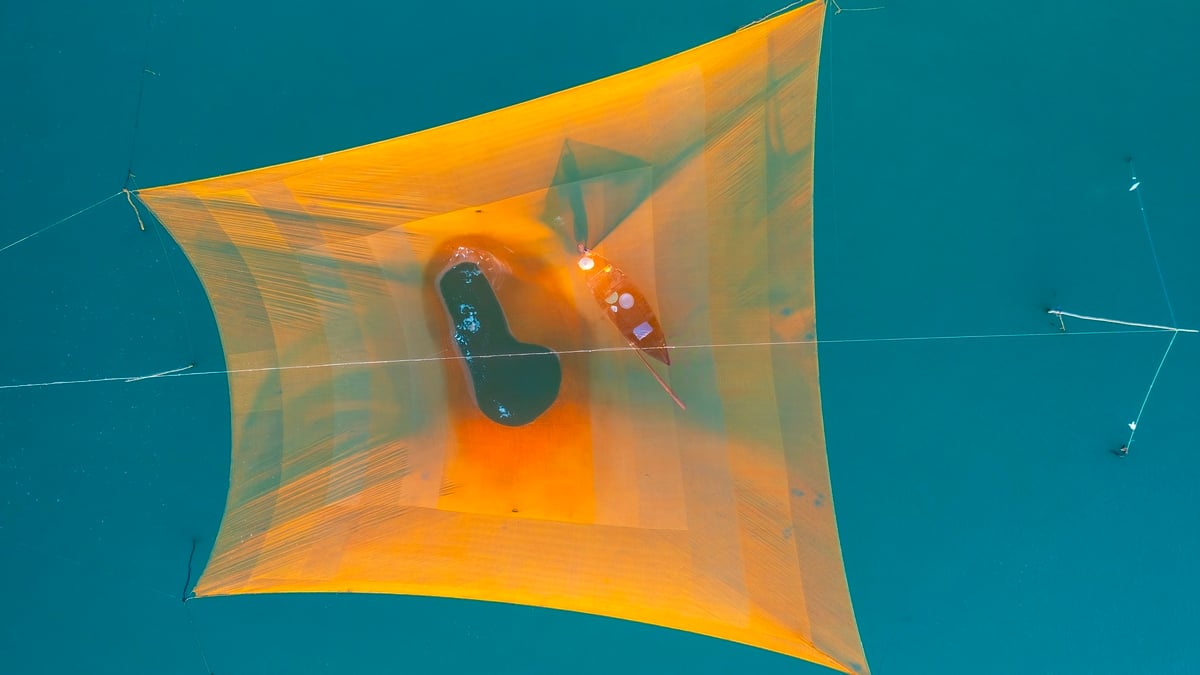

![[Foto] Descubre la "maravilla" bajo el mar de Gia Lai](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/8/6/befd4a58bb1245419e86ebe353525f97)

![[Foto] Nghe An: La carretera provincial 543D está gravemente erosionada debido a las inundaciones.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/8/5/5759d3837c26428799f6d929fa274493)

Kommentar (0)