El 2 de febrero, el Sr. Nguyen Tien Dat, Director General del Centro de Investigación AntiMalware de Bkav, afirmó que incluso si realizas una videollamada y ves la cara de un familiar o amigo y escuchas su voz, no significa necesariamente que estés hablando con esa persona.

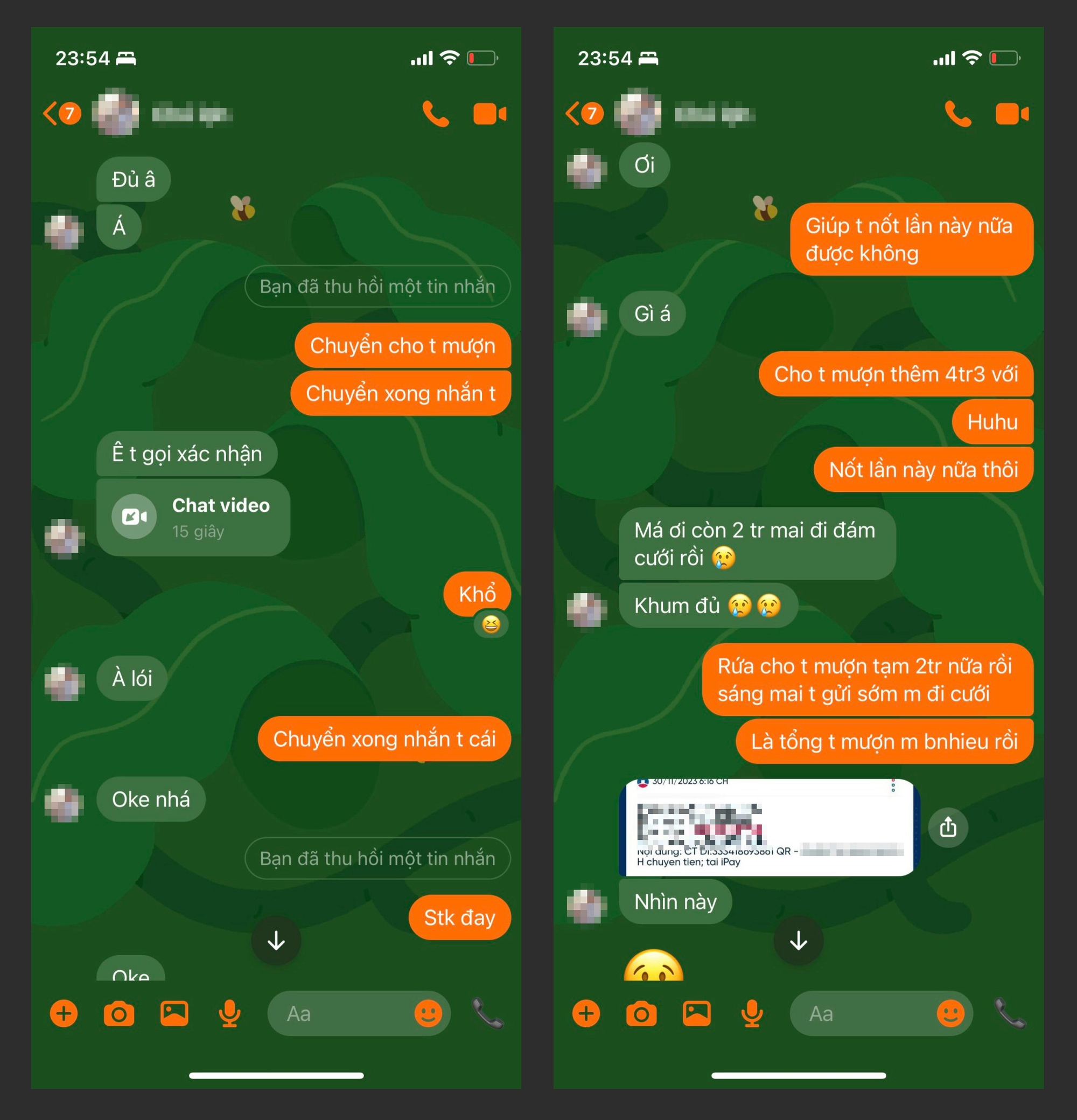

Nguyen Thanh Huong (nombre ficticio) trabaja como oficinista en Hanói . Durante una conversación con un amigo por Facebook Messenger, este se despidió y terminó la conversación, pero de repente le respondió pidiendo dinero prestado y solicitando que se transfiriera a una cuenta bancaria.

Aunque el nombre de la cuenta coincidía con el de su amiga, Huong aún tenía una ligera sospecha y solicitó una videollamada para verificarlo. Su amiga accedió de inmediato, pero la llamada solo duró unos segundos debido a una "conexión a internet inestable", según su explicación. Tras ver la cara de su amiga en la videollamada y escuchar la voz correcta, Huong dejó de dudar y transfirió el dinero. Sin embargo, solo después de la transferencia exitosa se dio cuenta de que había caído en la trampa de un hacker.

Muchas personas han sido víctimas recientemente de estafas financieras que utilizan tecnología Deepfake e involucran IA (Inteligencia Artificial).

Huong no fue la única víctima; muchas otras víctimas, incluyendo a sus amigos y familiares, también fueron estafadas de forma similar. La cantidad de dinero que los estafadores obtuvieron de este tipo de cuentas de Facebook alcanzó decenas de millones de VND.

Durante la segunda mitad de 2023, Bkav recibió continuamente denuncias y solicitudes de ayuda de víctimas relacionadas con estafas similares. Según los expertos de Bkav, en el caso de Huong, el agresor obtuvo el control de su cuenta de Facebook, pero no lo tomó por completo de inmediato. En cambio, la vigiló en secreto, esperando la oportunidad de hacerse pasar por la víctima y pedir préstamos a sus amigos y familiares.

Usan IA para crear un video falso que imita el rostro y la voz del propietario de la cuenta de Facebook (Deepfake). Cuando se les pide que hagan una videollamada para verificar la identidad, aceptan, pero se desconectan rápidamente para evitar ser detectados.

Según el Sr. Nguyen Tien Dat, del Centro de Investigación Antimalware de Bkav, la capacidad de recopilar y analizar datos de usuarios mediante IA permite la creación de sofisticadas estrategias de phishing. Esto también significa que la complejidad de los escenarios de phishing que combinan deepfake y GPT aumentará, dificultando su identificación.

Bkav recomienda a los usuarios estar especialmente atentos, no facilitar información personal (número de documento de identidad, datos de cuentas bancarias, códigos OTP, etc.) y no transferir dinero a desconocidos a través del teléfono, redes sociales o sitios web con características fraudulentas.

Al recibir solicitudes de préstamos/transferencias de dinero a través de las redes sociales, es recomendable utilizar métodos de verificación alternativos, como llamadas telefónicas u otros canales de comunicación para confirmar los detalles.

[anuncio_2]

Fuente: https://nld.com.vn/canh-bao-su-dung-ai-tao-hinh-anh-va-giong-noi-gia-mao-de-lua-tien-196240202191252818.htm

![[Foto] El primer ministro Pham Minh Chinh asiste a la Conferencia sobre la Implementación de Tareas para 2026 del Sector de Industria y Comercio.](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F19%2F1766159500458_ndo_br_shared31-jpg.webp&w=3840&q=75)

![[INFOGRAFÍA] Legion Go Gen 2 establece un nuevo estándar para los juegos.](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/12/19/1766146888809_info-taycamgames-02-jpg.webp)

Kommentar (0)