دکتر لی دوی تان، مدرس دانشکده فناوری اطلاعات، دانشگاه بینالمللی، دانشگاه ملی ویتنام، شهر هوشی مین، و از بنیانگذاران آزمایشگاه هوش مصنوعی اینترنت اشیا ویتنام (AIoT Lab VN)، گفت که استفاده از هوش مصنوعی توسط دانشجویان برای پشتیبانی از مطالعات، تکالیف، گزارشها و پایاننامههایشان یک روند رایج در سراسر جهان است.

طبق یک نظرسنجی جهانی در سال ۲۰۲۴ توسط شورای آموزش دیجیتال، تقریباً ۸۶٪ از دانشآموزان گزارش دادهاند که در مطالعات خود از ابزارهای هوش مصنوعی استفاده میکنند؛ از این تعداد، حدود ۵۴٪ به صورت هفتگی از آنها استفاده میکنند. یک نظرسنجی در ژوئن ۲۰۲۵ توسط Save My Exams نیز نشان داد که ۷۵٪ از دانشآموزان از هوش مصنوعی برای انجام تکالیف خود استفاده میکنند که ۲۴٪ روزانه و ۴۴٪ هفتگی از آن استفاده میکنند.

استفاده از هوش مصنوعی توسط دانشآموزان برای پشتیبانی از یادگیری و تحقیق آنها به طور فزایندهای رایج شده است.

عکس: NGOC لانگ

در کنار جنبههای مثبت، اجتنابناپذیر است که برخی از دانشآموزان از ابزارهای هوش مصنوعی سوءاستفاده کنند.

استفاده از هوش مصنوعی برای پنهان کردن هوش مصنوعی

به گفته دکتر لی دوی تان، برخی از دانشجویان بدون درک کامل از نحوه کار و محدودیتهای هوش مصنوعی، از آن برای انجام تکالیف، گزارشها و پایاننامهها استفاده میکنند. این امر باعث میشود که آنها به تدریج تواناییهای تفکر انتقادی، مهارتهای نوشتاری و مهارتهای تحقیق مستقل خود را از دست بدهند.

دکتر دین نگوک تان، مدیر فنی OpenEdu، در یک برنامه آنلاین به میزبانی روزنامه Thanh Nien ، اظهار داشت که بسیاری از دانشآموزان به جای مطالعه مستقل، از ابزارهایی مانند ChatGPT برای حل مسائل تکالیف استفاده میکنند که منجر به یک تجربه یادگیری "آسانتر" میشود. با این حال، این یک رویکرد خطرناک است که خلاف اصول آموزشی است، زیرا هدف آموزش فقط تکمیل تکالیف نیست، بلکه پرورش تفکر انتقادی و مهارتهای حل مسئله است.

آقای فام تان آنه وو، رئیس دفتر نمایندگی منطقه جنوبی شرکت راهکارهای هوش مصنوعی ویتنام (VAIS)، اظهار داشت که از سال ۲۰۲۲ تا ۲۰۲۴، متون تولید شده توسط هوش مصنوعی اغلب دارای «اثر انگشت دیجیتال» قابل تشخیص هستند. سبک نوشتاری یکنواخت، فاقد احساس است و ساختارهای آشنایی مانند «نه تنها… بلکه همچنین…» را تکرار میکند، با عبارات انتقالی فرمولی مانند «علاوه بر این»، «علاوه بر این» و همیشه با یک «به طور خلاصه» اجباری به پایان میرسد. محتوا بیعیب و نقص و با املای بینقص است و تمایل به فهرست کردن موارد با استفاده از نقاط گلولهای، همگی نشانگر تأثیر هوش مصنوعی هستند.

یک نقطه ضعف جدیتر در محتوای تولید شده توسط هوش مصنوعی نهفته است. این پدیده «توهم» است، جایی که هوش مصنوعی اطلاعات، دادهها یا حتی منابعی را که وجود ندارند، جعل میکند. آقای وو اظهار داشت: «بسیاری از مقالات تولید شده توسط هوش مصنوعی مانند مجموعهای از قطعات کد مختلف هستند که منجر به سبک نوشتاری متناقض و پاراگرافهای غیرمنطقی میشود.»

تا سال ۲۰۲۵، برای غلبه بر ابزارهای تشخیص سرقت ادبی مبتنی بر هوش مصنوعی، دانشآموزان به طور فزایندهای پیچیدهتر خواهند شد. یک صنعت فناوری جدید ظهور کرده است: ابزارهای شخصیتبخشی متن مبتنی بر هوش مصنوعی.

دانشآموزان فرآیندی را ایجاد کردند: استفاده از ChatGPT برای پیشنویس، انتقال به Quillbot برای بازنویسی و در نهایت استفاده از ابزارهای «شخصیتسازی» مانند Undetectable AI برای پاک کردن تمام ردپاها. برخی از دانشآموزان حتی عمداً خطاهای کوچکی اضافه میکردند تا متن «طبیعیتر» به نظر برسد.

آقای وو اظهار داشت: «در حال حاضر، تشخیص اینکه آیا یک مقاله از هوش مصنوعی استفاده میکند یا خیر و مقایسه آن با مقالهای که کاملاً توسط یک دانشآموز نوشته شده است، احتمالاً غیرممکن است زیرا انسانها از ترفندهای پیچیده زیادی برای فریب دادن ماشینها و معلمان هنگام نمرهدهی به برگهها استفاده کردهاند.»

از همین منظر، دکتر لو دوی تان استدلال میکند که مقالاتی که «بیش از حد تمیز»، عاری از غلطهای املایی، فاقد تجربه یا شواهد شخصی و با سبک نوشتاری یکنواخت هستند، بسیار مشکوک هستند.

وقتی زبانآموزان از هوش مصنوعی برای تکالیف، آزمونها، تحقیقات و غیره استفاده میکنند، برای مربیان بسیار دشوار است که تواناییهای واقعی دانشآموزان را به طور دقیق ارزیابی کنند.

عکس: TN با استفاده از هوش مصنوعی ایجاد شده است

شکاف بین «صلاحیت مجازی» و مهارتهای واقعی.

به گفته کارشناسان، سوءاستفاده دانشآموزان از هوش مصنوعی فقط تقلب نیست؛ بلکه پایه و اساس آموزش را تضعیف میکند.

آقای فام تان آنه وو بزرگترین نگرانی خود را اینگونه بیان کرد: خطر کاهش تواناییهای تفکر مستقل و انتقادی دانشآموزان توسط هوش مصنوعی. زیرا وقتی آنها به حل مسائل با دریافت پاسخهای فوری از هوش مصنوعی عادت کنند، به تدریج صبر خود را برای خواندن و درک اسناد اصلی یا ترکیب اطلاعات به تنهایی از دست میدهند.

آقای وو گفت: «همانطور که دانشیار دکتر نگوین چی تان، رئیس دانشکده آموزش دانشگاه آموزش و پرورش، دانشگاه ملی ویتنام ، هانوی ، زمانی در مورد خطر تبدیل شدن کاربران به «بردگان دیجیتال»، حالتی از وابستگی که سه توانایی قوی انسان را خفه میکند، هشدار داده بود: حل مسئله، خلاقیت و خودآموزی.»

خطرناکتر اینکه، هوش مصنوعی میتواند «توهم شایستگی» ایجاد کند. یک معلم ادبیات در شهر هوشی مین گفت که زمانی متوجه شده است که بسیاری از دانشآموزان از یک ابزار هوش مصنوعی برای انجام تکالیف خود استفاده میکنند، اما وقتی در مورد محتوا از آنها سوال میشود، نمیتوانند توضیح دهند که چه نوشتهاند. این نشان میدهد که شکاف رو به گسترش بین شایستگی ادراکشده و دانش دنیای واقعی، یک «بمب ساعتی» خواهد بود که آماده انفجار با فارغالتحصیلی و ورود دانشآموزان به بازار کار است.

این معلم تأکید کرد: «استفاده بیش از حد از هوش مصنوعی، روشهای سنتی ارزیابی را نیز بیاثر میکند. تکالیف درسی مانند انشا و گزارشهای گروهی که برای سنجش تواناییهای تحقیق و استدلال طراحی شده بودند، ناگهان بیمعنی میشوند و ارزیابی دقیق تواناییهای واقعی دانشآموزان را برای مدرسان بسیار دشوار میکنند.»

بنابراین، دکتر لی دوی تان معتقد است که مهمترین راه حل، طراحی مجدد روش ارزیابی است. تکالیف باید از دانشآموزان بخواهد که با یک طرح کلی شخصی شروع کنند، فرآیند کار خود را مستند کنند، تجربیات خود را تجزیه و تحلیل کنند، نحوه یافتن و تأیید اطلاعات را ارائه دهند، یا شامل یک جلسه پرسش و پاسخ مستقیم باشند. تحقیقات نشان میدهد که ارزیابیهایی که بر تحلیل، ارزیابی و خلاقیت متمرکز هستند، نه فقط خلاصهسازی، به کاهش وابستگی به هوش مصنوعی برای کل فرآیند کمک میکنند.

آقای وو گفت: «برای ارزیابی اینکه آیا یک دانشآموز در مورد مطالعات خود جدی است یا از هوش مصنوعی به طور مؤثر استفاده میکند، معلمان باید روشهای تدریس خود را با معرفی موضوع به دانشآموزان از طریق سه عنصر کلیدی تغییر دهند: دانستن واضح، درک محکم و درک عمیق. تنها در این صورت است که آنها میتوانند واقعاً قابلیتهای دانشآموزان را هنگام استفاده از ابزارهای هوش مصنوعی توسعه دهند.»

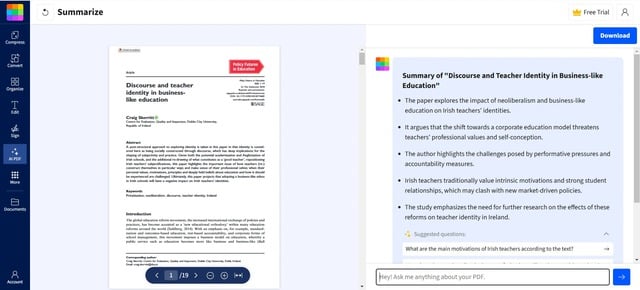

ابزارهای هوش مصنوعی به دانشجویان کمک میکنند تا بررسیهای تحقیقاتی انجام دهند، مقالات علمی را خلاصه کنند و موارد دیگر.

عکس: اسکرینشات

مرز بین کمک و کلاهبرداری

در زمینه تبدیل شدن هوش مصنوعی به ابزاری ضروری، این سوال که «آیا باید به دانشجویان اجازه استفاده از هوش مصنوعی داده شود؟» دیگر مطرح نیست. آنچه مهمتر است، تعریف مرزهای استفاده از هوش مصنوعی در دانشگاه است.

به گفته آقای فام تان آنه وو، این مرز در هدف، روش و نگرش نهفته است. هوش مصنوعی تنها زمانی ابزاری معقول است که برای تولید ایده، کمک به خلاصهسازی اسناد، بررسی خطاها یا توضیح اصطلاحات پیچیده استفاده شود. دانشجویان باید «خوانندگان کندی» باشند، اطلاعات را دوباره ارزیابی کنند و مسئولیت نهایی محتوا را بر عهده بگیرند. برعکس، اگر دانشجویان تمام یا بیشتر محتوای تولید شده توسط هوش مصنوعی را کلمه به کلمه کپی کنند و آن را به عنوان کار خود ارائه دهند، این یک کلاهبرداری دانشگاهی محسوب میشود.

آقای وو همچنین استدلال کرد که هوش مصنوعی باید به عنوان یک شایستگی اساسی برای دانشآموزان به رسمیت شناخته شود؛ به جای سرکوب آن، باید به رسمیت شناخته شود و استفاده از آن در برنامه آموزشی گنجانده شود.

دکتر دوی تان در مورد راهحلها پیشنهاد کرد که دانشگاهها و اساتید باید سیاستهایی را در مورد استفاده از هوش مصنوعی در دورهها، تکالیف و پایاننامهها تدوین و به وضوح اعلام کنند. به عنوان مثال، در تکلیف باید به وضوح ذکر شود: «دانشجویان مجاز به استفاده از ابزارهای هوش مصنوعی هستند/نیستند؛ در صورت استفاده، ابزارها باید به وضوح مشخص شوند، کدام بخشها توسط هوش مصنوعی پشتیبانی میشوند و کدام بخشها توسط دانشجو پشتیبانی میشوند»؛ دانشجویان باید در استفاده مسئولانه، اخلاقی و مؤثر از هوش مصنوعی آموزش ببینند، نه اینکه فقط بگویند «مجاز نیست» بلکه آنها را در مورد نحوه استفاده از هوش مصنوعی برای کمک به بررسی نتایج، تأیید دادهها، تجزیه و تحلیل و توسعه بیشتر ایدههای هوش مصنوعی راهنمایی کنند.

یک چارچوب قانونی مشترک در سطح ملی مورد نیاز است.

به گفته آقای فام تان آنه وو، تلاشهای پیشگامانه دانشگاهها بسیار مهم است، اما برای ایجاد تغییر هماهنگ، به یک آییننامه رفتاری و چارچوب قانونی مشترک در سطح ملی نیاز داریم. ما نمیتوانیم اجازه دهیم وضعیتی پیش بیاید که در آن یک عمل سوءاستفاده از هوش مصنوعی ممکن است تقلب تلقی شود و منجر به نمره صفر در یک دانشگاه شود، اما در دانشگاه دیگری پذیرفته شود.

ویتنام باید یک چارچوب قانونی شفاف بر اساس اصول اساسی ایجاد کند: پایبندی به قانون و اخلاق؛ انصاف و عدم تبعیض؛ شفافیت و پاسخگویی (چه کسی مسئول اشتباهات هوش مصنوعی است)؛ و یک رویکرد انسانمحور (انسانها همیشه کنترل نهایی را در دست دارند).

منبع: https://thanhnien.vn/sinh-vien-dung-thu-thuat-de-che-dau-ai-185251211185713308.htm

![[تصویر] سمفونی درخشان و قدرت انفجاری در آسمان دانانگ.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/05/31/1780196945787_anh-man-hinh-2026-05-31-luc-10-08-51.png)

![[ویدئو] غروب خورشید در تالاب لپ آن - جایی که خورشید بر فراز تورهای ماهیگیری غروب میکند](https://vphoto.vietnam.vn/thumb/340x192/vietnam/resource/IMAGE/2026/05/31/1780192137701_beach-landscape-sea-water-nature-grass-745871-pxhere-com.jpeg)

نظر (0)