Une équipe de chercheurs affirme avoir réussi à obtenir des données de ChatGPT en demandant à l'IA de répéter des mots aléatoires.

Des chercheurs de Google DeepMind, de l'Université de Washington, de l'Université Cornell, de l'Université Carnegie Mellon, de l'Université de Californie à Berkeley et de l'ETH Zurich ont appelé les entreprises spécialisées en IA à tester minutieusement leurs produits, des grands modèles de langage à la technologie sous-jacente qui alimente les services d'IA tels que les chatbots et les générateurs d'images, avant de les commercialiser officiellement.

L'alerte a été donnée après que des chercheurs ont demandé à ChatGPT de répéter le mot « poème » en boucle. ChatGPT s'est exécuté, mais a ensuite révélé l'adresse électronique et le numéro de téléphone du PDG et cofondateur d'OpenAI. Testé avec le mot « entreprise », le chatbot a affiché l'adresse électronique et le numéro de téléphone d'un cabinet d'avocats choisi au hasard.

Logo ChatGPT affiché sur un smartphone. Photo : Reuters

En utilisant d'autres mots-clés, ils ont également réussi à obtenir de ChatGPT des adresses Bitcoin, des numéros de fax, des noms, des dates de naissance, des comptes de réseaux sociaux, des extraits d'articles de recherche protégés par le droit d'auteur, ou encore des articles sponsorisés de CNN . L'équipe n'a dépensé que 200 dollars pour générer 10 000 exemples d'informations et de données personnelles.

Les chercheurs se sont dits surpris, qualifiant la vulnérabilité de ChatGPT de « vraiment stupide » et affirmant qu'elle aurait dû être découverte plus tôt.

La vulnérabilité a été signalée à OpenAI et corrigée le 30 août. Cependant, lors du nouveau test d' Engadget , lorsqu'on a demandé à ChatGPT de répéter le mot « répondre » indéfiniment, le site spécialisé a alors reçu le nom et l'identifiant Skype d'une personne.

OpenAI n'a pas encore fait de commentaire.

Les IA génératives comme ChatGPT ou le générateur d'images à partir de texte Dall-E reposent sur de vastes modèles de langage et des algorithmes d'apprentissage automatique, entraînés sur d'énormes quantités de données sans le consentement des utilisateurs. OpenAI n'a pas divulgué les données utilisées pour l'entraînement de ChatGPT car le modèle de langage qui le sous-tend est propriétaire.

Selon Huy Duc - VnExpress

Source

![[Photo] Lam Dong : Gros plan sur un lac illégal au mur brisé](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/03/1762166057849_a5018a8dcbd5478b1ec4-jpg.webp)

![[Photo] Foire d'automne 2025 et records impressionnants](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/03/1762180761230_ndo_br_tk-hcmt-15-jpg.webp)

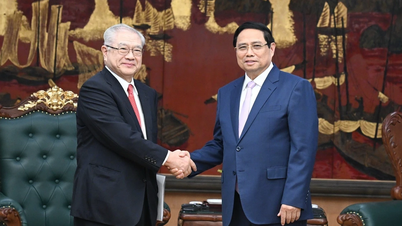

![[Photo] Le Premier ministre Pham Minh Chinh reçoit le président de l'Association d'amitié Japon-Vietnam dans la région du Kansai](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/03/1762176259003_ndo_br_dsc-9224-jpg.webp)

![[Photo] Le secrétaire général To Lam reçoit l'ambassadeur de Singapour, Jaya Ratnam](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/03/1762171461424_a1-bnd-5309-9100-jpg.webp)

Comment (0)