Selon les experts en sécurité, les escroqueries utilisant la technologie Deepfake sont très dangereuses, mais il existe des moyens pour les utilisateurs de reconnaître les vidéos à l'aide de cette technologie d'intelligence artificielle, évitant ainsi d'être dupés par des méchants.

Le risque d'une vague de fraude utilisant la technologie Deepfake

Dans un avertissement publié le 24 mars, la police provinciale de Tuyen Quang a indiqué qu'une méthode très sophistiquée de fraude et d'appropriation de biens avait récemment fait son apparition sur le cyberespace. Ces escrocs utilisent la technologie Deepfake (une technologie qui utilise l'intelligence artificielle pour créer des produits audio, image et vidéo imitant des personnes réelles avec une très grande précision) pour passer de faux appels vidéo afin d'emprunter de l'argent à des proches, se faire passer pour des enfants étudiant à l'étranger appelant leurs parents pour leur demander de virer de l'argent afin de payer leurs frais de scolarité, ou encore créer des situations d'urgence, comme un accident impliquant des proches nécessitant des soins médicaux urgents.

Ces derniers jours, la police de certaines autres localités comme Hanoi et Thai Nguyen a continué à mettre en garde contre des astuces frauduleuses visant à s'approprier des actifs sur Internet en utilisant la technologie Deepfake.

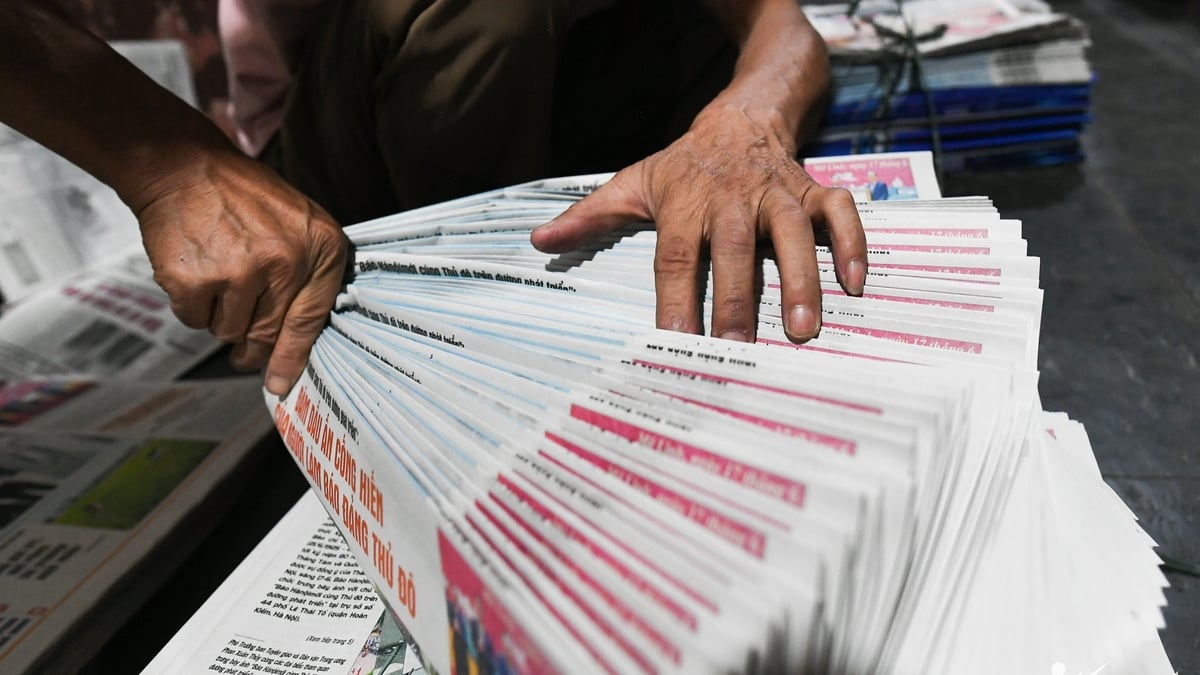

La police de plusieurs provinces et villes a émis des avertissements concernant des fraudes utilisant la technologie Deepfake. (Photo d'illustration : Internet)

Lors d'un partage lors de l'atelier sur « La cybersécurité dans l'espace numérique - Tendances et opportunités » organisé par l'Institut de technologie des postes et télécommunications (PTIT) le 27 mars, l'expert Ngo Minh Hieu, co-fondateur du projet ChongLuaDao.vn et Threat Hunter, National Cyber Security Monitoring Center a déclaré que les vidéos Deepfake viennent d'apparaître au Vietnam, mais en fait, cette technique de fraude et de falsification basée sur l'IA est appliquée par des groupes criminels internationaux depuis environ 2 à 3 ans.

L'expert Ngo Minh Hieu a également analysé l'existence de nombreux outils en ligne permettant de créer des deepfakes. À l'avenir, lorsque les cybercriminels vietnamiens maîtriseront mieux le vol de vidéos et d'images, leur copier-coller, puis utiliseront des outils en ligne pour créer des deepfakes, une vague de fraudes de génération 4.0 se produira, faisant de nombreuses victimes, longtemps difficiles à duper.

« Les personnes d'âge moyen et les personnes âgées sont les plus vulnérables aux escroqueries car elles manquent de sensibilisation à la sécurité de l'information et à la technologie et ont du mal à reconnaître ce type d'escroquerie sophistiquée », a ajouté l'expert Ngo Minh Hieu.

L'expert Ngo Minh Hieu a partagé avec les étudiants du PTIT des informations sur les formes de fraude, notamment la fraude utilisant Deepfake.

À ce propos, Vu Ngoc Son, directeur technique de NCS, a déclaré que les applications deepfake gagnent en popularité, suscitant même des inquiétudes quant à la perte de contrôle. Initialement, ces applications avaient pour objectif de permettre aux utilisateurs de remplacer facilement leurs visages et leurs voix par ceux de personnages de films célèbres. Elles constituent une nouvelle étape dans la tendance actuelle de la retouche photo et du doublage humoristique de clips, qui a fait fureur par le passé.

Cependant, des escrocs ont exploité les applications Deepfake pour créer des vidéos au contenu frauduleux et usurpant l'identité de leurs victimes. De nombreuses personnes ont perdu de l'argent, pensant que leurs proches, collègues et dirigeants les appelaient pour leur demander de leur transférer de l'argent. Cette technologie est utilisée à des fins encore plus malveillantes, et récemment, lorsqu'on évoque Deepfake, on pense souvent à des outils malveillants.

Comment éviter les escroqueries grâce à la technologie Deepfake

Concernant la prévention, l'expert Vu Ngoc Son a analysé que, la puissance de calcul des applications Deepfake n'étant pas encore totalement optimale, les clips créés à partir de cette technologie présentent souvent une faible capacité, une durée courte et une qualité d'image et de son médiocre. Le plus notable est que le visage est assez rigide et moins émotionnel. Le corps du personnage dans Deepfake bougera également moins, notamment face vers le haut ou vers le bas, par rapport aux clips classiques. Il n'y aura pas d'action consistant à se frotter le visage ou à le couvrir, car l'IA gère les erreurs lorsque le visage est partiellement couvert. Par conséquent, une attention particulière permettra de le détecter.

« Les utilisateurs ne doivent pas faire confiance aux clips courts, de mauvaise qualité, flous, peu clairs, avec peu d'expression faciale, peu de mouvements corporels, des visages qui ne sont pas tournés de côté, des voix qui ne sont pas fluides ou trop monotones, et qui n'ont pas de pauses », recommande l'expert Vu Ngoc Son.

L'expert de NCS Company a également souligné la nécessité pour les utilisateurs d'être vigilants. Il est notamment recommandé de ne pas se fier aux courts clips ou aux appels vidéo dont la qualité d'image ou de son est médiocre ; de vérifier la situation en appelant directement avec un téléphone classique ; de demander à l'appelant de se couvrir le visage ou de tourner à gauche ou à droite ; de discuter autant que possible avec lui pour s'assurer que l'appel est authentique et non enregistré. Il est notamment recommandé de ne pas transférer d'argent ni d'envoyer d'informations à des adresses ou comptes inconnus.

Partageant le même avis, l'expert Ngo Minh Hieu recommande aux utilisateurs d'être vigilants et vigilants pour éviter les arnaques. Si, sur les réseaux sociaux, quelqu'un de votre liste d'amis vous demande soudainement de l'argent ou vous envoie un lien étrange, ne vous précipitez pas, restez calme et vérifiez encore et encore.

« Les utilisateurs peuvent s'authentifier proactivement en appelant directement ou en utilisant FaceTime pendant au moins une minute, puis faire semblant de poser des questions personnelles que seuls eux et leur interlocuteur connaissent. Deepfake ne permettra pas de simuler une conversation réelle en temps réel avec une grande précision », a conseillé l'expert Ngo Minh Hieu.

Selon VNN

Source

![[Photo] Le Département central de la propagande et de la mobilisation de masse rencontre des journalistes exemplaires](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/6/21/9509840458074c03a5831541450d39f8)

![[Nouvelles maritimes] Wan Hai Lines investit 150 millions de dollars pour acheter 48 000 conteneurs](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/6/20/c945a62aff624b4bb5c25e67e9bcc1cb)

Comment (0)