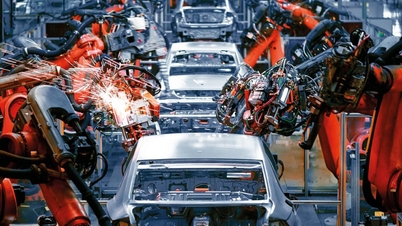

Les géants technologiques Alibaba, Baidu et ByteDance se livrent une véritable course pour proposer des prix inférieurs de 90 % à ceux de leurs concurrents américains dans le domaine de l'IA d'« inférence ».

Les entreprises de Chine continentale réduisent leurs coûts en créant des modèles entraînés sur de plus petites quantités de données, ce qui nécessite moins de puissance de calcul mais un matériel optimisé, a déclaré Lee Kai-Fu, fondateur de 01.ai et ancien directeur de Google Chine.

D'après le classement récemment publié par UC Berkeley SkyLab et LMSYS, le modèle Yi-Lingtning de la startup 01.ai arrive en troisième position, ex aequo avec Grok-2 de x.AI, derrière OpenAI et Google. Ce classement est établi en fonction des scores attribués par les utilisateurs aux réponses à leurs requêtes.

01.ai et DeepSeek sont des entreprises d'IA chinoises qui adoptent une stratégie consistant à se concentrer sur des ensembles de données plus petits pour entraîner les modèles, tout en embauchant une main-d'œuvre bon marché et hautement qualifiée.

Selon le Financial Times, le coût d'inférence de Yi-Lightning est de 14 cents par million de jetons, contre 26 cents pour GPT-o1-mini d'OpenAI. GPT-4o, quant à lui, coûte jusqu'à 4,40 $ par million de jetons. Le nombre de jetons nécessaires pour générer une réponse dépend de la complexité de chaque requête.

Les fondateurs de Yi-Lightning ont révélé que l'entreprise avait investi 3 millions de dollars dans la « formation initiale », avant d'optimiser le modèle pour différents cas d'utilisation. Lee a précisé que leur objectif n'était pas de « créer le meilleur modèle », mais de concevoir un modèle concurrent « 5 à 10 fois moins cher ».

La méthode appliquée par 01.ai, DeepSeek, MiniMax et Stepfun est appelée « modélisation experte », ce qui signifie simplement combiner plusieurs réseaux neuronaux entraînés sur des ensembles de données spécifiques au domaine.

Les chercheurs considèrent cette approche comme un moyen essentiel d'atteindre le même niveau d'intelligence que les modèles de mégadonnées, mais avec une puissance de calcul moindre. Cependant, la difficulté réside dans le fait que les ingénieurs doivent orchestrer le processus d'apprentissage avec plusieurs experts au lieu d'un seul modèle général.

Face aux difficultés d'accès aux puces d'IA haut de gamme, les entreprises chinoises se sont tournées vers le développement d'ensembles de données de haute qualité, utilisables pour entraîner des modèles experts, leur permettant ainsi de concurrencer leurs rivaux occidentaux.

Lee a déclaré que 01.ai utilise des méthodes non traditionnelles de collecte de données, comme la numérisation de livres ou la collecte d'articles sur l'application de messagerie WeChat qui ne sont pas accessibles sur le site web public.

Le fondateur estime que la Chine est mieux placée que les États-Unis, grâce à son immense vivier de talents techniques bon marché.

(Selon le Financial Times et Bloomberg)

Source : https://vietnamnet.vn/trung-quoc-giam-90-chi-phi-ai-suy-luan-so-voi-my-2334520.html

![[Photo] Le président Luong Cuong reçoit le président de l'Assemblée nationale coréenne, Woo Won Shik](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F11%2F21%2F1763720046458_ndo_br_1-jpg.webp&w=3840&q=75)

![[Photo] Le secrétaire général de Lam reçoit le président du Sénat de la République tchèque, Miloš Vystrčil.](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F11%2F21%2F1763723946294_ndo_br_1-8401-jpg.webp&w=3840&q=75)

![[Photo] Visitez Hung Yen pour admirer la pagode « chef-d'œuvre en bois » au cœur du delta du Nord](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F11%2F21%2F1763716446000_a1-bnd-8471-1769-jpg.webp&w=3840&q=75)

![[Photo] Le président de l'Assemblée nationale, Tran Thanh Man, s'entretient avec le président du Sénat de la République tchèque, Milos Vystrcil](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F11%2F21%2F1763715853195_ndo_br_bnd-6440-jpg.webp&w=3840&q=75)

Comment (0)