L’Armée populaire de libération chinoise (APL) a récemment averti que l’intelligence artificielle (IA) ne serait pas en mesure de remplacer les humains dans la prise de décisions sur le champ de bataille.

|

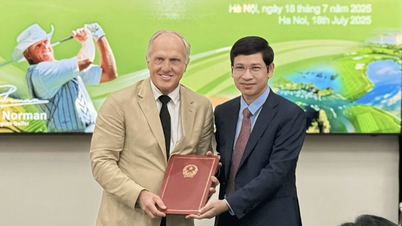

| La décision finale revient au commandant humain pour se prémunir contre les erreurs découlant de la nature « boîte noire » de l'IA. (Source : Shutterstock) |

« L'IA doit travailler en tandem avec les décideurs pour optimiser l'efficacité du commandement, en augmentant plutôt qu'en remplaçant les humains », indique un article publié dans le People's Liberation Army Daily le 31 décembre 2024.

L’IA peut être utilisée pour augmenter les capacités humaines – par l’analyse de données, la simulation ou la planification – mais ne peut pas remplacer nos rôles, indique l’article.

« À mesure que l'IA se développe, elle demeure un outil guidé par le jugement humain, garant de la responsabilisation. La créativité et l'adaptabilité stratégique demeurent des priorités absolues dans la prise de décision militaire », commente l'article.

Selon l'article, l'autonomie et la créativité humaines sont des facteurs indispensables sur le champ de bataille. Alors que les humains, occupant des postes de commandement, peuvent réagir aux situations de manière dynamique et exploiter les faiblesses de l'ennemi, l'IA évolue dans des limites algorithmiques prédéterminées et les réponses technologiques manquent souvent d'originalité.

L’APL a proposé un modèle dans lequel « les humains planifient et l’IA exécute », où la technologie est utilisée pour exécuter les stratégies et les tactiques développées par les commandants tout en conservant un élément de surveillance humaine.

Cependant, « la décision finale revient au commandant humain de se prémunir contre les erreurs découlant de la nature de boîte noire de l’IA ».

Une autre faiblesse de la technologie, estime l’APL, est son incapacité à assumer la responsabilité des décisions prises, contrairement aux commandants humains qui peuvent ajuster leurs plans pour répondre avec souplesse aux situations.

L'article indique également que même les équipements avancés, tels que les systèmes automatisés de défense antimissile, dépendent souvent d'opérateurs humains pour prendre les décisions finales afin de garantir la responsabilité.

La Chine est un fervent défenseur de la réglementation de l’utilisation de l’IA dans l’armée, ayant déjà soumis des documents aux Nations Unies sur le sujet, soulignant la nécessité d’un « contrôle humain de la technologie ».

Le président chinois Xi Jinping a souligné la nécessité de contrôler la technologie et, lors de sa dernière rencontre avec son homologue américain Joe Biden au Pérou il y a deux mois, les deux puissances ont convenu que « les humains, et non l'IA, devraient décider de la manière dont les armes nucléaires sont utilisées ».

Le dernier rapport annuel du Pentagone sur l'armée chinoise, publié le mois dernier, indique que l'APL fait pression pour une collaboration homme-machine, visant une « guerre algorithmique » et une « guerre centrée sur le réseau » d'ici 2030.

Le rapport souligne les investissements importants de l'APL dans les véhicules autonomes, la maintenance prédictive, la reconnaissance automatique des cibles et les drones sous-marins. Parallèlement, l'APL envisage de recourir à des initiatives civiles d'IA dans des domaines tels que les drones, la reconnaissance d'images et la prise de décision intelligente.

Les États-Unis cherchent également à exploiter cette technologie. Le mois dernier, Radha Plumb, responsable du numérique et de l'IA au Pentagone, a dévoilé les détails d'un plan visant à intégrer cette technologie aux opérations de combat, qu'elle a décrit comme « le premier effort majeur visant à déployer une IA avancée pour répondre aux besoins des combattants en temps réel ».

L'acquisition par les États-Unis de cette technologie auprès d'« adversaires » tels que la Chine, la Russie, l'Iran et la Corée du Nord « s'accélère et pose des risques importants pour la sécurité nationale », a-t-elle averti.

Source

![[Infographie] En 2025, 47 produits obtiendront l'OCOP national](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/7/16/5d672398b0744db3ab920e05db8e5b7d)

Comment (0)