न्यू हैम्पशायर अटॉर्नी जनरल के कार्यालय ने सोमवार को घोषणा की कि वह एक नकली आवाज की शिकायतों के बाद संभावित मतदाता हेरफेर की जांच कर रहा है, जो बिल्कुल अमेरिकी राष्ट्रपति जो बिडेन की तरह लग रही थी, जो मतदाताओं से राज्य के प्राथमिक चुनाव में मतदान न करने का आग्रह कर रहे थे।

शोधकर्ताओं ने राजनेताओं और प्रमुख नेताओं की नकल करने के लिए डीपफेक ऑडियो के उपयोग के बारे में भी चेतावनी दी है, जिसके प्रमुख मामले 2023 में यूके, भारत, नाइजीरिया, सूडान, इथियोपिया और स्लोवाकिया में सामने आएंगे।

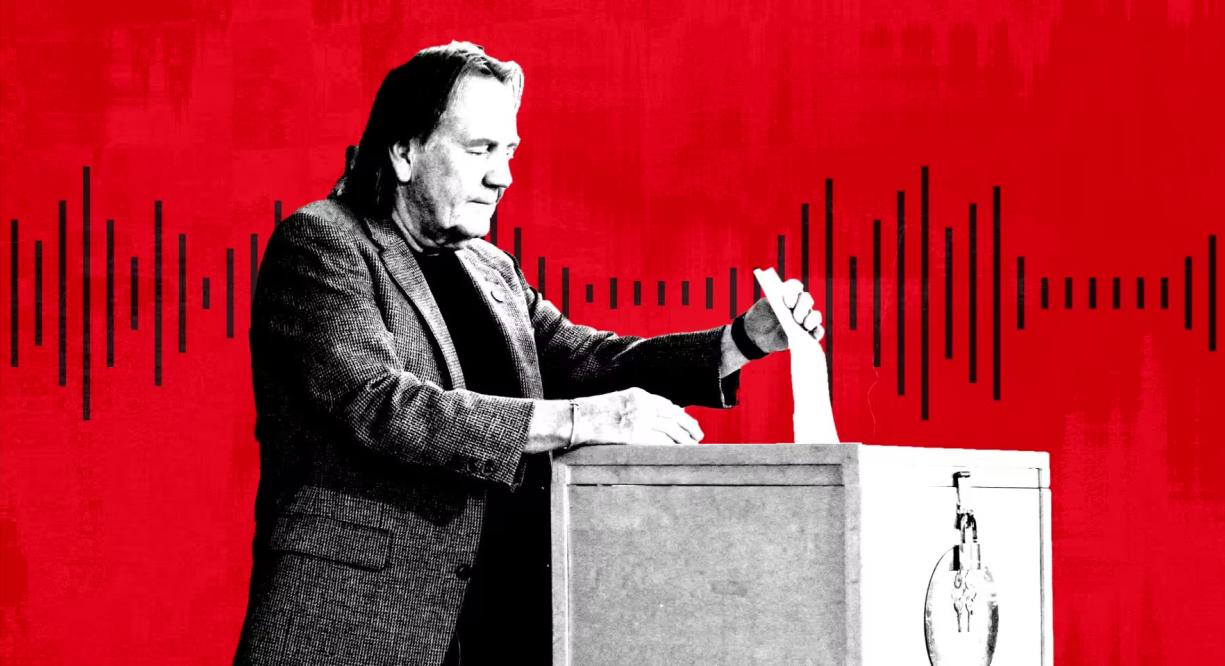

अमेरिका के न्यू हैम्पशायर में प्राइमरी चुनाव में वोट डालता एक व्यक्ति। फोटो: गेटी

विशेषज्ञों के अनुसार, स्टार्टअप्स द्वारा कई सस्ते और प्रभावी एआई टूल्स के आने से डीपफेक ऑडियो गलत सूचना का एक लोकप्रिय रूप बन गया है। माइक्रोसॉफ्ट ने एक नया एआई मॉडल भी विकसित किया है जो केवल तीन सेकंड की रिकॉर्डिंग से आवाज़ों की नकल कर सकता है।

"जब दृश्य हेरफेर की बात आती है, तो हर कोई फ़ोटोशॉप से परिचित है या कम से कम जानता है कि यह मौजूद है," एडोब, मेटा और ईवाई के लिए एआई और डीपफेक विशेषज्ञ और सलाहकार हेनरी अजदर ने कहा। "इस बारे में बहुत कम जागरूकता है कि ऑडियो से कैसे छेड़छाड़ की जा सकती है, इसलिए मेरे हिसाब से यह हमें वास्तव में असुरक्षित बनाता है।"

सितंबर में, न्यूज़गार्ड, जो समाचार साइटों की गुणवत्ता और विश्वसनीयता का मूल्यांकन करने वाली एक प्रणाली है, ने टिकटॉक अकाउंट्स के एक ऐसे नेटवर्क का पता लगाया जो वैध समाचार साइटों के रूप में नकली थे और षड्यंत्र के सिद्धांत और राजनीतिक गलत सूचना फैलाने के लिए एआई-जनरेटेड सामग्री का उपयोग कर रहे थे। पूर्व अमेरिकी राष्ट्रपति बराक ओबामा की आवाज़ सहित डीपफेक रिकॉर्डिंग को करोड़ों बार देखा गया।

न्यूजगार्ड ने कहा कि ऐसा प्रतीत होता है कि ये नकली वॉयसओवर एंड्रीसन होरोविट्ज़ समर्थित इलेवनलैब्स द्वारा उपलब्ध कराए गए टूल द्वारा तैयार किए गए हैं, जबकि क्लिप को करोड़ों बार देखा गया है।

इलेवनलैब्स ने कहा, "हमारे प्लेटफॉर्म पर 99% से अधिक उपयोगकर्ता दिलचस्प, रचनात्मक, उपयोगी सामग्री बना रहे हैं, लेकिन हम मानते हैं कि दुरुपयोग के मामले भी हैं और हमने उन्हें सीमित करने के लिए लगातार सुरक्षा विकसित और शुरू की है।"

दो साल पहले गूगल और पैलंटिर के पूर्व कर्मचारियों पियोट्र डबकोव्स्की और माटी स्टैनिशेव्स्की द्वारा स्थापित इलेवनलैब्स, केवल एक क्लिक पर बुनियादी एआई ऑडियो जनरेशन टूल मुफ़्त में प्रदान करता है। अधिक जटिल सेवाओं की तलाश करने वालों के लिए सदस्यता योजनाएँ $1 प्रति माह से लेकर $330 प्रति माह और उससे भी अधिक तक उपलब्ध हैं।

पिछले साल, अमेरिकी खुफिया एजेंसियों ने एक रिपोर्ट में चेतावनी दी थी कि "परिष्कृत और अच्छी तरह से प्रशिक्षित एआई वॉयस क्लोनिंग मॉडल के जारी होने के कारण व्यक्तिगत एआई घोटाले में काफी वृद्धि हुई है।"

आर्थिक रूप से प्रेरित घोटालों के अलावा, राजनीतिक विशेषज्ञ अब वायरल डीपफेक ऑडियो क्लिप्स और रोबोकॉल या अभियानों के लिए डीपफेक के इस्तेमाल को लेकर भी चिंता जता रहे हैं। साइबर सुरक्षा समूह ज़ीरोफ़ॉक्स के उपाध्यक्ष और प्रतिष्ठित इंटेलिजेंस फ़ेलो एजे नैश ने कहा, "आप फ़ोनों को निशाना बनाकर एक शक्तिशाली, व्यापक दुष्प्रचार अभियान चला सकते हैं।"

इनमें से कुछ कंपनियाँ गलत सूचनाओं से निपटने के अन्य तरीके खोजने में सक्रिय रही हैं। माइक्रोसॉफ्ट ने एक नैतिक वक्तव्य जारी किया है, जिसमें उपयोगकर्ताओं से उसके एआई ऑडियो टूल के किसी भी दुरुपयोग की रिपोर्ट करने का आग्रह किया गया है। इलेवनलैब्स ने अपने सिस्टम द्वारा बनाई गई ऑडियो रिकॉर्डिंग की पहचान करने के लिए अपने स्वयं के डिटेक्शन टूल बनाए हैं।

मानवाधिकार समूह फ्रीडम हाउस के अनुसार, नाइजीरिया के 2023 के चुनाव के दौरान, एआई द्वारा हेरफेर की गई एक क्लिप सोशल मीडिया पर वायरल हो गई थी, जिसका "यह दावा किया गया था कि एक विपक्षी उम्मीदवार वोट में हेराफेरी करने की योजना बना रहा था।"

स्लोवाकिया में, सितंबर में होने वाले राष्ट्रपति चुनाव से कुछ दिन पहले विपक्षी उम्मीदवार मिशल शिमेचका की एक फर्जी ऑडियो रिकॉर्डिंग वायरल हो गई, जिसमें वे चुनाव में धांधली की साजिश रच रहे थे।

गैर-लाभकारी उपभोक्ता वकालत समूह पब्लिक सिटीजन के अध्यक्ष रॉबर्ट वीसमैन ने कहा, "न्यू हैम्पशायर डीपफेक इस बात की याद दिलाता है कि डीपफेक कितने तरीकों से भ्रमित और धोखा दे सकता है।" उन्होंने आगे कहा, "राजनीतिक डीपफेक का दौर आ गया है। नीति निर्माताओं को तुरंत सुरक्षा उपाय लागू करने होंगे, वरना हमें चुनावी अराजकता का सामना करना पड़ेगा।"

माई आन्ह (एफटी के अनुसार)

[विज्ञापन_2]

स्रोत

![[फोटो] डैन माउंटेन जिनसेंग, किन्ह बाक भूमि के लिए प्रकृति का एक अनमोल उपहार](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F11%2F30%2F1764493588163_ndo_br_anh-longform-jpg.webp&w=3840&q=75)

टिप्पणी (0)