A DeepSeek, a legfelkapottabb kínai startup az utóbbi napokban kétségeket vetett fel azzal az állításával kapcsolatban, hogy mindössze 5 millió dollárral az OpenAI-hoz hasonló mesterséges intelligenciát hoz létre.

A DeepSeek széleskörű média- és közösségi médiavisszhangot kapott a Kígyó évének kezdetén, jelentős remegést okozva a globális tőzsdéken.

A Bernstein pénzügyi tanácsadó cég nemrégiben közzétett jelentése azonban arra figyelmeztet, hogy a lenyűgöző eredmények ellenére sem pontos az az állítás, miszerint mindössze 5 millió dollárból az OpenAI-hoz hasonló MI-rendszert lehetne létrehozni.

Bernstein szerint a DeepSeek állítása félrevezető, és nem tükrözi a nagyobb képet.

„Úgy gondoljuk, hogy a DeepSeek nem »5 millió dollárból hozta létre az OpenAI-t«; a modellek fantasztikusak, de nem hisszük őket csodáknak; és a hétvégi pánik látszólag eltúlzott volt” – áll a jelentésben.

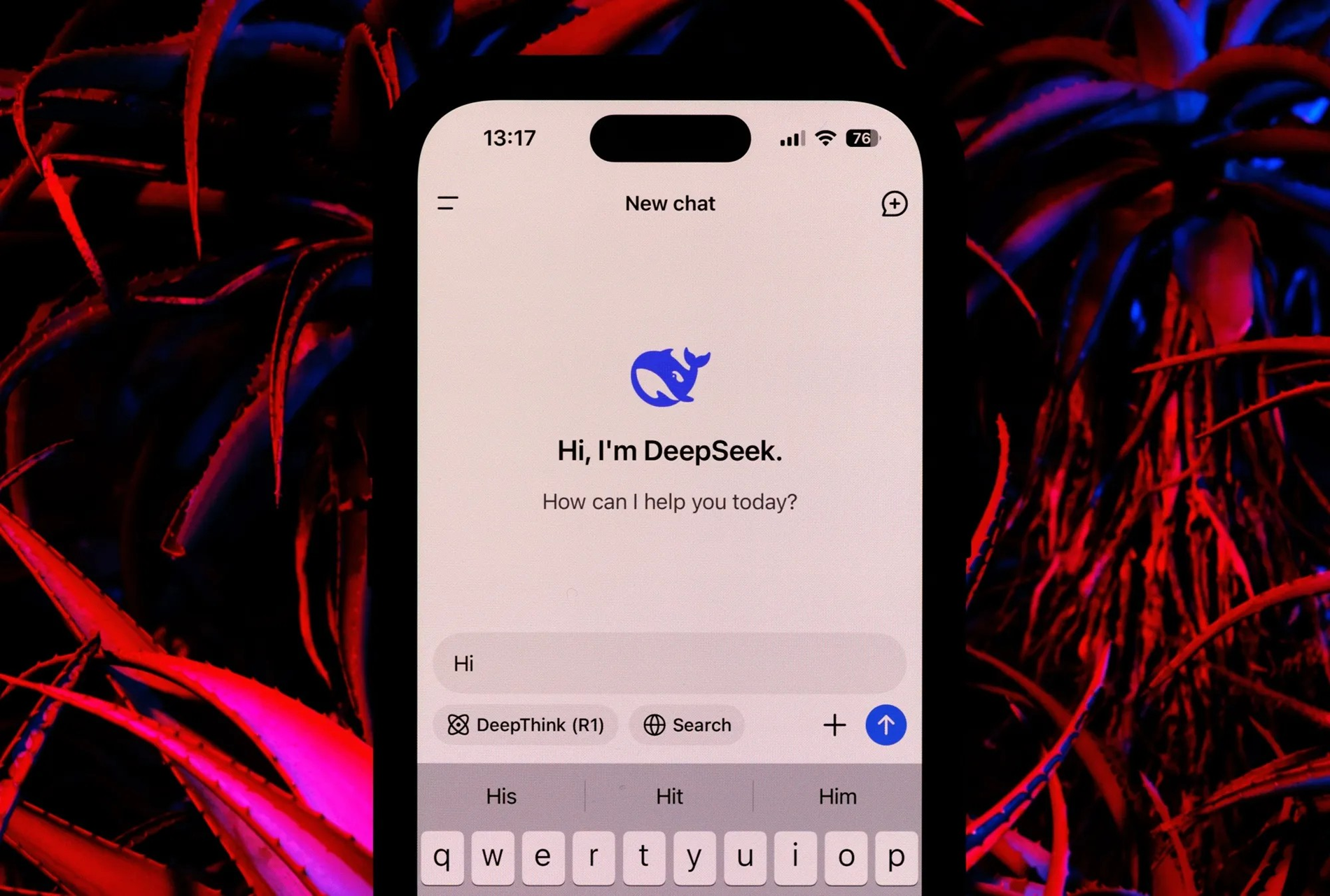

A DeepSeek két fő MI-modellt fejleszt: a DeepSeek-V3-at és a DeepSeek R1-et. A nagyméretű V3 nyelvi modell a MOE architektúrát használja ki, kisebb modelleket kombinálva a nagy teljesítmény elérése érdekében, miközben kevesebb számítási erőforrást használ, mint a hagyományos modellek.

Másrészről a V3 modell 671 milliárd paraméterrel rendelkezik, amelyek közül 37 milliárd aktív egy adott időpontban, olyan innovációkat tartalmaz, mint az MHLA a memóriahasználat csökkentése és az FP8 használata a nagyobb hatékonyság érdekében.

A V3 modell betanításához két hónap alatt 2048 Nvidia H800 GPU-ból álló klaszterre volt szükség, ami 5,5 millió GPU-órának felel meg. Míg egyes becslések a betanítás költségét körülbelül 5 millió dollárra becsülik, Bernstein jelentése hangsúlyozza, hogy ez az összeg csak a számítási erőforrásokat fedezi, és nem veszi figyelembe a kutatással, teszteléssel és egyéb fejlesztési kiadásokkal kapcsolatos jelentős költségeket.

A DeepSeek R1 modell a V3 alapjaira épít a megerősítéses tanulás (RL) és más technikák alkalmazásával a következtetési képesség biztosítása érdekében.

Az R1 modell képes versenyezni az OpenAI modellekkel az érvelési feladatokban. Bernstein azonban rámutat, hogy az R1 fejlesztése jelentős erőforrásokat igényel, bár ezeket a DeepSeek-jelentés nem részletezi.

A DeepSeekkel kapcsolatban Bernstein lenyűgözőnek nevezte a modelleket. Például a V3 modell ugyanolyan jól vagy jobban teljesít, mint a nyelvészet, a programozás és a matematika más jelentős nyelvi modelljei, miközben kevesebb erőforrást igényel.

A V3 előképzési folyamata mindössze 2,7 millió GPU-óra munkát igényelt, ami néhány más csúcskategóriás modell számítási erőforrásainak 9%-a.

Bernstein arra a következtetésre jutott, hogy bár a DeepSeek előrelépései figyelemre méltóak, óvatosnak kell lenni a túlzó állításokkal. Az OpenAI versenytársának létrehozása mindössze 5 millió dollárral félrevezető ötletnek tűnik.

(A Times of India szerint)

[hirdetés_2]

Forrás: https://vietnamnet.vn/deepseek-khong-the-lam-ai-tuong-duong-openai-voi-5-trieu-usd-2367340.html

![[Kép] A Központi Párt Irodája összefoglalja a 2025-ös munkát](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F18%2F1766065572073_vptw-hoi-nghi-tong-ket-89-1204-jpg.webp&w=3840&q=75)

![[Videó] Két könyv bemutatója a történelemről és az örökségvédelemről](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/12/18/1766072185865_2663241292917005256-4230-jpg.webp)

Hozzászólás (0)