●企業が適切なセキュリティ対策を実施すれば、リスクを制御できます。

●イスラエルのサイバーセキュリティ企業 Team8 は、多くの企業の情報セキュリティ責任者からのフィードバックを基に、この問題に関するレポートを作成しました。

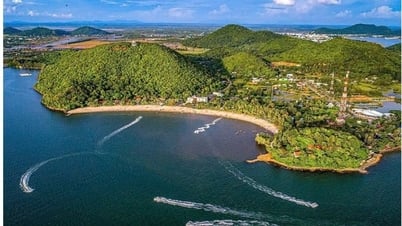

写真:ギャビー・ジョーンズ/ブルームバーグ。

イスラエルのサイバーセキュリティベンチャーであるTeam8は、レポートの中で、ChatGPTのような一部の人工知能アプリケーションを現在使用している企業は、機密の顧客情報や企業秘密が漏洩するリスクに直面する可能性が高いと述べた。

ブルームバーグ・ニュースに公開前に提供されたこの報告書は、チャットボットやテキストエディターにおけるAIの利用拡大により、多くの企業がデータ侵害や訴訟のリスクにさらされる可能性があると指摘しています。報告書は、チャットボットがハッカーによって企業の機密情報を盗み出したり、企業に損害を与えるその他の活動に利用される可能性を懸念しています。また、現在チャットボットに提供されている機密情報が、将来AI企業に利用される可能性についても懸念されています。

マイクロソフトやアルファベットといった大手テクノロジー企業の多くは、チャットボットや検索エンジンの改良に人工知能(AI)の導入を競い合っており、インターネットから収集したデータセットでAIモデルを学習させることで、ユーザーのあらゆる質問に答えられる多機能ツールを提供しています。報告書によると、これらのアプリケーションに機密情報や個人情報が提供された場合、提供された情報を削除することは極めて困難になるとのことです。

「企業環境における人工知能の適用は、ユーザーから直接またはAPI経由で受信したデータを通じて、機密情報、知的財産、ソースコード、企業秘密、その他のデータ(ユーザーのプライバシーや機密情報を含む)が悪用・処理されるリスクにつながる可能性がある」と報告書は述べている。報告書はこれらのリスクを「高」と評価し、適切なサイバーセキュリティ対策が実施されればこれらのリスクは「管理可能」であると述べた。

Team8 のレポートでは、チャットボットの入力は他人に読み取られる可能性があるという最近のレポートとは対照的に、人工知能のトレーニングのために企業に提供されていないことを強調しています。

本稿執筆時点では、大規模言語データで学習されたAIモデルはリアルタイムで自己更新することができないため、ある人からの入力を別の人への応答に利用することができません。そのため、その可能性について懸念する必要はありません。ただし、これらのモデルの将来バージョンが必ずしも同様の特性を持つとは限りません。

この報告書では、AI統合に関する他の3つの問題も「高リスク」と評価し、サードパーティ製アプリケーションとの情報共有の脅威の増大を強調しています。マイクロソフトは、Bing検索エンジンとMicrosoft 365ソフトウェアスイートに複数のチャットボット機能を統合しています。

「例えば、ユーザー側では、人工知能モデルのAPIを活用するサードパーティ製アプリケーションが侵害され、ユーザーのメールやウェブブラウザへのアクセスが許可され、侵入者がユーザーに代わってアクティビティを実行できるようになる可能性があります。」

報告書はまた、人工知能の使用により差別が増加したり、企業の評判が損なわれたり、著作権問題で訴訟の対象になったりする可能性があるという「中程度のリスク」を評価した。

マイクロソフトのコーポレートバイスプレジデント、アン・ジョンソン氏がこのレポートに寄稿しました。マイクロソフトは、ChatGPTアプリケーションを開発したOpenAIに数十億ドルを投資しています。

マイクロソフトの広報担当者は「マイクロソフトは、サイバーセキュリティと人工知能のコミュニティ内で進化するサイバーリスクに関する透明性のある議論を奨励しています」と述べた。

複数の米国企業の最高情報セキュリティ責任者(CISO)もこの報告書に協力しました。Team8の報告書は、米国国家安全保障局(NSA)および米国サイバーコマンドの元議長であるマイケル・ロジャース氏からも支持されています。

グエン・クアン・ミン(ブルームバーグによると)

[広告2]

ソース

コメント (0)