GoogleはGalaxy Unpackedイベント(米国)において、Gemini Advance(Gemini 2.0)を正式に発表しました。これは、マルチタスクと自然なインタラクションに重点を置いた人工知能プラットフォームの強力なアップグレードです。Gemini Advanceには、Samsung製品ラインへの最適化を目的とした多くの改良が盛り込まれています。 ギャラクシーS25 リリースされたばかりで、Galaxy S24やPixel 9などのデバイスをサポートしています。

このバージョンで最も顕著な特徴は、アクションチェーンの実行機能です。これにより、ユーザーは複数のタスクを連続して簡単に処理できます。例えば、Gemini Advance を使ってGoogleマップでレストランを検索し、その後Googleメッセージでメッセージを作成して友人を招待するといった操作を、たった1つのコマンドで実行できます。

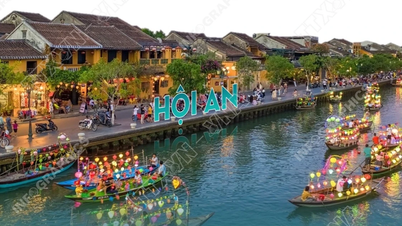

YouTubeのミュージックビデオをGemini Liveで分析し、ベトナム語で迅速な結果と正確な情報をテストします

マップやメッセージなどのGoogleの主要アプリに拡張機能が追加され、リマインダー、カレンダー、メモ、時計などのSamsung専用アプリも利用可能になり、 ギャラクシーS25。

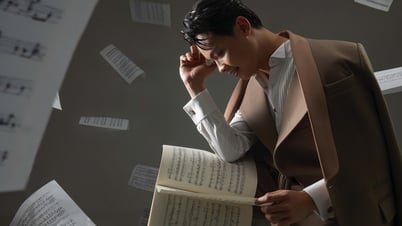

Gemini Advanceの拡張機能であるGemini Liveも、マルチモーダル処理機能を大幅に強化しました。ユーザーは画像、ファイル、YouTube動画をアップロードし、AIによる分析と支援を受けることができます。例えば、Gemini Liveにプロジェクトの写真を評価してもらい、改善点を提案してもらうことができます。ただし、これらの機能はGalaxy S24、Galaxy S25、Pixel 9でのみ利用可能であり、Googleが現在最もプレミアムなデバイスに重点を置いていることを裏付けています。

Gemini Advanceに加え、GoogleはProject Astraも発表しました。これはAIインタラクションの新たな一歩であり、ユーザーはスマートフォンのカメラを使って周囲の状況について質問できるようになります。例えば、カメラを物体に向けるとGeminiが関連情報を提供したり、写真を撮るだけでバスの時刻表を尋ねたりすることができます。

内蔵の AI プラットフォームは、現実世界の写真を分析し、冷蔵庫にある食材からレシピなどの提案を行うことができます。

プロジェクト・アストラは、まず ギャラクシーS25 Pixelデバイスにも対応しています。さらにGoogleは、スマートフォンの画面を使わずに周囲の環境とやりとりできるハンズフリーAIグラスのテストも行っています。

アクション シーケンスやマルチモーダル処理などの新機能を備えた Gemini Advance は、特に Samsung Galaxy S25 において、モバイル デバイスへの AI の適用における一歩前進を示しています。

[広告2]

出典: https://thanhnien.vn/google-ra-mat-gemini-advance-toi-uu-hoa-cho-samsung-galaxy-s25-185250123021204879.htm

![[インフォグラフィック] 2025年には47の製品が国家OCOPを達成する](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/7/16/5d672398b0744db3ab920e05db8e5b7d)

コメント (0)