TruepicのCEO、ジェフリー・マクレガー氏は、今回の事件は氷山の一角に過ぎないと考えている。ソーシャルメディアには今後さらに多くのAI生成コンテンツが登場するだろうが、私たちはまだそれを受け入れる準備ができていないと彼は述べている。

CNNによると、Truepicはこの問題に対処するため、Truepic Lensを通じてメディアの作成時に真正性を検証する技術を提供する予定です。このデータ収集アプリケーションは、画像の作成日時、場所、使用されたデバイスをユーザーに通知し、デジタル署名を適用することで、画像が自然画像かAI生成画像かを検証します。

ペンタゴン爆発の偽写真がツイッターで拡散している。

2015年に設立され、マイクロソフトの支援を受けているTruepicは、請求の正当性を検証する方法を探しているNGOやメディア企業、さらには保険会社からも関心を集めている。

マクレガー氏は、あらゆるものが偽造可能となり、人工知能が品質とアクセス性の点で最高潮に達したとき、私たちはオンライン上で何が現実なのか分からなくなると述べた。

Truepicのようなテクノロジー企業は、長年にわたりオンライン上の偽情報対策に取り組んできました。しかし、ユーザーの指示に従って画像や文章を生成できる様々な新しいAIツールの台頭により、その緊急性は高まっています。今年初めには、フランシスコ教皇がバレンシアガの救命胴衣を着用している姿や、ドナルド・トランプ前米大統領が逮捕される様子を捉えた偽画像が広く拡散されました。どちらの事件も、AIの潜在的な危険性について何百万人もの人々に警鐘を鳴らしました。

一部の議員は現在、テクノロジー企業に対し、AI生成コンテンツにラベルを貼ることでこの問題に対処するよう求めている。欧州委員会のヴェラ・ヨウロバ副委員長は、Google、Meta、Microsoft、TikTokなどの企業が、欧州連合の誤情報対策に関する自主行動規範に加盟していると述べた。

製品に AI 生成を実装している企業を含む新興企業や大手テクノロジー企業は、画像や動画が AI を使用して作成されたかどうかを人々が判断できるようにするための標準やソリューションを導入しようと努めています。

しかし、AI技術の進歩は人間の対応能力を上回る速さで進んでおり、これらの解決策が問題を完全に解決できるかどうかは依然として不透明です。Dal-EやChatGPTを開発したOpenAIでさえ、AI生成の文章検出を支援する自社の取り組みは不完全であることを認めています。

ソリューションを開発している企業は、この問題に対処するために2つのアプローチを採用しています。1つ目は、AI生成画像がオンラインで作成・共有された後に、その画像を識別するプログラムを開発することです。もう1つは、何らかのデジタル署名を用いて、画像が本物かAI生成かを識別することに重点を置いています。

Reality DefenderとHive Moderationは、前者のアプローチを研究しています。彼らのプラットフォームでは、ユーザーはスキャン対象の画像をアップロードし、画像が本物かAI生成かを示すパーセンテージを示す分析結果を受け取ることができます。

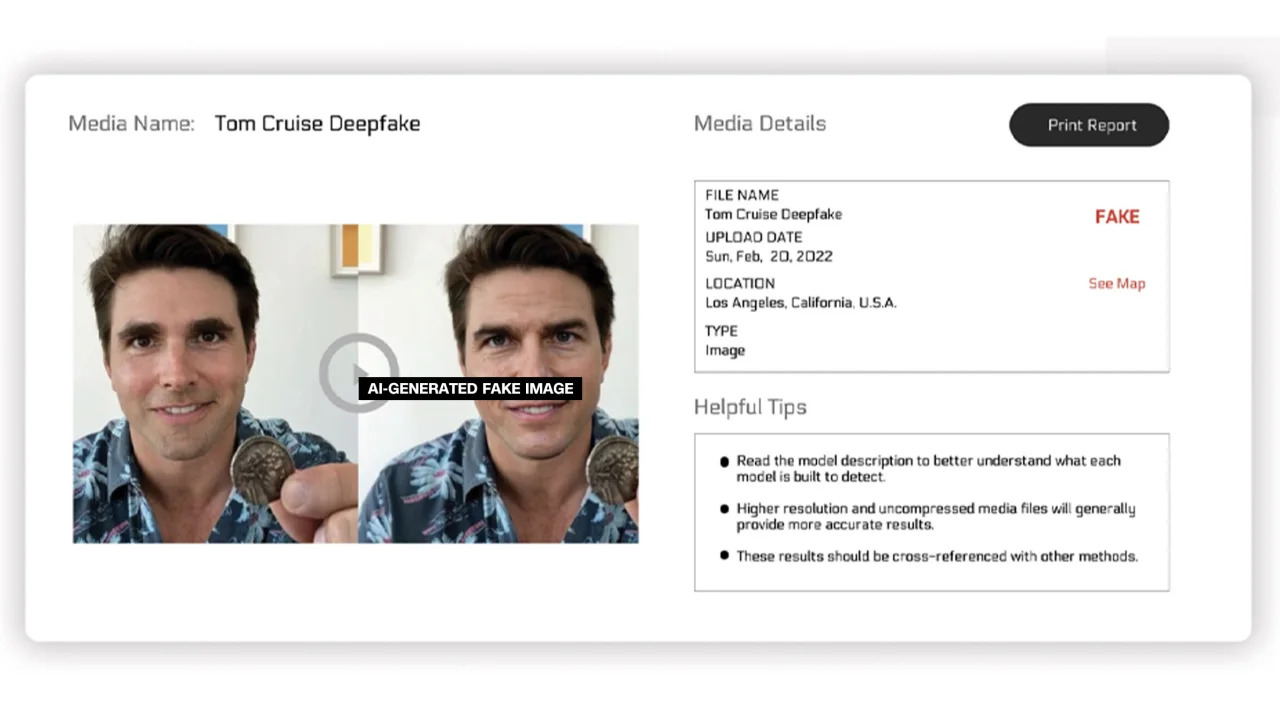

Reality Defenderは、独自のコンテンツフィンガープリンティングとディープフェイク技術を用いて、AIによって生成された動画、音声、画像を検出すると述べています。同社が提供した例では、トム・クルーズのディープフェイク画像が表示されており、画像に写っている人物の顔が歪んでいるため、「疑わしい」評価は53%となっています。これは、加工された写真によくあることです。

AI によって生成されたタグが付けられた画像。

これらのサービスは無料版と有料版の両方を提供しています。Hive Moderationは画像1,000枚につき1.50ドルの料金を請求しています。Realty Defenderは、クライアントが専門知識や企業によるサポートを必要とするかどうかなど、様々な要因に応じて料金が変動する可能性があると述べています。Reality DefenderのCEO、ベン・コールマン氏は、AIツールを使えば誰でも偽の画像を作成できるため、リスクは毎月倍増していると述べています。

他にもいくつかの企業が、画像にステッカーのようなものを組み込み、それが本物かAI生成かを証明する取り組みを進めています。これまでのところ、この取り組みは主に「コンテンツの真正性と情報源のための連合(C2PA)」によって推進されています。

C2PAは、デジタルメディアの出所と履歴を認証するための技術標準を策定するために2021年に設立されました。Adobeのコンテンツ真正性イニシアチブ(CAI)と、MicrosoftとBBCが主導するProject Originを統合し、デジタルニュースにおける誤情報の撲滅に重点を置くことを目的としています。C2PAには、Truepic、Intel、Sonyなどの企業も参加しています。

C2PAの原則に基づき、CAIは企業が画像に関する情報を含むコンテンツ認証情報やメタデータを作成するためのオープンソースツールを提供します。CAIのウェブサイトによると、これにより、作成者は画像の作成方法に関する詳細を透明性を持って共有できるようになります。これにより、エンドユーザーは、画像が誰によって、何を、どのように改変されたかというコンテキストにアクセスし、その画像の真正性を自ら評価できるようになります。

多くの企業がC2PA規格とCAIツールを自社のアプリケーションに統合しています。AdobeのFirefly(Photoshopに追加された新しいAI画像作成ツール)は、コンテンツ認証情報機能を通じてC2PA規格に準拠しています。Microsoftも、Bing Image CreatorとMicrosoft Designerを使用して作成された画像と動画に、今後数か月以内に暗号化された署名が付与されることを発表しました。

Googleは5月、「この画像について」機能を発表しました。この機能により、ユーザーは画像がGoogleに初めて表示された日時と、どこで表示される可能性があるかを確認できます。また、Googleは、AIが生成したすべての画像について、元のファイルにマークアップを追加し、他のウェブサイトやプラットフォームで画像が見つかった場合に「コンテキストを追加」できるようにすると発表しました。

テクノロジー企業はAI生成画像やデジタルメディアの完全性に関する懸念に対処しようと努めていますが、専門家は、企業が相互に、そして政府と協力し、問題を解決する必要があると強調しています。しかし、テクノロジー企業はリスクを顧みず、AI開発に邁進し続けています。

[広告2]

ソースリンク

コメント (0)