|

អ្នកប្រើប្រាស់អ៊ីនធឺណែតប្រើប្រាស់ AI ដើម្បីបង្កើតរូបភាពនៃជនសង្ស័យឃាតកម្មរបស់ Charlie Kirk ។ រូបថត៖ CBC ។ |

ការិយាល័យស៊ើបអង្កេតសហព័ន្ធអាមេរិក (FBI) បានចេញផ្សាយរូបថតចំនួនពីរដែលបង្ហាញពីជនសង្ស័យពាក់ព័ន្ធនឹងការបាញ់សម្លាប់សកម្មជន Charlie Kirk ។ ដោយសារតែរូបថតមានភាពមិនច្បាស់ សហគមន៍អនឡាញបានឆ្លើយតបយ៉ាងឆាប់រហ័សជាមួយនឹងកំណែ "អាប់ដេត" នៃរូបថតដោយប្រើបញ្ញាសិប្បនិម្មិត (AI)។

រូបភាពទាំងនេះមើលទៅច្បាស់ និងច្បាស់ជាងរូបភាពដើម ប៉ុន្តែតាមពិតវាគ្រាន់តែជាផលិតផលនៃការរំពឹងទុកប៉ុណ្ណោះ។ AI មិនមានសមត្ថភាពក្នុងការ " ស្វែងរក " ព័ត៌មានលម្អិតដែលលាក់នៅក្នុងរូបថតព្រិលៗនោះទេ។ ផ្ទុយទៅវិញ ឧបករណ៍ព្យាករណ៍ បំពេញចន្លោះដែលផ្អែកលើទិន្នន័យដែលបានសិក្សា ដែលអាចមានន័យថាបង្កើតព័ត៌មានលម្អិតដែលមិនមាននៅក្នុងការពិត។

|

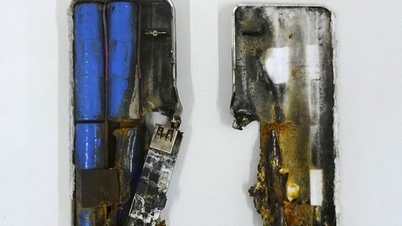

រូបថតដែលបានពង្រឹង AI របស់ជនសង្ស័យនៅក្នុងការបាញ់ប្រហារ Charlie Kirk ប៉ុន្តែមិនមានមុខពីរដូចគ្នានោះទេ។ រូបថត៖ Grok ។ |

កំណែប្រសើរឡើងជាច្រើននៃរូបភាពត្រូវបានបង្ហោះនៅក្រោមការបង្ហោះរបស់ FBI ។ រូបភាពមួយចំនួនអាចត្រូវបានបង្កើតឡើងដោយប្រើឧបករណ៍ Grok នៅលើ X ខណៈដែលរូបភាពផ្សេងទៀតត្រូវបានគេជឿថាត្រូវបានបង្កើតដោយប្រើវេទិកាដូចជា ChatGPT និង Gemini ។ ទោះយ៉ាងណាក៏ដោយ ភាពត្រឹមត្រូវនៃការបង្ហាញទាំងនេះប្រែប្រួលយ៉ាងខ្លាំង។ រូបភាពខ្លះថែមទាំងបង្ហាញពីភាពមិនត្រឹមត្រូវជាក់ស្តែង ដូចជាការផ្លាស់ប្តូរពណ៌នៃអាវ ឬធ្វើឱ្យមុខរបស់តួអង្គមើលទៅប្លែកជាមួយនឹងចង្កាបំផ្លើស។

វាហាក់ដូចជារូបភាពទាំងនេះត្រូវបានចែករំលែកជាមួយនឹងហេតុផលនៃការ "ជួយ" សហគមន៍កំណត់អត្តសញ្ញាណជនសង្ស័យ។ ប៉ុន្តែការពិត ពួកគេក៏បានក្លាយជាឧបករណ៍មួយសម្រាប់ទាក់ទាញចំណាប់អារម្មណ៍ បង្កើនការចូលចិត្ត និងការចែករំលែកនៅលើបណ្តាញសង្គម។

អ្នកជំនាញព្រមានថា វាមិនទំនងថារូបភាព AI ទាំងនេះនឹងមានប្រយោជន៍ជាងរូបភាពដើមរបស់ FBI នោះទេ។ ជាការពិត នៅក្នុងករណីមួយចំនួនកន្លងមក រូបភាពដែលពង្រឹង AI បានបង្កើតលទ្ធផលដ៏ចម្រូងចម្រាស។

ជាឧទាហរណ៍ រូបថតដែលមានភាពច្បាស់ទាបរបស់អតីតប្រធានាធិបតី បារ៉ាក់ អូបាម៉ា ត្រូវបាន AI "ធ្វើឱ្យប្រសើរឡើង" ដើម្បីបង្ហាញបុរសស្បែកស។ ក្នុងករណីមួយទៀត រូបថតរបស់លោកប្រធានាធិបតី Donald Trump មានដុំសាច់ដែលមិនមានស្រាប់បន្ថែមលើក្បាលរបស់លោកដោយ AI។

ភាពមិនស្របគ្នាទាំងនេះបង្ហាញថា AI គឺគ្រាន់តែបន្ថែមពីទិន្នន័យដែលមានស្រាប់ ជាជាងបង្កើតឡើងវិញនូវអ្វីដែលបាត់បង់នៅក្នុងរូបភាពមិនច្បាស់។ ខណៈពេលដែលបច្ចេកវិទ្យាអាចមានប្រយោជន៍ក្នុងបរិបទមួយចំនួន រូបភាពដែលបង្កើតដោយ AI មិនគួរត្រូវបានចាត់ទុកថាជាភស្តុតាងច្បាស់លាស់ក្នុងការស៊ើបអង្កេតឧក្រិដ្ឋកម្មនោះទេ។

FBI ខ្លួនឯងក្នុងសេចក្តីប្រកាសរបស់ខ្លួនបានបញ្ចេញតែរូបថតដើមប៉ុណ្ណោះ ហើយបានអំពាវនាវដល់សាធារណជនឱ្យផ្តល់ព័ត៌មានប្រសិនបើពួកគេអាចកំណត់អត្តសញ្ញាណមនុស្សក្នុងរូបថតនោះបាន។ ទោះជាយ៉ាងណាក៏ដោយ រលកនៃ "រូបថតធ្វើឱ្យប្រសើរដោយខ្លួនឯង" នៅលើបណ្តាញសង្គមបានទាក់ទាញការចាប់អារម្មណ៍យ៉ាងឆាប់រហ័ស ដោយបានចោទជាសំណួរអំពីទំនួលខុសត្រូវនៃការប្រើប្រាស់ឧបករណ៍ AI ក្នុងករណីរសើបទាក់ទងនឹងសន្តិសុខ និងជីវិតមនុស្ស។

នៅពេលដែលបញ្ញាសិប្បនិមិត្តត្រូវបានប្រើប្រាស់យ៉ាងទូលំទូលាយ ឧប្បត្តិហេតុនេះបង្ហាញពីបញ្ហាមួយ៖ AI អាចបង្កើតរូបភាពដែលមើលទៅដូចពិតៗ ដែលពួកវាអាចមើលងាយបាន ប៉ុន្តែមិនមែនមានន័យថាវាគួរឱ្យទុកចិត្តនោះទេ។ ជាពិសេសនៅក្នុងការស្វែងរកឧក្រិដ្ឋជន ទិន្នន័យមិនត្រឹមត្រូវអាចនាំទៅរកផលវិបាកធ្ងន់ធ្ងរ។

ប្រភព៖ https://znews.vn/hinh-anh-nghi-pham-am-sat-charlie-kirk-bi-lam-gia-post1584664.html

![[រូបថត] ខួបលើកទី 60 នៃការបង្កើតសមាគមវិចិត្រករថតរូបវៀតណាម](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F05%2F1764935864512_a1-bnd-0841-9740-jpg.webp&w=3840&q=75)

![[រូបថត] ប្រធានរដ្ឋសភាលោក Tran Thanh Man ចូលរួមពិធីប្រគល់រង្វាន់ VinFuture 2025](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F05%2F1764951162416_2628509768338816493-6995-jpg.webp&w=3840&q=75)

Kommentar (0)