ការផ្ទុះនៃបញ្ញាសិប្បនិមិត្ត (AI) នាំមកនូវអត្ថប្រយោជន៍ដ៏អស្ចារ្យដល់មនុស្សជាតិ ប៉ុន្តែក៏មានផលវិបាកជាច្រើនរាប់មិនអស់ផងដែរ៖ ពីការរើសអើងពូជសាសន៍ ការក្លែងបន្លំតាមអ៊ីនធឺណិតដ៏ស្មុគ្រស្មាញ រហូតដល់ហានិភ័យនៃបណ្តាប្រទេសកំពុងអភិវឌ្ឍក្លាយជា "អណ្តូងរ៉ែទិន្នន័យ" ថោក។

ដោយសារការពិតនោះ តើការប្រើប្រាស់ AI ប្រកបដោយទំនួលខុសត្រូវគួរតែជាការស្ម័គ្រចិត្ត ឬជាកាតព្វកិច្ច? តើវៀតណាមគួរធ្វើដូចម្តេចនៅពេលសាងសង់ច្រករបៀងស្របច្បាប់សម្រាប់វិស័យនេះ?

នៅខាងក្រៅព្រឹត្តិការណ៍ VinFuture Science and Technology Week អ្នកយកព័ត៌មានបានសន្ទនាជាមួយសាស្រ្តាចារ្យ Toby Walsh - University of New South Wales (Australia) អ្នកសិក្សានៃសមាគមកុំព្យូទ័រអាមេរិក។

សាស្រ្តាចារ្យផ្តល់នូវការយល់ដឹងអំពីរបៀបដែលយើង "ប្រព្រឹត្ត" ជាមួយ AI ពីការកាន់ "ម៉ាស៊ីន" ទទួលខុសត្រូវចំពោះគន្លឹះសម្រាប់គ្រួសារដើម្បីការពារខ្លួនពីរលកនៃការបោកប្រាស់បច្ចេកវិទ្យាខ្ពស់។

តើអ្នកណាទទួលខុសត្រូវចំពោះ AI?

សាស្រ្តាចារ្យ តើការប្រើប្រាស់ AI ប្រកបដោយទំនួលខុសត្រូវ គួរតែជាការស្ម័គ្រចិត្ត ឬជាកាតព្វកិច្ច? ហើយតើយើងគួរមានអាកប្បកិរិយាយ៉ាងណាចំពោះ AI?

- ខ្ញុំជឿជាក់យ៉ាងមុតមាំថាការប្រើប្រាស់ AI ប្រកបដោយការទទួលខុសត្រូវគួរតែជាកាតព្វកិច្ច ។ មានការលើកទឹកចិត្តដ៏ច្របូកច្របល់ក្នុងការលេង ជាមួយនឹង ចំនួនទឹកប្រាក់ដ៏ច្រើនត្រូវបានធ្វើឡើងជាមួយ AI ហើយមធ្យោបាយតែមួយគត់ដើម្បីធានានូវអាកប្បកិរិយាត្រឹមត្រូវគឺត្រូវដាក់បទបញ្ជាតឹងរ៉ឹង ដូច្នេះ ផលប្រយោជន៍សាធារណៈតែងតែមានតុល្យភាពជាមួយនឹងផលប្រយោជន៍ពាណិជ្ជកម្ម ។

ពេល AI ធ្វើខុស តើអ្នកណាទទួលខុសត្រូវ? ជាពិសេសជាមួយភ្នាក់ងារ AI តើយើងមានសមត្ថភាពក្នុងការជួសជុលយន្តការប្រតិបត្តិការរបស់ពួកគេទេ?

បញ្ហាស្នូលជាមួយ AI ធ្វើឱ្យមានកំហុសគឺថាយើងមិនអាចទទួលខុសត្រូវ AI បានទេ។ AI មិនមែនជាមនុស្សទេ ហើយនេះជាកំហុសនៅគ្រប់ប្រព័ន្ធច្បាប់ក្នុង ពិភពលោក ។ មានតែមនុស្សទេដែលអាចទទួលខុសត្រូវចំពោះការសម្រេចចិត្ត និងសកម្មភាពរបស់ពួកគេ។

ភ្លាមៗនោះ យើងមាន “ភ្នាក់ងារ” ថ្មី AI ដែលអាច—ប្រសិនបើយើងអនុញ្ញាត—ធ្វើការសម្រេចចិត្ត និងធ្វើសកម្មភាពនៅក្នុងពិភពលោករបស់យើង ដែលបង្កបញ្ហា៖ តើយើងនឹងទទួលខុសត្រូវលើអ្នកណា?

ចម្លើយគឺ៖ ក្រុមហ៊ុនដែលដាក់ពង្រាយ និងដំណើរការប្រព័ន្ធ AI ត្រូវតែទទួលខុសត្រូវចំពោះផលវិបាកដែលបណ្តាលឱ្យ "ម៉ាស៊ីន" ទាំងនេះ។

ក្រុមហ៊ុនជាច្រើនក៏និយាយអំពី AI ដែលមានទំនួលខុសត្រូវផងដែរ។ តើយើងអាចទុកចិត្តពួកគេដោយរបៀបណា? តើយើងធ្វើដូចម្តេចទើបដឹងថាពួកគេមានភាពម៉ឺងម៉ាត់ និងទូលំទូលាយ ហើយមិនមែនគ្រាន់តែប្រើ "AI ប្រកបដោយទំនួលខុសត្រូវ" ជាល្បិចទីផ្សារនោះទេ?

- យើងត្រូវបង្កើនតម្លាភាព។ វាមានសារៈសំខាន់ណាស់ក្នុងការយល់ដឹងអំពីសមត្ថភាព និងដែនកំណត់នៃប្រព័ន្ធ AI ។ យើងក៏គួរតែ "បោះឆ្នោតដោយធ្វើ" ពោលគឺជ្រើសរើសប្រើប្រាស់សេវាកម្មប្រកបដោយទំនួលខុសត្រូវ។

ខ្ញុំពិតជាជឿថារបៀបដែលអាជីវកម្មប្រើប្រាស់ AI ប្រកបដោយទំនួលខុសត្រូវនឹងក្លាយទៅជាភាពខុសគ្នានៅក្នុងទីផ្សារ ដោយផ្តល់ឱ្យពួកគេនូវអត្ថប្រយោជន៍ពាណិជ្ជកម្ម។

ប្រសិនបើក្រុមហ៊ុនគោរពទិន្នន័យអតិថិជន វានឹងផ្តល់អត្ថប្រយោជន៍ និងទាក់ទាញអតិថិជន។ អាជីវកម្មនឹងដឹងថាការធ្វើអ្វីដែលត្រឹមត្រូវមិនត្រឹមតែមានសីលធម៌ប៉ុណ្ណោះទេ ប៉ុន្តែថែមទាំងជួយឱ្យពួកគេទទួលបានជោគជ័យថែមទៀត។ ខ្ញុំយល់ឃើញថានេះជាមធ្យោបាយមួយក្នុងការបែងចែករវាងអាជីវកម្ម ហើយអាជីវកម្មដែលមានទំនួលខុសត្រូវ គឺជាអាជីវកម្មដែលយើងអាចមានអារម្មណ៍ស្រួលក្នុងការធ្វើអាជីវកម្មជាមួយ។

វៀតណាមត្រូវការពារយ៉ាងសកម្មនូវតម្លៃវប្បធម៌។

វៀតណាមជាប្រទេសមួយក្នុងចំណោមប្រទេសមួយចំនួនដែលពិចារណាលើការប្រកាសឱ្យប្រើច្បាប់ស្តីពីការស៊ើបអង្កេតសិប្បនិម្មិត។ តើអ្វីជាការវាយតម្លៃរបស់អ្នកចំពោះការនេះ? តាមគំនិតរបស់អ្នក សម្រាប់ប្រទេសកំពុងអភិវឌ្ឍន៍ដូចជាវៀតណាម តើមានបញ្ហាប្រឈមអ្វីខ្លះទាក់ទងនឹងក្រមសីលធម៌ និងសុវត្ថិភាពក្នុងការអភិវឌ្ឍន៍ AI?

- ខ្ញុំសប្បាយចិត្តណាស់ដែលវៀតណាមជាប្រទេសត្រួសត្រាយផ្លូវមួយដែលនឹងមានច្បាប់ឯកទេសស្តីពីបញ្ញាសិប្បនិមិត្ត។ នេះគឺសំខាន់ណាស់ព្រោះប្រទេសនីមួយៗមានតម្លៃ និងវប្បធម៌រៀងៗខ្លួន ហើយត្រូវការច្បាប់ដើម្បីការពារតម្លៃទាំងនោះ។

តម្លៃនិងវប្បធម៌វៀតណាមខុសពីអូស្ត្រាលី ចិន និងអាមេរិក។ យើងមិនអាចរំពឹងថាក្រុមហ៊ុនបច្ចេកវិទ្យាមកពីប្រទេសចិន ឬសហរដ្ឋអាមេរិកនឹងការពារវប្បធម៌ និងភាសាវៀតណាមដោយស្វ័យប្រវត្តិនោះទេ។ វៀតណាមត្រូវតែមានគំនិតផ្តួចផ្តើមដើម្បីការពាររបស់ទាំងនេះ។

ខ្ញុំចាំថាកាលពីអតីតកាលប្រទេសកំពុងអភិវឌ្ឍន៍ជាច្រើនបានឆ្លងកាត់សម័យអាណានិគមរូបវន្ត។ ប្រសិនបើយើងមិនប្រយ័ត្ន នោះយើងអាចឆ្លងកាត់រយៈពេលនៃ "អាណានិគមឌីជីថល"។ ទិន្នន័យរបស់អ្នកនឹងត្រូវបានកេងប្រវ័ញ្ច ហើយអ្នកនឹងក្លាយជាធនធានថោក។

នេះគឺមានគ្រោះថ្នាក់ប្រសិនបើប្រទេសកំពុងអភិវឌ្ឍន៍អភិវឌ្ឍឧស្សាហកម្ម AI តាមរបៀបដែលទាញយកតែទិន្នន័យដោយមិនគ្រប់គ្រងឬការពារផលប្រយោជន៍ផ្ទាល់ខ្លួនរបស់ពួកគេ។

ដូច្នេះតើធ្វើដូចម្តេចដើម្បីយកឈ្នះស្ថានភាពនេះ?

- វាសាមញ្ញ៖ វិនិយោគលើមនុស្ស។ មនុស្សដែលមានជំនាញខ្ពស់ ត្រូវប្រាកដថាពួកគេយល់ពី AI ។ គាំទ្រសហគ្រិន ក្រុមហ៊ុន AI គាំទ្រសាកលវិទ្យាល័យ។ សកម្ម។ ជំនួសឱ្យការរង់ចាំឱ្យប្រទេសផ្សេងទៀតផ្ទេរបច្ចេកវិទ្យា ឬណែនាំយើង យើងត្រូវសកម្ម និងធ្វើជាម្ចាស់លើបច្ចេកវិទ្យា។

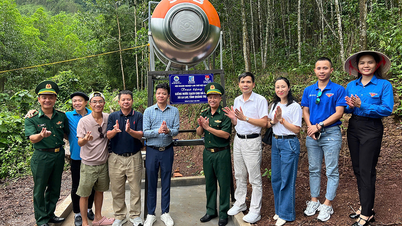

សាស្ត្រាចារ្យ Toby Walsh ចែករំលែកនៅ VinFuture Science and Technology Week (រូបថត៖ គណៈកម្មាធិការរៀបចំ)។

ទីពីរ យើងត្រូវតស៊ូមតិយ៉ាងមុតមាំសម្រាប់វេទិកាប្រព័ន្ធផ្សព្វផ្សាយសង្គម ដើម្បីបង្កើតបរិយាកាសសុវត្ថិភាពសម្រាប់អ្នកប្រើប្រាស់នៅក្នុងប្រទេសវៀតណាម ខណៈពេលដែលមិនប៉ះពាល់ដល់លទ្ធិប្រជាធិបតេយ្យរបស់ប្រទេស។

តាមពិត មានឧទាហរណ៍ជាច្រើនអំពីរបៀបដែលខ្លឹមសារប្រព័ន្ធផ្សព្វផ្សាយសង្គមបានជះឥទ្ធិពលដល់លទ្ធផលបោះឆ្នោត ប្រទេសដែលបែកបាក់គ្នា និងសូម្បីតែញុះញង់ឱ្យមានអំពើភេរវកម្ម។

ខ្ញុំបានចំណាយពេល 40 ឆ្នាំដើម្បីធ្វើការលើបញ្ញាសិប្បនិម្មិត។ ក្នុងរយៈពេល 30 ឆ្នាំដំបូង ខ្ញុំមានការព្រួយបារម្ភអំពីវិធីធ្វើឱ្យ AI កាន់តែមានឥទ្ធិពល។ ក្នុងរយៈពេល 10 ឆ្នាំចុងក្រោយនេះ ខ្ញុំបានចាប់អារម្មណ៍កាន់តែខ្លាំងឡើង និងបញ្ចេញសម្លេងអំពីការអភិវឌ្ឍន៍ AI ប្រកបដោយទំនួលខុសត្រូវ។

តើលោកអាចផ្តល់យោបល់បានខ្លះទេ ខណៈដែលប្រទេសវៀតណាមកំពុងស្ថិតក្នុងដំណើរការនៃសេចក្តីព្រាងច្បាប់ស្តីពីការស៊ើបអង្កេតសិប្បនិម្មិត?

- មានករណីជាច្រើនដែលច្បាប់ថ្មីមិនចាំបាច់។ យើងមានច្បាប់ឯកជនភាព យើងមានច្បាប់ប្រកួតប្រជែងរួចហើយ។ ច្បាប់ដែលមានស្រាប់ទាំងនេះអនុវត្តចំពោះលំហឌីជីថល ដូចដែលពួកគេអនុវត្តចំពោះពិភពរូបវន្ត។

វាមានសារៈសំខាន់ណាស់ក្នុងការអនុវត្តច្បាប់ទាំងនេះយ៉ាងតឹងរ៉ឹងនៅក្នុងបរិយាកាសឌីជីថល ដូចដែលយើងធ្វើនៅក្នុងបរិយាកាសរូបវន្ត។

ទោះយ៉ាងណាក៏ដោយ មានហានិភ័យថ្មីមួយចំនួនដែលកំពុងលេចឡើង ហើយយើងកំពុងចាប់ផ្តើមមើលឃើញនោះ។ មនុស្សចាប់ផ្តើមបង្កើតទំនាក់ទំនងជាមួយ AI ដោយប្រើ AI ជាអ្នកព្យាបាល ហើយពេលខ្លះវានឹងបង្កគ្រោះថ្នាក់ដល់អ្នកប្រើប្រាស់ ដូច្នេះយើងត្រូវប្រុងប្រយ័ត្ន។

យើងតែងតែទទួលខុសត្រូវចំពោះក្រុមហ៊ុនផលិតនៅពេលពួកគេបញ្ចេញផលិតផល។ ឧទាហរណ៍ ប្រសិនបើក្រុមហ៊ុន AI បញ្ចេញផលិតផល AI ដែលបង្កគ្រោះថ្នាក់ដល់មនុស្ស ពួកគេគួរតែទទួលខុសត្រូវផងដែរ។

ដូច្នេះតើយើងអាចការពារ AI ពីការបង្កផលប៉ះពាល់ដល់កុមារ និងបង្កើតបរិយាកាសសុវត្ថិភាពសម្រាប់កុមារនៅពេលណាដែល AI លេចឡើង?

- ខ្ញុំគិតថាយើងមិនបានរៀនមេរៀនច្រើនពីប្រព័ន្ធផ្សព្វផ្សាយសង្គម។ ប្រទេសជាច្រើនឥឡូវនេះចាប់ផ្តើមដឹងថាប្រព័ន្ធផ្សព្វផ្សាយសង្គមមានអត្ថប្រយោជន៍ដ៏អស្ចារ្យ ប៉ុន្តែក៏មានគុណវិបត្តិជាច្រើនផងដែរ ជាពិសេសផលប៉ះពាល់លើសុខភាពផ្លូវចិត្ត កម្រិតថប់បារម្ភ និងរូបភាពរាងកាយរបស់មនុស្សវ័យក្មេង ជាពិសេសក្មេងស្រី។

ប្រទេសជាច្រើនបានចាប់ផ្តើមអនុវត្តវិធានការដើម្បីដោះស្រាយបញ្ហានេះ។ នៅប្រទេសអូស្ត្រាលី ការកំណត់អាយុសម្រាប់ការប្រើប្រាស់ប្រព័ន្ធផ្សព្វផ្សាយសង្គមនឹងចូលជាធរមាននៅថ្ងៃទី 10 ខែធ្នូ។ ខ្ញុំគិតថាយើងត្រូវការវិធានការស្រដៀងគ្នាសម្រាប់ AI ។

យើងកំពុងបង្កើតឧបករណ៍ដែលអាចមានឥទ្ធិពលវិជ្ជមាន ប៉ុន្តែក៏អាចបង្កគ្រោះថ្នាក់ផងដែរ ហើយយើងត្រូវការពារចិត្ត និងបេះដូងរបស់កូនៗយើងពីផលប៉ះពាល់អវិជ្ជមានទាំងនេះ។

លើសពីនេះ ខ្ញុំសង្ឃឹមថាប្រទេសនានានឹងចេញបទប្បញ្ញត្តិដ៏តឹងរឹងដើម្បីគ្រប់គ្រងបណ្តាញសង្គម ដោយហេតុនេះបង្កើតបរិយាកាសសុវត្ថិភាពពិតប្រាកដសម្រាប់មនុស្សគ្រប់គ្នានៅពេលប្រើប្រាស់ AI ។

ជាការពិត មិនត្រឹមតែកុមារប៉ុណ្ណោះទេ ថែមទាំងមនុស្សពេញវ័យផងដែរ កំពុងប្រឈមមុខនឹងហានិភ័យដែលបណ្តាលមកពី AI ផ្ទាល់។ ដូច្នេះ តើមនុស្សអាចប្រើ AI ដើម្បីកែលម្អជីវិតរបស់ពួកគេដោយរបៀបណា ហើយមិនមានគ្រោះថ្នាក់?

- AI ត្រូវបានគេអនុវត្តក្នុងវិស័យជាច្រើនជួយលើកកម្ពស់គុណភាពជីវិតរបស់យើង។ នៅក្នុងវេជ្ជសាស្ត្រ AI ជួយស្វែងរកថ្នាំថ្មីៗ។ នៅក្នុង ការអប់រំ AI ក៏នាំមកនូវអត្ថប្រយោជន៍វិជ្ជមានជាច្រើនផងដែរ។

ទោះជាយ៉ាងណាក៏ដោយ ការផ្តល់សិទ្ធិចូលប្រើ AI ដោយគ្មានការការពារគ្រប់គ្រាន់គឺមានគ្រោះថ្នាក់ខ្លាំងពេក។ យើងបានឃើញបណ្តឹងនៅសហរដ្ឋអាមេរិក ដែលឪពុកម្តាយប្តឹងក្រុមហ៊ុនបច្ចេកវិទ្យា ដែលជំរុញកូនរបស់ពួកគេឱ្យធ្វើអត្តឃាត បន្ទាប់ពីមានទំនាក់ទំនងជាមួយ AI chatbots ។

ទោះបីជាភាគរយនៃអ្នកប្រើប្រាស់ ChatGPT ដែលជួបប្រទះបញ្ហាសុខភាពផ្លូវចិត្តមានត្រឹមតែពីរបីភាគរយប៉ុណ្ណោះ ជាមួយនឹងអ្នកប្រើប្រាស់រាប់រយលាននាក់ ប៉ុន្តែចំនួនពិតប្រាកដគឺរាប់សែននាក់។

ទិន្នន័យមានសារៈសំខាន់ខ្លាំងណាស់សម្រាប់ការអភិវឌ្ឍន៍ AI ប៉ុន្តែតាមទស្សនៈនៃការគ្រប់គ្រង ប្រសិនបើការគ្រប់គ្រងទិន្នន័យមានភាពតឹងតែងពេក វានឹងរារាំងដល់ការអភិវឌ្ឍន៍ AI ។ តាមគំនិតរបស់អ្នក តើគ្រោះថ្នាក់អ្វីខ្លះដែលអាចធ្វើឱ្យការគ្រប់គ្រងទិន្នន័យធូររលុង? តើធ្វើដូចម្តេចដើម្បីធ្វើសមតុល្យការប្រមូលទិន្នន័យ ការគ្រប់គ្រងទិន្នន័យប្រកបដោយសុវត្ថិភាព ជាមួយនឹងការបង្កើតការអភិវឌ្ឍន៍សម្រាប់ AI?

- ខ្ញុំយល់ស្របទាំងស្រុង។ ទិន្នន័យគឺជាបេះដូងនៃដំណើរការ AI ព្រោះ វាជាទិន្នន័យដែលជំរុញវា។ បើគ្មានទិន្នន័យទេ យើងនឹងមិនដំណើរការអ្វីឡើយ។ ទិន្នន័យដែលមានគុណភាពខ្ពស់គឺជាស្នូលនៃអ្វីគ្រប់យ៉ាងដែលយើងធ្វើ។ ជាការពិត តម្លៃពាណិជ្ជកម្ម និងអត្ថប្រយោជន៍ប្រកួតប្រជែងដែលក្រុមហ៊ុនទទួលបានគឺមកពីទិន្នន័យ។ មិនថាយើងមានទិន្នន័យគុណភាព ឬអត់នោះទេ នោះគឺជាបញ្ហាសំខាន់។

វាជាការខឹងសម្បារក្នុងការឃើញសៀវភៅរបស់អ្នកនិពន្ធជុំវិញពិភពលោក រួមទាំងខ្ញុំផងដែរ ដែលត្រូវបានប្រើប្រាស់ដោយគ្មានការអនុញ្ញាត និងដោយគ្មានសំណង។ វាជាអំពើលួចផលនៃពលកម្មអ្នកដទៃ។ ប្រសិនបើស្ថានភាពនេះនៅតែបន្ត អ្នកនិពន្ធនឹងបាត់បង់កម្លាំងចិត្តក្នុងការសរសេរសៀវភៅ ហើយយើងនឹងបាត់បង់តម្លៃវប្បធម៌ដែលយើងស្រលាញ់។

យើងត្រូវស្វែងរកដំណោះស្រាយសមធម៌ជាងអ្វីដែលយើងមាននៅពេលនេះ។

ឥឡូវនេះ “Silicon Valley” ទទួលយកខ្លឹមសារ និងការច្នៃប្រឌិតពីអ្នកនិពន្ធដោយមិនចាំបាច់បង់ប្រាក់សម្រាប់វា – នេះគឺគ្មាននិរន្តរភាពទេ។ ខ្ញុំប្រៀបធៀបស្ថានភាពបច្ចុប្បន្នទៅនឹង Napster និងថ្ងៃដំបូងនៃតន្ត្រីអនឡាញក្នុងទសវត្សរ៍ឆ្នាំ 2000 ។ កាលនោះ តន្ត្រីអនឡាញត្រូវបាន "លួច" ទាំងអស់ ប៉ុន្តែវាមិនអាចស្ថិតស្ថេរជារៀងរហូតបានទេ ពីព្រោះតន្ត្រីករត្រូវការប្រាក់ចំណូលដើម្បីបន្តបង្កើត។

ជាចុងក្រោយ យើងមានប្រព័ន្ធស្ទ្រីមបង់ប្រាក់ ដូចជា Spotify ឬ Apple Music ឬតន្ត្រីដែលគាំទ្រការផ្សាយពាណិជ្ជកម្ម ជាមួយនឹងចំណែកនៃប្រាក់ចំណូលនឹងត្រលប់ទៅសិល្បករវិញ។ យើងត្រូវធ្វើដូចគ្នាជាមួយសៀវភៅ ដូច្នេះអ្នកនិពន្ធទទួលបានតម្លៃពីទិន្នន័យរបស់ពួកគេ។ បើមិនដូច្នេះទេ គ្មាននរណាម្នាក់នឹងមានការលើកទឹកចិត្តក្នុងការសរសេរសៀវភៅនោះទេ ហើយពិភពលោកនឹងកាន់តែអាក្រក់ទៅៗ បើគ្មានសៀវភៅថ្មីត្រូវបានសរសេរ។

ក្នុងក្របខ័ណ្ឌនៃសប្តាហ៍វិទ្យាសាស្ត្រ និងបច្ចេកវិទ្យា VinFuture ការតាំងពិព័រណ៍ "Toa V - Touchpoint of Science" ក៏នឹងប្រព្រឹត្តទៅនៅមជ្ឈមណ្ឌលសិល្បៈសហសម័យ Vincom Royal City (រូបថត៖ គណៈកម្មាធិការរៀបចំ)។

AI មានការអភិវឌ្ឍន៍ខ្លាំងនៅប្រទេសវៀតណាម។ នាពេលថ្មីៗនេះ វៀតណាមមានគោលនយោបាយជាច្រើនក្នុងការលើកកម្ពស់ AI ប៉ុន្តែវៀតណាមក៏កំពុងប្រឈមមុខនឹងបញ្ហាដែរ នោះគឺការក្លែងបន្លំដែលបណ្តាលមកពី AI ។ ដូច្នេះ បើតាមលោកសាស្ត្រាចារ្យ តើវៀតណាមគួរដោះស្រាយស្ថានភាពបែបណា? តើអ្វីជាដំបូន្មានរបស់សាស្រ្តាចារ្យសម្រាប់អ្នកដែលកំពុងប្រើប្រាស់ AI សព្វថ្ងៃនេះ ដើម្បីធានាសុវត្ថិភាព និងការពារទិន្នន័យរបស់ពួកគេ?

- សម្រាប់បុគ្គលម្នាក់ៗ ខ្ញុំគិតថាវិធីសាមញ្ញបំផុតគឺផ្ទៀងផ្ទាត់ព័ត៌មាន។ ឧទាហរណ៍ នៅពេលទទួលការហៅទូរសព្ទ ឬអ៊ីមែល ឧទាហរណ៍ពីធនាគារ យើងត្រូវពិនិត្យម្តងទៀត៖ យើងអាចទូរស័ព្ទទៅលេខអតិថិជននោះមកវិញ ឬទាក់ទងធនាគារដោយផ្ទាល់ដើម្បីផ្ទៀងផ្ទាត់ព័ត៌មាន។

មានអ៊ីមែលក្លែងក្លាយ លេខទូរស័ព្ទក្លែងក្លាយ សូម្បីតែការហៅ Zoom ក្លែងក្លាយជាច្រើនសព្វថ្ងៃនេះ។ ការបោកប្រាស់ទាំងនេះគឺសាមញ្ញ តម្លៃថោក ហើយមិនចំណាយពេលច្រើនទេ។

នៅក្នុងគ្រួសាររបស់ខ្ញុំ យើងក៏មានវិធានការសុវត្ថិភាពផ្ទាល់ខ្លួនរបស់យើងផងដែរ៖ “សំណួរសម្ងាត់” ដែលមានតែសមាជិកគ្រួសារប៉ុណ្ណោះដែលដឹង ដូចជាឈ្មោះទន្សាយសត្វចិញ្ចឹមរបស់យើង។ នេះធានាថាព័ត៌មានសំខាន់ៗស្ថិតនៅក្នុងគ្រួសារ និងមិនត្រូវបានលេចធ្លាយចេញមកក្រៅឡើយ។

វៀតណាមក៏បានបញ្ចូលការអប់រំ AI នៅក្នុងការអប់រំទូទៅផងដែរ ដូច្នេះតើអ្វីគួរកត់សម្គាល់នៅក្នុងដំណើរការនោះ?

- AI ផ្លាស់ប្តូរអ្វីដែលត្រូវបានបង្រៀន និងរបៀបដែលវាត្រូវបានបង្រៀន។ វាប៉ះពាល់ដល់ជំនាញសំខាន់ៗនៃអនាគត ដូចជាការគិតរិះគន់ ជំនាញទំនាក់ទំនង ភាពវៃឆ្លាតក្នុងសង្គម និងបញ្ញាអារម្មណ៍។ ជំនាញទាំងនេះនឹងក្លាយជាចាំបាច់។

AI អាចជួយក្នុងការបង្រៀនជំនាញទាំងនេះ ឧទាហរណ៍ដូចជាគ្រូបង្រៀនផ្ទាល់ខ្លួន ជំនួយការសិក្សាផ្ទាល់ខ្លួន ការផ្តល់ឧបករណ៍អប់រំដ៏មានប្រសិទ្ធភាពតាមរយៈកម្មវិធី AI ។

សូមអរគុណលោកសាស្ត្រាចារ្យ ដែលបានចំណាយពេលវេលាសម្រាប់ការជជែករបស់យើង!

ប្រភព៖ https://dantri.com.vn/cong-nghe/viet-nam-can-lam-gi-de-tranh-nguy-co-tro-thanh-nguon-luc-re-tien-20251203093314154.htm

![[រូបថត] ក្បួនដង្ហែដើម្បីអបអរសាទរខួបលើកទី 50 នៃទិវាជាតិរបស់ប្រទេសឡាវ](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F02%2F1764691918289_ndo_br_0-jpg.webp&w=3840&q=75)

Kommentar (0)