|

Anthropic ຫາກໍ່ປັບປຸງນະໂຍບາຍໃຫມ່ຂອງຕົນ. ພາບ: GK Images . |

ໃນວັນທີ 28 ສິງຫາ, ບໍລິສັດ AI Anthropic ໄດ້ປະກາດການປັບປຸງເງື່ອນໄຂການໃຫ້ບໍລິການຂອງຜູ້ໃຊ້ແລະນະໂຍບາຍຄວາມເປັນສ່ວນຕົວ. ດຽວນີ້ຜູ້ໃຊ້ສາມາດເລືອກໃຊ້ຂໍ້ມູນຂອງເຂົາເຈົ້າເພື່ອປັບປຸງ Claude ແລະເສີມສ້າງການປ້ອງກັນການລ່ວງລະເມີດເຊັ່ນ: ການຫລອກລວງແລະການສໍ້ໂກງ.

ແຈ້ງການນີ້ຈະຖືກນຳອອກສູ່ chatbot ເລີ່ມແຕ່ວັນທີ 28 ສິງຫາ. ຜູ້ໃຊ້ມີເວລາໜຶ່ງເດືອນເພື່ອຍອມຮັບ ຫຼື ປະຕິເສດຂໍ້ກຳນົດ. ນະໂຍບາຍໃໝ່ຈະມີຜົນບັງຄັບໃຊ້ທັນທີເມື່ອໄດ້ຮັບການຍອມຮັບ. ຫຼັງຈາກວັນທີ 28 ກັນຍາ, ຜູ້ໃຊ້ຈະຕ້ອງເລືອກເຂົ້າເພື່ອສືບຕໍ່ນຳໃຊ້ Claude.

ການອັບເດດແມ່ນມີຄວາມໝາຍເພື່ອຊ່ວຍສົ່ງຕົວແບບ AI ທີ່ມີປະສິດທິພາບ ແລະມີປະໂຫຍດຫຼາຍຂຶ້ນ, ອີງຕາມບໍລິສັດ. ການປັບຕົວເລືອກນີ້ແມ່ນງ່າຍດາຍ ແລະສາມາດເຮັດໄດ້ທຸກເວລາໃນການຕັ້ງຄ່າຄວາມເປັນສ່ວນຕົວ.

ການປ່ຽນແປງເຫຼົ່ານີ້ກໍາລັງດໍາເນີນຢູ່ໃນແຜນການ Claude Free, Pro, ແລະ Max, ເຊິ່ງລວມມີ Claude Code, ເຄື່ອງມືການຂຽນໂປຼແກຼມຂອງ Anthropic. ການບໍລິການທີ່ຄຸ້ມຄອງໂດຍເງື່ອນໄຂການຄ້າຈະບໍ່ນໍາໃຊ້, ລວມທັງ Claude for Work, Claude Gov, Claude for Education, ຫຼືການນໍາໃຊ້ APIs, ລວມທັງຜ່ານພາກສ່ວນທີສາມເຊັ່ນ Amazon Bedrock ແລະ Vertex AI ຂອງ Google Cloud.

ໂດຍການເຂົ້າຮ່ວມ, Anthropic ກ່າວໃນການຕອບ blog ຂອງຕົນ, ຜູ້ໃຊ້ຈະຊ່ວຍປັບປຸງຄວາມປອດໄພຂອງຕົວແບບ, ເພີ່ມຄວາມສາມາດໃນການກວດສອບເນື້ອຫາທີ່ເປັນອັນຕະລາຍຢ່າງຖືກຕ້ອງແລະຫຼຸດຜ່ອນຄວາມສ່ຽງຕໍ່ການຜິດພາດໃນການສົນທະນາທີ່ບໍ່ເປັນອັນຕະລາຍ. ຮຸ່ນ Claude ໃນອະນາຄົດຍັງຈະໄດ້ຮັບການປັບປຸງດ້ວຍທັກສະເຊັ່ນການຂຽນໂປລແກລມ, ການວິເຄາະແລະການສົມເຫດສົມຜົນ.

ມັນເປັນສິ່ງສໍາຄັນທີ່ຜູ້ໃຊ້ມີການຄວບຄຸມຢ່າງເຕັມທີ່ກ່ຽວກັບຂໍ້ມູນຂອງເຂົາເຈົ້າ, ແລະບໍ່ວ່າຈະອະນຸຍາດໃຫ້ເວທີການນໍາໃຊ້ມັນຢູ່ໃນປ່ອງຢ້ຽມປ໊ອບອັບ. ບັນຊີໃຫມ່ສາມາດຕັ້ງຄ່າທາງເລືອກນີ້ໃນລະຫວ່າງຂະບວນການລົງທະບຽນ.

|

ປ່ອງຢ້ຽມປ໊ອບອັບເງື່ອນໄຂໃຫມ່ໃນ chatbot. ຮູບພາບ: Anthropic. |

ໄລຍະເວລາເກັບຮັກສາຂໍ້ມູນໄດ້ເພີ່ມຂຶ້ນເປັນຫ້າປີ, ເຊິ່ງໃຊ້ກັບການສົນທະນາໃຫມ່ຫຼືສືບຕໍ່ຫຼືກອງປະຊຸມການເຂົ້າລະຫັດ, ເຊັ່ນດຽວກັນກັບການຕອບສະຫນອງຕໍ່ການຕອບສະຫນອງຂອງ chatbot. ຂໍ້ມູນທີ່ຖືກລົບຈະບໍ່ໄດ້ຖືກນໍາໃຊ້ເພື່ອຝຶກອົບຮົມຮູບແບບໃນອະນາຄົດ. ຖ້າຜູ້ໃຊ້ບໍ່ເຂົ້າຮ່ວມການສະຫນອງຂໍ້ມູນສໍາລັບການຝຶກອົບຮົມ, ພວກເຂົາຈະສືບຕໍ່ກັບນະໂຍບາຍການເກັບຮັກສາ 30 ມື້ໃນປະຈຸບັນ.

ການອະທິບາຍນະໂຍບາຍ, Anthropic ກ່າວວ່າວົງຈອນການພັດທະນາ AI ໂດຍທົ່ວໄປແມ່ນໃຊ້ເວລາຫຼາຍປີ, ແລະການຮັກສາຂໍ້ມູນໃຫ້ສອດຄ່ອງຕະຫຼອດຂະບວນການຝຶກອົບຮົມຍັງຊ່ວຍໃຫ້ຕົວແບບຄົງທີ່. ການເກັບຮັກສາຂໍ້ມູນໄດ້ດົນຂຶ້ນຍັງຊ່ວຍປັບປຸງຕົວຈັດປະເພດ, ລະບົບທີ່ໃຊ້ເພື່ອກໍານົດພຶດຕິກໍາການລ່ວງລະເມີດ, ການກວດສອບຮູບແບບທີ່ເປັນອັນຕະລາຍ.

ບໍລິສັດຂຽນວ່າ "ເພື່ອປົກປ້ອງຄວາມເປັນສ່ວນຕົວຂອງຜູ້ໃຊ້, ພວກເຮົາໃຊ້ການປະສົມປະສານຂອງເຄື່ອງມືອັດຕະໂນມັດແລະຂະບວນການເພື່ອກັ່ນຕອງຫຼືປິດບັງຂໍ້ມູນທີ່ລະອຽດອ່ອນ. ພວກເຮົາບໍ່ໄດ້ຂາຍຂໍ້ມູນຜູ້ໃຊ້ໃຫ້ກັບພາກສ່ວນທີສາມ," ບໍລິສັດຂຽນ.

Anthropic ມັກຈະຖືກກ່າວເຖິງວ່າເປັນຫນຶ່ງໃນຜູ້ນໍາໃນ AI ທີ່ປອດໄພ. Anthropic ໄດ້ພັດທະນາວິທີການທີ່ເອີ້ນວ່າ AI ລັດຖະທໍາມະນູນ, ເຊິ່ງກໍານົດຫຼັກການດ້ານຈັນຍາບັນແລະຄໍາແນະນໍາທີ່ຕົວແບບຕ້ອງປະຕິບັດຕາມ. Anthropic ຍັງເປັນຫນຶ່ງໃນບໍລິສັດທີ່ໄດ້ລົງນາມໃນຄໍາຫມັ້ນສັນຍາ AI ທີ່ປອດໄພກັບ ລັດຖະບານ ສະຫະລັດ, ອັງກິດ, ແລະ G7.

ທີ່ມາ: https://znews.vn/cong-ty-ai-ra-han-cuoi-cho-nguoi-dung-post1580997.html

![[ຮູບພາບ] ຊາວຮ່າໂນ້ຍນອນຫຼັບທຸກຄືນເພື່ອລໍຖ້າການຊ້ອມຮົບໃນໂອກາດບຸນເຕັດໃຫຍ່.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/8/30/d14625501aee42e28bbd5227a1ff2b11)

![[ຮູບພາບ] ອາຫານ Noodle Snail ເຮັດໃຫ້ນະຄອນ Liuzhou, ປະເທດຈີນມີຊື່ສຽງ](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/8/30/56e738ed891c40cda33e4b85524e30d3)

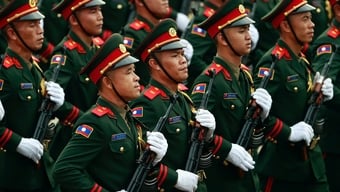

![[ຮູບພາບ] ຄະນະຜູ້ແທນທະຫານສາກົນເຂົ້າຮ່ວມການຊ້ອມຮົບຢູ່ສະໜາມຫຼວງ Ba Dinh](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/8/30/1fe13d6df1534ce8a798fa91962ed487)

(0)