Reglementările ar trebui să fie deschise.

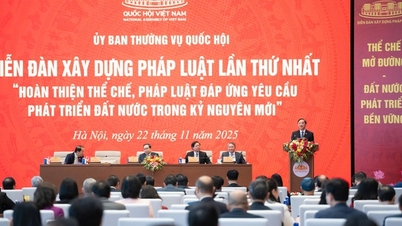

În continuarea celei de-a zecea sesiuni, în dimineața zilei de 21 noiembrie, Adunarea Națională a discutat în grupuri Proiectul de lege privind inteligența artificială.

Exprimându-și opiniile în cadrul Grupului 4 (inclusiv delegații ale Adunării Naționale din provinciile Khanh Hoa , Lai Chau și Lao Cai), delegații au fost în general de acord cu necesitatea promulgării Legii.

Potrivit deputatului Adunării Naționale Nguyen Huu Toan ( Lai Chau ), promulgarea Legii privind Inteligența Artificială (IA) în prezent este foarte necesară. „Am făcut pregătiri relativ bune pentru a supune această lege Adunării Naționale.”

Deputata Adunării Naționale Nguyen Thi Lan Anh (Lao Cai) a declarat că, în prezent, foarte puține țări au emis Legea privind inteligența artificială, astfel încât referințele în procesul de promulgare a legii sunt, de asemenea, limitate. Cu toate acestea, „asta nu înseamnă că nu ar trebui să o promulgăm”, a subliniat delegata.

Totuși, delegata Nguyen Thi Lan Anh a menționat că promulgarea Legii trebuie să ia în considerare factorul „deschidere”, deoarece tehnologia se dezvoltă mereu, zi de zi, oră de oră. „Dacă Legea este promulgată într-un cadru restrâns, nu vom putea promova domeniul tehnologiei inovatoare fără a fi atenți.”

Luați în considerare reglementările statului pentru a garanta dreptul de a beneficia de beneficiile inteligenței artificiale

Făcând comentarii specifice, delegatul Nguyen Huu Toan a declarat că proiectul de lege stipulează subiecții de aplicare (articolul 2) ca fiind: agențiile, organizațiile, persoanele fizice vietnameze și organizațiile și persoanele fizice străine care desfășoară activități de dezvoltare, furnizare, implementare și utilizare a sistemelor de inteligență artificială în Vietnam sau care dețin sisteme de inteligență artificială care produc rezultate utilizate în Vietnam .

Cu toate acestea, domeniul de aplicare al reglementării (clauza 2, articolul 1) prevede: Prezenta lege nu se aplică sistemelor de inteligență artificială dezvoltate, furnizate, implementate și utilizate exclusiv în scopuri de apărare, securitate, informații și criptografie.

Potrivit delegatului, implementarea acestei legi trebuie să asigure în continuare apărarea și securitatea națională, deoarece există produse de inteligență artificială furnizate din afara graniței în Vietnam.

Prin urmare, proiectul de lege nu ar trebui să considere „sistemele de inteligență artificială dezvoltate, furnizate, implementate și utilizate exclusiv în scopuri de apărare, securitate, informații și criptografie” ca un punct de excludere. În schimb, ar trebui reglementat în sensul că cercetarea, dezvoltarea, furnizarea, implementarea și utilizarea sistemelor de inteligență artificială în scopuri de apărare, securitate, informații și criptografie vor fi atribuite Ministerului Apărării Naționale sau Ministerului Securității Publice spre îndrumare.

De asemenea, la articolul 1 din clauza 2 se prevede: Prezenta lege nu se aplică sistemelor de inteligență artificială sau modelelor de inteligență artificială dezvoltate, furnizate, implementate și utilizate numai în cadrul sferei interne a cercetării științifice, a formării și a facilităților de dezvoltare și care nu au fost puse în exploatare sau furnizate unor terți.

Aprobând faptul că sistemele de inteligență artificială utilizate în cadrul unităților de cercetare nu sunt supuse legii, delegatul Nguyen Huu Toan a menționat că, dacă sistemul încalcă legea, acesta trebuie remediat.

De fapt, există sisteme interne foarte mici, dar și sisteme interne foarte mari. „Utilizarea internă trebuie să respecte condițiile și reglementările”, iar Legea trebuie să aibă reglementări, a subliniat delegatul.

Proiectul de lege prevede în mod specific opt politici de stat privind inteligența artificială (articolul 5). De acord, în general, cu aceste politici, delegatul Nguyen Huu Toan a sugerat că este necesară clarificarea anumitor aspecte.

Mai exact, articolul 5, clauza 3, stipulează: Statul garantează dreptul organizațiilor și al persoanelor de a accesa, de a învăța și de a se bucura de beneficiile inteligenței artificiale; promovează dezvoltarea unei societăți digitale cuprinzătoare și incluzive.

Potrivit delegatului, este oportun ca Statul să garanteze dreptul de acces la inteligența artificială. Cu toate acestea, pentru a se bucura de beneficiile inteligenței artificiale, utilizatorii trebuie să cheltuiască și proprii bani pentru a o investi și a o aplica în mediul de producție și de afaceri...; Statul nu este obligat să garanteze pe deplin acest lucru. Prin urmare, este necesară revizuirea acestui regulament în consecință.

În ceea ce privește nivelul de risc al sistemelor de inteligență artificială, articolul 7 din proiectul de lege le împarte în 4 tipuri: risc inacceptabil; risc ridicat; risc mediu; risc scăzut.

De acord cu această clasificare, însă, potrivit delegatului Nguyen Huu Toan, aplicarea în practică la diferite grupuri țintă este diferită. De exemplu, există un tip de risc mediu care nu afectează adulții, dar afectează copiii; sau, în zonele cu condiții de acces mai precare, devine un risc ridicat...

Prin urmare, delegații au sugerat că fiecare tip de risc ar trebui să fie clar definit și aplicat fiecărui subiect și că trebuie să existe avertismente, de exemplu, există umbrele cu risc scăzut care sunt oferite doar adulților, nu și copiilor.

Construirea unui sistem de monitorizare și avertizare asupra incidentelor

O problemă de care delegații sunt foarte interesați este legată de gestionarea și tratarea incidentelor legate de inteligența artificială. Proiectul de lege definește: Un incident grav este un incident tehnic în activitățile de inteligență artificială care provoacă sau amenință să provoace consecințe grave asupra vieții umane, sănătății, proprietății, datelor, securității sau ordinii sociale.

Delegata Nguyen Thi Lan Anh a analizat faptul că în domeniul medical există multe niveluri diferite, la fel și securitatea.

„Deci, care este procesul de evaluare a acestui incident? Care parte, ce mecanism va notifica? Pentru că există unele lucruri care sunt foarte periculoase atunci când sunt descoperite după ce s-a produs un incident. Mai ales în domeniul medical, care este direct legat de viața umană.”

Ridicând problema în acest fel, delegata Nguyen Thi Lan Anh a spus că trebuie să proiectăm un sistem de procese. În primul rând, trebuie să vorbim despre procesul de procesare, cine îl gestionează și la ce nivel va exista o avertizare? În al doilea rând, trebuie să existe un sistem de monitorizare și avertizare timpurie. Acest lucru este foarte important și, dacă dorim o avertizare timpurie, trebuie să ne asigurăm de datele de intrare.

De asemenea, potrivit delegatei Nguyen Thi Lan Anh, problema responsabilității trebuie să fie foarte clară: este responsabilitatea dezvoltatorului modelului, a agenției de management sau a utilizatorului final?

În concluzie, conform delegaților, este necesară clasificarea și definirea tipurilor specifice de incidente legate de inteligența artificială. Construirea unui sistem de monitorizare și avertizare pentru incidente; specificarea procesului de gestionare în funcție de fiecare grup de nivel de risc, creșterea asistenței tehnice și juridice pentru părțile relevante; și clarificarea responsabilităților legale legate de mecanismele de compensare. Acest lucru va asigura atât securitatea, cât și siguranța rețelei.

Clauza 2, Articolul 10 din proiectul de lege prevede: Atunci când un sistem de inteligență artificială are un incident grav, dezvoltatorul sistemului, furnizorul și partea care implementează sistemul de inteligență artificială sunt responsabili pentru: a) Dezvoltatorul și furnizorul sistemului trebuie să aplice prompt măsuri tehnice pentru a remedia, suspenda sau revoca sistemul și să notifice autoritatea competentă; b) Partea care implementează sistemul și utilizatorul sunt obligate să înregistreze și să notifice prompt incidentul și să se coordoneze în procesul de remediere.

„Și dacă incidentul este mai puțin grav?”. Referindu-se la această întrebare, delegatul Nguyen Huu Toan a sugerat că ar trebui să existe un avertisment, în loc să se aștepte până când situația devine gravă înainte de a fi gestionată. Deoarece, în aplicarea inteligenței artificiale, dacă un incident are loc la un nivel grav, viteza de răspândire este foarte rapidă și foarte mare.

Delegatul Nguyen Huu Toan a sugerat că sub acest nivel ar trebui să existe avertismente pentru utilizatori și furnizori. „Monitorizarea și verificarea utilizării inteligenței artificiale este extrem de importantă în viitor pentru a asigura securitatea, ordinea, siguranța socială, precum și fericirea tuturor”, a adăugat delegatul.

În ceea ce privește aspectele etice legate de inteligența artificială, proiectul de lege stipulează în mod clar cadrul etic național privind inteligența artificială (articolul 27), precum și responsabilitățile etice și evaluarea impactului în aplicarea inteligenței artificiale în sectorul public (articolul 28).

„Deci, cum se calculează pentru sectorul privat sau alte domenii care au un impact asupra oamenilor sau asupra altor agenții și politici?”

Delegata Nguyen Thi Lan Anh a sugerat că este necesară extinderea responsabilității etice la sectorul privat și solicitarea companiilor de a dezvolta public un cod etic intern; de a distinge clar principiile etice de obligațiile legale pentru a asigura consecvența și fezabilitatea aplicării.

În același timp, proiectul de lege trebuie să completeze principiile etice de bază, cum ar fi: respectul față de persoane, echitatea, transparența și să stabilească mecanisme obligatorii de evaluare a impactului pentru sistemele de inteligență artificială cu risc ridicat.

Sursă: https://daibieunhandan.vn/du-an-luat-tri-tue-nhan-tao-mo-rong-trach-nhiem-dao-duc-sang-khu-vuc-tu-nhan-10396512.html

Comentariu (0)