Поступали сообщения о том, что пользователи обманным путем заставляли ChatGPT писать вредоносное ПО, но, по словам Касперского, использование искусственного интеллекта (ИИ) в кибератаках шагнуло далеко вперед.

По словам Нушина Шабаба, исследователя из команды GReAT Asia- Pacific (APAC) компании «Лаборатория Касперского», ИИ может поддерживать высокотехнологичные и целенаправленные онлайн-атаки, также известные как «Продвинутые постоянные угрозы» (Advanced Persistent Threats). Помимо разработки вредоносных программ, ИИ может использоваться на различных этапах кибератак.

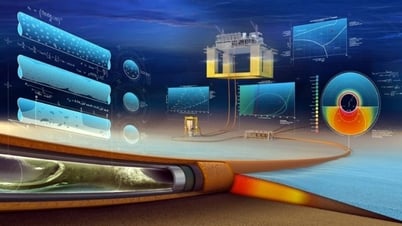

APT-атаки используют постоянные, скрытные и сложные хакерские методы, позволяющие получить доступ к системе и оставаться в ней в течение длительного времени. Хакеры делают это в несколько этапов: от разведки до разработки ресурсов, исполнения и кражи данных.

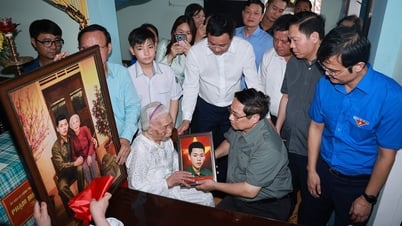

Нушин Шабаб, исследователь команды GReAT компании «Лаборатории Касперского» в Азиатско-Тихоокеанском регионе

По словам Шабаба, ИИ может помочь злоумышленникам находить и понимать потенциальные цели, автоматически анализируя данные из различных источников, таких как онлайн-базы данных и платформы социальных сетей, а также собирая информацию о персонале, системах и приложениях, используемых в компании. Эти системы могут даже выявлять уязвимости, анализируя подробную информацию о сотрудниках компании, отношениях со сторонними организациями и архитектуре сети.

Эксперты «Лаборатории Касперского» утверждают, что фишинг через электронную почту и социальные сети остаётся излюбленным методом атак APT-групп в Азиатско-Тихоокеанском регионе: 10 из 14 групп используют эту тактику для взлома целевых сетей. Искусственный интеллект может помочь создавать персонализированные, очень убедительные фишинговые сообщения. Эти интеллектуальные системы также можно обучить находить оптимальную точку входа в целевую сеть и выбирать оптимальное время для атаки.

ИИ также можно использовать для атак методом подбора, перебирая вероятные пароли. Анализируя поведение пользователя, его активность в социальных сетях и персональные данные, алгоритмы ИИ могут делать обоснованные предположения о паролях, увеличивая вероятность успешного доступа.

На этапе исполнения ИИ может изменять поведение и адаптивность вредоносного ПО для противодействия мерам безопасности. ИИ также может мутировать вредоносное ПО, изменяя структуру его кода, чтобы избежать обнаружения средствами безопасности. Методы социальной инженерии, основанные на ИИ, также могут повысить вероятность взаимодействия пользователей с вредоносными файлами и вероятность успеха.

На этапе персистентности ИИ может генерировать наиболее подходящий сценарий для запуска вредоносного ПО на основе анализа поведения пользователя. Механизмы наблюдения на базе ИИ также могут отслеживать изменения в системе и соответствующим образом корректировать тактику обхода. Методы на базе ИИ могут манипулировать записями реестра Windows для обновления ключей и избежания обнаружения.

Эксперты «Лаборатории Касперского» утверждают, что искусственный интеллект может помочь киберпреступникам похищать данные более скрытно и эффективно. Искусственный интеллект может помочь хакерам анализировать сетевой трафик, чтобы лучше соответствовать типичным моделям поведения и определять наиболее подходящий канал связи для кражи данных каждой жертвы. Эта технология может даже оптимизировать обфускацию, сжатие и шифрование украденных данных, чтобы избежать обнаружения необычного трафика.

По мнению Шабаба, для усиления защиты предприятий и организаций от APT-атак с использованием ИИ необходимы четыре элемента. Первый — внедрение защитных решений, использующих передовые методы мониторинга поведения пользователей и систем для выявления отклонений от нормальных моделей, которые могут указывать на вредоносную активность киберпреступников. Второй — регулярное обновление программного обеспечения, приложений и операционных систем для минимизации уязвимостей, которыми могут воспользоваться злоумышленники.

Ссылка на источник

Комментарий (0)