Sosyal medyada gezinirken, büyük ihtimalle yapay zeka tarafından oluşturulmuş görüntüler veya videolarla karşılaşmışsınızdır. Birçok insan kandırıldı, örneğin trambolinde zıplayan tavşanların viral videosu gibi. Ancak OpenAI tarafından geliştirilen ChatGPT'nin kardeş uygulaması Sora, yapay zeka videolarını yeni bir seviyeye taşıyarak sahte içerik tespitini giderek daha acil hale getiriyor.

Yapay zekâ destekli video araçları, gerçek videoları tespit etmeyi her zamankinden daha zor hale getiriyor. (Kaynak: CNET)

2024 yılında piyasaya sürülen ve yakın zamanda Sora 2 ile güncellenen bu uygulama, tüm videoların yapay zeka tarafından oluşturulduğu TikTok'a benzer bir arayüze sahip. "Cameo" özelliği, gerçek kişilerin simüle edilmiş görüntülere eklenmesine olanak tanıyarak, korkutucu derecede gerçekçi videolar oluşturuyor.

Bu nedenle birçok uzman, Sora'nın deepfake'lerin yayılmasına, bilgiyi çarpıtmasına ve gerçek ile sahte arasındaki çizgiyi bulanıklaştırmasına neden olacağından endişe ediyor. Özellikle ünlüler savunmasız durumda; bu da SAG-AFTRA gibi kuruluşların OpenAI'yi koruma önlemlerini güçlendirmeye çağırmasına yol açtı.

Yapay zekâ tarafından oluşturulan içeriği tanımlamak, teknoloji şirketleri, sosyal medya platformları ve kullanıcılar için büyük bir zorluk teşkil ediyor. Ancak Sora kullanılarak oluşturulan videoları tanımanın yolları mevcut.

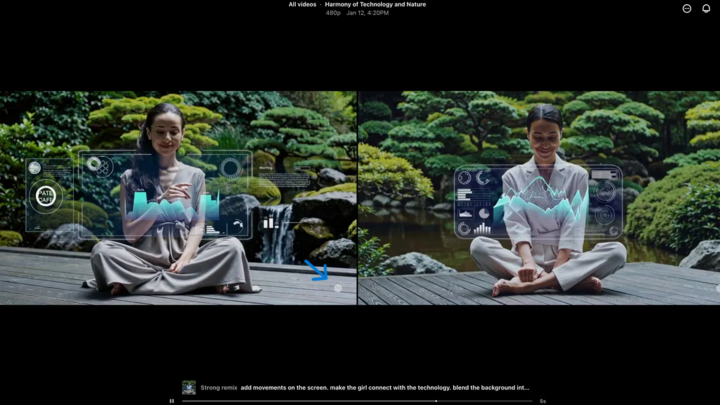

Sora filigranını bulun

Sora filigranı (mavi okla gösterilmiştir), videoyu oluşturmak için kullanılan aracı belirten bir işarettir. (Kaynak: CNET)

Sora iOS uygulamasında oluşturulan her video, indirildiğinde bir filigran içerir; beyaz Sora logosu (bulut simgesi), TikTok'un filigranına benzer şekilde videonun kenarlarında hareket eder.

Bu, yapay zeka tarafından oluşturulan içeriği görsel olarak tanımlamanın bir yoludur. Örneğin, Google'ın Gemini "nano-muz" modeli de resimlere otomatik olarak filigran ekler. Ancak filigranlar her zaman güvenilir değildir. Filigran statik ise kolayca kırpılabilir. Sora'nınki gibi dinamik filigranlar bile özel uygulamalar kullanılarak kaldırılabilir.

Bu konu sorulduğunda, OpenAI CEO'su Sam Altman, toplumun herkesin sahte video oluşturabileceği gerçeğine uyum sağlaması gerektiğini savundu. Sora'dan önce, bu kadar popüler, erişilebilir ve bu tür videoları oluşturmak için hiçbir beceri gerektirmeyen bir araç hiç yoktu. Onun bakış açısı, alternatif doğrulama yöntemlerine güvenmenin gerekliliğini vurguluyor.

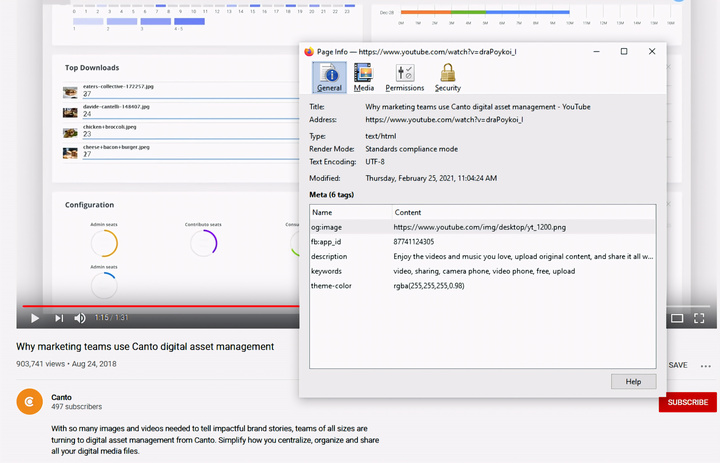

Meta verileri kontrol et

Meta verilerin kontrol edilmesi – bir videonun Sora gibi bir yapay zeka tarafından oluşturulup oluşturulmadığını belirlemede çok önemli bir adım. (Kaynak: Canto)

Meta verileri kontrol etmenin çok karmaşık olduğunu düşünebilirsiniz, ancak aslında oldukça basit ve çok etkilidir.

Meta veri, kamera türü, konum, kayıt zamanı ve dosya adı gibi içerik oluşturulduğunda otomatik olarak eklenen bir bilgi kümesidir. İçerik insan tarafından mı yoksa yapay zeka tarafından mı oluşturulmuş olursa olsun, meta veriye sahiptir. Yapay zeka tarafından oluşturulan içerikte, meta veri genellikle kaynak atıf bilgilerini de içerir.

OpenAI, İçerik Kaynağı ve Orijinalliği Koalisyonu'nun (C2PA) bir üyesidir, bu nedenle Sora videoları C2PA meta verilerini içerecektir. Bunu, içerik orijinalliği girişiminin doğrulama aracını kullanarak doğrulayabilirsiniz:

Meta verileri nasıl kontrol edersiniz:

- verify.contentauthenticity.org adresini ziyaret edin.

- Kontrol edilecek dosyayı yükleyin.

- "Aç" düğmesine basın.

- Sağdaki tabloda yer alan bilgilere bakınız.

Video yapay zeka tarafından oluşturulduysa, özet bölümünde bu açıkça belirtilecektir. Sora videolarını kontrol ederken, "OpenAI tarafından yayınlandı" ibaresini ve videonun yapay zeka kullanılarak oluşturulduğunu doğrulayan bilgileri göreceksiniz. Tüm Sora videolarının kaynağını doğrulamak için bu bilgilere sahip olması gerekir.

Kaynak: https://vtcnews.vn/cach-nhan-biet-video-that-hay-do-ai-tao-ar972891.html

![[Fotoğraf] Genel Sekreter ve Başkan To Lam, Hanoi Şehir Parti Komitesi Daimi Komitesi Politbürosu'nun ikinci incelemesinin sonuçlarına ilişkin taslak raporun onaylanması toplantısına başkanlık ediyor.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/05/26/1779789811432_a2-bnd-4430-9620-jpg.webp)

![[Video] İntihal veya veri tahrifatı, bilimsel araştırmalardan süresiz olarak men edilmenize neden olabilir.](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2026/05/27/1779841122844_khoa-hoc-jpg.webp)

![[İNFOgrafik] Çin'deki ciddi kömür madeni kazalarına bir bakış](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2026/05/27/1779840222951_thumb-tai-nan-mo-than-o-trung-quoc-jpg.webp)

![[GALERİ] ChatGPT'yi arama için kullanırken dikkat edilmesi gereken 5 son derece önemli şey](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2026/05/27/1779840226248_gp-2-png.webp)

Yorum (0)