Хоанг Оань (ім'я персонажа змінено) — офісний працівник у Ханої . Під час спілкування з другом через Facebook Messenger друг Оань попрощався та завершив розмову, але раптово повернувся до повідомлення, попросивши позичити грошей та запропонувавши переказати гроші на банківський рахунок.

Хоча ім'я облікового запису збігалося з іменем її подруги, Хоанг Оань все ще мала деякі підозри, тому вона запросила відеодзвінок для підтвердження. Її подруга одразу погодилася, але дзвінок тривав лише кілька секунд через «перебої в мережі», як пояснила подруга. Побачивши обличчя подруги у відеодзвінку, а голос також належав цій людині, Хоанг Оань більше не сумнівалася та переказала гроші. Однак лише після успішного переказу ця користувачка зрозуміла, що потрапила в пастку хакера.

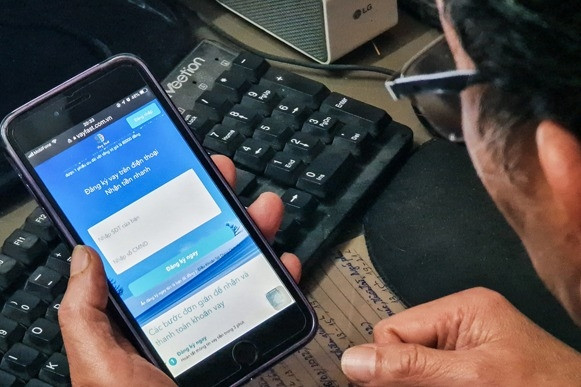

Випадок користувача Hoang Oanh — лише одна з багатьох жертв, які «потрапили в пастку» шахрайських груп, що використовують технології штучного інтелекту для створення зображень та голосів друзів і родичів жертв, щоб обманом змусити їх привласнити їхнє майно.

Експерти Bkav заявили, що у другій половині 2023 року, і особливо приблизно під час місячного Нового року 2024, ця компанія з інформаційної безпеки постійно отримувала повідомлення та запити про допомогу від жертв щодо подібних випадків шахрайства, як зазначено вище.

Згідно з аналізом експертів компанії, у випадку користувача Hoang Oanh зловмисники взяли під контроль обліковий запис Facebook, але не одразу повністю захопили його, а натомість таємно стежили та чекали нагоди, щоб прикинутися жертвою та попросити позичити гроші у друзів та родичів.

Шахраї використовують штучний інтелект для створення фальшивого відео обличчя та голосу власника облікового запису Facebook (Deepfake). Коли їх просять здійснити відеодзвінок для підтвердження, вони погоджуються прийняти дзвінок, але потім швидко відключаються, щоб уникнути виявлення.

Пан Нгуєн Тьєн Дат, генеральний директор Центру дослідження шкідливих програм Bkav, наголосив, що навіть коли користувачі здійснюють відеодзвінок і бачать обличчя родичів чи друзів, а також чують їхні голоси, це не обов'язково означає, що ви розмовляєте саме з цією людиною. Останнім часом багато людей стали жертвами фінансових шахрайств з використанням Deepfake та за участю технологій штучного інтелекту.

«Можливість збирати та аналізувати дані користувачів за допомогою штучного інтелекту дозволяє створювати складні стратегії шахрайства. Це також означає, що складність сценаріїв шахрайства при поєднанні Deepfake та GPT зросте, що значно ускладнить виявлення шахрайства», – сказав пан Нгуєн Тьєн Дат.

Експерти Bkav рекомендують користувачам бути особливо пильними, не надавати особисту інформацію (посвідчення особи, банківський рахунок, OTP-код...). Не переказуйте гроші незнайомцям через телефон, соціальні мережі, веб-сайти з ознаками шахрайства. Коли надходить запит на позику/переказ грошей на рахунок через соціальні мережі, користувачам слід використовувати інші методи автентифікації, такі як дзвінок або використання інших каналів зв'язку для повторного підтвердження.

Прогнозуючи тенденції кібератак у 2024 році, експерти погоджуються, що швидкий розвиток штучного інтелекту не лише приносить очевидні переваги, але й створює значні ризики для кібербезпеки.

Найбільшим викликом для бізнесу та організацій, що стикаються з технологіями штучного інтелекту сьогодні, є шахрайство та передові постійні загрози (APT), зі зростаючою складністю сценаріїв шахрайства, особливо при поєднанні Deepfake та GPT. Можливість збирати та аналізувати дані користувачів за допомогою ШІ дозволяє створювати складні стратегії шахрайства, що ускладнює для користувачів виявлення шахрайства.

Підвищення безпеки штучного інтелекту – це незаперечна тенденція майбутнього. Міжнародній спільноті потрібно буде тісно співпрацювати для розробки нових заходів безпеки, а також підвищувати знання та обізнаність користувачів щодо потенційних ризиків, пов’язаних зі штучним інтелектом.

Остерігайтеся шахрайства, яке поширює фальшиві повідомлення брендів

Попередження про 5 онлайн-шахрайств під час місячного Нового року 2024

Видання себе за офіційних осіб становить 9% від загальної кількості фішингових атак у В'єтнамі.

Джерело

![[Фото] Прем'єр-міністр Фам Мінь Чінь головує на першому засіданні Центрального керівного комітету з питань житлової політики та ринку нерухомості](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/22/c0f42b88c6284975b4bcfcf5b17656e7)

![[Фото] Генеральний секретар То Лам вручає Медаль праці першого класу Національній енергетичній та промисловій групі В'єтнаму](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/21/0ad2d50e1c274a55a3736500c5f262e5)

Коментар (0)