ڈیپ فیک آواز کے ساتھ آواز کی نقالی کرکے دھوکہ

تیزی سے ترقی پذیر مصنوعی ذہانت کے دور میں، آواز - ایک ایسے عوامل میں سے ایک جسے کبھی مستند ثبوت سمجھا جاتا تھا - اب برے لوگوں کے ہاتھ میں ایک خطرناک آلہ بن گیا ہے۔ ڈیپ فیک وائس ٹیکنالوجی جعلی آوازوں کو حقیقی لوگوں سے مماثل ہونے کی اجازت دیتی ہے، دھوکہ دہی اور مناسب جائیداد کے لیے جدید ترین جعلی کالیں تخلیق کرتی ہے۔

ڈیپ فیک آواز کیوں خوفناک ہے؟

ڈیپ فیک وائس ایک ایسی ٹیکنالوجی ہے جو مصنوعی ذہانت (AI) اور مشین لرننگ کا اطلاق کرتی ہے تاکہ ایک جعلی آواز بنائی جا سکے جو ایک حقیقی شخص کی آواز سے ملتی جلتی ہو۔

Tacotron، WaveNet، ElevenLabs یا Respeecher جیسے صوتی کلوننگ پلیٹ فارم جیسے جدید ماڈلز کی مدد سے، دھوکہ بازوں کو 95% قابل بھروسہ ڈیپ فیک بنانے کے لیے صرف 3 سے 10 سیکنڈ کے صوتی نمونوں کی ضرورت ہوتی ہے۔

ڈیپ فیک آواز خاص طور پر خطرناک ہو جاتی ہے کیونکہ اس کی آوازوں کی تقریباً مکمل نقل کرنے کی صلاحیت، تلفظ، لہجے سے لے کر یہاں تک کہ ہر شخص کی منفرد بولنے کی عادات تک۔

اس سے متاثرین کے لیے اصلی اور نقلی میں فرق کرنا بہت مشکل ہو جاتا ہے، خاص طور پر جب آواز ان کے رشتہ داروں، دوستوں یا اعلیٰ افسران کی ہو۔

وائس مائننگ بھی بہت آسان ہے، کیونکہ آج کل زیادہ تر لوگ TikTok، سوشل میڈیا لائیو اسٹریمز، پوڈ کاسٹ، یا آن لائن میٹنگز جیسے پلیٹ فارمز کے ذریعے اپنے آڈیو کو بے نقاب کرتے ہیں۔ مزید تشویشناک بات یہ ہے کہ ڈیپ فیک آوازیں تصاویر یا ویڈیوز جیسے بصری نشانات نہیں چھوڑتی ہیں، جس سے تفتیش مشکل ہو جاتی ہے اور متاثرین کو پیسے کھونے کا خطرہ ہوتا ہے۔

آواز کے نمونے کے صرف چند سیکنڈ ایک ڈیپ فیک بنا سکتے ہیں۔

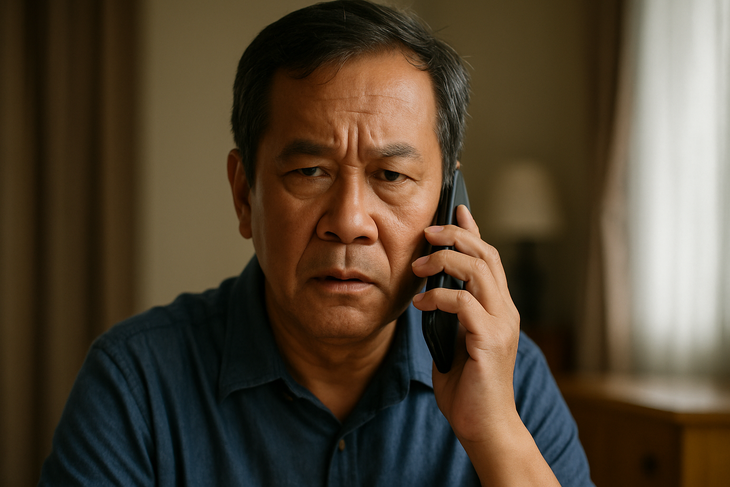

ڈیپ فیک آواز کے گھوٹالے تیزی سے نفیس ہوتے جا رہے ہیں، اکثر ایک مانوس منظر نامے کا استعمال کرتے ہوئے: ہنگامی صورتحال میں کسی جاننے والے کی آواز کی نقل کرنا تاکہ خوف و ہراس پیدا ہو اور متاثرین کو فوری طور پر رقم کی منتقلی کے لیے دباؤ ڈالا جائے۔

ویتنام میں، ایک ماں کا معاملہ سامنے آیا ہے کہ اس کے "بیٹے" کا فون آیا جس میں اسے بتایا گیا کہ اس کا حادثہ ہوا ہے اور اسے فوری طور پر رقم کی ضرورت ہے۔ برطانیہ میں، ایک کمپنی کے ڈائریکٹر کو فون پر رقم کی منتقلی کی اس کے "باس" کی درخواست سن کر 240,000 USD سے زیادہ کا گھپلہ کیا گیا۔ ایک انتظامی ملازم کو اس وقت بھی دھوکہ دیا گیا جب "بگ باس" کا کال موصول ہوا جس میں "اسٹریٹجک پارٹنر" کو ادائیگی کی درخواست کی گئی تھی...

ان حالات میں عام بات یہ ہے کہ جعلی آواز بالکل کسی رشتہ دار یا اعلیٰ کی طرح دوبارہ تیار کی جاتی ہے، جس سے متاثرہ شخص پر مکمل اعتماد ہوتا ہے اور اس کے پاس تصدیق کرنے کا وقت نہیں ہوتا ہے۔

ہمیشہ تصدیق کریں، فوری طور پر بھروسہ نہ کریں۔

ڈیپ فیک صوتی گھوٹالوں میں اضافے کے ساتھ، لوگوں کو مشورہ دیا جاتا ہے کہ وہ فون پر صرف آواز کی بنیاد پر رقم منتقل نہ کریں، چاہے یہ بالکل کسی پیارے کی طرح ہی کیوں نہ ہو۔ اس کے بجائے، کوئی بھی لین دین کرنے سے پہلے پرانے نمبر پر کال کریں یا مختلف چینلز کے ذریعے معلومات چیک کریں۔

بہت سے ماہرین غیر معمولی حالات میں تصدیق کے لیے گھر یا کاروبار کے اندر ایک "اندرونی پاس ورڈ" ترتیب دینے کا مشورہ بھی دیتے ہیں۔

اس کے علاوہ، سوشل نیٹ ورکس پر واضح آوازوں کے ساتھ ویڈیوز کی پوسٹنگ کو محدود کرنا ضروری ہے، خاص طور پر طویل مواد۔ خاص طور پر، یہ ضروری ہے کہ خطرے سے دوچار گروہوں جیسے کہ بوڑھے یا ٹیکنالوجی سے بہت کم ایکسپوژر والے افراد کو فعال طور پر متنبہ کرنا اور رہنمائی کرنا ضروری ہے، کیونکہ یہ ہائی ٹیک گھوٹالوں کے ترجیحی اہداف ہیں۔

رشتہ داروں، دوستوں اور ساتھیوں کی آوازیں جعلی ہو سکتی ہیں۔

بہت سے ممالک میں، حکام نے اپنے قانونی فریم ورک کے ساتھ ڈیپ فیک ٹیکنالوجی کے انتظام کو سخت کرنا شروع کر دیا ہے۔

امریکہ میں، کئی ریاستوں نے انتخابی مہم میں ڈیپ فیکس کے استعمال یا غلط معلومات پھیلانے پر پابندی لگا دی ہے۔ یورپی یونین (EU) نے AI ایکٹ منظور کیا، جس میں تنظیموں کو شفاف اور واضح طور پر متنبہ کرنے کی ضرورت ہے کہ اگر کوئی مواد مصنوعی ذہانت سے تیار کیا جاتا ہے۔

دریں اثنا، ویتنام میں، اگرچہ ڈیپ فیک آوازوں کے لیے کوئی خاص ضابطے نہیں ہیں، متعلقہ کارروائیوں کو موجودہ قانون کے مطابق ہینڈل کیا جا سکتا ہے، جیسے کہ دھوکہ دہی، جائیداد کی تخصیص، رازداری کی خلاف ورزی، یا شناخت کی جعلسازی۔

تاہم، حقیقت یہ ہے کہ ٹیکنالوجی اس رفتار سے ترقی کر رہی ہے جس کی نگرانی قانون کی صلاحیت سے کہیں زیادہ ہو رہی ہے، جس سے بہت سی خامیاں رہ گئی ہیں جن کا برے اداکار فائدہ اٹھا سکتے ہیں۔

جب آواز اب ثبوت نہیں رہی

آواز ایک مباشرت اور قابل اعتماد چیز ہوا کرتی تھی، لیکن گہری جعلی آواز کے ساتھ، یہ اب کوئی درست ثبوت نہیں ہے۔ AI کے دور میں، ہر فرد کو ڈیجیٹل دفاع کے بارے میں معلومات حاصل کرنے کی ضرورت ہے، فعال طور پر تصدیق کریں اور ہمیشہ چوکس رہیں کیونکہ کال ایک جال بن سکتی ہے۔

ماخذ: https://tuoitre.vn/lua-dao-bang-deepfake-voice-ngay-cang-tinh-vi-phai-lam-sao-20250709105303634.htm

![[تصویر] صدر لوونگ کوانگ امریکی وزیر جنگ پیٹ ہیگستھ کا استقبال کر رہے ہیں۔](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/02/1762089839868_ndo_br_1-jpg.webp)

![[تصویر] لام ڈونگ: ٹوئی فونگ میں مشتبہ جھیل پھٹنے کے بعد نقصان کی تصاویر](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/02/1762078736805_8e7f5424f473782d2162-5118-jpg.webp)

تبصرہ (0)