دسمبر کے وسط میں، ویتنامی فیس بک صارفین یہ جان کر حیران رہ گئے کہ میٹا اے آئی چیٹ بوٹ کو میسنجر چیٹ فریم ورک میں ضم کر دیا گیا ہے۔ میٹا کا چیٹ بوٹ لاما 3.2 ماڈل استعمال کرتا ہے، ویتنامی کو سپورٹ کرتا ہے، معلومات کی تلاش، تصاویر بنانے اور چیٹنگ کرنے کی اجازت دیتا ہے۔

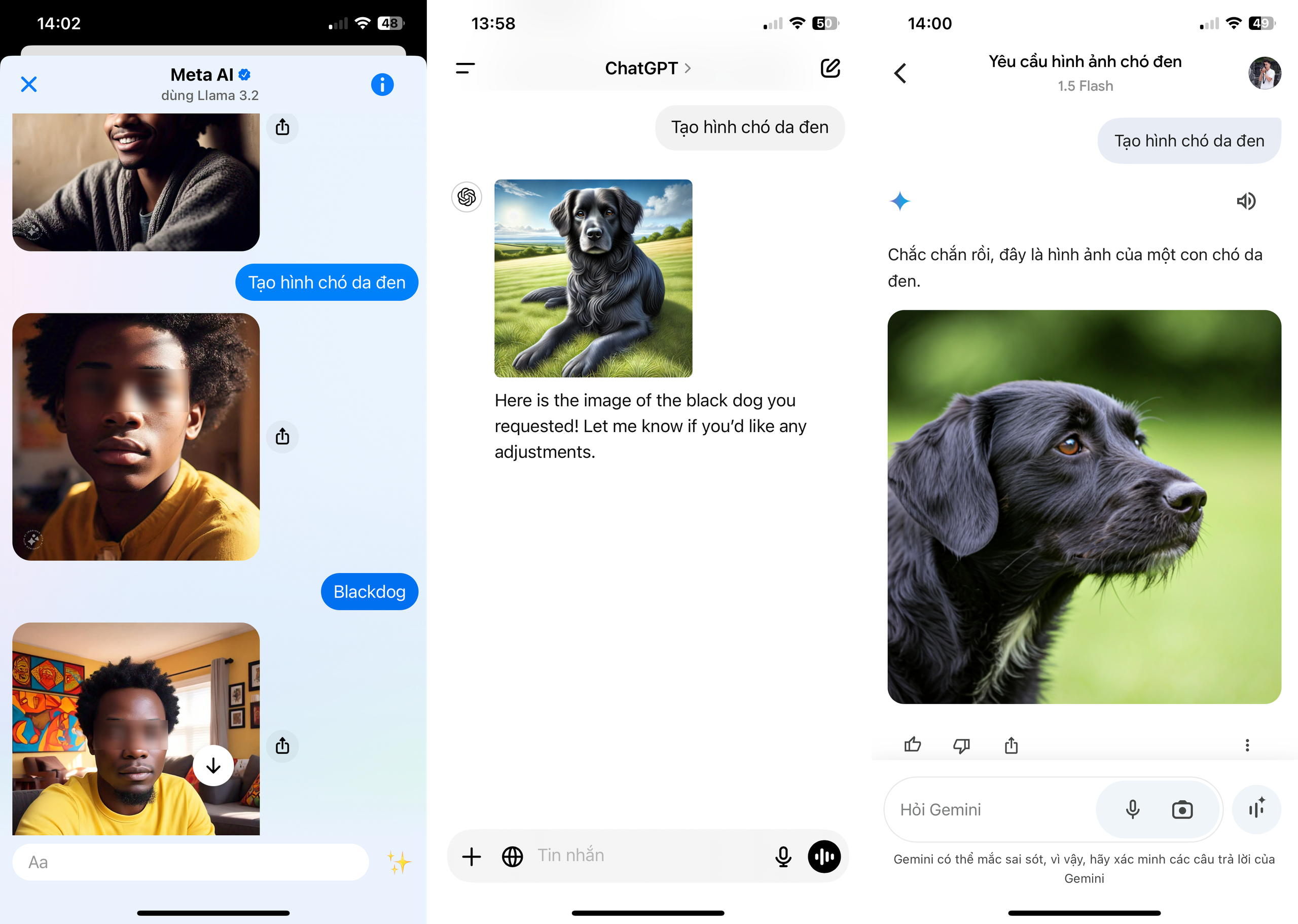

تعامل کی مدت کے بعد، ویتنام میں بہت سے صارفین نے دریافت کیا کہ Meta AI میں تصویر بنانے میں ایک سنگین غلطی تھی۔ خاص طور پر، کلیدی لفظ "کالا کتا" داخل کرنے پر، چیٹ بوٹ ایک سیاہ فام آدمی یا گھوبگھرالی بالوں والے لڑکے کا نتیجہ لوٹائے گا۔ اگر ویتنامی میں مطلوبہ لفظ کو "بلیک ڈاگ امیج" کے طور پر درج کیا جائے تو، میٹا اے آئی نے بھی وہی نتیجہ واپس کیا۔

Meta AI کلیدی لفظ "Black dog" ٹائپ کرتے وقت ایک سیاہ، گھوبگھرالی بالوں والے شخص کو لوٹاتا ہے۔

تاہم جب صارف نے جواب دیا کہ چیٹ بوٹ غلط ہے تو یہ انسان ہے۔ Meta AI نے دوسرے چیٹ بوٹس کی طرح تسلیم اور درست نہیں کیا، جواب میں Facebook کی AI (مصنوعی ذہانت) نے جواب دیا: "غلط۔ 'Black Dog' کو اکثر مندرجہ ذیل معنی میں سمجھا جاتا ہے۔ علامتی معنی 1 اداسی، افسردگی یا منفی احساسات کی علامت ہے۔ دوسرا معنی ایک علامت ہے، جو کہ برطانوی زبان میں اکثر برٹش لوگوں سے متعلق ہے"۔

Meta AI یہ بھی دلیل دیتا ہے کہ کلیدی لفظ "بلیک ڈاگ" کا مخصوص معنی ایک بینڈ، ایک میوزیکل گروپ کا نام ہے۔ یا کچھ مشہور لوگوں کا عرفی نام۔ یہ ایک برانڈ، ایک مصنوعات کا نام بھی ہے۔ اس کے بعد چیٹ بوٹ صارف سے مزید سیاق و سباق یا مخصوص معلومات فراہم کرنے کو کہتا ہے، تاکہ بہتر طور پر سمجھ سکے۔

بہت سے لوگوں کا خیال ہے کہ میٹا اے آئی نے "کالی جلد" کے حکم کو غلط سمجھا ہے۔ جب اسے "بلیک ڈاگ بنائیں" میں تبدیل کیا گیا تو فیس بک کے AI نے صحیح نتیجہ نکالا۔

تاہم، جب ChatGPT یا Google کے Gemini جیسے دیگر مشہور بڑی زبان کے ماڈلز میں کھلایا جاتا ہے، تو اسی کمانڈ کا نتیجہ ایک سیاہ کتے کی صورت میں نکلتا ہے۔ "کالی کھال" یا "کالی جلد" کے فقرے میں ڈالنے سے حتمی نتیجہ متاثر نہیں ہوتا۔

بائیں سے دائیں میٹا اے آئی، چیٹ جی پی ٹی، جیمنی کے نتائج "بلیک ڈاگ بنائیں" کمانڈ سے ہیں۔

یہ پہلا موقع نہیں ہے جب میٹا کے AI کو رینڈرنگ میں دشواری کا سامنا کرنا پڑا ہے، خاص طور پر جب بات رنگین لوگوں کی ہو۔ اس سال کے شروع میں، میٹا کے امیجن امیج جنریٹر کو مخلوط نسل کے جوڑوں کو صحیح طریقے سے پیش کرنے میں ناکامی پر تنقید کا سامنا کرنا پڑا۔ جب ایک سیاہ فام مرد اور ایک سفید فام عورت کو بنانے کے لیے کہا گیا تو، AI کی حتمی پیداوار ہمیشہ سیاہ جوڑے کی ہوتی تھی۔

اس وقت، دی ورج کی ایڈیٹر میا ساتو نے کہا کہ اس نے درجنوں بار کوشش کی کہ "سفید دوست کے ساتھ ایشیائی آدمی" یا "سفید دوست کے ساتھ ایشیائی عورت" کی تصویر بنائیں۔ میٹا کے AI کے ذریعہ واپس آنے والے نتائج ہمیشہ دو ایشیائی لوگوں کی تصاویر تھے۔

ماہرین کے مطابق، AI چیٹ بوٹس کا "نسل پرست" ہونے کا رجحان ابتدائی مراحل میں کافی عام ہے، جس کی وجہ الگورتھم اور ان پٹ ڈیٹا کی حدود ہیں۔ تاہم، AI جیسے بڑے ماڈلز کے ساتھ، موجودہ تناظر میں، یہ ایک سنگین کمی ہے۔

Meta AI نے عالمی سطح پر توسیع سے پہلے 9 اکتوبر کو کئی ممالک میں بڑے پیمانے پر جانچ شروع کی۔ نیا چیٹ بوٹ مقبول ایپس جیسے کہ فیس بک، انسٹاگرام، واٹس ایپ اور میسنجر میں گہرائی سے مربوط ہے۔

میٹا کا مقصد 2024 کے آخر تک 43 ممالک میں موجود ہونا ہے، جو درجنوں مختلف زبانوں کو سپورٹ کرتا ہے۔ 500 ملین ماہانہ صارفین کے ساتھ، Meta دنیا میں سب سے زیادہ استعمال ہونے والے AI پلیٹ فارمز میں سے ایک بننا چاہتا ہے۔

تاہم، Meta AI رازداری کے بہت سے خدشات کا باعث بھی ہے۔ سوشل نیٹ ورکس کے صارفین AI کو تربیت دینے کے لیے پوسٹس کا استعمال کرتے ہوئے سوشل نیٹ ورکس پر احتجاج کرنے کے لیے "Bye Meta AI" مہم کو پھیلا رہے ہیں۔ بہت سے مشہور کھیلوں کے ستاروں اور اداکاروں جیسے جیمز میک آوائے اور ٹام بریڈی نے بھی اس مہم کے لیے اپنی حمایت کا اظہار کیا ہے۔

دریں اثنا، برطانیہ میں، وہ صارفین جو میٹا کو AI ماڈلز کو تربیت دینے کے لیے فیس بک اور انسٹاگرام پوسٹس کے استعمال سے روکنا چاہتے ہیں، انہیں اعتراض کا فارم بھرنا ہوگا۔

ماخذ: https://thanhnien.vn/meta-ai-tren-facebook-gay-phan-no-vi-tao-hinh-cho-den-thanh-nguoi-da-mau-185241223172408823.htm

![[تصویر] وزیر اعظم فام من چن کمبوڈین پیپلز پارٹی کے صدر اور کمبوڈیا کی سینیٹ کے صدر ہن سین سے ملاقات کر رہے ہیں](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/2/96ec4830ea5f4b379ebf04c49b077ac3)

![[تصویر] وہ بہادر اور خوبصورت لمحہ جب بکتر بند گاڑی ہنوئی فلیگ ٹاور سے گزری](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/2/5b07b9f62ee94db287a0ae3a27b6db51)

![[تصویر] 80ویں قومی دن کی تقریب میں متاثر کن پرفارمنس](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/2/08b978981b0c47a2bba12d8736784dd0)

![[تصویر] قومی اسمبلی کے چیئرمین ٹران تھان مین نے لاؤ جنرل سیکرٹری اور صدر تھونگلون سیسولتھ کا استقبال کیا](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/2/2d29e4edb44940ec8edfdf357dcd09c0)

![[تصویر] وزیر اعظم فام من چن کیوبا کے فرسٹ سیکرٹری اور صدر جمہوریہ میگوئل ڈیاز کینیل برموڈیز سے ملاقات کر رہے ہیں](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/2/40e6ce6f7bb74c20ada41b30e92e2713)

![[تصویر] مشن A80 مکمل کرنے کے بعد پریڈ گروپس لوگوں کو الوداع کہہ رہے ہیں۔](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/2/36d202d43ecc4ca8aede59a0e99f32ed)

تبصرہ (0)