قال جيفري هينتون، الذي ابتكر التكنولوجيا الأساسية لأنظمة الذكاء الاصطناعي، لصحيفة نيويورك تايمز إن التقدم المحرز في هذا المجال يشكل "مخاطر عميقة على المجتمع والإنسانية".

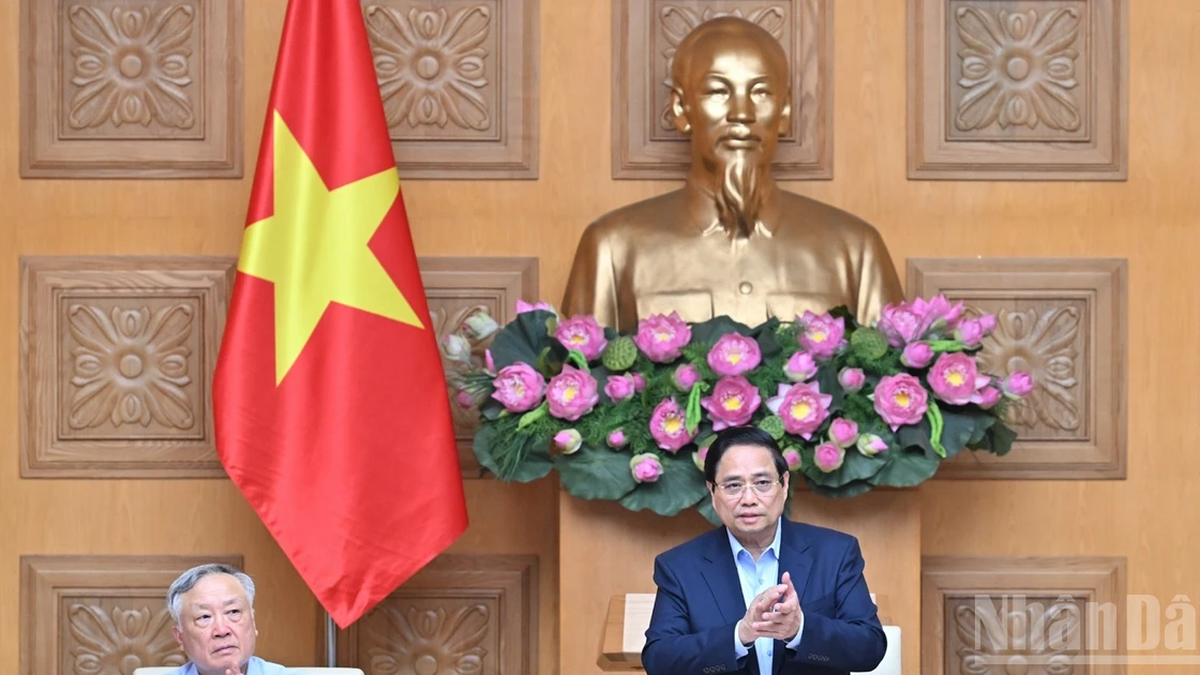

ترك جيفري هينتون، رائد الذكاء الاصطناعي، جوجل، وهو يُحذّر الآن من مخاطر التقنية المستخدمة في تطبيقات مثل ChatGPT. الصورة: وكالة فرانس برس

قال هينتون: "انظروا إلى حالنا قبل خمس سنوات، وإلى حالنا الآن". المنافسة بين عمالقة التكنولوجيا تدفع الشركات إلى إطلاق تقنيات الذكاء الاصطناعي الجديدة بوتيرة خطيرة، مما يُعرّض الوظائف للخطر وينشر معلومات مضللة.

وقال لصحيفة نيويورك تايمز "من الصعب أن نرى كيف يمكننا منع الأشرار من استخدام الإنترنت لأغراض سيئة".

في عام 2022، بدأت Google وOpenAI - الشركة الناشئة التي تقف وراء برنامج الدردشة الشهير ChatGPT الذي يعمل بالذكاء الاصطناعي - في بناء أنظمة تستخدم كميات أكبر بكثير من البيانات مقارنة بأي وقت مضى.

وقال هينتون لصحيفة نيويورك تايمز إنه يعتقد أن هذه الأنظمة تتفوق على الذكاء البشري في بعض النواحي بسبب كمية البيانات التي تقوم بتحليلها.

وأضاف في تصريح للصحيفة: "ربما يكون ما يحدث في هذه الأنظمة أفضل بكثير مما يحدث في الدماغ".

في حين يُستخدم الذكاء الاصطناعي بالفعل لمساعدة البشر، فإن التوسع السريع لروبوتات الدردشة مثل ChatGPT قد يُعرّض الوظائف للخطر. وقال إن الذكاء الاصطناعي "يُزيل العمل الشاق"، ولكنه "قد يُزيل أكثر من ذلك بكثير".

كما حذّر العالم من احتمال انتشار معلومات مضللة ناتجة عن الذكاء الاصطناعي، قائلاً إن الشخص العادي "لن يتمكن بعد الآن من تمييز الحقيقة". وأبلغ هينتون جوجل باستقالته الشهر الماضي.

في شهر مارس/آذار، دعا الملياردير إيلون ماسك ومجموعة من الخبراء إلى التوقف مؤقتًا في تطوير أنظمة الذكاء الاصطناعي لإعطاء الوقت الكافي لضمان سلامتها.

ولم يوقع هينتون على الرسالة في ذلك الوقت، لكنه قال لصحيفة نيويورك تايمز إن العلماء لا ينبغي لهم "توسيع نطاق هذا الأمر إلى أن يفهموا ما إذا كانوا قادرين على السيطرة عليه".

ماي آنه (وفقًا لصحيفة نيويورك تايمز، CNA)

[إعلان 2]

مصدر

![[صورة] رئيس الجمعية الوطنية يحضر ندوة "بناء وتشغيل مركز مالي دولي وتوصيات لفيتنام"](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/7/28/76393436936e457db31ec84433289f72)

تعليق (0)