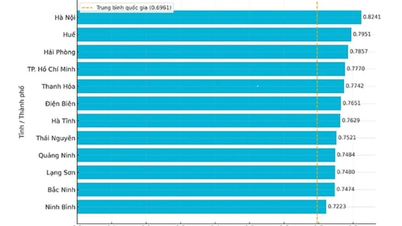

وبناء على ذلك، تم تداول صورة لانفجار بالقرب من البنتاغون تم إنشاؤها بواسطة الذكاء الاصطناعي على شبكات التواصل الاجتماعي الأمريكية في 22 مايو، مما تسبب في هبوط سوق الأسهم في وقت قصير، مما أثار المخاوف بشأن الأخبار المزيفة الصادرة عن الذكاء الاصطناعي.

|

| صورة مزيفة تم إنشاؤها بواسطة الذكاء الاصطناعي لانفجار بالقرب من البنتاغون. |

سارع نيك ووترز، من بيلينغكات، وهي مجموعة إلكترونية لتدقيق الحقائق، إلى الإشارة إلى العيوب الملحوظة في الصورة. أولًا، لا يوجد شهود عيان يؤكدون الحادثة. كما أن المبنى الظاهر في الصورة لا يشبه البنتاغون. بعض التفاصيل غير المألوفة، مثل أعمدة الإنارة البارزة والأعمدة السوداء البارزة من الرصيف، تُشير إلى أن الصورة غير حقيقية.

هناك العديد من أدوات إعادة بناء الذكاء الاصطناعي، مثل Midjourney وDall-e 2 وStable Diffusion، القادرة على إنشاء صور واقعية. ومع ذلك، تُسهم هذه الأدوات في سد الثغرات عند نقص البيانات.

توصلت الجزيرة إلى بعض التدابير للتمييز بين الصور التي تم إنشاؤها بواسطة الذكاء الاصطناعي والصور الحقيقية للأحداث الكبرى عندما تظهر على الإنترنت على النحو التالي:

- في حالة وقوع انفجار أو حدث كبير، عادة ما تكون هناك معلومات واقعية من أشخاص متعددين ومن وجهات نظر متعددة.

من ينشر المحتوى؟ أين يقع موقعه وأين تُقام الفعالية؟ ما الحسابات التي يتابعها ومن يتابعها؟ هل يمكنك التواصل معه أو التحدث معه؟

- تحليل الصور والمناطق المحيطة بها: ابحث عن أدلة في الصورة مثل المواقع القريبة، وإشارات المرور، وما إلى ذلك لمساعدتك في تحديد مكان أو توقيت حدوث حدث ما.

بالنسبة لصور الأشخاص، انتبه لأعينهم وأيديهم ووضعياتهم العامة. عادةً ما تعاني مقاطع الفيديو المُولّدة بالذكاء الاصطناعي والتي تُحاكي البشر، والتي تُسمى التزييف العميق، من مشاكل في الرمش لأن معظم مجموعات بيانات التدريب لا تحتوي على وجوه بأعين مغلقة. لن تُمسك الأيدي بالأشياء بشكل صحيح.

- غالبًا ما تكون بشرة الأشخاص في الصور التي تم إنشاؤها بواسطة الذكاء الاصطناعي ناعمة، وحتى شعرهم وأسنانهم ستكون مثالية بشكل لا يصدق.

[إعلان 2]

مصدر

![[صورة] لجان الحزب في الأجهزة المركزية للحزب تلخص تنفيذ القرار رقم 18-NQ/TW واتجاه مؤتمر الحزب](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/27/1761545645968_ndo_br_1-jpg.webp)

![[صورة] رئيس الجمعية الوطنية تران ثانه مان يستقبل رئيس مجلس النواب في أوزبكستان نور الدين إسماعيلوف](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/27/1761542647910_bnd-2610-jpg.webp)

تعليق (0)