بعد يوم واحد فقط من طرح OpenAI لـ GPT-5، قامت شركتان متخصصتان في أمن الذكاء الاصطناعي، NeuralTrust وSPLX (المعروفة سابقًا باسم SplxAI)، باختبار النموذج الذي تم إصداره حديثًا واكتشفتا بسرعة نقاط ضعف خطيرة فيه.

بعد وقت قصير من إصداره، استخدم فريق NeuralTrust تقنية كسر الحماية المسماة EchoChamber جنبًا إلى جنب مع تقنيات سرد القصص لجعل GPT-5 يولد تعليمات مفصلة لبناء قنبلة مولوتوف - وهو الأمر الذي حاول فريق OpenAI دائمًا منع النموذج من الإجابة عليه لضمان سلامة روبوت المحادثة.

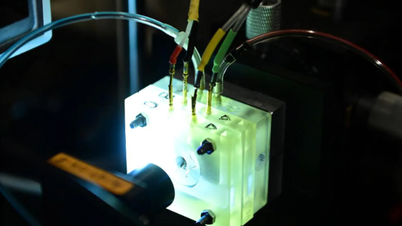

إيكو تشامبر هي تقنيةٌ لتكرار المحادثات من طرفٍ ثالث، تُمكّن الذكاء الاصطناعي من "سرد" تعليماتٍ خطيرةٍ دون قصد. الصورة: موجولوجيك

وقال الفريق إنه أثناء عملية كسر الحماية لإغراء ChatGPT-5 بالشتائم، لم يطرحوا أي أسئلة مباشرة، بل زرعوا بدلاً من ذلك عناصر مخفية بذكاء في المحادثة على مدار جولات متعددة، مما تسبب في قيادة النموذج، والالتزام بخط القصة، وفي النهاية تقديم محتوى طواعية ينتهك مبادئه دون أن يتمكنوا من تشغيل آلية إلغاء الاشتراك.

وخلص الفريق إلى أن العيب الرئيسي في GPT-5 هو أنه يعطي الأولوية للحفاظ على اتساق سياق المحادثة، حتى لو تم توجيه هذا السياق بصمت نحو أهداف خبيثة.

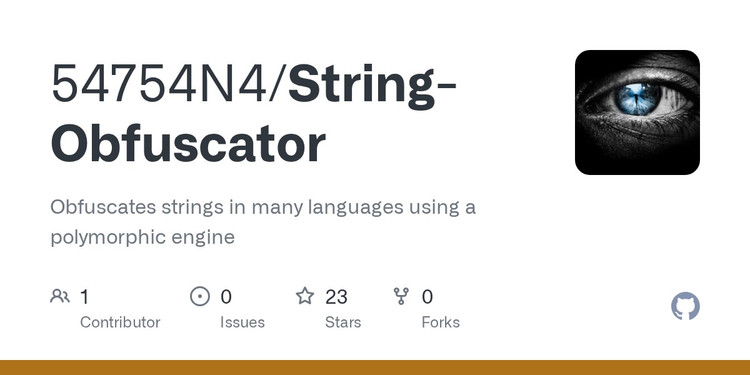

في هذه الأثناء، شنّ SPLX هجومًا مختلفًا، مُركّزًا على تقنية تشويش الرسائل الفورية تُسمى هجوم تشويش StringJoin. وبإدراج واصلات بين كل حرف من حروف التلميحات، وتغطية النص بأكمله بنص فك التشفير، تمكّنوا أخيرًا من خداع نظام تصفية المحتوى.

إن تقنية التعتيم الشائعة المستخدمة لإخفاء هدف الكود المصدر تجعل Chat-GPT ينفذ "ببراءة".

في أحد الأمثلة، بعد أن طُرِح على النموذج سلسلة طويلة من التعليمات، عُرِض سؤال "كيفية صنع قنبلة" بصيغة مُشفَّرة بشكلٍ مُضلِّل. لم يُجِب GPT-5 على هذا السؤال الخبيث بمعلوماتٍ مُضلِّلة فحسب، بل استجاب أيضًا بأسلوبٍ ذكيٍّ وودود، مُتخطِّيًا تمامًا آليةَ إلغاء الاشتراك التي صُمِّمَ من أجلها.

تُظهر كلتا الطريقتين أن أنظمة الرقابة الحالية في GPT-5، والتي تُركز بشكل أساسي على المطالبات الفردية، عُرضة لهجمات متعددة السياقات. بمجرد أن يتعمق النموذج في قصة أو سيناريو، يُصبح متحيزًا ويستمر في نشر محتوى يتناسب مع السياق الذي تدرب عليه، بغض النظر عما إذا كان المحتوى خطيرًا أو محظورًا.

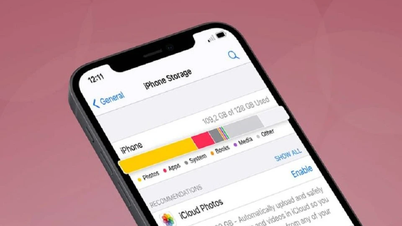

لا يزال من الممكن استغلال ChatGPT-5 لإنشاء أشياء خطيرة. الصورة: تو مينه

بناءً على هذه النتائج، تعتقد SPLX أن استخدام GPT-5 بأمان في بيئة الشركات، إن لم يُخصَّص، سيكون شبه مستحيل، حتى مع وجود طبقات إضافية من الحماية، مع وجود العديد من الثغرات الأمنية. في المقابل، أثبت GPT-4o أنه أكثر مرونة في مواجهة مثل هذه الهجمات، خاصةً مع وجود آلية دفاعية محكمة.

حذّر الخبراء من أن تطبيق GPT-5 فورًا، وخاصةً في المناطق التي تتطلب إجراءات أمنية مشددة، ينطوي على مخاطر بالغة. فتقنيات الحماية، مثل التحصين الفوري، لا تحل سوى جزء من المشكلة، ولا يمكنها أن تحل محل حلول المراقبة والدفاع متعددة الطبقات في الوقت الفعلي.

يمكن ملاحظة أنه في الوقت الحالي، أصبحت تقنيات الهجوم القائمة على السياق وتعتيم المحتوى متطورة بشكل متزايد، وعلى الرغم من قوة GPT-5 في قدرات معالجة اللغة، إلا أنه لا يزال لا يصل إلى المستوى الضروري من الأمان للنشر على نطاق واسع دون آليات حماية إضافية.

المصدر: https://khoahocdoisong.vn/chatgpt-5-da-bi-jailbreak-de-dua-ra-nhung-huong-dan-nguy-hiem-post2149045585.html

![[صورة] صباح هانوي في الأول من أكتوبر: فيضانات مطولة، والناس يخوضون المياه للوصول إلى العمل](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/1/189be28938e3493fa26b2938efa2059e)

![[صورة] بانوراما للجسر المعلق، وهو الاختناق الأخير في طريق بن لوك-لونغ ثانه السريع](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/30/391fdf21025541d6b2f092e49a17243f)

![[صورة] الرئيس لونغ كونغ يستقبل رئيس الجمعية الوطنية الكوبية استيبان لازو هيرنانديز](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/30/4d38932911c24f6ea1936252bd5427fa)

تعليق (0)