يقول خبراء الأمن إن عمليات الاحتيال باستخدام تقنية Deepfake خطيرة للغاية، ولكن هناك طرق يمكن للمستخدمين من خلالها التعرف على مقاطع الفيديو باستخدام تقنية الذكاء الاصطناعي هذه، وبالتالي تجنب الوقوع في فخ الأشرار.

خطر موجة الاحتيال باستخدام تقنية Deepfake

في تحذير صدر في 24 مارس، أفادت شرطة مقاطعة توين كوانغ بظهور طريقة متطورة للغاية للاحتيال والاستيلاء على الممتلكات عبر الإنترنت. يستخدم المحتالون تقنية التزييف العميق (وهي تقنية تستخدم الذكاء الاصطناعي لإنشاء منتجات صوتية وصورية وفيديو تُزيّف شخصيات حقيقية بدقة عالية) لإجراء مكالمات فيديو وهمية لاقتراض المال من الأقارب، أو التظاهر بأنهم أطفال يدرسون في الخارج ويتصلون بآبائهم طالبين منهم تحويل أموال لدفع الرسوم الدراسية، أو قد يُختلقون حالات طوارئ، مثل تعرض الأقارب لحادث وحاجتهم الماسة إلى مال لعلاج طارئ.

وفي الأيام الأخيرة، واصلت الشرطة في بعض المناطق الأخرى مثل هانوي وتاي نجوين التحذير من الحيل الاحتيالية للاستيلاء على الأصول على الإنترنت باستخدام تقنية Deepfake.

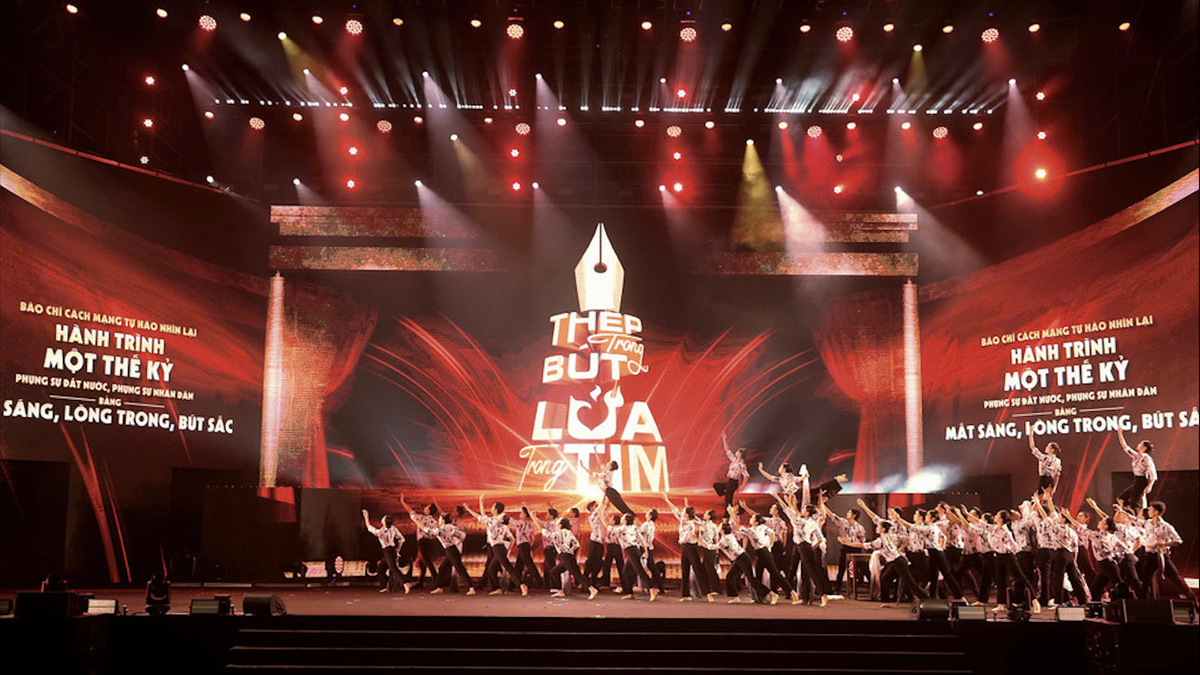

أصدرت الشرطة في عدة مقاطعات ومدن تحذيرات من الاحتيال باستخدام تقنية التزييف العميق. (صورة توضيحية: الإنترنت)

في مشاركة في ورشة عمل حول "الأمن السيبراني في الفضاء الرقمي - الاتجاهات والفرص" التي نظمها معهد البريد والاتصالات للتكنولوجيا (PTIT) في 27 مارس، قال الخبير نجو مينه هيو، المؤسس المشارك لمشروع ChongLuaDao.vn و Threat Hunter، المركز الوطني لمراقبة الأمن السيبراني، إن مقاطع الفيديو Deepfake ظهرت للتو في فيتنام، ولكن في الواقع، تم تطبيق تقنية الاحتيال والتزوير القائمة على الذكاء الاصطناعي هذه من قبل الجماعات الإجرامية الدولية منذ حوالي 2-3 سنوات.

كما حلل الخبير نغو مينه هيو وجود العديد من الأدوات على الإنترنت لمساعدة الأفراد على إنشاء فيديوهات ديب فيك. في المستقبل، عندما يتقن مجرمو الإنترنت في فيتنام كيفية سرقة الفيديوهات والصور، ونسخها ولصقها، ثم استخدام أدوات الإنترنت لإنشاء ديب فيك، ستحدث موجة من عمليات الاحتيال من الجيل الرابع، مما يجعل العديد من الأشخاص الذين لطالما كان من الصعب خداعهم ضحايا.

وأضاف الخبير نجو مينه هيو أن "الأشخاص في منتصف العمر وكبار السن هم الأكثر عرضة للاحتيال لأنهم يفتقرون إلى الوعي بأمن المعلومات والتكنولوجيا ويجدون صعوبة في التعرف على هذا النوع من الاحتيال المتطور".

تحدث الخبير نجو مينه هيو مع طلاب PTIT حول أشكال الاحتيال، بما في ذلك الاحتيال باستخدام Deepfake.

في معرض حديثه عن هذه المسألة، قال فو نغوك سون، المدير الفني لشركة NCS، إن تطبيقات التزييف العميق تزداد رواجًا، بل وتُثير مخاوف من فقدان السيطرة عليها. في البداية، صُممت هذه التطبيقات بهدف "تبديل الوجوه" لمساعدة المستخدمين على استبدال وجوههم وأصواتهم بسهولة بشخصيات من أفلام شهيرة. ويمكن اعتبارها الخطوة التالية في اتجاه تحرير الصور والدبلجة الفكاهية للمقاطع التي أثارت ضجة كبيرة في الماضي.

ومع ذلك، استغلّ المحتالون تطبيقات التزييف العميق لإنشاء مقاطع فيديو بمحتوى احتيالي ومنتحل. خسر الكثيرون أموالهم ظنًّا منهم أن أقاربهم وزملاءهم وقادتهم يتصلون بهم طالبين منهم تحويل أموال إليهم. تُستخدم هذه التقنية لأغراض أكثر سوءًا، ولذلك، عند ذكر التزييف العميق مؤخرًا، غالبًا ما يُفكّر الناس في أدوات سيئة.

كيفية تجنب عمليات الاحتيال باستخدام تقنية Deepfake

فيما يتعلق بالوقاية، حلل الخبير فو نغوك سون أنه نظرًا لعدم اكتمال قوة حوسبة تطبيقات التزييف العميق (Deepfake)، غالبًا ما تكون المقاطع المُنتجة بهذه التقنية ذات سعة تخزينية محدودة، ومدة زمنية قصيرة، وجودة صوت وصورة منخفضة. أكثر ما يُلاحظ هو تصلب الوجه وقلة انفعالاته. كما أن حركة جسم الشخصية في التزييف العميق ستكون أقل، خاصةً عند رفع أو خفض الوجه مقارنةً بالمقاطع العادية، ولن يكون هناك أي حركات فرك أو تغطية للوجه لأن الذكاء الاصطناعي سيتعامل مع الأخطاء عند تغطية الوجه جزئيًا. لذلك، إذا انتبهت جيدًا، يمكنك اكتشاف ذلك.

ويوصي الخبير فو نغوك سون المستخدمين بعدم الثقة في المقاطع القصيرة، أو ذات الجودة المنخفضة، أو الضبابية، أو غير الواضحة، أو ذات تعبيرات الوجه القليلة، أو حركات الجسم القليلة، أو الوجوه غير المنحنية، أو الأصوات غير الناعمة أو الرتيبة للغاية، والتي لا تحتوي على توقف مؤقت.

أكد خبير شركة NCS أيضًا على أهمية توخي المستخدمين الحذر. وتحديدًا، لا تثقوا بالشركة إذا تلقيتم مقاطع قصيرة أو مكالمات فيديو ذات جودة صورة أو صوت رديئة؛ تحققوا مرة أخرى بالاتصال مباشرةً بهاتف عادي؛ اطلبوا من المتصل وضع يده على وجهه أو الالتفاف يسارًا أو يمينًا؛ تحدثوا معه قدر الإمكان للتأكد من أن المكالمة حقيقية وليست فيديو مسجلًا مسبقًا. وبشكل خاص، يجب على المستخدمين عدم تحويل الأموال أو إرسال معلومات إلى عناوين أو حسابات غريبة.

يتفق الخبير نغو مينه هيو مع هذا الرأي، ويوصي بتوخي الحذر واليقظة لتجنب الوقوع ضحية للاحتيال. عندما يطلب منك شخص ما على مواقع التواصل الاجتماعي، أو في قائمة أصدقائك، اقتراض المال فجأةً أو يرسل رابطًا غريبًا، فلا تتسرع، بل كن هادئًا، وتحقق من الأمر مرارًا وتكرارًا.

يمكن للمستخدمين المصادقة بشكل استباقي عبر الاتصال المباشر أو عبر فيس تايم لمدة دقيقة واحدة على الأقل، ثم التظاهر بطرح أسئلة شخصية لا يعرفها إلا أنت والشخص الآخر. لأن تقنية التزييف العميق لن تتمكن من تزييف محادثة حقيقية في الوقت الفعلي بدقة عالية، كما نصح الخبير نغو مينه هيو.

وفقا لشبكة VNN

[إعلان 2]

مصدر

![[أخبار الملاحة البحرية] شركة وان هاي لاينز تستثمر 150 مليون دولار لشراء 48 ألف حاوية](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/6/20/c945a62aff624b4bb5c25e67e9bcc1cb)

![[إنفوجراف] لجنة الحزب بوزارة الثقافة والرياضة والسياحة: علامات الفترة 2020 - 2025](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/6/22/058c9f95a9a54fcab13153cddc34435e)

تعليق (0)