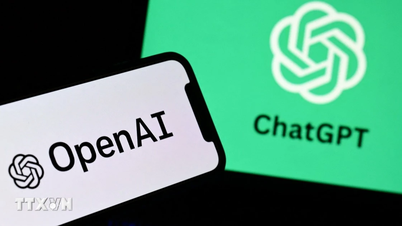

المحادثات الخاصة تصبح بيانات عامة

وفقًا لتقرير صادر عن شركة فاست كومباني، قامت جوجل بفهرسة آلاف المحادثات الخاصة. قد يكون هذا مجرد غيض من فيض، إذ يُحتمل أن تكون ملايين المحادثات الأخرى معرضة للخطر.

ورغم أن هذه المحادثات لم تتضمن معلومات تعريفية مباشرة، فإن العديد من المستخدمين شاركوا تفاصيل شخصية حساسة للغاية، من العلاقات إلى التجارب المؤلمة، مما يجعل التعرف على الهوية ممكنا.

بدأ كل شيء عندما اكتشف بعض خبراء الأمن السيبراني أنه بمجرد إجراء استعلام بسيط على Google، يمكن للمستخدمين الوصول بسهولة إلى الدردشات المشتركة علنًا.

ولا يقتصر المحتوى المسرب على فقرات نموذجية وأسئلة فنية، بل يشمل أيضًا معلومات شخصية، ومشاركة عمل حساسة، وحتى أسرار خاصة.

تم تحديد السبب في ميزة "مشاركة الدردشة"، وهي أداة طوّرتها OpenAI لمساعدة المستخدمين على مشاركة محتوى الدردشة مع الآخرين. عند اختيار المستخدمين خيار "جعل هذه الدردشة قابلة للاكتشاف"، يُنشئ النظام رابطًا عامًا يُمكن لمحركات البحث فهرسته.

ومن الجدير بالذكر أن واجهة هذه الميزة ليست واضحة بما فيه الكفاية، مما يتسبب في سوء فهم العديد من الأشخاص بأنهم يشاركون المحتوى مع الأصدقاء أو الزملاء فقط، بدلاً من جعله عامًا عبر الإنترنت.

ردًا على ردة الفعل العنيفة، اتخذت شركة OpenAI إجراءات فورية: حيث أوقفت مشاركة نتائجها وعملت مع Google لإزالة الروابط ذات الصلة.

وفقًا لشركة Fast Company، تم اكتشاف أكثر من 4500 رابط من هذا القبيل، وهو عدد ليس صغيرًا نظرًا لأن ChatGPT لديه مئات الملايين من المستخدمين في جميع أنحاء العالم.

ما يثير القلق هو أن العديد من الأشخاص استخدموا ChatGPT لكتابة رسائل البريد الإلكتروني، أو تبادل العمل، أو استغلال المعلومات الطبية ، أو حتى التحدث عن مشاكل نفسية شخصية، معتقدين أن هذه مساحة خاصة.

ناقوس الخطر يدق بشأن الخصوصية في عصر الذكاء الاصطناعي

تُثير هذه الحادثة تساؤلاتٍ جوهرية حول مسؤولية شركات الذكاء الاصطناعي عن بيانات المستخدمين. هل تُوفر OpenAI شفافيةً كافيةً للمستخدمين لفهم حقوقهم في الخصوصية؟ هل مستوى حماية البيانات الذي يحصل عليه المستخدمون مُتناسبٌ حقًا مع حساسية المحتوى؟

حذر الرئيس التنفيذي لشركة OpenAI سام ألتمان المستخدمين من مشاركة بياناتهم الشخصية الحساسة مع ChatGPT، معترفًا بأن الشركة قد تُجبر على تقديم مثل هذه المعلومات إذا طلب منها القانون ذلك من قبل المحكمة.

لكن الجدير بالذكر أن ألتمان لم يشر في تصريحاته إلى أن المحادثات التي يتشاركها المستخدمون طواعية يمكن فهرستها علناً على محركات البحث.

علاوة على ذلك، ليست هذه هي المرة الأولى التي يُشكك فيها في تسريبات بيانات ChatGPT. فقد حذّر باحثون من أن نماذج اللغات الكبيرة، مثل GPT، قد تُعيد إنشاء بيانات قديمة "عن طريق الخطأ" إذا طرح المستخدمون أسئلةً بذكاء.

لا شك أن أدوات مثل ChatGPT أحدثت ثورة في طريقة بحث الناس عن المعلومات وإنشاء المحتوى. ومع ذلك، بالإضافة إلى الراحة، يجب على المستخدمين إدراك أن الخصوصية الحقيقية لا تتحقق إلا بوجود حواجز تكنولوجية قوية وتعامل شخصي دقيق.

المصدر: https://baovanhoa.vn/nhip-song-so/hang-nghin-cuoc-tro-chuyen-chatgpt-bi-ro-ri-cong-khai-tren-google-158723.html

![[صورة] تم الانتهاء من بناء جسر بينه تريو 1، وتم رفعه بمقدار 1.1 متر، وسيتم افتتاحه أمام حركة المرور في نهاية نوفمبر.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/2/a6549e2a3b5848a1ba76a1ded6141fae)

تعليق (0)