|

| رسم توضيحي لدعوة لاعتبار الذكاء الاصطناعي سلاحًا بيولوجيًا. (المصدر: gizmodo.com) |

في مقال بعنوان "تعامل مع الذكاء الاصطناعي كسلاح بيولوجي وليس سلاحًا نوويًا" بقلم إميليا جافورسكي، عالمة وطبيبة ومديرة معهد مستقبل الحياة (الولايات المتحدة الأمريكية)، تزعم الكاتبة أنه على الرغم من حقيقة أن العالم قارن مؤخرًا بشكل متكرر الذكاء الاصطناعي بالقنابل النووية، إلا أن هناك نهجًا أكثر ملاءمة، وهو تنظيم هذا النوع من التكنولوجيا كسلاح بيولوجي أو تكنولوجيا حيوية.

وفقًا للمؤلف، يُعد الذكاء الاصطناعي ربما أقوى تقنية في تاريخ البشرية، وهي التي يطورها البشر اليوم. وقد وُثِّقت آثاره الضارة، بما في ذلك التمييز وتهديد الديمقراطية وتركيز النفوذ، توثيقًا جيدًا.

ومع ذلك، تتسابق شركات الذكاء الاصطناعي الرائدة لبناء أنظمة ذكاء اصطناعي قوية بشكل متزايد، وهو ما يؤدي إلى تصاعد المخاطر بمعدل غير مسبوق في تاريخ البشرية.

وبينما يسعى القادة إلى إيجاد طريقة لاحتواء والسيطرة على صعود الذكاء الاصطناعي والمخاطر المرتبطة به، فإنهم بحاجة إلى النظر في نفس القواعد والمعايير التي استخدمتها البشرية لإنشائه في الماضي.

إن التكيف والابتكار يمكن أن يتعايشا، وخاصة عندما تكون حياة البشر على المحك.

تحذير من التكنولوجيا النووية

على الرغم من أن الطاقة النووية أكثر أمانا من النفط بما يزيد على 600 مرة من حيث الوفيات، وهي فعالة للغاية، فإن القليل من البلدان تلمسها بسبب العواقب التي شهدتها من النهج طويل الأمد تجاه الطاقة النووية.

تعرّف العالم على التكنولوجيا النووية من خلال القنبلتين الذرية والهيدروجينية. بفضل هذه الأسلحة، ولأول مرة في التاريخ، طوّر البشر تقنيةً قادرة على القضاء على الحضارة الإنسانية، نتيجة سباق تسلحٍ ركّز على السرعة والابتكار بدلاً من السلامة والتحكم.

لقد أدت الإخفاقات اللاحقة في السلامة التقنية وإدارة المخاطر، والتي كانت مسؤولة بشكل واضح عن الكوارث النووية في تشيرنوبيل وفوكوشيما، إلى تدمير أي فرصة للناس لقبول الجوانب الإيجابية للطاقة النووية.

وعلى الرغم من التقييم الإيجابي العام للمخاطر المرتبطة بالطاقة النووية، وعقود من عمل العلماء لإقناع العالم بجدواها، فإن مفهوم "الطاقة النووية" نفسه لا يزال... ملوثاً.

عندما تُسبب تقنيةٌ ما ضررًا في مراحلها الأولى، فإن الوعي الاجتماعي وردود الفعل المبالغ فيها قد يحدّان بشكل دائم من فوائدها المُحتملة. وبسبب الأخطاء المبكرة في استخدام الطاقة النووية، لم تتمكن البشرية من الاستفادة من مصدرها النظيف والآمن للطاقة، ويظلّ الحياد الكربوني واستقرار الطاقة حلمًا بعيد المنال.

النهج الصحيح للتكنولوجيا الحيوية

ومع ذلك، في بعض المجالات، نجح الناس في ذلك. التكنولوجيا الحيوية أحد هذه المجالات، التي تُشجَّع على التطور السريع في ظل معاناة العديد من المرضى ووفاة الكثيرين منهم يوميًا بسبب أمراض لا علاج لها.

لا يهدف هذا البحث إلى "التحرك بسرعة وكسر الأشياء"، بل إلى الابتكار بأقصى سرعة وأمان ممكنين. يحدّ البشر من وتيرة الابتكار في هذا المجال من خلال نظام من اللوائح والأخلاقيات والمعايير التي تحمي رفاهية المجتمع والأفراد، وتحمي الصناعة من الشلل الناتج عن ردود الفعل العنيفة التي قد تؤدي إلى كارثة.

عندما حُظرت الأسلحة البيولوجية في اتفاقية الأسلحة البيولوجية خلال الحرب الباردة، اتفقت القوى العظمى المتعارضة على أن إنتاج مثل هذه الأسلحة ليس في مصلحة أحد. رأى القادة أن هذه التقنيات، التي يصعب السيطرة عليها، ولكن يسهل الوصول إليها، لا ينبغي اعتبارها آلية للفوز في سباق التسلح، بل تهديدًا للبشرية نفسها.

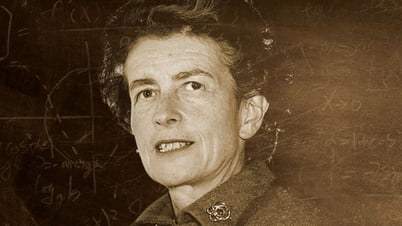

| إميليا جافورسكي من بين العلماء الذين وقّعوا مؤخرًا رسالة مفتوحة تدعو إلى تعليق تطوير الذكاء الاصطناعي لمدة ستة أشهر. كما وقّعت بيانًا يُحذّر من أن الذكاء الاصطناعي يُشكّل "خطر انقراض" على البشرية. |

إن التوقف المؤقت في سباق الأسلحة البيولوجية يسمح للبشر بتطويرها بوتيرة مسؤولة، مع قيام العلماء والهيئات التنظيمية بتطبيق معايير صارمة على أي ابتكار جديد من الممكن أن يضر البشر.

ولم تكن هذه التعديلات خالية من التكلفة، ولكنها أدت أيضاً إلى إنشاء اقتصاد حيوي ، مع العديد من التطبيقات في مجالات تتراوح من الطاقة النظيفة إلى الزراعة.

خلال جائحة كوفيد-19، استخدم علماء الأحياء تقنية mRNA لإنتاج لقاحات فعالة بسرعة غير مسبوقة في تاريخ البشرية.

أظهر استطلاع حديث لباحثي الذكاء الاصطناعي أن 36% من المشاركين يرون أن الذكاء الاصطناعي قد يُسبب كارثة نووية. ومع ذلك، كانت ردود الفعل واللوائح الحكومية بطيئة، وهو ما لا يتماشى مع وتيرة تبني التكنولوجيا، حيث تجاوز عدد مستخدمي تطبيق ChatGPT الآن 100 مليون مستخدم.

دفعت مخاطر الذكاء الاصطناعي المتصاعدة بسرعة 1800 رئيس تنفيذي و1500 أستاذ جامعي في الولايات المتحدة الأمريكية إلى توقيع رسالة مؤخرًا تدعو إلى وقف تطوير الذكاء الاصطناعي لمدة ستة أشهر، وإلى عملية تنظيمية عاجلة وتخفيف المخاطر. من شأن هذا التوقف أن يمنح المجتمع الدولي وقتًا للحد من الضرر الناجم عن الذكاء الاصطناعي، ومنع خطر كارثة لا رجعة فيها على مجتمعنا.

أثناء تقييم مخاطر الذكاء الاصطناعي وأضراره المحتملة، يجب علينا أيضًا مراعاة كيفية تجنب إغفال الإمكانات الإيجابية لهذه التقنية. إذا طورنا الذكاء الاصطناعي بمسؤولية الآن، فسنتمكن من جني فوائد هائلة منها. على سبيل المثال، فوائد تطبيق الذكاء الاصطناعي في اكتشاف الأدوية وتطويرها، وتحسين جودة الرعاية الصحية وتكلفتها، وزيادة فرص الوصول إلى الأطباء والعلاج الطبي.

أظهرت شركة ديب مايند التابعة لجوجل أن الذكاء الاصطناعي قادر على حل مشكلات بيولوجية جوهرية لطالما تجنبها البشر. ووفقًا للدراسة، يمكن للذكاء الاصطناعي أن يُسرّع تحقيق جميع أهداف التنمية المستدامة للأمم المتحدة، مما يدفع البشرية نحو مستقبل ينعم فيه الجميع بالصحة والمساواة والرخاء والسلام.

لقد حان الوقت للمجتمع الدولي أن يتحد، كما فعل قبل خمسين عامًا في اتفاقية الأسلحة البيولوجية، لضمان تطوير آمن ومسؤول للذكاء الاصطناعي. إذا لم نتحرك سريعًا، فإننا نخاطر بتدمير المستقبل المشرق للذكاء الاصطناعي ومجتمعنا الحالي.

[إعلان 2]

مصدر

تعليق (0)