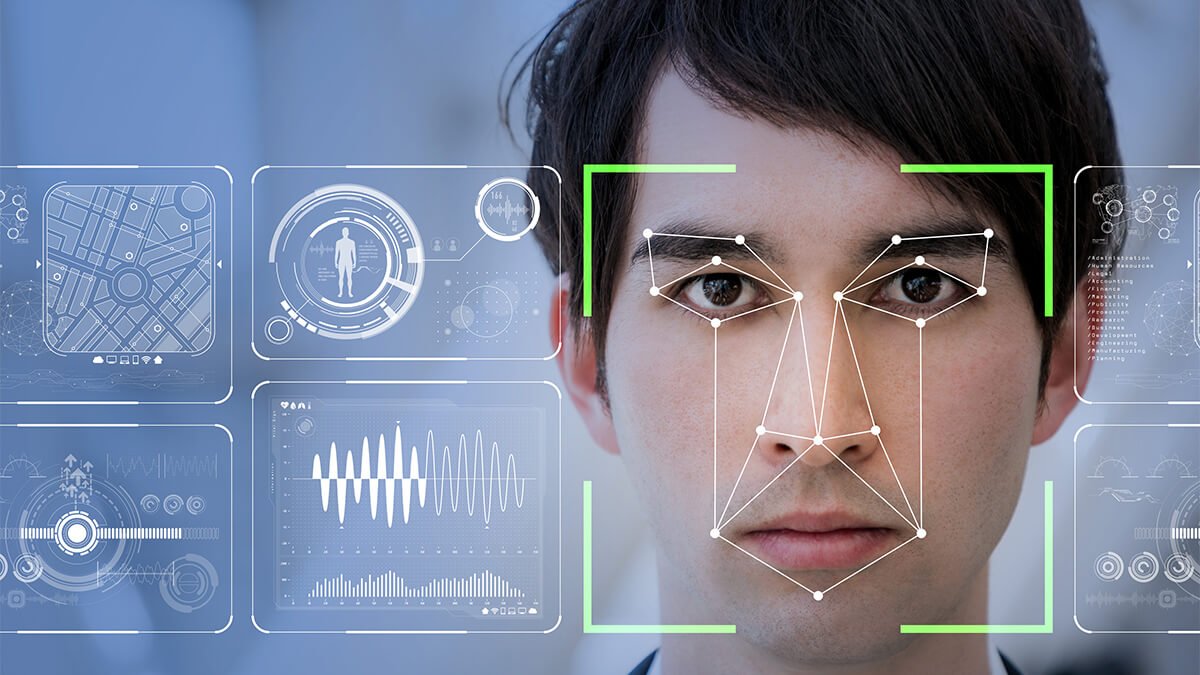

مع استمرار التقدم التكنولوجي في تشكيل وسائل التواصل الاجتماعي ووسائل الإعلام الجماهيرية، أصبحت تقنية التزييف العميق مصدر قلق كبير مع استمرار ارتفاع عدد عمليات الاحتيال باستخدام تقنية التزييف العميق.

يمكن استخدام Deepfakes لأغراض سيئة

بعد البحث في منتديات الشبكة المظلمة، حيث يعمل مجرمو الإنترنت في كثير من الأحيان، حددت كاسبرسكي أن هناك العديد من المجرمين الذين يستخدمون التزييف العميق للاحتيال، إلى الحد الذي يتجاوز فيه الطلب بكثير العرض من برامج التزييف العميق الموجودة حاليًا في السوق.

ومع تجاوز الطلب للعرض، يتوقع خبراء كاسبرسكي أن تزداد عمليات الاحتيال باستخدام تقنية التزييف العميق في تنوعها وتطورها، بدءًا من تقديم فيديو انتحال عالي الجودة مع خدمات إنتاج كاملة إلى استخدام صور المشاهير في البث المباشر المزيف على وسائل التواصل الاجتماعي والوعد بمضاعفة المبلغ الذي يرسله الضحية إليهم.

أصبحت تقنية التزييف العميق كابوسًا يهدد النساء والمجتمع. يستغل مجرمو الإنترنت الآن الذكاء الاصطناعي لدمج وجوه الضحايا في صور ومقاطع فيديو إباحية، بالإضافة إلى حملات دعائية. تهدف هذه الأشكال إلى التلاعب بالرأي العام من خلال نشر معلومات كاذبة أو حتى الإضرار بسمعة المؤسسات أو الأفراد. ندعو الجمهور إلى توخي المزيد من الحذر في مواجهة هذا التهديد، وفقًا للسيدة فو دونغ تو ديم، المديرة الإقليمية لكاسبيرسكي فيتنام.

وفقًا لـ Regula، وهو نظام مرجعي للمعلومات، تعرّض ما يصل إلى 37% من الشركات حول العالم لعمليات احتيال باستخدام التزييف الصوتي العميق، ووقع 29% منها ضحيةً لمقاطع فيديو مُزيّفة. وقد أصبحت هذه المقاطع تهديدًا للأمن السيبراني في فيتنام، حيث غالبًا ما يستخدم مجرمو الإنترنت مكالمات الفيديو المُزيّفة لانتحال شخصية شخص ما واقتراض مبالغ طائلة من أقاربه وأصدقائه للحالات العاجلة. علاوة على ذلك، يمكن إجراء مكالمة فيديو مُزيّفة في غضون دقيقة واحدة فقط، مما يُصعّب على الضحايا التمييز بين المكالمات الحقيقية والمزيفة.

في حين يتم إساءة استخدام الذكاء الاصطناعي من قبل المجرمين لأغراض خبيثة، لا يزال بإمكان الأفراد والشركات الاستفادة من الذكاء الاصطناعي لتحديد التزييف العميق لتقليل احتمالية نجاح عمليات الاحتيال.

تشارك كاسبرسكي حلولاً للمستخدمين لحماية أنفسهم من عمليات الاحتيال باستخدام تقنية Deepfake:

أدوات كشف المحتوى بالذكاء الاصطناعي : تستخدم برامج كشف المحتوى المُولّدة بالذكاء الاصطناعي خوارزميات ذكاء اصطناعي متقدمة لتحليل ملفات الصور والفيديو والصوت وتحديد درجة التلاعب بها. بالنسبة لمقاطع الفيديو المُزيّفة، تساعد بعض الأدوات في تحديد حركات الفم والكلام غير المتطابقة. كما تكتشف بعض الأدوات تدفق الدم غير الطبيعي تحت الجلد من خلال تحليل دقة الفيديو، لأن لون أوردة الإنسان يتغير عند ضخ القلب للدم.

محتوى الذكاء الاصطناعي المُعَلَّم بعلامة مائية : تُعَدُّ العلامات المائية بمثابة علامات تعريف في الصور والفيديوهات وغيرها، لمساعدة المؤلفين على حماية حقوق الطبع والنشر لأعمال الذكاء الاصطناعي. ومع ذلك، يُمكن أن تُصبح هذه الأداة سلاحًا ضد التزييف العميق، إذ يُمكنها المساعدة في تتبع أصل المنصة التي أنشأت الذكاء الاصطناعي.

منشأ المحتوى : نظرًا لأن الذكاء الاصطناعي يجمع كميات كبيرة من البيانات من مصادر مختلفة لإنشاء محتوى جديد، فإن هذا النهج يهدف إلى تتبع أصل هذا المحتوى.

مصادقة الفيديو : هي عملية التحقق من عدم تعديل محتوى الفيديو منذ إنشائه. هذه هي العملية التي تهمّ مُنشئي الفيديو بشكل خاص. تستخدم بعض التقنيات الناشئة خوارزميات تشفيرية لإدراج قيم تجزئة على فترات زمنية محددة في الفيديو. في حال تعديل الفيديو، ستتغير قيمة التجزئة.

[إعلان 2]

رابط المصدر

تعليق (0)